零、概念和研究背景

“众人拾柴火焰高”,合作是人类社会中重要的组织方式,人们通过合作能够达到个体难以企及的高度。研究发现,群体能够做出更优、更理性的决策,即使其中的个体是不理性的,这被称为群体的智慧(The wisdom of crowds)。当然,要想更好地体现群体的力量,要求群体中的个体具有独立性和多样性[1]。

随着大模型智能体的发展,许多研究开始关注多个大模型智能体之间的交互,比如著名的AI小镇。那么,除了简单的互动,大模型智能体能否通过合作,以实现单个智能体无法完成的复杂任务呢?

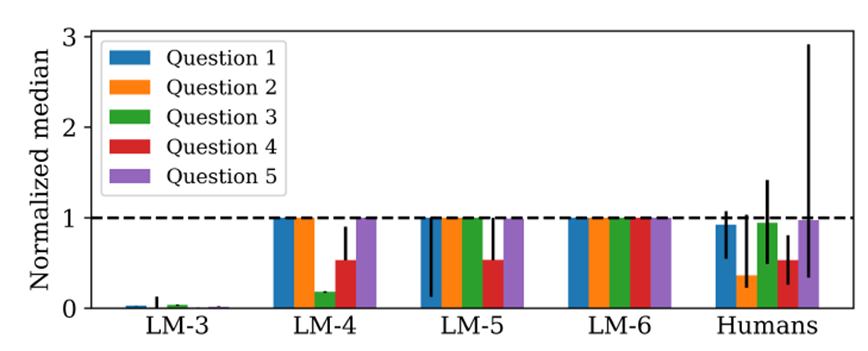

有研究尝试在大模型智能体上验证人类群体实验的结果[2],发现大模型和人类有很大的差异。比如在回答常识问题时,不同人的回答可能有很大差别,但大模型回答的方差很小,无论让它扮演什么样的人,回答都基本一致,这不满足前文所说的独立性和多样性的要求。这样看来,大模型智能体的合作并不是那么简单和显然。

本文将通过调研相关文献,总结研究者们如何设计大模型多智能体合作的方法,以更好地解决问题。

图1. 大模型和人类在回答常识问题上的差异 [2]

[1] Page, Scott. The difference: How the power of diversity creates better groups, firms, schools, and societies-new edition. Princeton University Press, 2008.

[2] Aher, Gati V., Rosa I. Arriaga, and Adam Tauman Kalai. “Using large language models to simulate multiple humans and replicate human subject studies.” International Conference on Machine Learning. PMLR, 2023.

一、相关研究梳理

现有工作中,大模型多智能体合作大致分为两个步骤,角色扮演(role-play)和协作流程(collaboration workflow)。其中角色扮演是让多个智能体扮演不同的角色、做不同的事;协作流程是指多个智能体通过交流、讨论、总结等方式,共同完成目标任务。本文将首先介绍常见的角色扮演和协作流程,然后介绍对合作机制本身的若干研究,最后总结大模型多智能体合作相关文献中常用的benchmark。

图2. 大语言模型多智能体合作介绍框架

二、多智能体合作中的角色扮演

多智能体合作的第一步通常是让多个智能体扮演不同的角色,这包括预定义的角色扮演和动态更新的角色扮演两类方法。

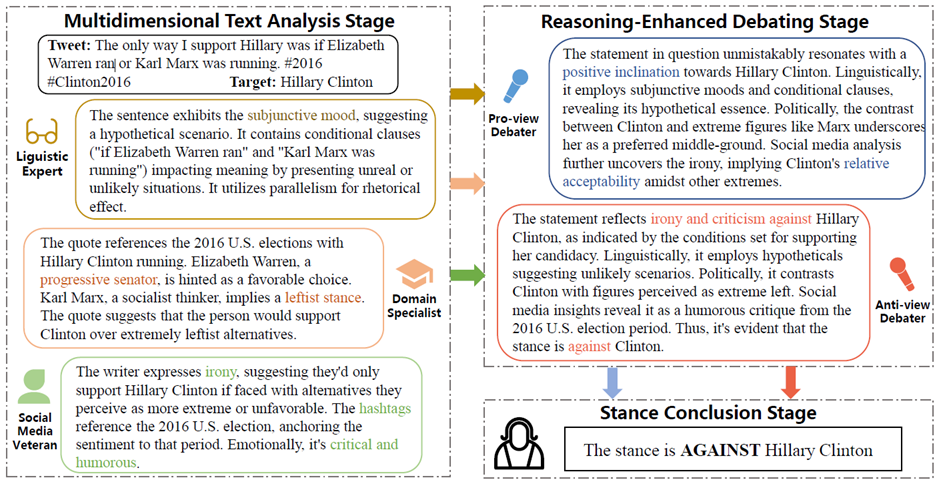

1. 预定义的角色扮演。最常见的角色扮演方法是根据人类的经验或者相关知识预先定义好每个角色,根据角色扮演的作用可以分为两种类型。其一是让不同角色提供多样的视角和知识。

比如在社交媒体文本立场检测的任务中[3],作者让智能体分别扮演语言学家、领域知识专家、社交媒体达人,从多个角度对文本进行更全面的分析。

在文本质量评价任务中[4],作者设置了公众、批评家、新闻记者、心理学家、科学家等多种角色,发现增加角色的数量能有效提升任务效果。其二是将复杂任务拆解,让不同角色完成不同的子任务。比如在软件开发任务中[5],作者模仿人类软件开发中的不同角色,设置了产品经理、架构师、项目经理、工程师等,分别负责不同任务。在解决运筹学问题时[6],作者设置了11个角色,分别负责术语解释、参数提取、变量提取、约束提取、写代码、审阅代码等。

图3. 通过预定义的多个智能体,从不同角度全面地分析社交文本[3]

2. 动态更新的角色扮演。

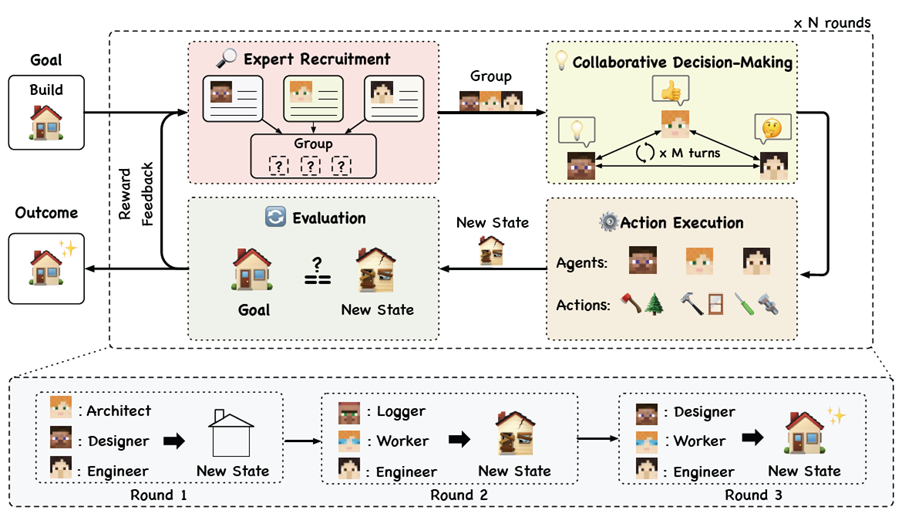

这种方法是指在合作中根据实际情况,动态生成和更新角色。

比如文献[7]中设置了一个招募者(recruiter),每一轮根据当前的任务进度进行“专家招募”,即生成若干个智能体的提示词,并据此构建智能体。然后,这些构建的智能体进行讨论并执行任务。若未能完成,则进入下一轮,招募者可以根据任务完成情况招募其他的专家。这种方法无需根据先验知识预定义角色,具有更好的泛用性。

图4. 动态更新的角色扮演 [7]

[3] Lan, Xiaochong, et al. “Stance detection with collaborative role-infused llm-based agents.” Proceedings of the International AAAI Conference on Web and Social Media. Vol. 18. 2024.

[4] Chan, Chi-Min, et al. “ChatEval: Towards Better LLM-based Evaluators through Multi-Agent Debate.” The Twelfth International Conference on Learning Representations.

[5] Hong, Sirui, et al. “MetaGPT: Meta Programming for A Multi-Agent Collaborative Framework.” The Twelfth International Conference on Learning Representations.

[6] Xiao, Ziyang, et al. “Chain-of-Experts: When LLMs Meet Complex Operations Research Problems.” The Twelfth International Conference on Learning Representations. 2023.

[7] Chen, Weize, et al. “Agentverse: Facilitating multi-agent collaboration and exploring emergent behaviors.” The Twelfth International Conference on Learning Representations. 2023.

三、多智能体合作中的协作流程

在角色扮演之后,不同角色的智能体需要通过一定的交互方式和顺序来共同完成任务,这样的协作流程可以大致分为:参考人类的组织形式、自发讨论和一些其他形式。

1. 参考人类的组织形式。

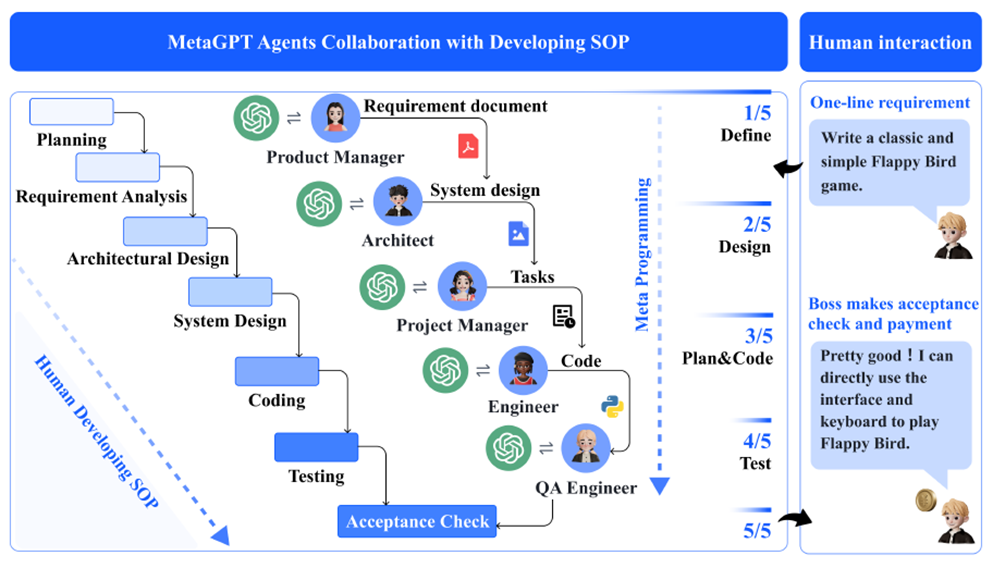

在人类长期的合作经验中,已经产生了许多成熟的协作流程,可以直接借鉴用于大模型智能体的合作。比如前文所述软件开发的任务中[5],各智能体完全按照人类的标准操作流程(Standardized Operating Procedures,SOP)来执行:产品经理先进行需求分析,然后交给架构师进行架构设计,项目经理进行系统设计,工程师写代码等。同时,智能体之间的信息交流也按照标准以结构化的方式进行,以减少大模型的幻觉。

图 5. 模拟人类软件开发SOP的协作流程 [5]

2. 自发讨论。

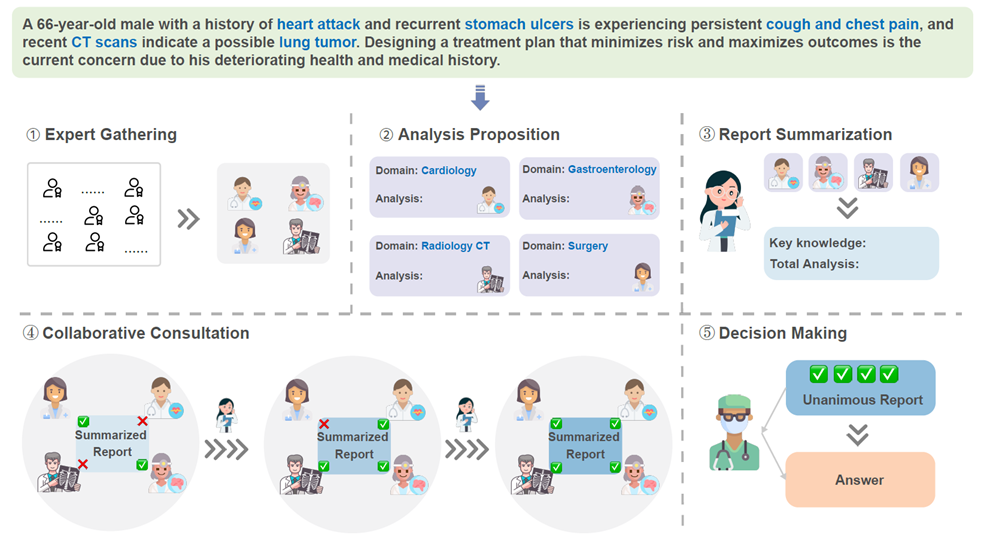

这种方式是指多个智能体进行若干轮讨论,然后总结得到最终结果。讨论的过程一般是智能体按一定顺序发言,同时每个智能体可以接收到之前其他人的发言。总结的方法包括投票、让大模型概括讨论内容、由一个裁判智能体根据讨论内容得出最终结论等。以医疗诊断任务为例[8],智能体首先扮演不同医疗领域的专家,给出初始诊断报告。然后进行讨论,每一轮中每个专家对报告进行修改,直到所有专家均满意,得到最终的诊断报告。

图 6. 多智能体通过讨论完成医疗任务 [8]

3. 其他形式。

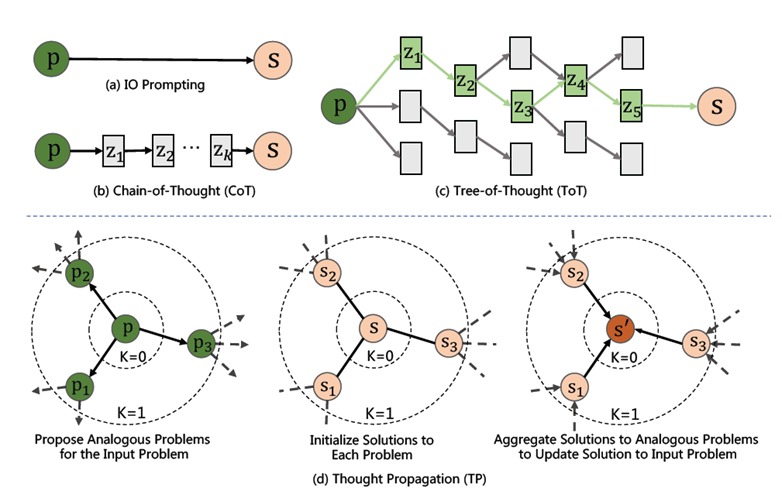

此外,智能体还有许多其他的协作流程。比如[9]提出一种基于类比的方法。对于目标问题,首先提出若干类似的问题,然后给出原问题和类似问题的解决方法,最后对原问题和类似问题的解答进行聚合,并更新原问题的解答。这种解决问题的结构类似GNN的消息传播,也可以堆叠多层。其思想是通过相似问题的解答进行类比和借鉴,从而辅助解答原问题。

图 7. 多智能体通过类比的方法解决问题[9]

[8] Tang, Xiangru, et al. “Medagents: Large language models as collaborators for zero-shot medical reasoning.” ACL, 2024.

[9] Yu, Junchi, Ran He, and Rex Ying. “Thought propagation: An analogical approach to complex reasoning with large language models.” ICLR, 2024.

四、对合作机制的研究

除了设计合作机制,还有一些工作关注合作机制本身,研究什么样的合作机制效果更好。比如[10]从社会心理学的视角出发,构建了“自负”和“随和”两种性格的智能体,并通过“讨论”和“反思”两种方式进行合作。实验发现,合作方式对性能影响大,讨论比反思效果更好,而智能体的性格影响不大。

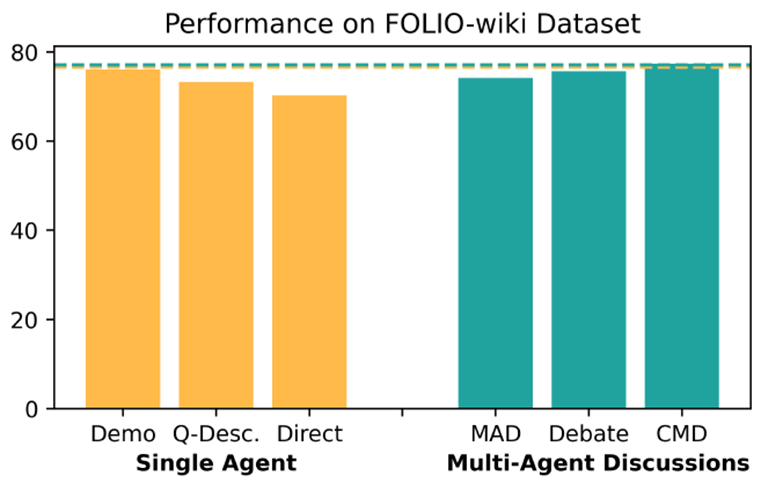

此外,文章[11]发现,在提示词足够强的情况下(比如提供了few-shot的例子),单个智能体的性能可以和多智能体的讨论相近;而在提示词中没有例子的情况下,多智能体讨论能显著提升性能。

图 8. 在提示词足够好时,单个智能体能达到和多智能体合作接近的效果 [11]

[10] Zhang, Jintian, Xin Xu, and Shumin Deng. “Exploring collaboration mechanisms for llm agents: A social psychology view.” ACL 2024.

[11] Wang, Qineng, et al. “Rethinking the Bounds of LLM Reasoning: Are Multi-Agent Discussions the Key?.” ACL 2024.

五、常用Benchmark

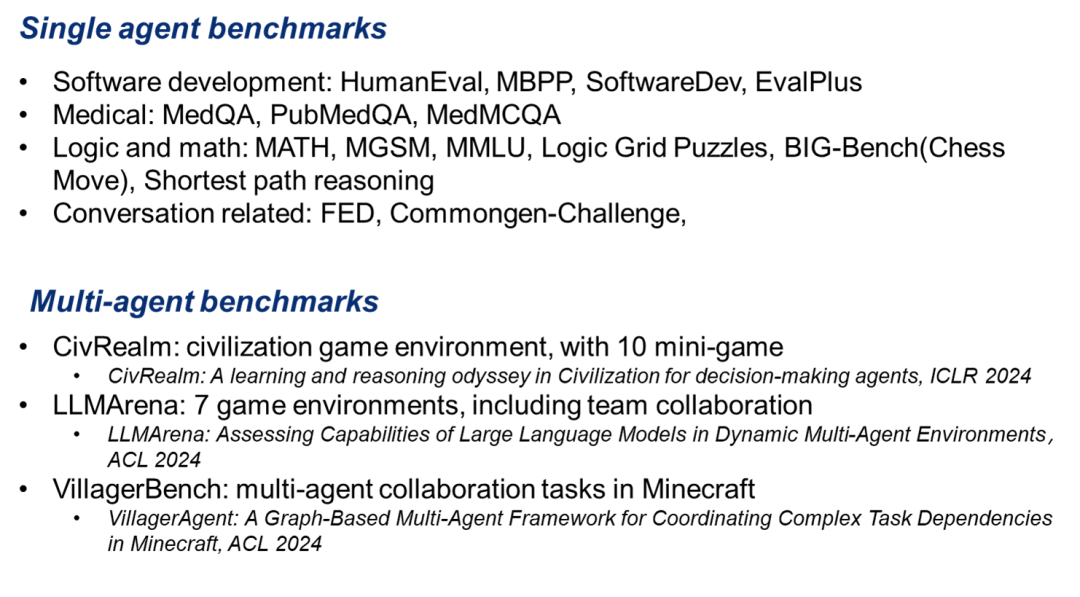

多智能体合作的研究中常用的Benchmark如图9所示。总体看来,前面提到的工作主要用的都是单智能体的Benchmark,意在说明合作能比单个智能体效果更好;而专为多智能体设计的Benchmark较少,也大多还未被广泛使用。

图 9. 多智能体合作的Benchmark总结

未来展望

上述研究展现了研究者们对大模型多智能体合作的努力,我们相信在该领域有更多的研究方向等待挖掘与探索。

首先,多智能体合作效果更好的原因是什么?对此,现有研究仍然缺乏全面的分析,是一个值得探索的问题。

第二,现有工作已经将人类软件开发的标准操作流程(SOP)应用到多智能体合作中,那么还有哪些领域有类似的SOP,是否能用于指导合作方式的设计,以及构建相应的Benchmark?

第三,现有的角色扮演和协作流程大多需要人为设计。未来工作可以考虑自动搜索和优化角色扮演和协作流程。

最后,若我们在大模型智能体的合作中能发现某些规律,或者某些优秀的合作方式,是否可以对人类的组织合作方式产生启发,可以通过人类的实验进行验证。

如何学习大模型?

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

5. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方CSDN官方认证二维码,免费领取【

保证100%免费】

1402

1402

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?