论文:Semantic Image Synthesis with Spatially-Adaptive Normalization

论文链接:https://arxiv.org/abs/1903.07291

代码链接:https://github.com/NVlabs/SPADE

项目主页链接:https://nvlabs.github.io/SPADE/

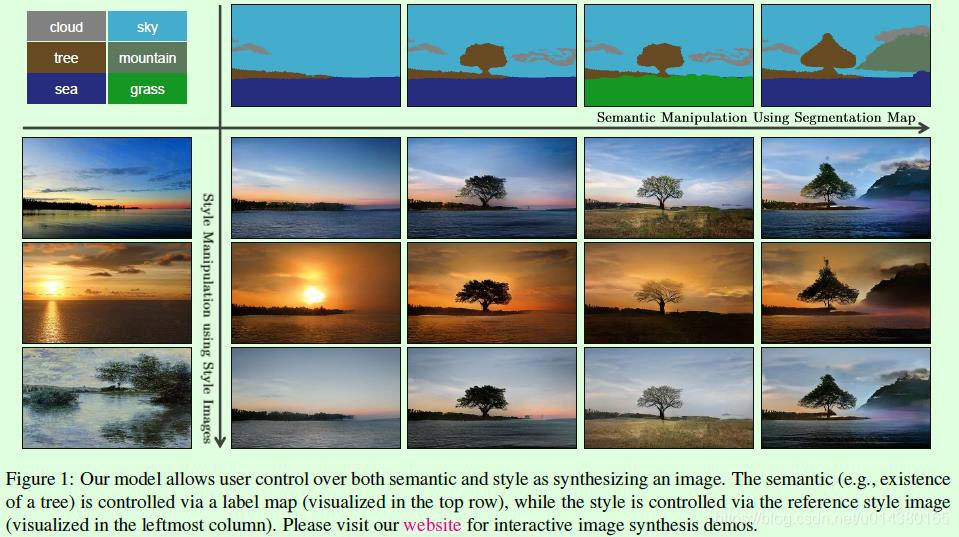

图像生成领域最近今年有不少出色的作品,比如英伟达在GTC 2019上展示的GauGAN,随后很多AI公众号都推送了相关文章,且大部分文章中将这个算法(GauGAN)称之为神笔马良,这是因为GauGAN可以根据用户画的简单图像(如Figure1最上面一行的4张图像所示)得到合成的实际图像(如Figure1右下角的12张图所示),在合成时用户还可以选择合成图像的风格(如Figure1最左边的3张图像所示),因此可以得到非常多样的合成结果。

虽然在GTC和大部分的介绍文章中都将这篇论文提出的算法称之为GauGAN,不过在这篇论文中作者将这个算法简称为SPADE,和论文名中的Spatially-Adaptive Normalization对应,接下来我们就都称之为SPADE了,大家知道本质上和GauGAN是一个算法就行了。

SPADE发表在CVPR 2019的Oral文章,CVPR 2019上还有一篇令人印象深刻的图像生成论文:StyleGAN,获得了最佳论文提名,在我看来这2篇文章都非常值得细细品读。这2篇论文的大部分作者都来自英伟达,不得不

SPADE(Spatially-Adaptive Normalization)是CVPR 2019的一篇Oral论文,它解决了在语义图像合成中传统归一化层易丢失信息的问题。该算法通过适应性地计算γ和β,改进了BN层,能根据语义分割图生成逼真的图像。与pix2pix和pix2pixHD相比,SPADE在保持细节和风格方面表现出色,同时支持多样化的图像生成。其网络结构由多个SPADE ResBlk组成,判别器采用了Patch-GAN。通过编码网络,SPADE还能实现输入图像风格的转换。

SPADE(Spatially-Adaptive Normalization)是CVPR 2019的一篇Oral论文,它解决了在语义图像合成中传统归一化层易丢失信息的问题。该算法通过适应性地计算γ和β,改进了BN层,能根据语义分割图生成逼真的图像。与pix2pix和pix2pixHD相比,SPADE在保持细节和风格方面表现出色,同时支持多样化的图像生成。其网络结构由多个SPADE ResBlk组成,判别器采用了Patch-GAN。通过编码网络,SPADE还能实现输入图像风格的转换。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?