-

作者:Yuxiang Ji, Boyong He, Zhuoyue Tan, Liaoni Wu

-

单位:厦门大学人工智能研究院,厦门大学航空航天学院

-

标题:Game4Loc: A UAV Geo-Localization Benchmark from Game Data

-

原文链接:https://arxiv.org/pdf/2409.16925

-

项目主页:https://yuxiang-ji.com/game4loc/

-

代码链接:https://github.com/Yux1angJi/GTA-UAV

主要贡献

-

首个支持部分匹配的大规模无人机地理定位数据集GTA-UAV,基于游戏生成3万余张多场景、多高度(80m~650m)无人机图像,定义“正样本”(高重叠)和“半正样本”(低重叠),突破传统完美匹配假设;

-

扩展任务定义,从图像检索升级到米级定位,提出基于距离的评估指标(SDM@3、Dis@1),直接量化定位精度;

-

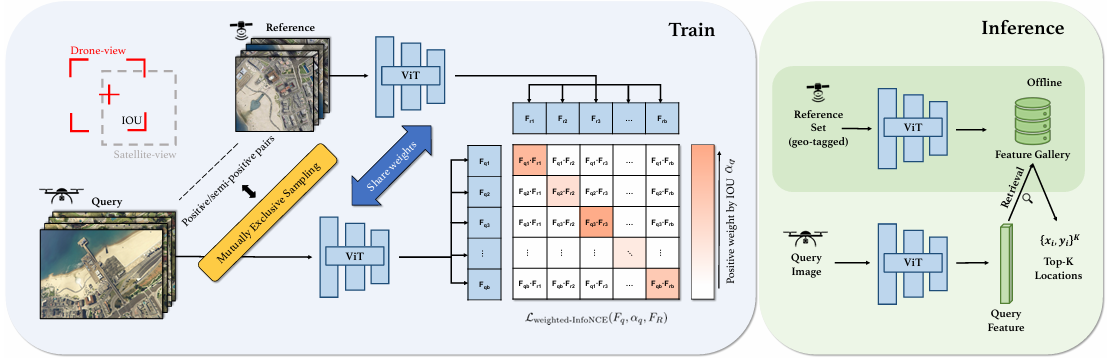

提出加权对比学习方法(Weighted-InfoNCE),利用IOU动态调整损失权重,结合互斥采样策略提升训练稳定性;

-

实验表明加权方法较传统InfoNCE将R@1提升20.08%、定位误差降低234米,且预训练模型在真实数据集UAV-VisLoc上表现最佳,证实其泛化能力。

研究背景

研究问题

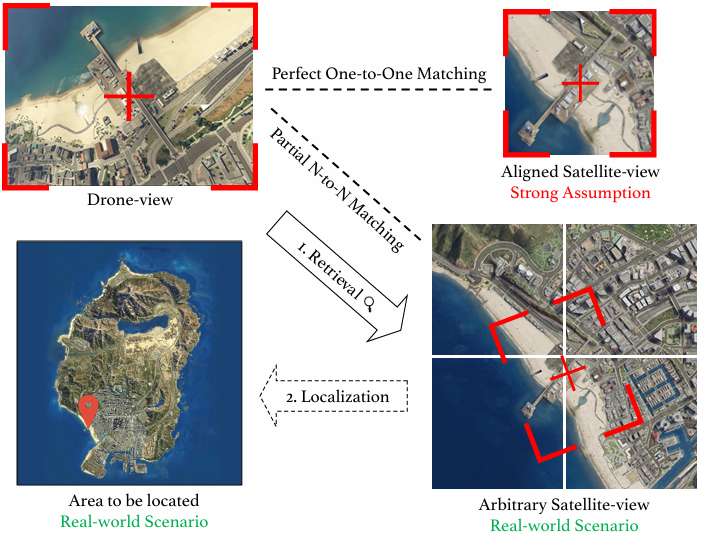

论文主要解决的问题是如何在GPS拒止环境下,利用无人机视角图像和卫星视角图像进行无人机地理定位(UAV Geo-Localization)。

现有的基于深度学习的方法通常假设存在完美的一对一匹配参考图像,但在实际场景中,这种完美匹配几乎不存在,更多的是部分匹配的情况。

研究难点

该问题的研究难点包括:

-

获取大规模无人机视角图像的高成本和隐私问题;

-

现有数据集大多基于小规模航拍图像,且假设存在完美匹配,与实际应用场景不符;

-

如何有效地处理部分匹配对以提高定位的准确性和鲁棒性。

相关工作

-

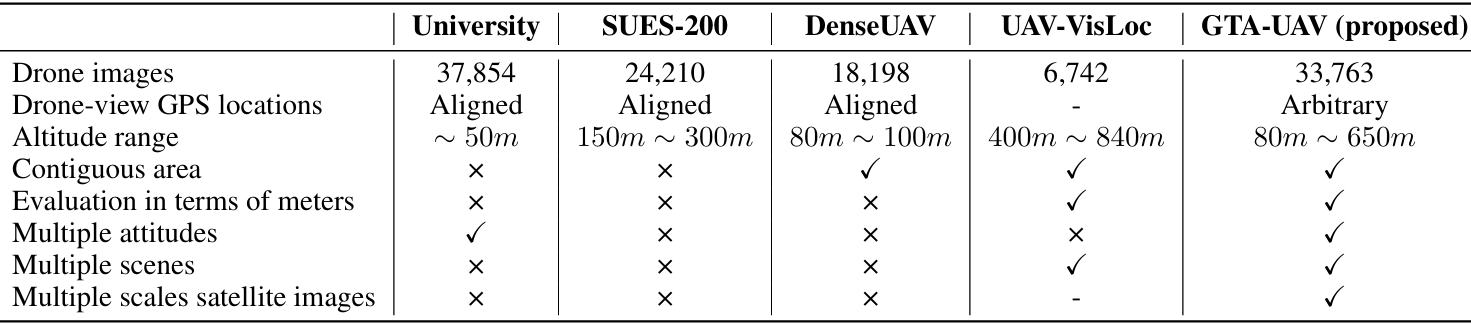

数据集的局限性

-

规模与多样性不足:早期数据集(如University-1652、SUES-200)仅包含少量图像,且多为单一场景(如校园、道路)。后续数据集(如RGB-World、Aerial Image Labeling)虽扩大覆盖范围,但仍受限于卫星图像与无人机图像的完美配对假设(即两图需严格对齐)。

-

高度与姿态限制:现有数据集多聚焦特定飞行高度(如20-50米),缺乏多尺度(如80米至650米)覆盖,难以支持复杂场景下的定位需求。

-

-

匹配方法的局限性

-

依赖精确配对:传统方法(如基于特征点匹配、CNN-RNN)假设无人机与卫星图像间存在一一对应关系,未考虑实际场景中的部分匹配问题(如视角差异、遮挡干扰)。

-

对比学习未适配部分匹配:现有对比学习方法(如InfoNCE)直接应用于图像检索任务,未针对地理定位中“不完全匹配”的特性进行改进。

-

GTA-UAV 数据集

问题描述

-

现有无人机视觉地理定位研究多基于“完美匹配”假设,即每个无人机视图都能与卫星图像中的一张完全对齐的图像匹配。

- 然而,实际场景中由于视角、高度、遮挡等因素,无人机视图通常只能与卫星图像进行部分匹配。为解决这一差距,本文提出了一种新的任务定义:

-

扩展任务类型:从传统的完美匹配检索扩展到包含部分匹配对的检索任务。

-

量化定位精度:将图像级检索扩展到实际的米级距离定位(而非仅依赖检索结果的顺序)。

-

数据集构建

数据来源

-

模拟平台:使用 GTAV 生成无人机视图图像,覆盖城市、山地、沙漠、森林、田野和海岸等多种场景。

-

卫星图像:基于游戏地图的地理信息,构建分辨率0.2米的卫星图像,并划分为8个层次瓦片(地面分辨率逐级减半)。

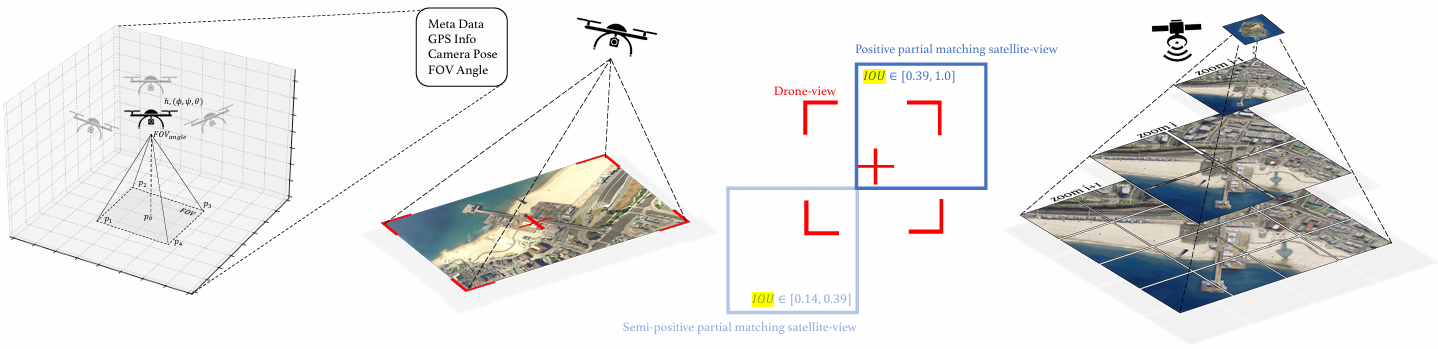

数据构造流程

-

无人机视图采集:

-

飞行高度范围:80m ~ 650m;

-

角度范围:俯仰角θ ∈ [-100°, -80°],横滚角φ ∈ [-10°, 10°],偏航角ψ ∈ [-180°, 180°]。

-

每张无人机图像标注GPS坐标(米级精度)。

-

-

卫星图像处理:

-

将游戏地图(81.3km²)划分为256×256像素的方片,共14,640张(缩放级别4~7)。

-

-

配对策略:

-

正样本:无人机视图与卫星图像的IOU> 0.39;

-

半正样本:IOU ∈ [0.14, 0.39]。

-

采用“收集-匹配”方法,避免强制对齐,模拟真实场景中的非完美匹配。

-

权重对比学习

-

利用正/半正样本的IOU作为权重标签,设计加权InfoNCE损失函数,通过参数化Sigmoid函数动态调整权重系数,平衡部分匹配对的监督强度。

评估协议

评估指标

-

检索任务:

-

R@K:前K个结果中包含正确样本的比例;

-

AP:平均精度(按查准率-查全率曲线积分)。

-

-

定位任务:

-

SDM@K:结合检索结果的位置信息计算的空间距离指标;

-

Dis@1:前1个检索结果与查询位置的欧氏距离误差(单位:米)。

-

-

数据划分:

-

同区域(Same-Area):训练与测试数据来自同一游戏区域;

-

跨区域(Cross-Area):训练与测试数据来自不同区域,场景不同。

-

基于跨视图匹配的地理信息定位

基线框架

建立公平的对比基准,验证现有方法在非完美匹配场景下的局限性。

核心组件

-

特征提取器:使用ViT-Base模型,输入尺寸调整为384×384像素。

- 损失函数:

-

Triplet Loss:最小化锚点(Anchor)、正样本(Positive)、负样本(Negative)的距离差异;

-

InfoNCE Loss:通过最大化同类样本的相似性概率: 其中表示第个样本与第个样本的相似度,为温度参数。

-

- 数据输入:

-

每个batch包含个无人机图像及其对应的卫星图像候选集(共张)。

-

实验设置

-

训练时固定正样本与半正样本的匹配关系;

-

未引入权重机制,直接使用InfoNCE损失。

样本权重自适应调整

-

传统InfoNCE损失无法区分正样本(高IOU)与半正样本(低IOU)的贡献,导致部分匹配场景下监督信号不足。

-

提出了一种加权对比学习方法weighted-InfoNCE,利用部分匹配数据区域的交集比例作为权重标签进行对比学习:

-

其中,表示一个编码的查询图像,表示同一批次中另一个视图的编码参考图像,表示正/半正参考对,表示可学习的参数,是通过参数Sigmoid计算的权重系数。

-

动态权重分配:

-

根据正样本与半正样本的IOU值,为每对样本分配权重: 其中为Sigmoid函数,为超参数。

-

权重通过线性变换映射到(0,1),高IOU样本获得更高权重。

-

互斥采样

问题

-

在基于对称InfoNCE损失的训练过程中,为了建立样本对之间的负样本关系,需要在每个批次中采样互不相关的正样本对。

-

然而,由于无人机视角和卫星视角图像之间不存在严格的一对一关系,直接采样可能导致同一批次中出现相关联的跨视角数据,从而影响训练效果。

方案

-

论文提出了一种互斥采样方法,通过图论的思想来确保每个批次中的样本对是独立的。

-

具体来说,将每张图像视为图中的一个节点,将匹配关系视为无向边。

-

在采样过程中,每次采样后会移除已采样的节点及其所有相邻节点,从而避免同一批次中出现相关联的样本对。

实验与分析

实现细节

-

网络架构:采用ViT-Base作为图像编码架构,patch-size为16×16,参数量为64M。

-

输入图像尺寸:无人机视角图像和卫星视角图像在输入网络前均被调整为384×384。

-

超参数设置:加权InfoNCE损失函数中的超参数k默认设置为5,可学习的温度参数初始化为1。

-

优化器及学习率调度:使用Adam优化器,初始学习率为0.0001,并采用余弦学习率调度器,训练每个实验共20个周期,每批次大小为64。

-

数据增强:在训练过程中,采用翻转、旋转和网格丢弃作为数据增强方法。

-

训练数据:默认情况下,同时使用正样本和半正样本进行训练,除非特别说明,后续子节中会针对此进行实验。

评估指标

检索任务指标:

-

Recall@K(R@K):对于每个无人机视角查询图像,检索结果中排名前K的卫星视角图像中至少有一个是正样本的概率。

-

平均精度(AP):衡量检索结果的准确性,考虑了检索结果中正样本的排名位置。

定位相关指标:

-

空间距离度量(SDM@K):结合检索和定位的综合指标,用于进一步评估定位性能。计算方法在补充材料中提供。在实验中,使用SDM@3作为评估指标。

-

距离误差(Dis@1):直观地提供检索结果的定位精度,即检索结果中排名前1的图像与无人机视角查询图像之间的距离。

GTA-UAV基准测试结果

比较方法

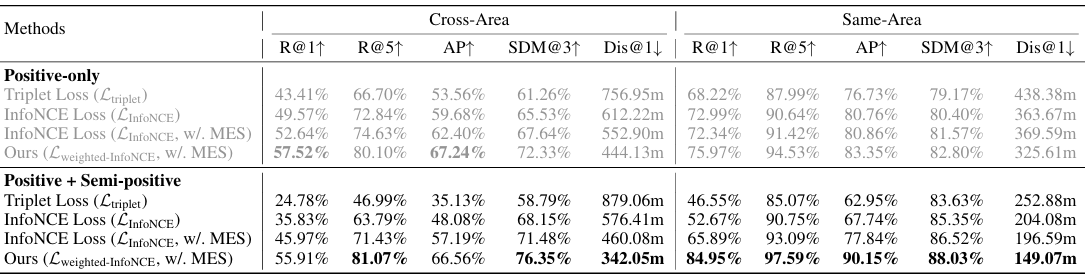

将提出的加权InfoNCE方法与之前最先进的训练方法(如三元组损失、InfoNCE损失等)在GTA-UAV数据集上进行比较,分别在跨区域(cross-area)和同区域(same-area)设置下,使用正样本+半正样本以及仅正样本作为训练数据。

结果分析

-

在跨区域设置下,加权InfoNCE方法在所有指标上均取得了最佳性能。与之前使用InfoNCE的SOTA方法相比,使用正样本+半正样本训练时,R@1提高了20.08%,Dis@1降低了234.36m。

-

使用正样本+半正样本训练的结果在检索准确率上低于仅使用正样本训练的结果,但在SDM@3和Dis@1指标上表现更好,这说明半正样本使模型能够学习到更全面的部分匹配关系。

-

在同区域设置下,加权InfoNCE方法同样取得了优异的性能,与其他方法相比,在R@1、R@5、AP、SDM@3和Dis@1等指标上均有显著提升。

-

结论:加权InfoNCE方法在处理部分匹配任务时具有更好的性能和稳定性,能够更好地适应实际场景中的无人机视觉定位任务。

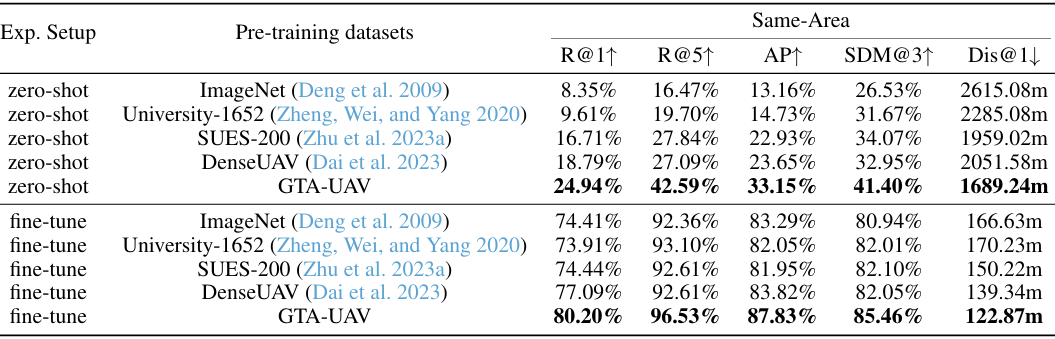

GTA-UAV的迁移能力

实验设置

-

为了进一步证明GTA-UAV数据集在实际应用中的重要性,评估了其预训练模型在真实数据集上的迁移能力。

-

选择最近发布的无人机视角数据集UAV-VisLoc作为真实数据,该数据集缺乏数据配对和任务设计,适合作为目标子集来评估GTA-UAV数据集的迁移能力。

实验结果

-

零样本迁移:与ImageNet、University-1652、SUES-200和DenseUAV等数据集预训练的模型相比,GTA-UAV预训练的模型在UAV-VisLoc数据集上展现了最佳的零样本性能。具体来说,R@1比第二好的结果高出6.15%,AP高出9.5%。

-

微调迁移:在UAV-VisLoc数据集上微调后,GTA-UAV预训练的模型仍然保持最高性能,其中Dis@1指标降低了16.47m。

-

结论:GTA-UAV数据集预训练的模型在真实无人机地理定位数据集上具有良好的迁移能力,能够更好地适应实际场景中的任务需求。

消融研究

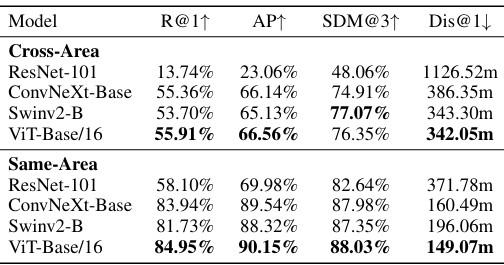

架构评估

-

对比了几种标准架构,包括ResNet-101、ConvNeXt-Base、Swinv2-B和ViT-Base/16。

-

在GTA-UAV数据集的跨区域任务及其对应的实际场景中,强调了对未知场景中未见数据的泛化能力。

-

实验结果表明,ViT在相同数量级参数下表现最佳,而ResNet由于其在处理显著位移、角度和场景变化时的代表性能力和泛化能力较弱,表现不佳。

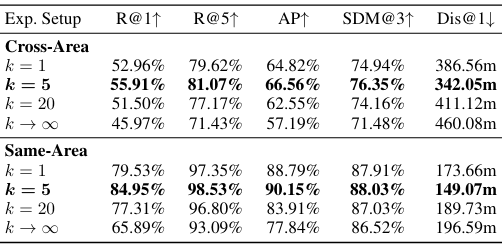

超参数评估

-

评估了加权InfoNCE损失函数中不同超参数k值对性能的影响。

-

实验结果表明,k值存在一个权衡,即在将部分匹配视为完全正样本和保持灵活性之间进行平衡。

-

不同k值的结果均优于k趋于无穷大时(即标准InfoNCE)的结果。

-

在跨区域设置下,k=5时取得了最佳性能,R@1为55.91%,R@5为81.07%,AP为66.56%,SDM@3为76.35%,Dis@1为342.05m;

-

在同区域设置下,k=5时同样取得了最佳性能,R@1为84.95%,R@5为97.59%,AP为90.15%,SDM@3为88.03%,Dis@1为149.07m。

-

考虑到加权InfoNCE的形式可以被视为InfoNCE的一种基于权重的标签平滑变体,还在补充材料中比较了InfoNCE与不同固定平滑值ϵ的结果。

总结

-

本文提出了一个新的基准和数据集GTA-UAV,用于无人机地理定位问题,特别是部分匹配对的情况。

-

通过引入加权对比学习方法weighted-InfoNCE,提升了模型在部分匹配任务中的性能。

-

实验结果表明,该数据集和方法在实际应用中具有显著的潜力和泛化能力。

489

489

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?