文章目录

一、理论基础

1、基本灰狼优化算法(GWO)

请参考这里。

2、改进的灰狼优化算法(IGWO)

(1)基于对数函数的非线性调整收敛因子 a a a

受粒子群算法中惯性权重设置的启发,本文提出一种新的非线性调整收敛因子

a

a

a的策略,计算公式如下:

a

(

t

)

=

a

i

n

i

t

i

a

l

−

(

a

i

n

i

t

i

a

l

−

a

f

i

n

a

l

)

×

log

(

1

+

(

e

−

1

)

×

t

M

a

x

_

i

t

e

r

)

(1)

a(t)=a_{initial}-(a_{initial}-a_{final})×\log\left(1+(e-1)×\frac{t}{Max\_iter}\right)\tag{1}

a(t)=ainitial−(ainitial−afinal)×log(1+(e−1)×Max_itert)(1)其中,

t

t

t为当前迭代次数,

M

a

x

_

i

t

e

r

Max\_iter

Max_iter为最大迭代次数,

a

i

n

i

t

i

a

l

a_{initial}

ainitial和

a

f

i

n

a

l

a_{final}

afinal分别为

a

a

a的初始值和最终值,本文分别取值为2和0。图1给出了参数

a

a

a线性递减策略与所提出的非线性递减策略的曲线比较。

从图1可以清晰地看出,与原线性递减策略相比,该非线性过渡参数在更多的迭代中比较着重于局部开发。迭代中后期,所提出的非线性参数的值较小,这表明与全局勘探相比,它有助于长时间(约为最大迭代次数的62%)进行局部开发。该图还显示,在搜索过程中, 所提出的非线性参数策略仅在约38%的迭代中有利于全局勘探。

(2)基于记忆指导的位置更新方程

受粒子群算法的启发,让个体同时从全局最优位置和个体历史最优位置学习,基于此,提出了一种新的改进位置更新规则,计算如下: X ( t + 1 ) = w ⋅ X 1 + X 2 + X 3 3 + c 1 ⋅ r 1 ⋅ ( X p b e s t − X ) + c 2 ⋅ r 2 ⋅ ( X 1 − X ) (2) X(t+1)=w\cdot\frac{X_1+X_2+X_3}{3}+c_1\cdot r_1\cdot(X_{pbest}-X)+c_2\cdot r_2\cdot(X_1-X)\tag{2} X(t+1)=w⋅3X1+X2+X3+c1⋅r1⋅(Xpbest−X)+c2⋅r2⋅(X1−X)(2)其中, t t t为当前迭代次数; r 1 r_1 r1和 r 2 r_2 r2均为 [ 0 , 1 ] [0,1] [0,1]之间均匀分布的随机数; c 1 c_1 c1和 c 2 c_2 c2分别表示个体学习因子和全局学习因子,二者均介于 [ 0 , 1 ] [0,1] [0,1],本文取值均为0.5; w w w表示惯性权重,与粒子群算法相似, w w w大小从初始值( w i n i t i a l w_{initial} winitial)线性递减至最终值( w f i n a l w_{final} wfinal),计算如下: w = m a x _ i t e r − t m a x _ i t e r × ( w i n i t i a l − w f i n a l ) + w f i n a l (3) w=\frac{max\_iter-t}{max\_iter}×(w_{initial}-w_{final})+w_{final}\tag{3} w=max_itermax_iter−t×(winitial−wfinal)+wfinal(3)

(3)IGWO算法流程图

IGWO算法流程图如图2所示。

二、实验对比和分析

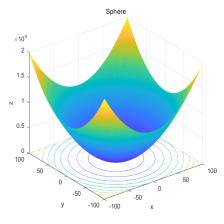

将IGWO算法分别与GWO、NGWO[1]、mGWO[2]、AWGWO[3]进行对比,以表1中的测试函数为例。种群规模 N = 30 N=30 N=30,最大迭代次数 m a x _ i t e r = 500 max\_iter=500 max_iter=500,每个算法独立运行30次。

结果显示如下:

函数:F1

GWO:最差值: 4.5538e-27,最优值:7.8871e-29,平均值:9.9303e-28,标准差:1.1817e-27

NGWO:最差值: 1.3402e-45,最优值:1.3192e-48,平均值:2.6566e-46,标准差:3.5005e-46

mGWO:最差值: 2.2532e-35,最优值:3.7134e-38,平均值:3.8516e-36,标准差:6.1722e-36

AWGWO:最差值: 4.1514e-30,最优值:9.7923e-33,平均值:6.1016e-31,标准差:1.0546e-30

IGWO:最差值: 0,最优值:0,平均值:0,标准差:0

函数:F2

GWO:最差值: 2.3948e-16,最优值:1.3512e-17,平均值:8.7108e-17,标准差:6.3213e-17

NGWO:最差值: 1.51e-26,最优值:1.7264e-28,平均值:3.1751e-27,标准差:3.2087e-27

mGWO:最差值: 3.3107e-21,最优值:1.7986e-22,平均值:1.0732e-21,标准差:7.6252e-22

AWGWO:最差值: 3.6215e-18,最优值:2.6132e-20,平均值:9.1034e-19,标准差:7.9641e-19

IGWO:最差值: 5.5615e-182,最优值:7.7691e-185,平均值:8.8293e-183,标准差:0

函数:F3

GWO:最差值: 0.00053804,最优值:1.1645e-08,平均值:3.7586e-05,标准差:0.00011057

NGWO:最差值: 5.4632e-07,最优值:2.2342e-13,平均值:3.4851e-08,标准差:1.131e-07

mGWO:最差值: 8.0394e-07,最优值:2.1788e-11,平均值:8.494e-08,标准差:1.7588e-07

AWGWO:最差值: 1.7645e-05,最优值:3.7295e-10,平均值:1.3993e-06,标准差:3.6027e-06

IGWO:最差值: 3.4287e-316,最优值:2.4703e-323,平均值:3.6825e-317,标准差:0

函数:F4

GWO:最差值: 2.6611e-06,最优值:4.8008e-08,平均值:5.9381e-07,标准差:6.6322e-07

NGWO:最差值: 4.6761e-12,最优值:3.2347e-14,平均值:7.71e-13,标准差:1.0471e-12

mGWO:最差值: 7.7212e-08,最优值:6.6454e-11,平均值:4.3974e-09,标准差:1.393e-08

AWGWO:最差值: 6.2579e-07,最优值:1.9064e-08,平均值:1.2364e-07,标准差:1.3387e-07

IGWO:最差值: 8.3419e-168,最优值:1.4096e-171,平均值:5.8839e-169,标准差:0

函数:F5

GWO:最差值: 0.0060729,最优值:0.00074177,平均值:0.0023733,标准差:0.00112

NGWO:最差值: 0.0070021,最优值:0.00026744,平均值:0.0015789,标准差:0.0013159

mGWO:最差值: 0.0026827,最优值:0.00025328,平均值:0.0011614,标准差:0.0006078

AWGWO:最差值: 0.0030451,最优值:0.00051754,平均值:0.0016609,标准差:0.00069748

IGWO:最差值: 0.00036823,最优值:6.7039e-06,平均值:7.4607e-05,标准差:8.0542e-05

函数:F6

GWO:最差值: 20.0176,最优值:5.6843e-14,平均值:3.716,标准差:4.8392

NGWO:最差值: 3.979e-12,最优值:0,平均值:1.3263e-13,标准差:7.2647e-13

mGWO:最差值: 3.9036,最优值:0,平均值:0.13012,标准差:0.7127

AWGWO:最差值: 17.6185,最优值:0,平均值:1.9925,标准差:4.0692

IGWO:最差值: 0,最优值:0,平均值:0,标准差:0

函数:F7

GWO:最差值: 1.3589e-13,最优值:7.5495e-14,平均值:1.0332e-13,标准差:1.1353e-14

NGWO:最差值: 1.1546e-14,最优值:4.4409e-15,平均值:8.112e-15,标准差:1.1363e-15

mGWO:最差值: 2.931e-14,最优值:1.5099e-14,平均值:2.2678e-14,标准差:4.3495e-15

AWGWO:最差值: 6.4837e-14,最优值:3.9968e-14,平均值:4.6126e-14,标准差:6.5928e-15

IGWO:最差值: 4.4409e-15,最优值:4.4409e-15,平均值:4.4409e-15,标准差:0

函数:F8

GWO:最差值: 0.017396,最优值:0,平均值:0.0019962,标准差:0.0052257

NGWO:最差值: 0.01022,最优值:0,平均值:0.00034068,标准差:0.001866

mGWO:最差值: 0,最优值:0,平均值:0,标准差:0

AWGWO:最差值: 0.022753,最优值:0,平均值:0.0017797,标准差:0.0055464

IGWO:最差值: 0,最优值:0,平均值:0,标准差:0

8个标准测试函数的实验结果表明,所提出的IGWO算法无论在求解精度还是收敛速度指标上均要优于基本GWO、NGWO、mGWO和AWGWO算法。

三、参考文献

[1] Wen Long. Grey Wolf Optimizer based on Nonlinear Adjustment Control Parameter[P]. Proceedings of the 2016 4th International Conference on Sensors, Mechatronics and Automation (ICSMA 2016), 2016.

[2] Nitin Mittal, Urvinder Singh, Balwinder Singh Sohi. Modified Grey Wolf Optimizer for Global Engineering Optimization[J]. Applied Computational Intelligence and Soft Computing, 2016, 2016.

[3] Luis Rodríguez, Oscar Castillo, José Soria, et al. A fuzzy hierarchical operator in the grey wolf optimizer algorithm[J]. Applied Soft Computing, 2017, 57: 315-328.

[4] Wen Long, Jianjun Jiao, Ximing Liang, et al. Inspired grey wolf optimizer for solving large-scale function optimization problems[J]. Applied Mathematical Modelling, 2018, 60: 112-126.

1773

1773

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?