论文链接:

https://ieeexplore.ieee.org/abstract/document/8916872

摘要

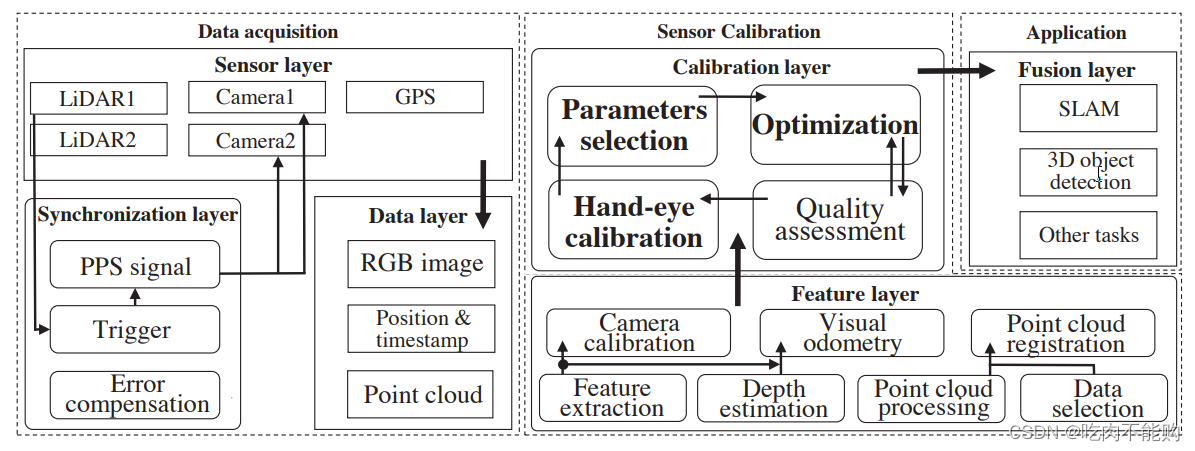

该论文提出了一种新颖的在线外参标定管道,专门用于自主驾驶应用中的单目RGB相机和LiDAR之间的自动外参标定。主要创新点包括:

- 开发了一套完整的自动标定管道。

- 无需初始外参值的标定初始化阶段。

- 结合深度估计和边缘检测以提高标定的精度和鲁棒性。

介绍

随着自动驾驶技术的发展,多传感器融合(特别是RGB相机和LiDAR之间的融合)变得至关重要。LiDAR提供360度高精度的深度信息,而RGB相机提供高分辨率的颜色和纹理信息。将这两种传感器集成在一起可以实现更为鲁棒的3D目标检测和实例分割。精确的外参标定对于这些任务至关重要。

相关工作

论文回顾了已有的LiDAR与相机标定方法,这些方法通常依赖于人工设置和用户经验,限制了其应用范围。文中讨论的标定方法主要分为三类:基于特征、基于互信息和基于运动的标定方法。

方法论

该方法分为三个阶段:

- 初始化外参:利用手眼标定和单目深度估计解决尺度歧义问题,获得外参初值。

- 初步优化:通过深度匹配方法修正初值的较大误差。

- 精细优化:提出基于深度-边缘匹配的最终精确标定方法。

具体步骤包括:

- 手眼标定:估计相机和LiDAR的运动,并计算其外参。

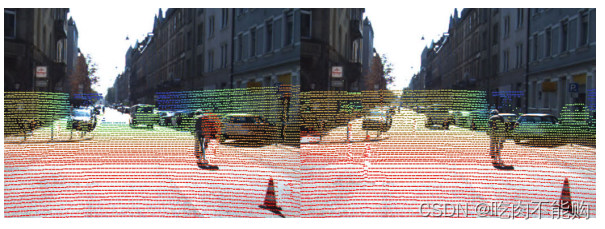

- 数据转换:将LiDAR点云投影到相机图像上,通过优化目标函数找到精确的外参。

- 优化过程:采用协方差矩阵自适应进化策略(CMA-ES)进行优化。

实验与结果

在KITTI数据集和自定义数据集上的实验结果验证了该方法的有效性。与其他方法相比,该方法在不依赖初始值的情况下具有更高的鲁棒性和更快的收敛速度。

结论

该论文提出了一种适用于自动驾驶的相机与LiDAR在线自动外参标定的新方法,具备较高的精度和鲁棒性,但未来仍需进一步研究以降低计算复杂度并提高初始化精度。

参考文献

- Levinson, J., & Thrun, S. (2013). Automatic online calibration of cameras and lasers. In Robotics: Science and Systems.

- Taylor, Z., & Nieto, J. (2016). Motion-based calibration of multimodal sensor extrinsics and timing offset estimation. IEEE Transactions on Robotics.

- Iyer, G., et al. (2018). CalibNet: Self-supervised extrinsic calibration using 3D spatial transformer networks.

2758

2758

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?