文章目录

- 概念

- 可分SVM推导

- 选择最优分割svm

- 计算点到直线的距离公式得到 ∣ ∣ w ∣ ∣ 2 ||w||_2 ∣∣w∣∣2,点到线距离公式

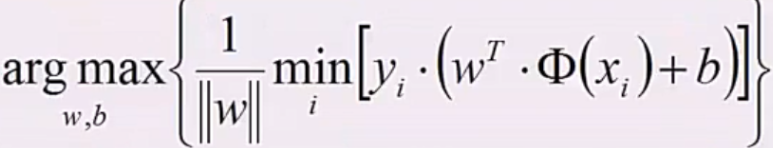

- 优化目标: 让样本点距分割超平面总距离最小,且最近点支持向量的距离模取最大(其中支持面令yi=-1,1),j是第j条线:wj发线,bj截距

- 原算法要通过对偶颠倒优化顺序解决

- 理解:首先看哪个线可以分,其次看支持的向量距离最大

- 线性可分样本不会出现在过渡带上,软则可以

- ϕ ( x ) 是 将 x 映 射 到 多 项 式 增 加 维 度 使 分 割 可 以 为 曲 线 \phi(x)是将x映射到多项式增加维度使分割可以为曲线 ϕ(x)是将x映射到多项式增加维度使分割可以为曲线

- 优化arg max(min{}),w法向量可缩放,等价成带约束的min{}优化

- SVM优化算法:SMO(serial max optimal)、也可以SGD优化

- 距离

- 为什么还有选择soft 松弛 SVM

- 将上式反过来写就是线性回归的loss加正则项:合页损失

- 核函数

- SVM多分类问题处理

概念

可分SVM推导

f

(

x

)

=

w

∗

x

+

b

,

x

是

n

维

向

量

,

w

法

向

量

,

b

是

截

距

。

=

0

是

中

间

的

分

割

超

平

面

f(x)=w*x+b,x是n维向量,w法向量,b是截距。=0是中间的分割超平面

f(x)=w∗x+b,x是n维向量,w法向量,b是截距。=0是中间的分割超平面

所以支持平面是

w

∗

x

+

b

=

−

1

,

w

∗

x

+

b

=

1

w*x+b=-1, w*x+b=1

w∗x+b=−1,w∗x+b=1,以下3点是支撑向量

选择最优分割svm

计算点到直线的距离公式得到 ∣ ∣ w ∣ ∣ 2 ||w||_2 ∣∣w∣∣2,点到线距离公式

优化目标: 让样本点距分割超平面总距离最小,且最近点支持向量的距离模取最大(其中支持面令yi=-1,1),j是第j条线:wj发线,bj截距

原算法要通过对偶颠倒优化顺序解决

理解:首先看哪个线可以分,其次看支持的向量距离最大

线性可分样本不会出现在过渡带上,软则可以

ϕ ( x ) 是 将 x 映 射 到 多 项 式 增 加 维 度 使 分 割 可 以 为 曲 线 \phi(x)是将x映射到多项式增加维度使分割可以为曲线 ϕ(x)是将x映射到多项式增加维度使分割可以为曲线

先根据所有样本到直线距离求最近min的直线w和b得到左图这么多分割线

然后求出支持点到直线距离最大的线

优化arg max(min{}),w法向量可缩放,等价成带约束的min{}优化

拉格朗日乘子法(n个样本)

进一步得到对偶函数,得到乘子最大值

原始为凸函数,则对偶函数min 最优解等价

非支持向量的点的

α

i

\alpha_i

αi=0,支持向量的

α

i

\alpha_i

αi不是0

SVM优化算法:SMO(serial max optimal)、也可以SGD优化

距离

为什么还有选择soft 松弛 SVM

当C为无穷大则为线性可分SVM,越大越不容许错误(为了大部分分类对,牺牲分错部分)

当C为无穷大则为线性可分SVM,越大越不容许错误(为了大部分分类对,牺牲分错部分)

将上式反过来写就是线性回归的loss加正则项:合页损失

核函数

系数c、核函数系数对比调参实验

3652

3652

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?