大模型干货解读

其“大”体现在训练数据集广,模型参数和层数大,计算量大,其价值体现在通用性上,以Transformer打底,并且有更好的泛化能力

那什么是Transform?

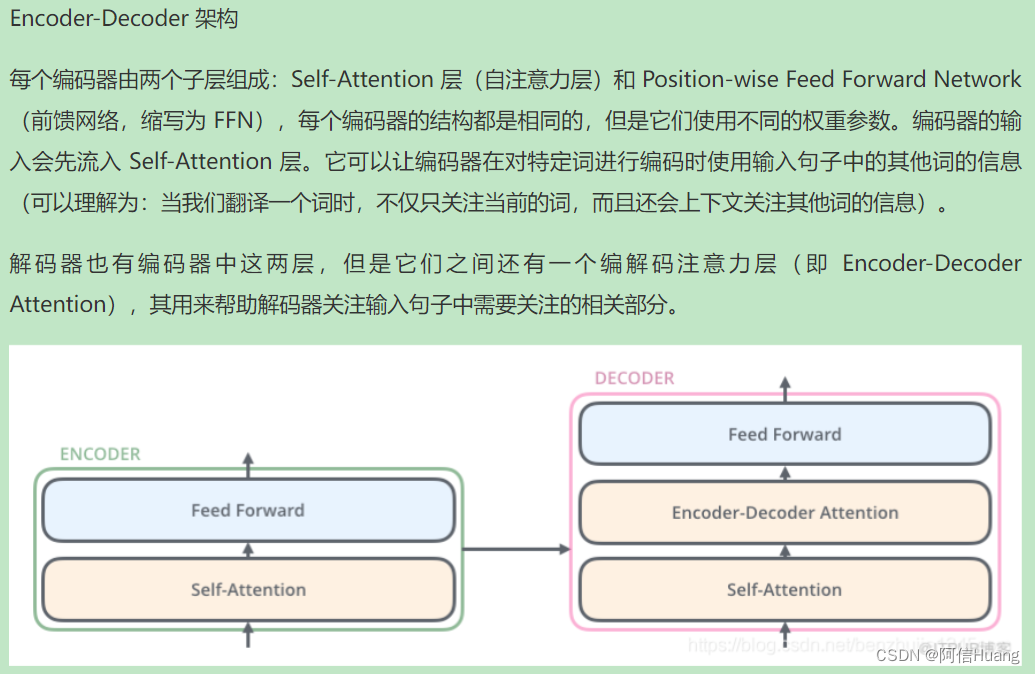

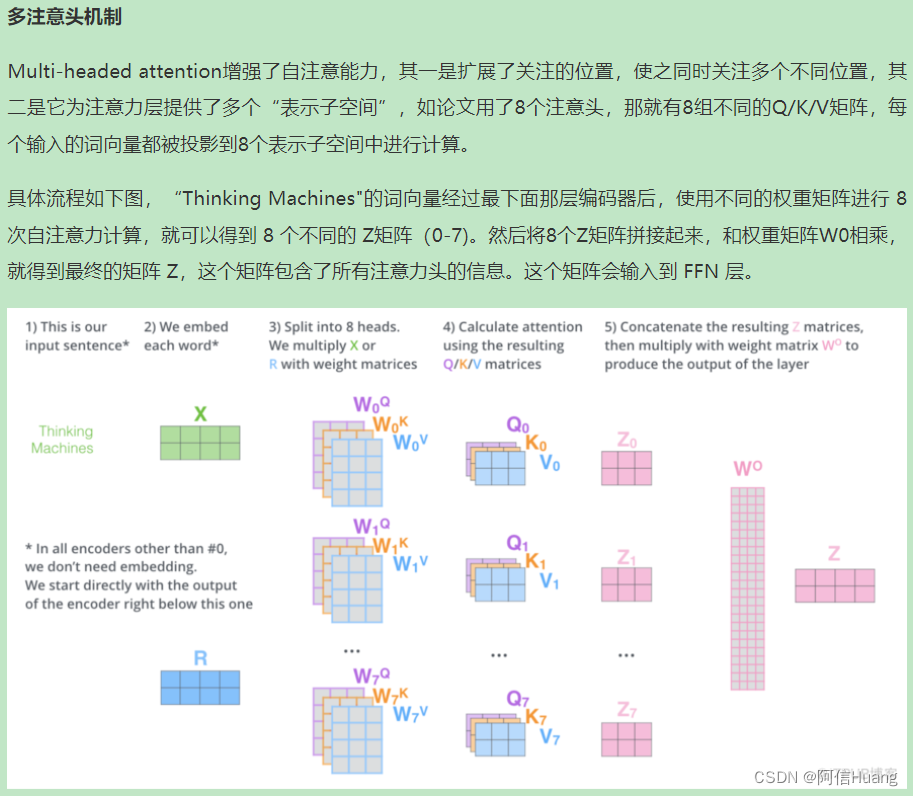

1、本质上是一个Encoder-Decoder架构,编码组件和解码组件可以有很多层

区别于其它模型的点:

1、只需要少量标注数据

2、基于人类反馈的强化学习是ChatGPT区别于其他生成类模型的最主要特点,该法帮助模型尽量减少有害的、不真实的及有偏见的输出

当前技术的局限性

应用场景

参考:https://www.cainiaoxueyuan.com/ai/44635.html

https://qiankunli.github.io/2023/03/25/llm.html

https://wallstreetcn.com/articles/3692688

http://jalammar.github.io/illustrated-transformer/

https://www.cnblogs.com/ajson/p/15040620.html

2213

2213

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?