基本概念

参考文献:多视图机器学习分类及聚类算法研究_王强

共同正则化谱聚类(Co-Reg,全称 Co-regularized Spectral Clustering)是一种旨在提高聚类性能的多视图学习方法,它特别适用于拥有多个特征表示或数据来源的场景。

这种方法通过结合不同视图(即数据的不同表示或维度)的信息来优化聚类结果,使得聚类不仅基于单个视图的特性,还能利用各视图间互补和一致性的信息。下面是共同正则化谱聚类的关键点:

-

基本原理:

- 多视图数据:在很多实际应用场景中,数据可以从

多个角度或特征维度进行观察,形成不同的“视图”。例如,一张图像可以有颜色、纹理、形状等多个特征视图。 - 视图间相似性:共同正则化谱聚类的

核心思想是通过正则化项强制不同视图下的特征向量保持高度相似性。这意味着,如果在某一视图中两个样本被认为相似,在其他视图中这两个样本也应该尽可能相似。

- 多视图数据:在很多实际应用场景中,数据可以从

-

算法步骤:

- 构建

单视图的拉普拉斯矩阵:对于每个视图 (v),构建其归一化拉普拉斯矩阵(L(v)),这反映了该视图内样本间的相似性关系。 - 共同正则化目标函数:通过

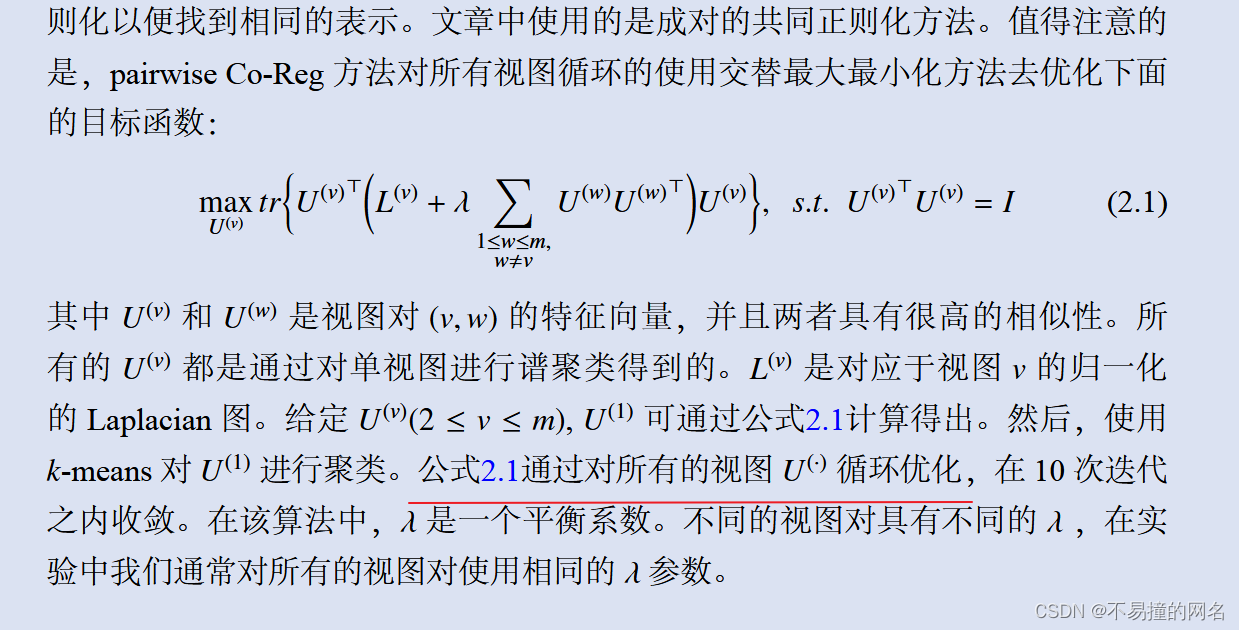

最大化所有视图下特征向量 (U(v)) 的迹(即对角线元素之和),同时确保这些特征向量与其它视图的特征向量保持高度相关。优化目标函数可以写作:

max U ( v ) tr ( U ( v ) ⊤ ( L ( v ) + λ ∑ w = 1 , w ≠ v m U ( w ) U ( w ) ⊤ ) U ( v ) ) , s.t. U ( v ) ⊤ U ( v ) = I \max_{U(v)} \text{tr}(U(v)^\top(L(v) + \lambda \sum_{w=1, w\neq v}^{m} U(w)U(w)^\top)U(v)), \text{s.t. } U(v)^\top U(v) = I U(v)maxtr(U(v)⊤(L(v)+λw=1,w=v∑mU(w)U(w)⊤)U(v)),s.t. U(v)⊤U(v)=I

其中,(U(v)) 、(U(w)) 是视图 (v) 、(w)下的特征向量矩阵,λ 是一个平衡系数,控制着视图间相似性的强调程度,(I) 是单位矩阵。 - 交替优化:为了求解上述目标函数,通常采用

交替最大最小化策略,循环遍历所有视图,优化每个视图的 (U(v))、(U(v)),直到达到某个停止条件,比如迭代次数限制或收敛阈值。 - U(w)是除U(v)以外视图的

特征向量矩阵,w=1,w≠v 2 3 4 5 6…根据视图

- 构建

-

聚类实现:

- 在所有视图的特征向量 (U(v)) 经过上述优化后,通常取第一个视图(或任意选定的参考视图)的特征向量 (U(1)),并使用 k-means 或其他聚类算法对 (U(1)) 进行聚类,以获得最终的聚类结果。

-

优势:

- 增强鲁棒性:通过融合多视图信息,共同正则化谱聚类能够

抵抗单个视图中的噪声和异常值,提高了聚类结果的稳定性和准确性。 - 提高泛化能力:多视图的协同考虑能够捕获数据的内在结构,有助于发现更本质的聚类模式,尤其在数据特性不完全或存在缺失时。

- 增强鲁棒性:通过融合多视图信息,共同正则化谱聚类能够

共同正则化谱聚类是多视图聚类领域的重要方法之一,通过跨视图的正则化项,促进了不同数据表示间的一致性,从而提升了聚类性能。

共同正则化谱聚类(Co-Reg)是一种多视图聚类方法,它通过在多个视图间共享正则化项来促进不同视图之间的信息融合,以提高聚类性能。以下是一个具体例子,包括涉及的公式和计算步骤:

示例

假设我们有一个数据集,包含100个样本,每个样本有3个不同的视图(例如,文本描述、图像特征、用户行为记录),我们希望利用这些视图来对样本进行聚类,目标是分成4个簇。

具体步骤

1. 数据预处理

- 归一化:首先,对每个视图的数据进行

Z-score标准化处理,使每个特征的均值为0,方差为1,得到归一化特征空间E(v)。

2. 构建单视图拉普拉斯矩阵

对于每个视图v(1 ≤ v ≤ m),计算其归一化拉普拉斯矩阵(L(v)),公式为:

L

(

v

)

=

D

(

v

)

−

1

2

S

(

v

)

D

(

v

)

−

1

2

L(v) = D(v)^{-\frac{1}{2}} S(v) D(v)^{-\frac{1}{2}}

L(v)=D(v)−21S(v)D(v)−21

其中,

D

(

v

)

是对角矩阵,

D

i

i

(

v

)

=

∑

j

=

1

n

S

i

j

(

v

)

,

S

(

v

)

是相似矩阵,

S

i

j

(

v

)

表示视图

v

中样本

i

和样本

j

的相似度,可以基于欧氏距离或其他度量计算。

其中,D(v)是对角矩阵,D_{ii}(v) = \sum_{j=1}^{n} S_{ij}(v),S(v)是相似矩阵,S_{ij}(v)表示视图v中样本i和样本j的相似度,可以基于欧氏距离或其他度量计算。

其中,D(v)是对角矩阵,Dii(v)=j=1∑nSij(v),S(v)是相似矩阵,Sij(v)表示视图v中样本i和样本j的相似度,可以基于欧氏距离或其他度量计算。

3. 共同正则化目标函数优化

定义共同正则化的目标函数为:

max

U

(

v

)

tr

(

U

(

v

)

⊤

(

L

(

v

)

+

λ

∑

w

=

1

,

w

≠

v

m

U

(

w

)

U

(

w

)

⊤

)

U

(

v

)

)

,

s.t.

U

(

v

)

⊤

U

(

v

)

=

I

\max_{U(v)} \text{tr}(U(v)^\top(L(v) + \lambda \sum_{w=1, w\neq v}^{m} U(w)U(w)^\top)U(v)), \text{s.t. } U(v)^\top U(v) = I

U(v)maxtr(U(v)⊤(L(v)+λw=1,w=v∑mU(w)U(w)⊤)U(v)),s.t. U(v)⊤U(v)=I

其中,(U(v))是视图v的特征向量矩阵,λ 是控制视图间正则化强度的参数,(I)是单位矩阵。

4. 交替优化

- 初始化:随机初始化或基于某些启发式方法为每个视图选择初始的聚类中心表示(U(v))。

- 迭代循环:

- 固定其他视图,对于当前视图(v),优化(U(v))以最大化目标函数。

- 更新完所有视图的(U(v))后,进行一轮循环,直到满足停止准则(如迭代次数、目标函数增益小于阈值)。

5. 聚类结果

- 最终,利用优化后的(U(1))(或任选一个视图的(U(v)))进行k-means聚类,以获得最终的聚类标签。

计算示例

假设我们已通过上述步骤获得了每个视图的(U(v)),并且选择(λ = 0.5)作为正则化参数。在第t轮迭代中,对于视图1,我们优化(U(1)):

- 计算 U ( 1 ) ⊤ ( L ( 1 ) + 0.5 U ( 2 ) U ( 2 ) ⊤ + 0.5 U ( 3 ) U ( 3 ) ⊤ ) U ( 1 ) 的最大值。 计算U(1)^\top(L(1) + 0.5U(2)U(2)^\top + 0.5U(3)U(3)^\top)U(1)的最大值。 计算U(1)⊤(L(1)+0.5U(2)U(2)⊤+0.5U(3)U(3)⊤)U(1)的最大值。

- 更新(U(1))后,依次对视图2和视图3执行相同的操作。

- 完成一轮循环后,检查收敛条件,若未满足,则继续迭代,直至收敛。

总结

共同正则化谱聚类通过迭代优化不同视图下的特征向量,促使不同视图间的信息相互补充,最终基于优化后的特征表示进行聚类,以达到更准确的聚类效果。在实际操作中,还需考虑如何有效选择 λ 值和初始化策略,以及确定合适的停止准则。

4709

4709

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?