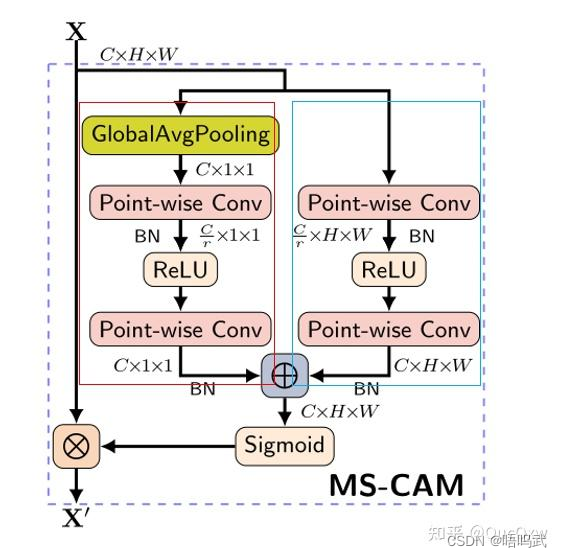

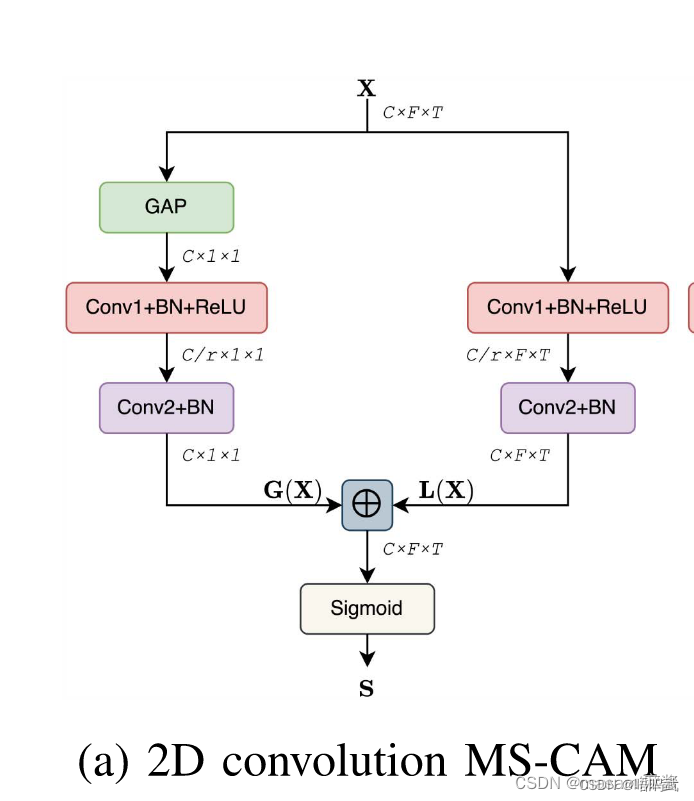

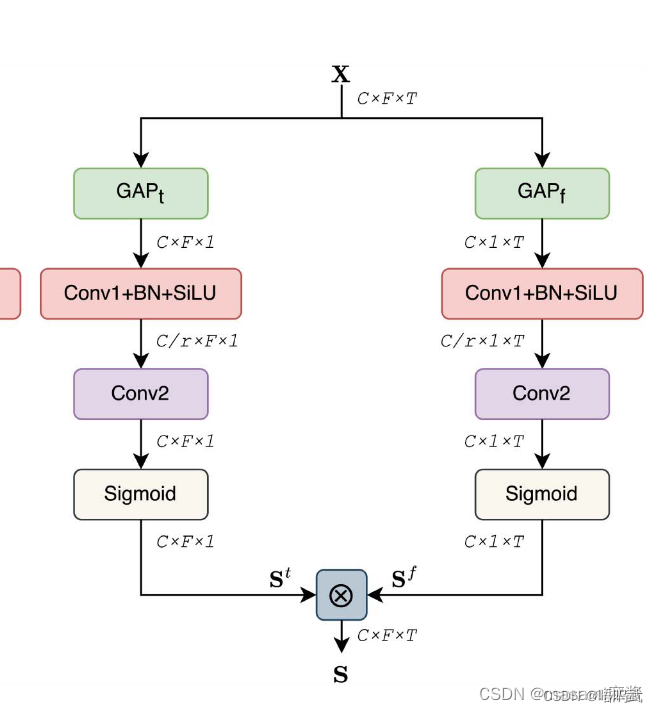

一、Multi-scale Channel Attention Module (MS-CAM)

- MS-CAM通过逐点卷积来关注通道的尺度问题,而不是大小不同的卷积核,使用点卷积,为了让 MS-CAM 尽可能的轻量化。

- MS-CAM不是在主干网中,而是在通道注意力模块中局部本地和全局的特征上下文特征。

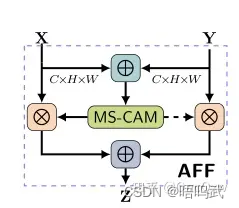

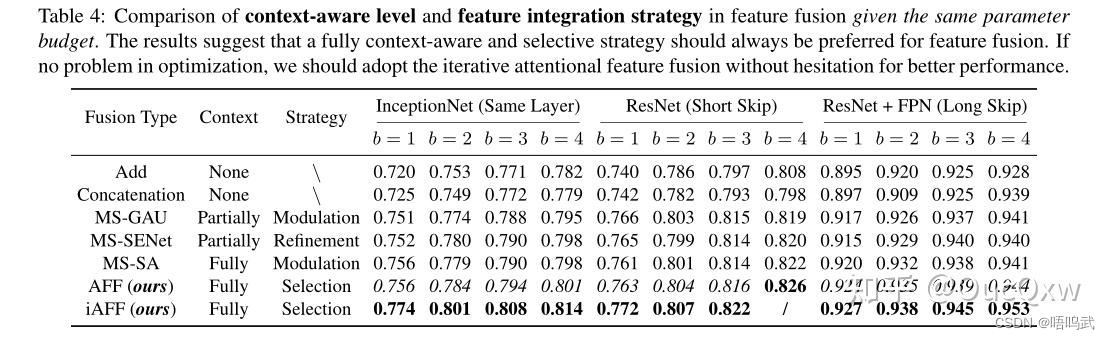

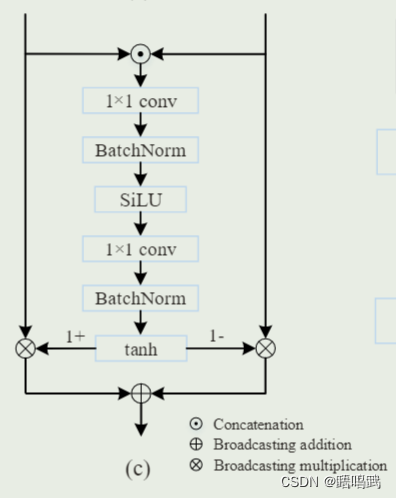

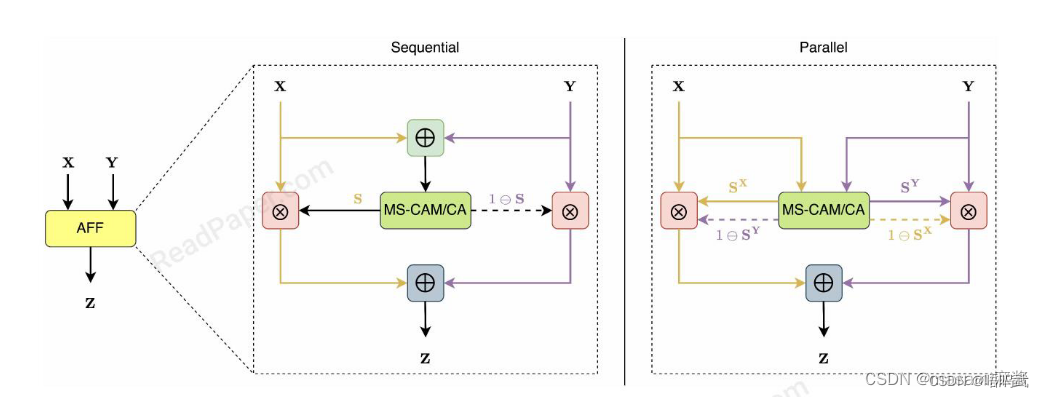

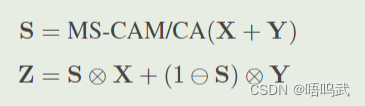

二、Attentional Feature Fusion(AFF)

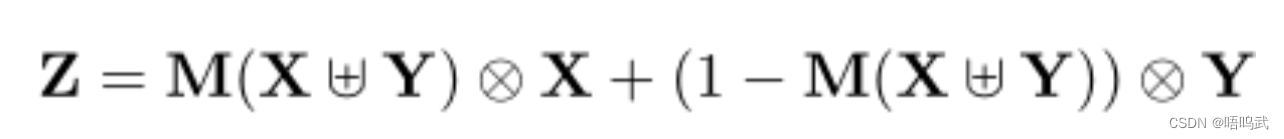

给定两个特征X和Y进行特征融合

AFF的计算方法如下:

对输入的两个特征X,Y先做初始特征融合,经过sigmod激活函数,输出值为0~1之间,作者希望对X 、Y 做加权平均,就用 1 减去这组 Fusion weight,可以作到 Soft selection,通过训练,让网络确定各自的权重。

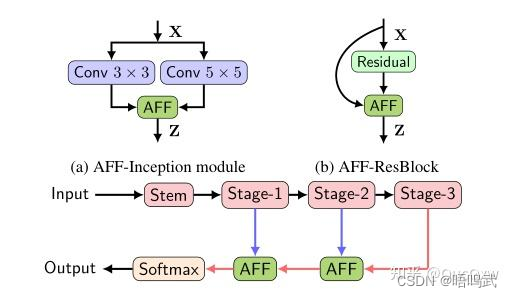

AFF 具备泛用性

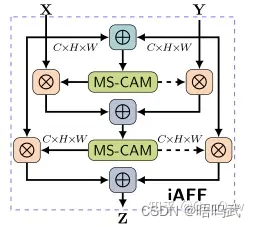

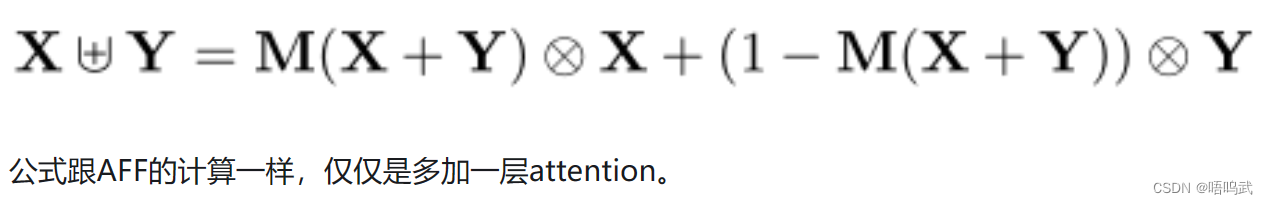

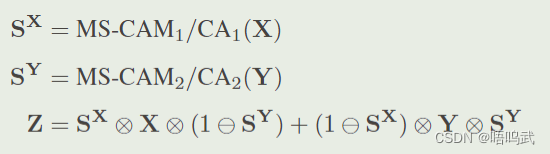

三、iterative Attentional Feature Fusion (iAFF)

在注意力特征融合模块中 ,X和Y初始特征的融合仅是简单对应元素相加,然后作为注意力模块的输入会对最终融合权重产生影响。作者认为如果想要对输入的特征图有完整的感知,只有将初始特征融合也采用注意力融合的机制,一种直观的方法是使用另一个attention模块来融合输入的特征。

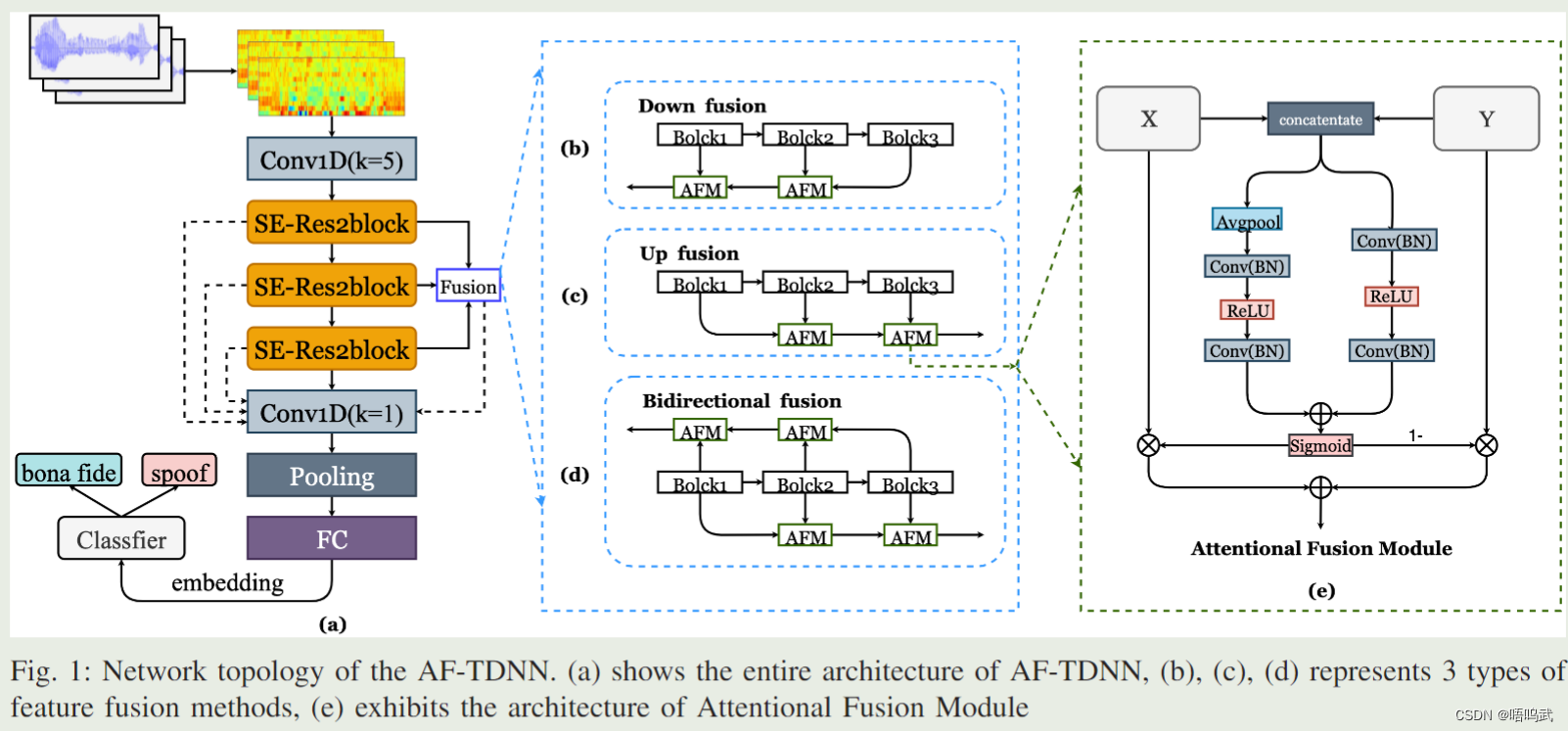

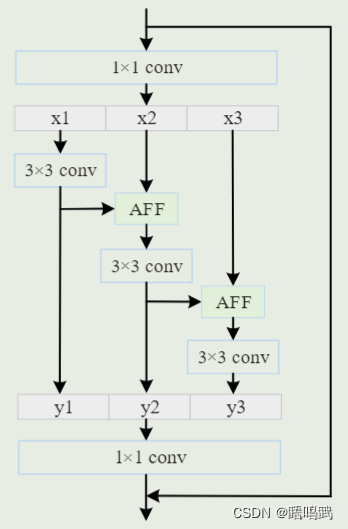

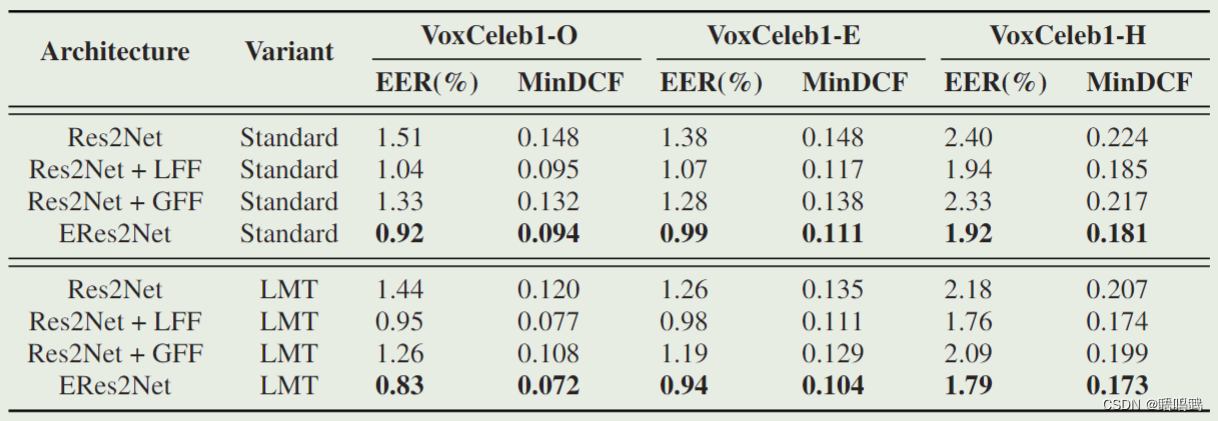

四、ERes2Net中的局部特征融合(LFF)

LFF机制在相邻特征映射之间的残差连接中引入了注意特征融合机制,其关键思想是获得更细粒度的特征并加强局部信息交互。

通过注意特征融合(AFF)模块将前一组输出特征与另一组输入特征映射融合在一起。AFF 用于明确加强信息交互。LFF块中的分层融合结构可以增加模型的接收域,并整合不同通道的局部信息。

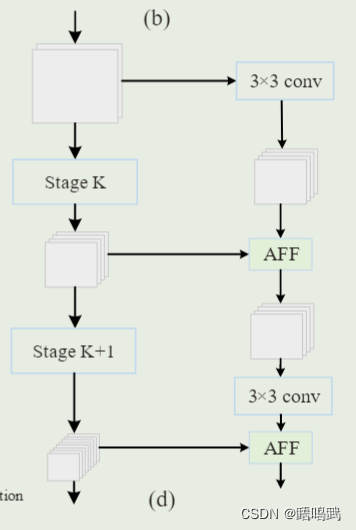

五、ERes2Net中的全局特征融合(GFF)

更接近神经网络的底层,神经元的感受野越有限,反之亦然。GFF旨在通过调制自下而上路径中不同时间尺度的特征来增强全局特征交互。

将每个阶段输出连接起来,并通过 AFF 模块计算自下而上的注意力。AFF 模块从全局角度计算注意力权重。通过 AFF 模块的特征增强了下采样的特征图。

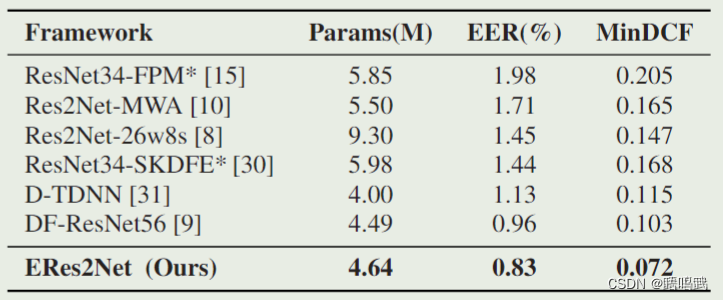

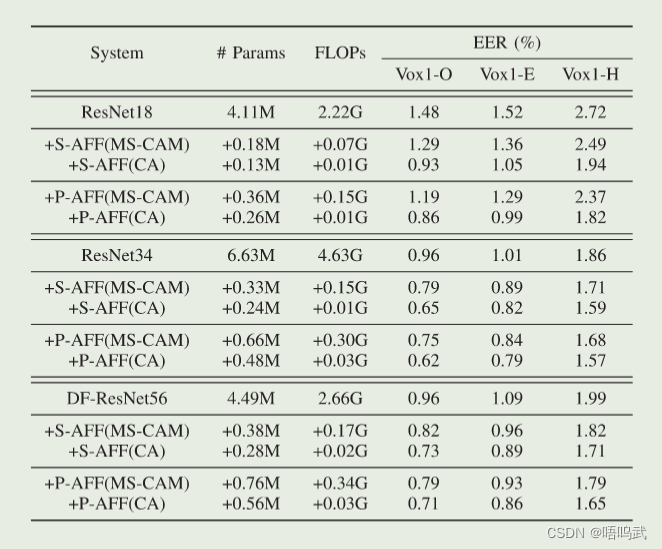

六、顺序AFF (S-AFF)和并行AFF (P-AFF)

左右分别位顺序AFF(S-AFF)和并行AFF(P-AFF)

1)ResNet/DF-ResNets:在ResNet和DF-ResNets的残差块中,存在二元特征融合,其中采用特征之间的逐元素相加。我们提出的 AFF 模块可以通过简单地替换每个残差块中原始的逐元素加法来轻松集成到 ResNet 和DF-ResNets 中。

2)ECAPA-TDNN/DF-ECAPA:对于ECAPA-TDNN和DF-ECAPA,SE-Res2Block中的逐元素加法可以用二进制AFF模块和多层特征聚合中的级联代替可以用多个AFF模块替代。

8315

8315

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?