👀

一、前言

上一期介绍了大模型预训练需要使用的数据--不能直接使用平时我们使用的 Word、PDF、网页等数据,需要经过清洗整理成 TXT 或者 JSON 格式的文本片段。 那么在大模型微调阶段能否直接使用这些文本片段呢?答案是不能,因为大模型在微调和预训练阶段的目的不一样,那么大模型微调到底需要什么样的数据?

👀

二、什么是大模型微调?

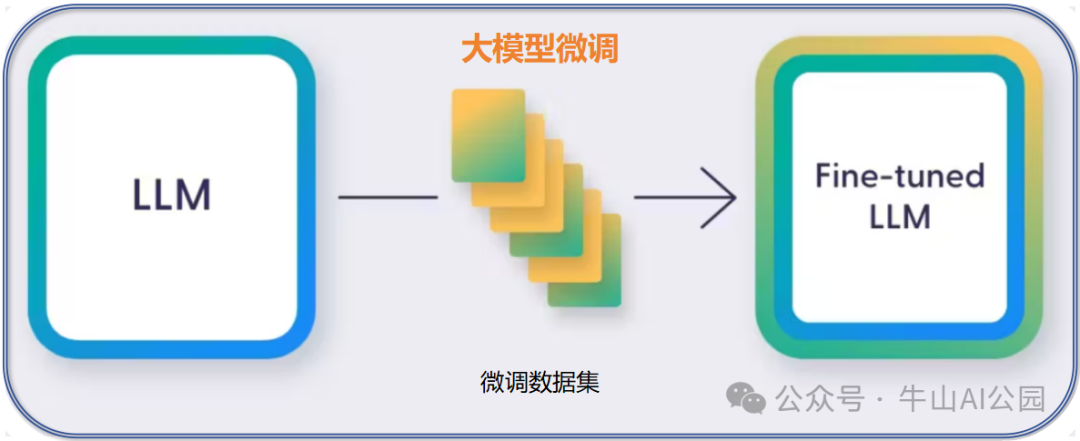

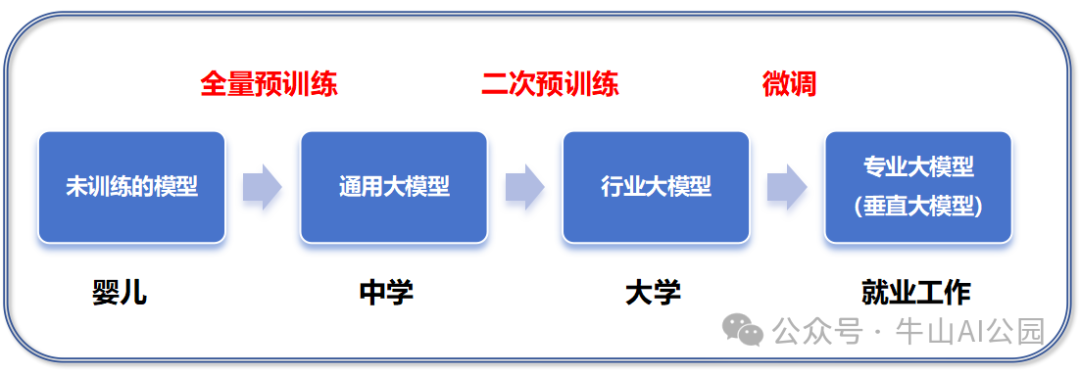

在上篇文章中简要介绍过大模型训练会分为预训练和微调两个阶段,如下图所示。 预训练是语言模型学习的初始阶段,这个阶段的目标是捕获文本语料库中的底层模式、结构和语义知识,对应人从婴儿成长到大学阶段。大模型微调是在预训练模型的基础上进行任务定制化调整。预训练让模型学会了通用的语言模式、结构和语义知识,微调则让模型针对特定的任务或领域需求进行调整优化。对应人学校毕业以后走向工作岗位,在上岗之前需要针对岗位要求进行针对性的学习和训练。

微调例子一:电商客服场景

假设你是一家电商平台的客服经理,想要通过人工智能帮助分析客户的评价,判断他们对产品的情感态度(比如“满意”或“不满意”)。这时候,你可以使用一个已经预训练的大语言模型(比如 GPT)。

问题是:未经微调的预训练模型能直接用吗?

答案是否定的。预训练模型虽然能力强大,但它对你的具体任务(情感分析)并不“专业”。例如:

用户评价:“这件衣服太大了,但质量不错。”

没有微调的模型可能只会生成一些通用的回答,比如“这是一段关于衣服的评论”,它不能准确判断客户的情感是“部分满意”或“中立”。

那么微调如何解决这个问题?

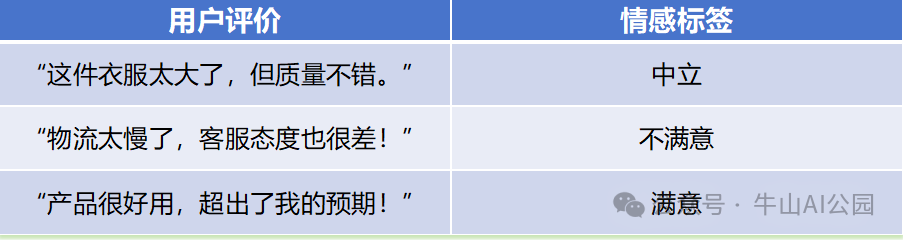

微调就像给模型上了一堂专门的“情感分析课”。我们会准备一个情感标注的训练集,例如:

然后,用这些标注数据对模型进行微调,模型会学会用户评论中的情感线索,例如:

“太大了”是个负面反馈,但“质量不错”是正面反馈,所以整体是中立。

“物流太慢了”“客服态度也很差”这些表达明确传递了不满意。

微调后的效果:微调后模型不仅能理解情感,还能快速分类。比如,你输入以下评价:

用户评价:“颜色比图片暗,但穿着很舒服。” --> 中立

用户评价:“真的很差,居然有瑕疵!” --> 不满意

用户评价:“物流快,包装好,非常满意。”–> 满意

微调例子二:行政咨询场景

想象你是行政部门的工作人员,日常会收到大量员工的咨询,比如公司政策、报销流程、请假规定等。为了提高效率,公司决定用一个大语言模型来回答这些问题。

问题是:未经微调的预训练模型能直接用吗?

预训练模型虽然很强大,但它对公司内部的具体政策并不了解。如果直接用,可能会给出一些看似合理但完全错误的回答。例如:

员工问:“公司的年度体检可以带家属参加吗?”

没有微调的模型可能回答:“一般情况下,公司体检是员工福利,通常不包括家属。”实际上,这与贵公司的规定(比如“可以带一名家属,费用自理”)完全不符。

微调如何解决这个问题?

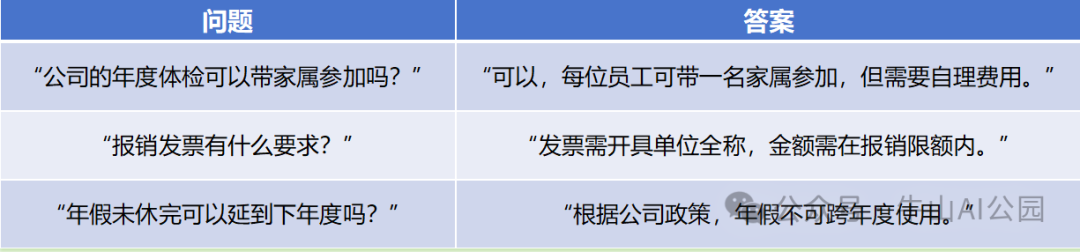

微调就像给模型上了一堂“公司行政政策课”。我们可以用公司内部常见问题和正确答案作为训练数据,对模型进行微调。例如:

通过这些专门数据的微调,模型会变得更加熟悉公司政策,回答更精准。

微调后的效果,当员工提出类似的问题时,模型能准确地回答:

员工问题“年度体检可以带家属参加吗?”–>“可以,每位员工可带一名家属参加,但需要自理费用。”

员工问题“请假超过 3 天需要什么手续?”–>“根据公司规定,请假超过 3 天需部门经理和 HR 审批。”

员工问题“报销单需要哪些附件?”–>“需附上发票原件、相关审批表和支付凭证。”

模型微调总结

预训练模型就像一个“全能选手”,会写文章、会聊天,但它对具体的某个业务场景并不精通,例如客服、行政咨询等,微调就是结合具体的业务场景需求,给全能选手上一门专门的课。上课的内容是基于特定的标注数据集(如情感分析、行政问答等),通过有监督学习或其他定制化方法,对模型的参数进行调整,以提高其在目标任务上的性能,变成某个场景里的专家,直接帮你解决实际问题!

👀

三、微调数据长什么样?

通过上述两个微调的例子可以看出,微调与预训练所需的数据,最大的不同是微调需要经过标注的数据集,通过标注数据把更加精确的要求和表述教给大模型,就像一个学生毕业后做客服,那么在做客服工作这个具体的任务,所需知识和技巧,需要有人教会他。

微调数据中根据实际的业务场景需求,其数据的内容会有不同,下面罗列几种常见的格式:

1、指令跟随格式

这种格式能够明确地告诉模型需要执行的具体任务和操作,使得模型能够更有针对性地生成符合要求的输出,很好地将预训练模型的通用语言能力引导到特定的任务场景中,增强模型在不同任务上的表现和泛化能力。

使用范围:极其广泛,几乎涵盖了自然语言处理的各类任务,如文本生成、翻译、总结、情感分析、问答等。例如,在文本生成任务中,可以给出 “根据以下关键词生成一篇短文” 的指令;在翻译任务中,指令可以是 “将以下中文句子翻译成英文” 等.

示例:

{

"instruction": "将以下句子转换为被动语态",

"input": "他们正在修理那辆汽车",

"output": "那辆汽车正在被修理"

}

2、多轮对话格式

该格式能够捕捉到对话的上下文信息和交互逻辑,让模型学习如何根据之前的对话历史来生成合适的回复,从而提高对话的连贯性、合理性和自然度,更好地满足用户在实际对话中的各种需求。

使用范围:主要适用于构建和微调对话模型,广泛应用于聊天机器人、智能客服等需要进行多轮交互的场景,以模拟用户与 AI 之间的自然流畅对话

示例:

{

"conversation": \[

{

"from": "human", //角色 A

"value": "你好,能帮我推荐一部电影吗"

},

{

"from": "gpt", //角色 B

"value": "当然可以,你喜欢什么类型的电影呢"

},

{

"from": "human",

"value": "我喜欢科幻电影"

},

{

"from": "gpt",

"value": "那我推荐《星际穿越》,它的剧情和特效都非常精彩"

}

\]

}

3、文本对齐数据格式

文本与标签或答案之间的明确对应关系,使得模型能够直接学习到从给定文本到特定推理结果或答案的映射,有助于提高模型在这些需要对文本进行深度理解和准确推理以得出正确结果的任务上的性能。

使用范围:在自然语言推理和问答系统等任务中使用较为广泛

示例:

问题,答案

今天天气怎么样?,今天天气很好

你喜欢吃什么?,我喜欢吃水果

4、序列到序列数据格式

能够直接对输入序列和输出序列之间的映射关系进行建模,很好地适应了这些任务中需要将一种文本序列转换为另一种文本序列的需求,例如在机器翻译中实现从源语言到目标语言的转换,在对话系统中根据输入的对话历史生成下一轮的回复等 。

使用范围:在机器翻译、对话系统、文本摘要等任务中有着广泛的应用

示例:

源语言,目标语言

我喜欢苹果, I like apples

他在跑步, He is running

上述是简单的示例,实际微调数据是大量以上指令格式的微调指令数据

那么,如何系统的去学习大模型LLM?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

所有资料 ⚡️ ,朋友们如果有需要全套 《AI大模型入门+进阶学习资源包**》,扫码获取~

篇幅有限,部分资料如下:

👉LLM大模型学习指南+路线汇总👈

💥大模型入门要点,扫盲必看!

💥既然要系统的学习大模型,那么学习路线是必不可少的,这份路线能帮助你快速梳理知识,形成自己的体系。

路线图很大就不一一展示了 (文末领取)

👉大模型入门实战训练👈

💥光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉国内企业大模型落地应用案例👈

💥两本《中国大模型落地应用案例集》 收录了近两年151个优秀的大模型落地应用案例,这些案例覆盖了金融、医疗、教育、交通、制造等众多领域,无论是对于大模型技术的研究者,还是对于希望了解大模型技术在实际业务中如何应用的业内人士,都具有很高的参考价值。 (文末领取)

👉GitHub海量高星开源项目👈

💥收集整理了海量的开源项目,地址、代码、文档等等全都下载共享给大家一起学习!

👉LLM大模型学习视频👈

💥观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。 (文末领取)

👉640份大模型行业报告(持续更新)👈

💥包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉获取方式:

这份完整版的大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

😝有需要的小伙伴,可以Vx扫描下方二维码免费领取🆓

25万+

25万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?