-

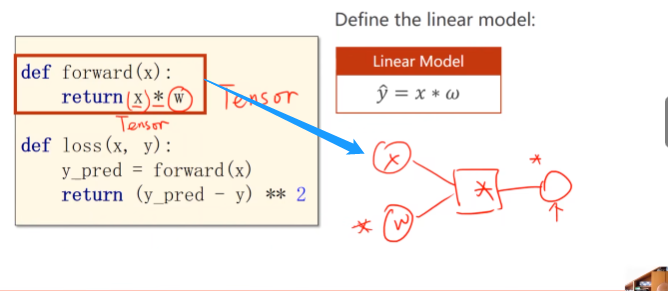

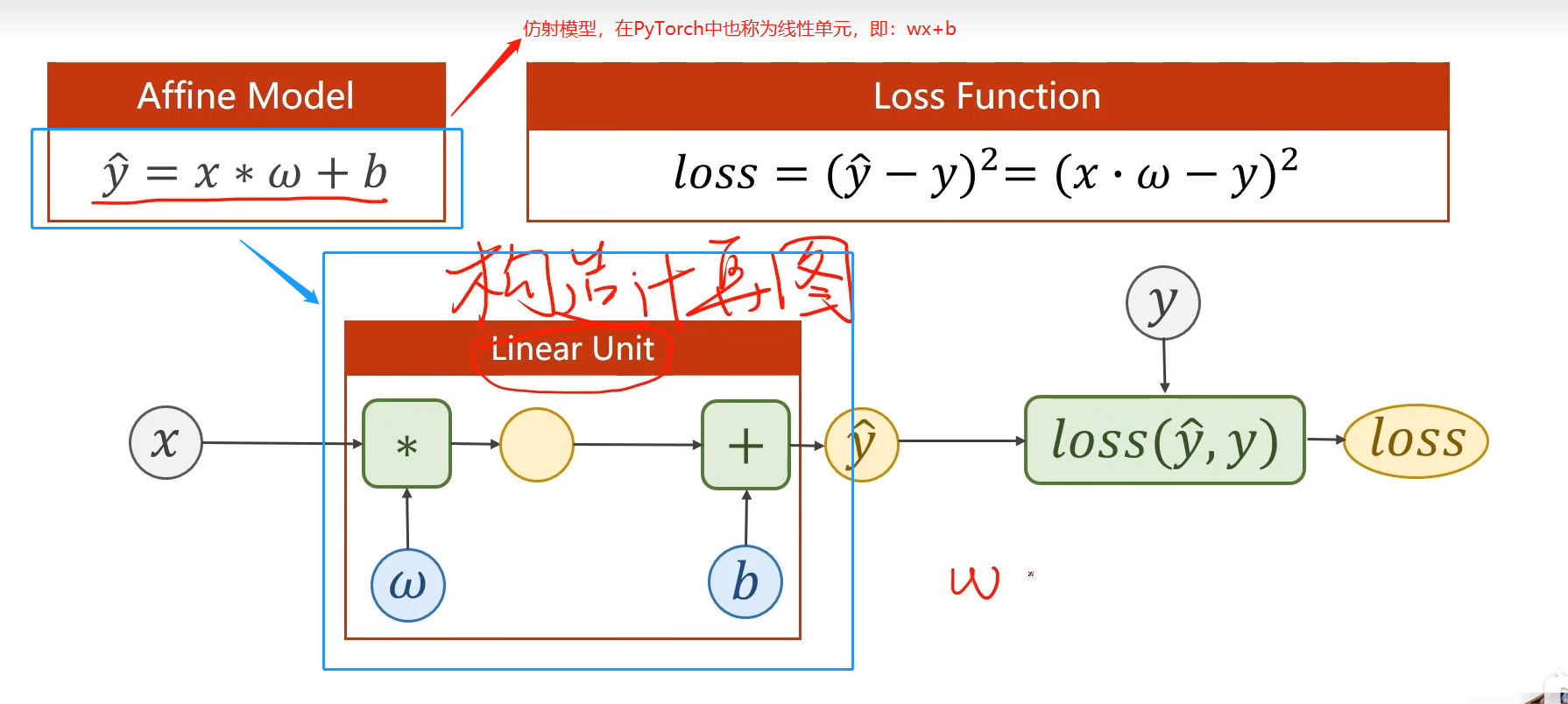

用PyTorch搭建神经网络,构建模型的过程就是构建计算图的过程

-

在计算x*w时,如果w是Tensor格式的,那么x也会自动转化成tensor格式,并自动构建计算图

-

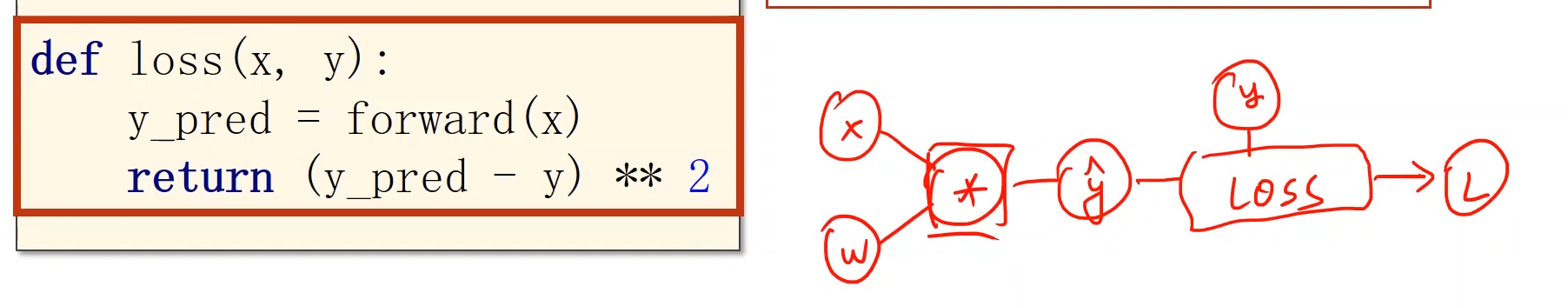

看见下面的代码,要知道是在构建计算图

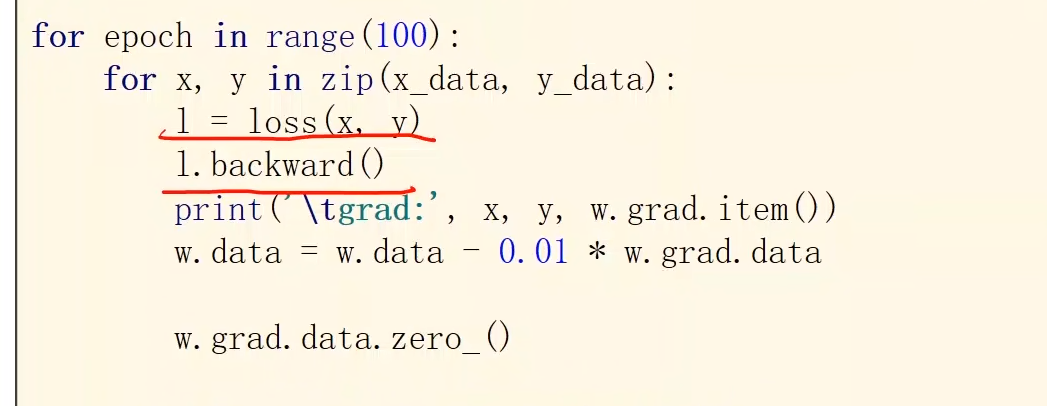

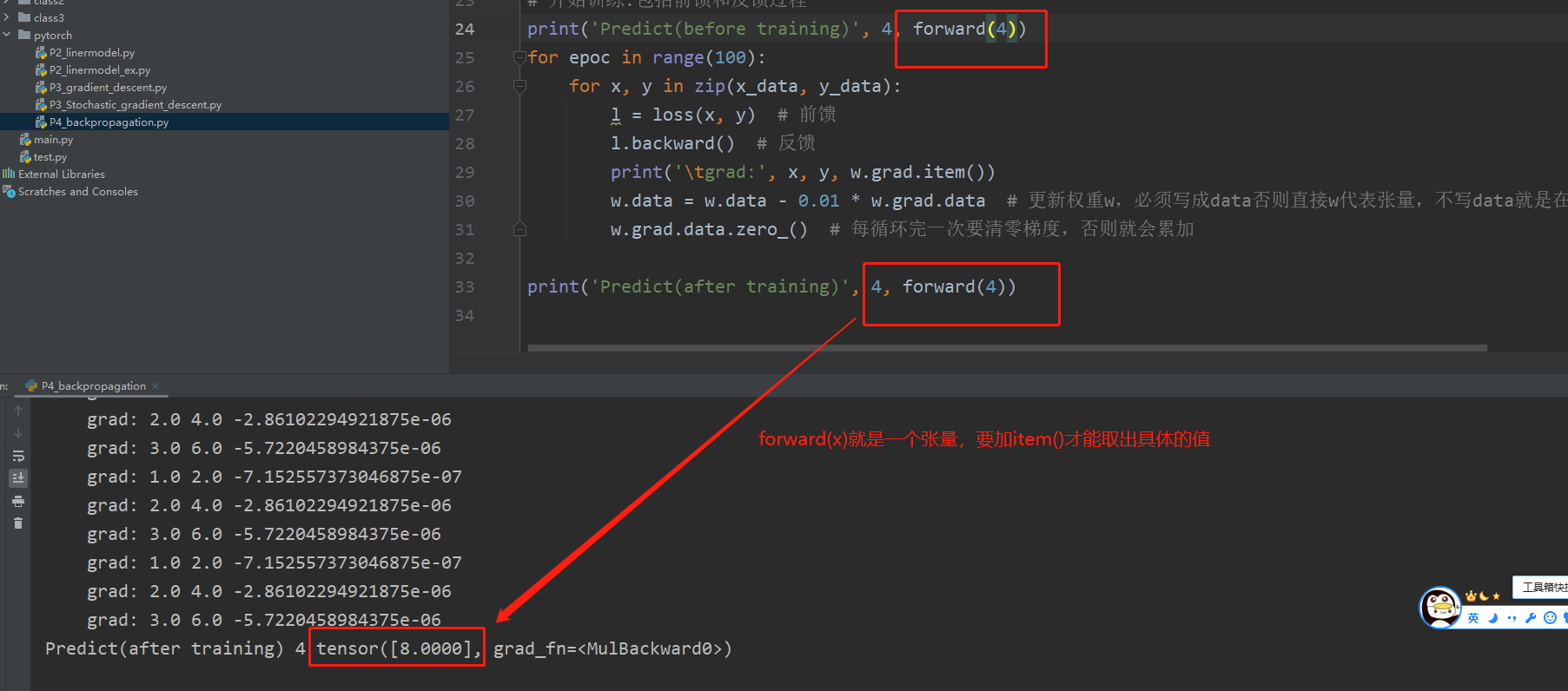

4.w.grad是Tensor格式的,如果直接加法运算的话,就还是在构建计算图,要取到data(构建计算图的时候要用张量进行计算,但更新权重的时候要用data);如果要计算loss的平均值或者求和的话,要用sum+=l.item()的形式取出他的data,如果不加.item(),那么就是张量计算了 ;然后就是其中的w.grad.data.zero_(),这是要将每次循环计算的w的梯度进行清零,否则就是循环一次加一次循环一次加一次了

5. forward(4).item()

用PyTorch实现线性回归(分四步)

第一步:准备数据(x和y必须是矩阵)

第二步:构造计算图——只要把计算图成功构建出来,就可以自动算梯度了(design model)

仿射模型,线性单元(w称为权重,b是偏执,如果想知道w和b的维度,只需要知道输入x和输出y的维度,就可以知道w和b张量的维度了)

import numpy as np

import matplotlib.pyplot as plt

import torch

x_data = [1.0, 2.0, 3.]

y_data = [2.0, 4.0, 6.0]

# 将w定义为tensor格式,同时计算梯度(如果不加True这行代码,默认是不计算梯度的)

w = torch.tensor([1.0])

w.requires_grad = True

# 定义两个函数(在反向传播中,只要调用这两个函数,就都是构建计算图的过程)

def forward(x):

return x * w

def loss(x, y):

y_pred = forward(x)

return (y_pred - y) ** 2

# 开始训练:包括前馈和反馈过程

print('Predict(before training)', 4, forward(4).item())

for epoc in range(100):

for x, y in zip(x_data, y_data):

l = loss(x, y) # 前馈

l.backward() # 反馈

print('\tgrad:', x, y, w.grad.item())

w.data = w.data - 0.01 * w.grad.data # 更新权重w,必须写成data否则直接w代表张量,不写data就是在构建计算图了

w.grad.data.zero_() # 每循环完一次要清零梯度,否则就会累加

print('Predict(after training)', 4, forward(4).item())

练习:y=w1x²+w2x+b

# w1x2+w2x+b

import numpy as np

import matplotlib.pyplot as plt

import torch

x_data = [1.0, 2.0, 3.0]

y_data = [2.0, 4.0, 6.0]

w1 = torch.tensor([1.0])

w1.requires_grad = True

w2 = torch.tensor([1.0])

w2.requires_grad = True

b = torch.tensor(([1.0]))

b.requires_grad = True

def forward(x):

return w1 * x ** 2 + w2 * x + b

def loss(x, y):

y_pred = forward(x)

return (y_pred - y) ** 2

print('Predict(before training)', 4, forward(4).item())

for epoc in range(100):

print('Epoc=', epoc)

for x, y in zip(x_data, y_data):

l = loss(x, y)

l.backward()

print('\tgrad:', x, y, w1.grad.item(), w2.grad.item(), b.grad.item())

w1.data = w1.data - 0.01 * w1.grad.data

w2.data = w2.data - 0.01 * w2.grad.data

b.data = b.data - 0.01 * b.grad.data

w1.grad.data.zero_()

w2.grad.data.zero_()

b.grad.data.zero_()

print('Predict(after training)', 4, forward(4).item())

572

572

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?