引言:在当今人工智能蓬勃发展的时代,DeepSeek 宛如一颗耀眼的新星,突然闯入大众视野,引发了全球范围内的热烈讨论。从其惊人的低成本训练模式,到高性能的模型表现,无一不让业界为之侧目。它打破了传统认知,让人们重新审视 AI 研发的成本与效率。然而,这背后的真相究竟如何?真实的训练成本到底几何?闭源模型的利润又受到怎样的冲击?H100 的价格飙升与它有何关联?补贴推理定价又隐藏着哪些秘密?出口管制对其又会产生怎样的影响?还有多头潜在注意力(MLA)技术究竟有着怎样的神奇之处?让我们一同深入这场 DeepSeek 引发的行业大辩论,探寻其中的奥秘 。

DeepSeek 在短时间内迅速成为全球关注的焦点。尽管该公司并不是新成立的,但近期它获得了前所未有的关注和讨论热度,甚至超过了其他知名的人工智能产品如Claude、Perplexity和Gemini。

对于密切关注这一领域的人来说,DeepSeek 的崛起并不令人意外。几个月以来,行业内一直在讨论 DeepSeek 的潜力与成就。然而,随着公众的关注度激增,这种狂热的关注程度似乎并不完全反映现实情况。作者认为,最近关于 DeepSeek 的讨论转向了其算法改进的速度,以及这是否对 Nvidia 和 GPU 市场造成了负面影响。

最新观点是,DeepSeek 的效率如此之高,以至于不再需要更多的计算资源,这导致了现有计算能力的过剩。尽管 Jevons 悖论(即技术进步虽然提高了效率,但总体上却增加了资源消耗)也被过度炒作,但在现实中,模型的进步确实已经影响到了 H100 和 H200 等硬件的价格。

DeepSeek 的迅猛发展不仅改变了人们对人工智能效率的看法,也对现有的硬件市场产生了实际的影响。

DeepSeek与High-Flyer的关系

High-Flyer是一家中国的对冲基金,早在AI技术被广泛应用于金融领域之外之前,他们就已经认识到AI的潜力,并且特别关注到了扩展性(scaling)的重要性。因此,High-Flyer一直在增加其GPU供应,以支持更大规模的AI模型训练。

2021年,在任何出口限制措施实施之前,High-Flyer就果断投资购买了10,000个A100 GPU,用于大规模模型训练实验。这项战略决策后来被证明是非常成功的,为公司带来了显著的竞争优势。

随着High-Flyer在AI能力上的持续进步,他们决定于2023年5月剥离出一个独立实体——DeepSeek。DeepSeek的目标是专注于进一步发展AI技术。由于当时外界投资者对AI的兴趣有限,尤其是考虑到缺乏明确的商业模式,DeepSeek主要由High-Flyer自我资助。

如今,DeepSeek已经发展成为一个严肃、有组织的努力方向,远远超出了媒体所称的“副项目”。High-Flyer和DeepSeek之间经常共享资源,包括人力和技术计算资源。据估计,仅在GPU投资方面,DeepSeek的投资额已经超过5亿美元,即使考虑到了出口控制的影响。

DeepSeek从一个内部项目的起源到成长为一个独立且重要的AI研发公司的历程。它强调了早期对AI技术和硬件基础设施的战略投资如何奠定了成功的基础,并指出了资源共享对于保持竞争力的重要性。DeepSeek的发展故事也反映了AI技术领域内,早期识别趋势并采取行动的重要性。

DeepSeek的GPU资源分布

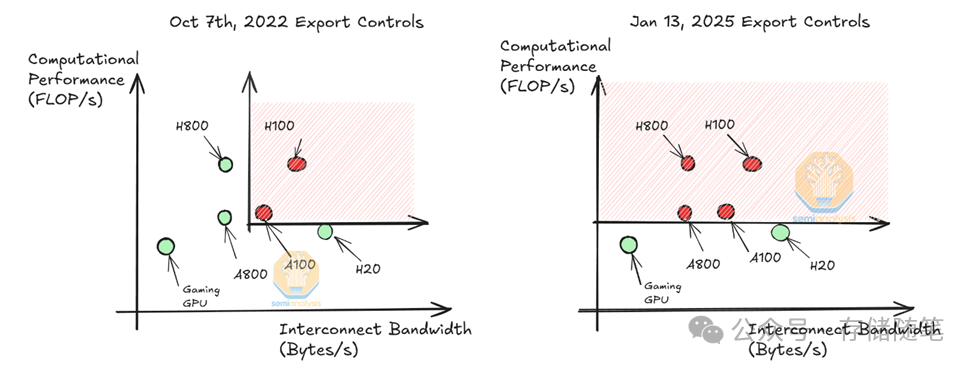

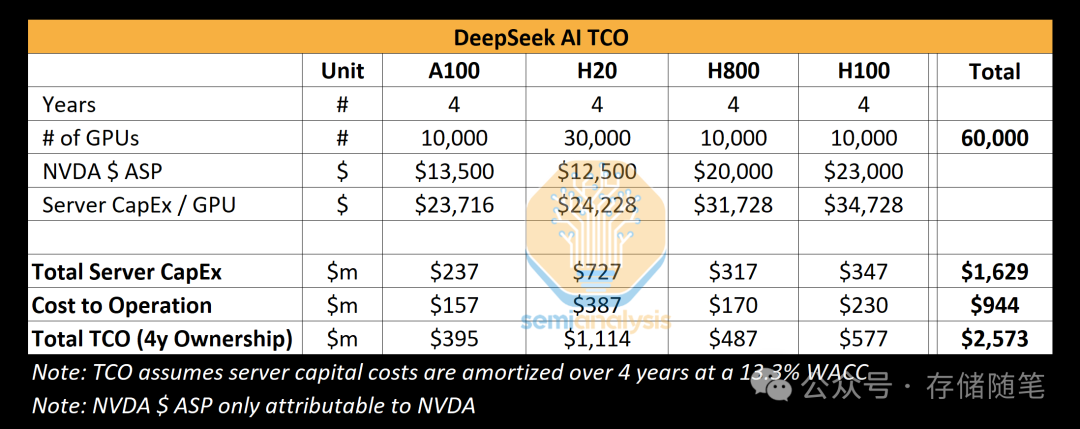

DeepSeek拥有大约50,000个Hopper架构的GPU,其中包括10,000个H800和10,000个H100型号。此外,他们还订购了大量的H20型号GPU,这些GPU专为中国市场设计。尽管H800与H100具有相同的计算能力,但其网络带宽较低。H20是当前唯一对中国模型提供商可用的型号。这些GPU不仅用于DeepSeek,也服务于High-Flyer,地理上分散部署,支持交易、推理、训练和研究等多种任务。

DeepSeek在服务器上的总资本支出约为16亿美元,其中约9.44亿美元用于集群的运营成本。与其他AI实验室和超大规模企业类似,DeepSeek面临的挑战之一是如何有效集中资源进行特定任务的训练。

DeepSeek专注于从中国顶尖大学如北京大学和浙江大学招募人才,强调能力和好奇心而非过往资历。公司提供高度灵活的工作环境,并以访问大量GPU资源为吸引点。为优秀候选人提供的年薪超过130万美元,远高于其他大型中国科技公司和AI实验室的标准。目前DeepSeek有约150名员工,但正在快速扩展。Deepseek核心创始团队成员的学历高校与技术背景如下:

| 成员 |

学历高校 |

技术背景 </ |

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7389

7389

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?