http://blog.csdn.net/pipisorry/article/details/42715245

求解最大似然估计时发现有两种表示方法

from:Gregor Heinrich - Parameter estimation for text analysis

from:http://blog.csdn.net/pipisorry/article/details/42649657

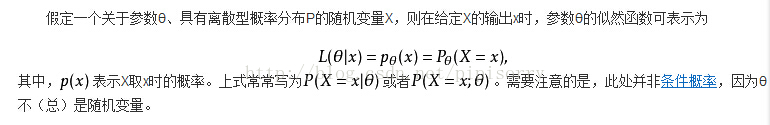

有上述两种方法表示的原因

p(x|theta)不总是代表条件概率;也就是说p(x|theta)不代表条件概率时与p(x;theta)等价

而一般地

写竖杠表示条件概率,是随机变量;

写分号p(x; theta)表示待估参数(是固定的,只是当前未知),应该可以直接认为是p(x),加了;是为了说明这里有个theta的参数,p(x; theta)意思是随机变量X=x的概率。在贝叶斯理论下又叫X=x的先验概率。

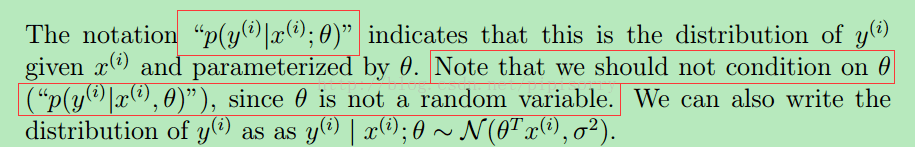

对于P(y|x;theta)的解释

from:andrew ng机器学习讲义中,关于表示方法

对于两种表示法,频率派和贝叶斯派的分歧

频率派认为参数为固定的值,是指真实世界中,参数值就是某个定值。

贝叶斯派认为参数是随机变量,是指取这个值是有一定概率的

from:http://blog.csdn.net/pipisorry/article/details/42715245

本文深入探讨了最大似然估计过程中,概率表达式中的竖杠与分号的区别,解释了它们在条件概率与待估参数表示上的含义,并通过实例说明了频率派与贝叶斯派在参数理解上的分歧。

本文深入探讨了最大似然估计过程中,概率表达式中的竖杠与分号的区别,解释了它们在条件概率与待估参数表示上的含义,并通过实例说明了频率派与贝叶斯派在参数理解上的分歧。

645

645

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?