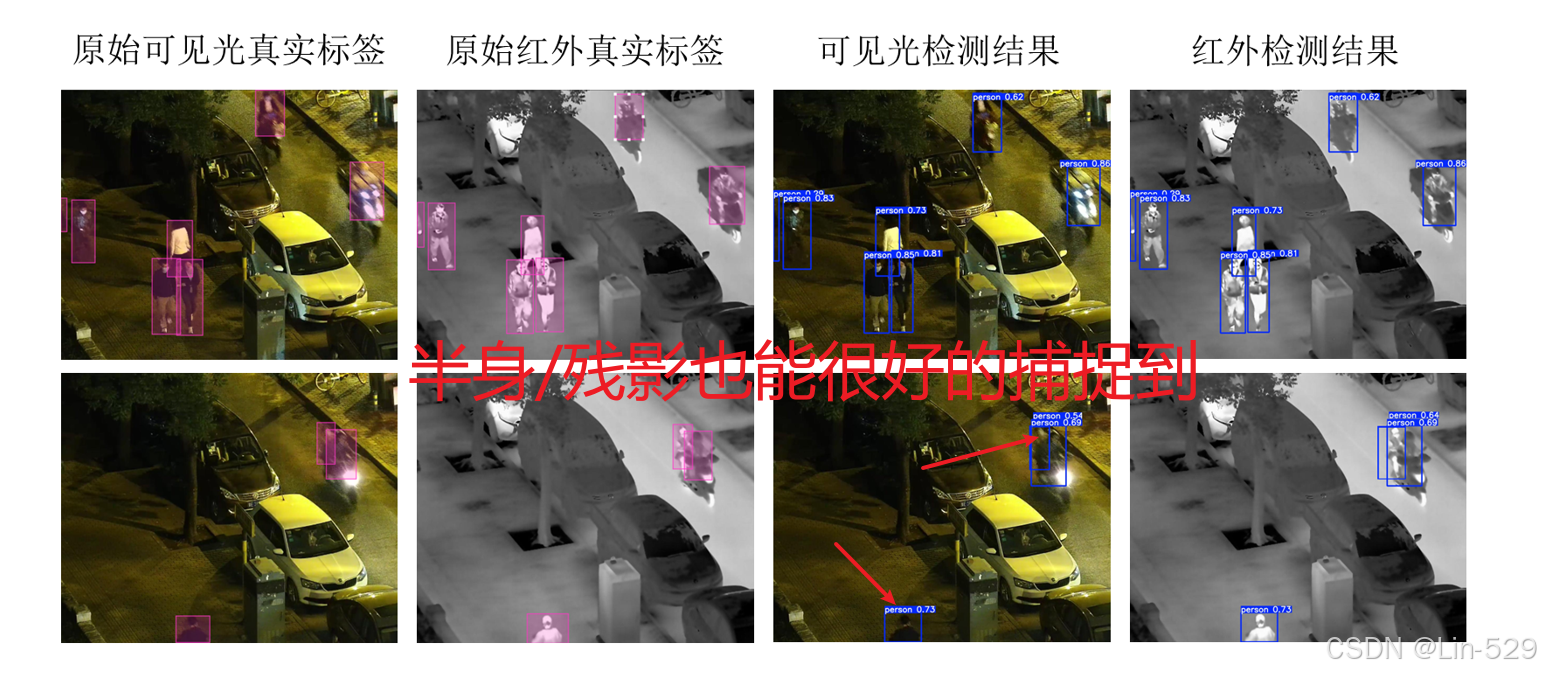

之前分享了自己自学的将YOLOv8改为双模态检测网络,也就是使用两种数据,即红外和可见光的图像进行双路特征提取,然后采用中间融合的方式进行目标检测任务。

随着YOLOv11的发布,通过学习,改进了双模态检测网络,后续会进行相关的创新性的更新。。。

YOLOV11与YOLOV8其实并没有什么特别大的结构上的变化,所以经过一段时间的研究,按照YOLOV8改进双模态的方法,改进了YOLOV11。

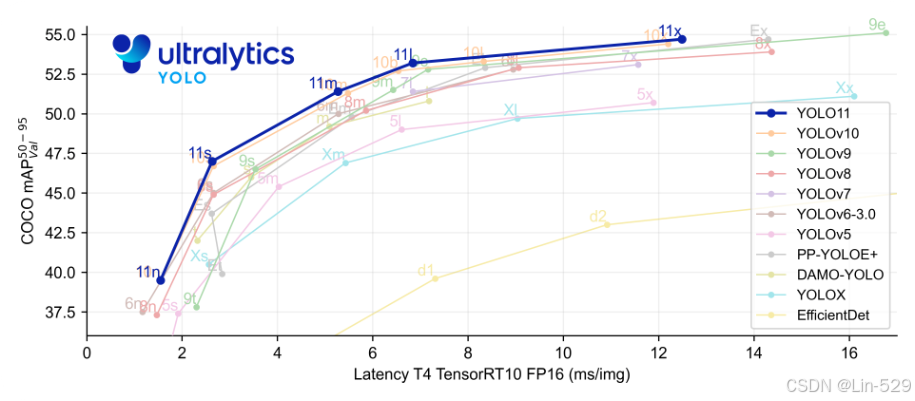

首先介绍下YOLOV11

更新 C2f 模块为 C3K2 模块

这一变化在 YOLOv11 的主干网络中体现,进一步优化了特征提取效率,能够更好地捕捉图像中的重要细节,增强了对复杂场景下物体特征的提取能力,从而有助于更准确地识别和定位物体。

加入 C2PSA 模块

在 SPPF 后加入类似注意力机制的 C2PSA,这个新模块有助于增强网络的关注机制,使模型能够更有针对性地关注图像中的关键区域,改善特征选择能力,进而提升检测性能,让检测结果更加准确可靠。

检测头的调整

YOLOv11 中的检测头内部进行了优化,替换了两个深度可分离卷积(DWConv)。这样的改进不仅降低了计算量,减少了模型的运算成本,提高了运行效率,还在一定程度上提升了检测效果,使模型能够更快速、更准确地检测出物体。

开题的方向是 小目标检测,虽然现在都做烂了,但是没有办法哈哈 硬着头皮做吧~~~

YOLOV11不再论述了,可以看看这个博主的介绍的很清楚:

YOLOv11 | 一文带你深入理解ultralytics最新作品yolov11的创新 | 训练、推理、验证、导出 (附网络结构图)-CSDN博客

主要展示下自己在 LLVIP和KAIST公开数据集上的表现:

主要就是在Neck部分、和Backbone上做了一些改进。。。。后续继续改吧

后续 打算继续看看究怎么处理数据集,把数据集增强下,小目标化,使得更加符合自己的方向。

其实对于改进,身为普通的学术研究的我来说,就是那几个东西缝缝补补,注意力,检测头,骨干网络,中间融合也就是那些东西。缝缝补补,能毕业就行。

有相同方向的小伙伴可以一起交流学习,早日毕业,脱离学术苦海。

也可以看看我之前的V8,点点赞哈哈

645

645

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?