现有的RAG系统存在显著的局限性,包括依赖于扁平的数据表示方式以及不足的上下文感知能力,这可能导致

答案碎片化,无法捕捉复杂的相互依赖关系。为了解决这些问题,我们提出了LightRAG,是一种改进的检索增强生成系统,旨在通过结合图结构和文本索引克服现有RAG系统的局限性。它利用双层检索机制与向量表示相结合,以提高信息检索能力、加快响应速度并维持上下文相关性。此外,通过增量更新算法支持数据的实时整合。实验显示,LightRAG在准确性和效率上超越了现有方法,并已开源发布。

相关研究 项

-

研究问题:如何增强大型语言模型(LLMs)的信息检索和生成能力,特别是通过集成外部知识源来提供更准确和上下文相关的响应。

-

研究内容:LightRAG的框架,通过在文本索引和检索过程中引入图结构,增强从低级和高级知识发现中获取的综合信息检索能力。此外,通过增量更新算法确保新数据的及时集成,使系统能够在快速变化的数据环境中保持有效性和响应性。

-

研究难点:现有RAG系统依赖于平面数据表示,缺乏对实体间复杂关系的理解;这些系统通常缺乏上下文感知能力,导致响应可能无法完全解决用户查询。

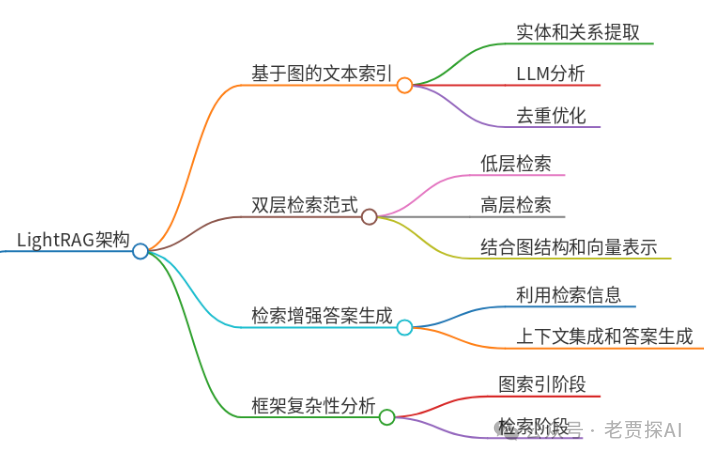

核心内容

LightRAG,用于解决现有RAG系统在信息检索和生成中的局限性。具体来说,

-

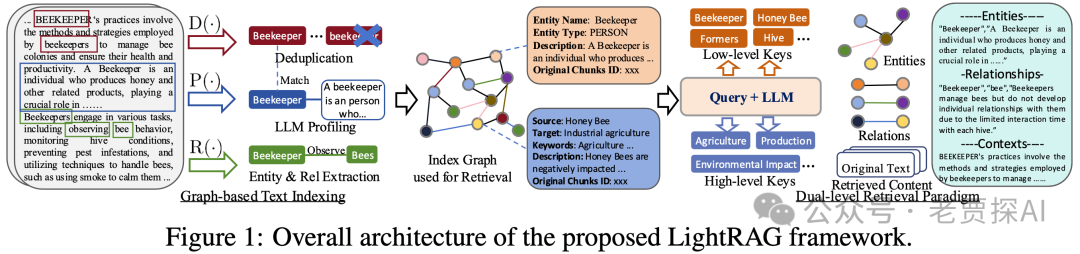

1.图结构的文本索引:首先,LightRAG通过将文档分割成更小的片段,利用LLMs识别和提取各种实体及其关系,生成一个全面的知识图。该过程包括实体和关系的提取、LLM配置的键值对生成以及去重优化。公式如下:

其中, 表示生成的知识图, 和 分别表示节点和边的集合, 表示实体和关系的识别函数, 表示LLM分析生成的键值对, 表示去重操作。

-

2.双层检索范式:其次,LightRAG采用双层检索策略,包括低级检索和高级检索。低级检索关注特定实体的详细信息,而高级检索关注更广泛的主题和概念。通过结合这两种检索方式,LightRAG能够有效应对各种查询类型。

-

3.图结构与向量表示的集成:此外,LightRAG通过将图结构与向量表示相结合,实现了高效的相关实体和关系检索。具体步骤包括:从查询中提取局部和全局关键词,使用向量数据库进行匹配,并收集局部子图中的邻近节点以增强查询的高阶相关性。

-

4.检索增强答案生成:利用检索到的信息生成回答,通过统一查询和多源文本,确保生成的回答与用户需求一致。

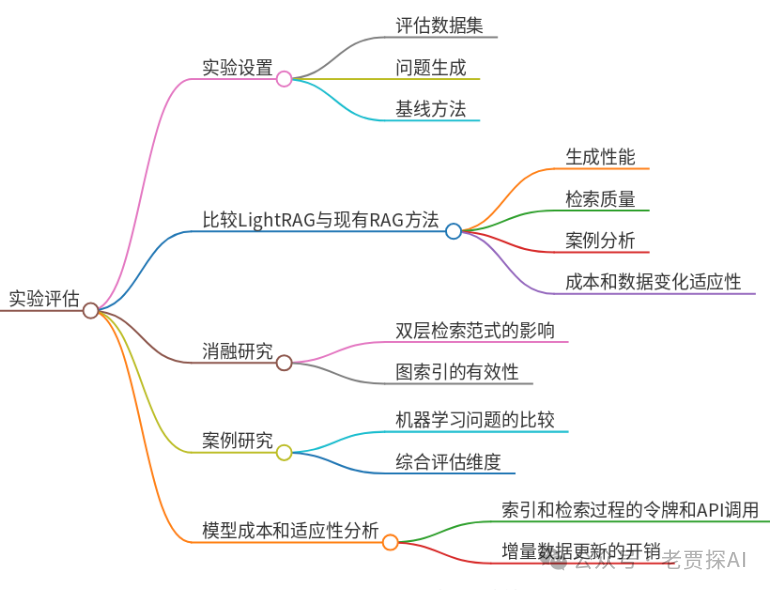

实验设计

-

数据集选择:实验使用了来自UltraDomain基准的四组数据集,包括Agriculture农业、CS计算机科学、Legal法律和混Mix合领域的数据集。每个数据集包含60万到500万个令牌。

-

问题生成:为了评估RAG系统在高阶理解任务中的有效性,实验采用了一种生成方法,指导大型语言模型生成五个用户及其任务和问题。每个用户任务组合生成五个问题,总共生成125个问题。

-

基线方法:LightRAG与以下基线方法进行比较:Naive RAG、RQ-RAG、HyDE和GraphRAG。

-

实现和评估细节:实验中使用nano向量数据库进行向量数据管理,所有基于LLM的操作默认使用GPT-4o-mini。块大小设置为1200,gleaning参数固定为1。

-

评价指标:包括全面性、多样性、赋能性和整体质量四个维度。

-

实验结果:LightRAG在所有数据集和评价维度上均显著优于基线方法,特别是在处理大规模语料库和复杂查询时表现出色。例如,在Legal数据集中,LightRAG的全面性达到了80.95%,而基线方法的最高仅为19.05%。

结果与分析

-

与现有RAG方法的对比:在处理大规模语料库和复杂查询时,基于图的RAG系统(如LightRAG和GraphRAG)显著优于纯分块检索方法(如NaiveRAG、HyDE和RQ-RAG)。特别是在最大的法律数据集中,基线方法的胜率仅为20%,而LightRAG则表现出明显的优势。

-

响应多样性:与基线方法相比,LightRAG在多样性指标上表现出色,特别是在较大的法律数据集中。其一致的领导地位表明,LightRAG在生成更广泛的响应方面更有效,特别是在需要多样化内容的情况下。

-

与GraphRAG的对比:尽管LightRAG和GraphRAG都使用基于图的检索机制,但LightRAG在处理较大数据集和复杂语言上下文时表现更为出色。在农业、计算机科学和法律数据集中,LightRAG显示出明显的优势。

-

消融研究:通过消融研究评估了双层检索范式和基于图的文本索引的有效性。结果表明,仅使用低级或高级检索的模型在多个数据集和指标上的性能显著下降,而LightRAG的双层检索模式在多个维度上实现了平衡的性能。

总结

通过集成基于图的索引方法,提出了一种改进的 RAG 系统LightRAG。LightRAG利用全面知识图实现快速且相关的文档检索,增强了复杂查询的理解。其双层检索范式允许提取具体和抽象信息,满足不同用户的需求。此外,LightRAG 的无缝增量更新能力确保系统在动态环境中保持最新和响应。总体而言,LightRAG 在效率和效果上均表现出色,显著提高了信息检索和生成的速度和质量,同时降低了LLM推理的成本。

关键QA

-

问题1:LightRAG如何通过图结构改进信息检索的效率和理解能力?

-

a.实体和关系提取:LLM用于从文本中识别和提取实体(如人名、地名、组织名等)及其关系(如“位于”、“创始人”等)。

-

b.键值对生成:每个实体和关系被赋予一个键值对,键是用于快速检索的词或短语,值是从外部数据中提取的相关文本段落。

-

c.去重:去除重复的实体和关系,以优化图操作。

-

1)LightRAG通过将文档分割成更小的片段,并利用 LLM 识别和提取实体及其关系,构建一个综合的知识图谱。这个知识图谱不仅包含了实体的详细信息,还捕捉了实体之间的关系。LightRAG的图结构文本索引过程包括以下步骤:

-

2)通过这种方式,LightRAG能够捕捉到多跳子图中的全局信息,从而在大规模语料库中更有效地理解和处理复杂查询。这种方法不仅提高了检索的效率,还增强了系统的理解能力。

-

问题2:LightRAG的双层检索范式是如何设计的,它在实验中表现如何?

-

a.低级检索:关注特定实体及其关联属性或关系。这种检索方式适用于需要精确信息的查询,例如查询某个特定人物的主要成就。

-

b.高级检索:关注更广泛的主题和概念。这种检索方式适用于需要综合信息的查询,例如查询人工智能对现代教育的影响。

-

1)LightRAG的双层检索范式包括两个层次的检索:低级检索和高级检索。

-

2)通过结合这两种检索方式,LightRAG能够有效应对详细和抽象的查询。实验结果表明,仅使用低级检索或高级检索的模型在多个数据集和指标上的表现均不如完整的LightRAG模型。这表明在综合信息检索方面具有显著优势。

-

问题3:LightRAG在增量数据更新方面有哪些创新,这些创新如何影响系统的性能?

-

a.增量更新算法:对于新加入的文档,LightRAG使用相同的图基索引步骤进行处理,生成新的知识图谱。然后,将新图谱与原始图谱通过节点集和边集的并集进行合并。

-

b.减少计算开销:由于不需要重建整个索引图,LightRAG在增量更新过程中显著降低了计算开销。这使得系统能够快速整合新数据,保持时效性和准确性。

-

1)LightRAG在增量数据更新方面进行了创新,使其能够在不重建整个索引图的情况下快速适应新数据的变化。具体方法如下:

-

2)实验结果显示,在处理动态环境中的数据变化时,LightRAG的性能显著优于传统的GraphRAG方法。特别是在处理大规模数据集时,LightRAG的增量更新机制能够有效降低计算成本,提高系统的整体效率。

引用

-

https://arxiv.org/pdf/2410.05779

-

https://github.com/HKUDS/LightRAG

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

1696

1696

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?