前言

KAIST、UCL和KT的研究人员探索了大型语言模型在预训练中获取和保留事实性知识的机制,发现模型大小、批次大小和数据集质量而非数量是影响知识记忆的关键因素,为优化模型训练策略提供了新思路。

论文介绍

大型语言模型 (LLMs) 因其理解和生成类人文本的能力而备受关注。由于接受过海量数据的训练,这些模型拥有有效编码事实性知识的独特能力。这种能力在各种应用中都至关重要,从自然语言处理 (NLP) 任务到更高级的人工智能形式。然而,了解这些模型如何在预训练期间获取和保留事实信息是一个复杂的挑战。这项研究调查了 LLMs 内化知识的复杂过程,并探索了如何优化这些模型以维护和概括它们获得的知识。

研究人员在训练 LLMs 时面临的主要问题之一是事实性知识会随着时间的推移而丢失。当在预训练中使用大型数据集时,LLMs 难以保留特定事实的细节,尤其是在后续训练阶段引入新信息时。此外,LLMs 经常难以记住罕见或长尾知识,这严重影响了它们在不同主题上的泛化能力。这种记忆力的丧失会损害模型在应用于复杂或不常遇到的场景时的准确性,这对提高 LLMs 的性能构成了相当大的障碍。

为了应对这些挑战,人们已经引入了几种方法,重点是改进 LLMs 对事实性知识的获取和保留。这些方法包括扩大模型规模和预训练数据集、使用先进的优化技术以及修改批量大小以更好地处理训练期间的数据。此外,还提出了对数据集进行去重以减少训练数据中的冗余,从而提高学习效率。尽管做出了这些努力,但快速遗忘和模型难以概括不常见事实的基本问题仍然存在,目前的解决方案只是进行了渐进式的改进。

来自 KAIST、UCL 和 KT 的研究人员引入了一种新方法来研究 LLMs 对事实性知识的获取和保留。他们设计了一个实验,在预训练期间系统地将新的事实性知识注入模型。通过分析模型在各种条件下记忆和概括这些知识的能力,研究人员旨在揭示控制 LLMs 如何学习和遗忘的动力学。他们的方法包括监测模型在不同检查点上的性能,并观察批量大小、数据重复和释义等因素对知识保留的影响。该实验为优化训练策略以提高 LLMs 的长期记忆提供了宝贵的见解。

研究人员的方法论非常彻底,涉及在预训练的多个阶段进行详细评估。他们使用模型以前从未遇到过的虚构知识进行实验,以确保分析的准确性。测试了各种条件,包括重复注入相同的 factual knowledge、对其进行释义或仅呈现一次。为了衡量知识保留的有效性,该团队通过检查特定事实的回忆概率随时间的变化来评估模型的性能。他们发现,较大的批量大小有助于模型更有效地保留事实性知识,而重复的数据会导致更快地遗忘。通过使用各种测试条件,研究团队可以确定训练 LLMs 以保留和概括知识的最有效策略。

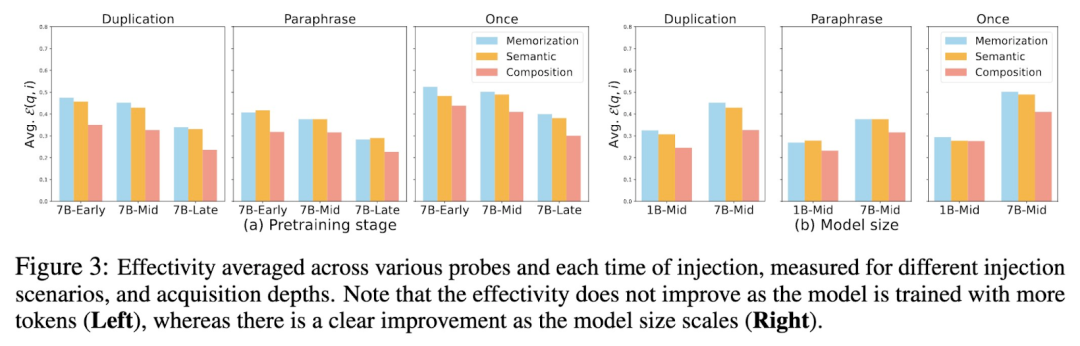

所提出的方法的性能揭示了几个关键发现。首先,研究表明,较大的模型(例如具有 70 亿个参数的模型)比仅具有 10 亿个参数的较小模型表现出更好的事实性知识保留。有趣的是,使用的训练数据量并没有显著影响记忆力,这与更多数据导致更好模型性能的观点相矛盾。相反,研究人员发现,使用去重数据集训练的模型更加稳健,遗忘率更慢。例如,接触过释义知识的模型表现出更高程度的泛化能力,这意味着它们可以在不同的上下文中更灵活地应用知识。

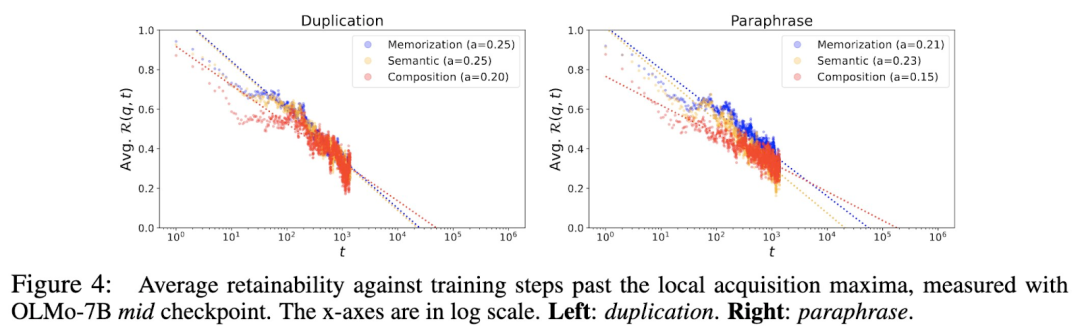

另一个关键发现是批量大小和知识保留之间的关系。使用较大批量大小(例如 2048)训练的模型比使用较小批量大小(128)训练的模型表现出更强的抗遗忘能力。该研究还揭示了训练步骤与遗忘之间的幂律关系,表明使用重复数据训练的模型中的事实性知识退化得更快。另一方面,接触大量独特事实的模型保留这些知识的时间更长,这突出了数据集质量比绝对数量更重要。例如,在预训练后期,重复数据的衰减常数为 0.21,而释义数据为 0.16,这表明数据集去重后遗忘速度较慢。

该研究为解决 LLMs 中的遗忘和泛化能力差的问题提供了一种有前景的方法。研究结果表明,在预训练阶段优化批量大小和去重可以显著提高 LLMs 对事实性知识的保留。这些改进可以使模型在更广泛的任务中更加可靠,尤其是在处理不太常见或长尾知识时。最终,这项研究更清楚地阐释了 LLMs 中知识获取背后的机制,为未来研究改进训练方法和进一步增强这些强大模型的能力开辟了新途径。

这项研究为了解大型语言模型如何获取和保留知识提供了宝贵的见解。通过确定模型大小、批量大小和数据集质量等因素,该研究为提高 LLM 性能提供了实用的解决方案。这些发现突出了高效训练技术的重要性,并强调了优化 LLMs 以使其在处理复杂和多样化的语言任务方面更加有效的潜力。

论文下载

- 论文地址:https://arxiv.org/abs/2406.11813

最后的最后

感谢你们的阅读和喜欢,我收藏了很多技术干货,可以共享给喜欢我文章的朋友们,如果你肯花时间沉下心去学习,它们一定能帮到你。

因为这个行业不同于其他行业,知识体系实在是过于庞大,知识更新也非常快。作为一个普通人,无法全部学完,所以我们在提升技术的时候,首先需要明确一个目标,然后制定好完整的计划,同时找到好的学习方法,这样才能更快的提升自己。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1685

1685

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?