今天给大家带来华为诺亚方舟实验室在AAAI2025上最新的大模型论文。

【论文标题】

Eve: Efficient Multimodal Vision Language Models with Elastic Visual Experts

【论文链接】https://arxiv.org/pdf/2501.04322v1

1

摘要

多模态视觉语言模型(VLMs)在模型规模和数据量不断增加的支持下取得了显著进展。

在边缘设备上运行 VLMs 对其广泛应用构成了挑战。

已有一些高效 VLM 的研究,但它们往往为增强多模态能力而牺牲语言能力,或需要大量训练。

为解决这一困境,本文引入了具有弹性视觉专家的高效视觉语言模型(Eve)这一创新框架。

通过在训练的多个阶段巧妙整合适应性视觉专业知识,Eve 在保持语言能力和增强多模态能力之间取得了平衡。

这种平衡的方法产生了一个仅含 18 亿参数的通用模型,在多模态和语言任务中都有显著改进。

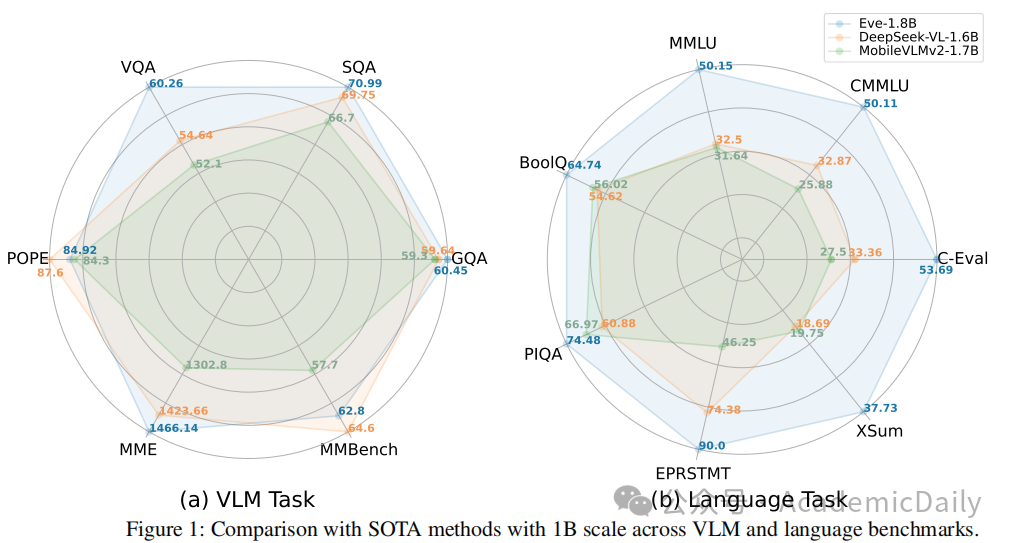

值得注意的是,在 30 亿参数以下的配置中,Eve 在语言基准测试中表现突出,并在 VLM 基准测试中达到了 68.87% 的最先进结果。

此外,其多模态准确性超过了更大的 70 亿参数的 LLaVA-1.5 模型。

2

背景

随着人工智能的迅速发展,视觉和语言的理解备受关注,成为重要的研究焦点。多模态模型如视觉语言模型(VLMs)旨在结合视觉信息和文本描述,以增强语义理解。

现有的大多数 VLMs 主要通过扩大数据量或增加模型尺寸来增强多模态能力,这使得模型规模庞大,难以在设备上部署和高效推理,阻碍了其实际应用。

为开发高效的 VLMs,虽有方法提出,但这些方法常以牺牲语言能力为代价增强多模态能力,或大幅增加训练成本。

3

贡献

-

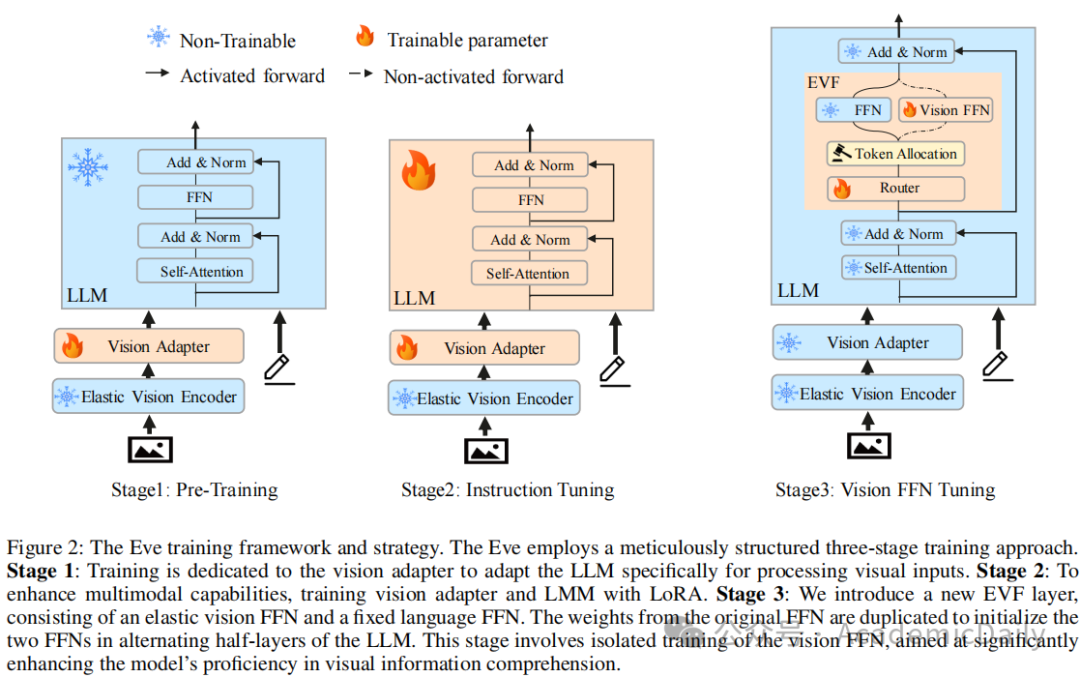

本文提出了弹性视觉专家(Eve)框架,精心设计了三个训练阶段,并在每个阶段巧妙融入动态自适应视觉专家,使每个专家专注于特定领域任务,在训练过程中整合专家的最佳性能以增强多模态能力,同时保持固有的语言能力。

-

弹性视觉专家,包括弹性视觉编码器(EVE)和弹性视觉前馈网络(EVF),具有出色的适应性。在前两个训练阶段,视觉编码器保持冻结,便于与各种视觉编码器无缝集成,同时保持语言模型的性能。在第三阶段,引入 EVF,与模型的语言能力相结合,产生强大的协同作用,显著提高了模型处理和融合视觉和文本数据的能力,从而大幅增强其多模态性能。

-

Eve 在参数少于 30 亿的多模态任务中表现出色,在 VLM 和语言基准测试中达到顶尖性能,在多模态准确性方面与 70 亿参数的 LLaVA - 1.5 模型相当。

4

技术方案

4.1 概述

Eve 采用了复杂的三阶段框架,在每个阶段都战略性地集成了弹性视觉专家。

在训练过程中,前两个阶段视觉编码器的预训练数据变化不会影响模型的语言能力。

在后期训练中,在第三阶段引入新的弹性视觉前馈网络(FFN)来增强模型处理多模态数据的能力,同时保持语言任务的熟练度。

4.2 弹性视觉编码器

基于现有的基础视觉模型如 ResNet 和 ViT 提出弹性视觉编码器。

在训练的前两个阶段,视觉编码器从 RGB 图像中提取特征并转换为视觉嵌入序列,视觉适配器被持续训练以将视觉特征与语言模型的特征空间对齐

而语言模型在第二阶段仅进行轻微的基于 LoRA 的微调,且视觉编码器保持冻结以支持不同的视觉骨干模型。

本文使用 ResNet-50 作为视觉编码器,并在 ImageNet-1K、ImageNet-22K 和 LAION400M 数据集上进行训练

结果表明在 ImageNet-22K 上训练的模型在 VLM 基准测试中精度最高,且不同数据集训练的视觉编码器对模型语言能力影响较小。

4.3 弹性视觉 FFN

在第三阶段受 MoE-LLaVA 启发引入弹性视觉前馈网络(EVF)。

EVF 层包含路由机制、令牌分配策略以及两个分别用于语言处理和视觉信息的前馈网络(FFNs)。

在LLM前向传播中,图像和文本tokens经处理后共同输入 LLM,路由层首先为每个token推荐一个 FFN,token分配机制再综合考虑路由层建议和 FFN 容量决定tokens分配。

路由机制使用线性层计算将每个token分配到相应 FFN 的概率

公式为:,

其中,为轻量级可训练参数,对应语言 FFN,对应视觉 FFN。

在第三阶段初始化时,将第二阶段的 FFN 参数复制到语言和视觉 FFNs 中,训练时冻结视觉编码器、视觉适配器和语言模型的大部分参数,仅训练视觉 FFN 和语言模型中的路由层。

在多模态任务推理阶段,EVF 层的两个 FFNs 都被激活,而在语言任务中,仅保留语言 FFN。

Token分配。对确定每个token分配到哪个 FFN 至关重要。

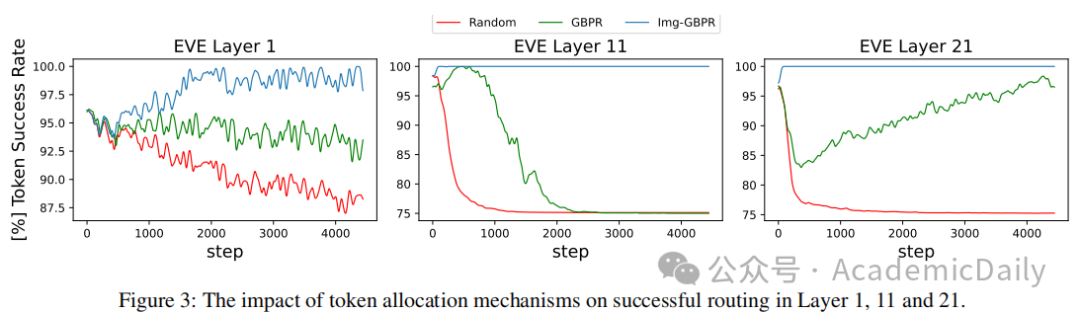

在 EVF 层中,每个 FFN 有预定义容量,传统分配机制若推荐令牌数超容量会随机丢弃部分令牌

本文引入 GBPR 策略,根据路由分数优先分配重要令牌,进一步提出 Img-GBPR 机制区分管理视觉和文本token,为每种token类型指定默认推荐 FFN,并根据模态优化token分配,最终优先级分数计算公式为

,

当分配给 FFN 的令牌数超容量时,优先选择基于的最重要个token分配,剩余令牌重新分配,一定比例随机分配到另一个 FFN 以减少token损失。

平衡损失:借鉴 MoE-LLaVA,整体损失函数由回归损失和辅助损失组成,,

本文调整辅助损失系数为 0.001,并在每个 EVF 层集成可微负载平衡损失,

其中和分别表示视觉和语言 FFN 处理的令牌比例,和表示视觉和语言 FFN 的平均路由概率,以促进 FFN 间令牌处理的公平分配。

5

实验结果

模型细节与训练设置

Eve 由视觉适配器、视觉编码器和语言模型三个核心组件构成。

视觉适配器基于轻量化下采样投影仪(LDP),视觉编码器采用 SigLip-L,语言模型为 PanGu-π-1.5B-Pro。

在训练阶段

第一阶段冻结视觉编码器和 LLM 仅训练视觉适配器

第二阶段使用 LoRA 技术微调视觉适配器和 LLM

第三阶段仅训练视觉 FFN 并为每个 FFN 设置容量,训练数据集在前两阶段使用 CC-595K 和 LLaVA - mixed - 665

第三阶段精心挑选了涵盖多领域的超过 320 万个样本的数据集。

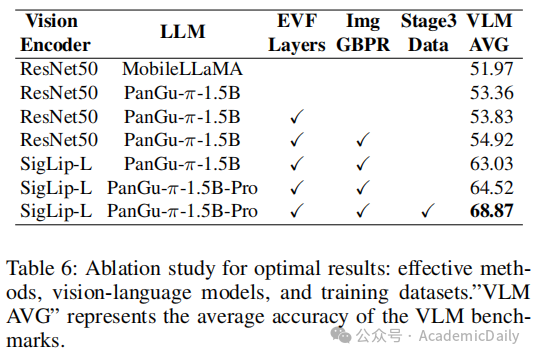

消融研究

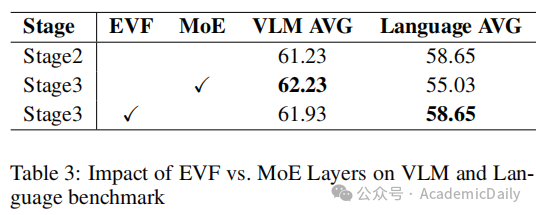

弹性视觉 FFN 层的影响:在第三阶段,比较 EVF 和 MoE 层在多模态和语言任务上的性能差异,结果显示 MoE 层虽使多模态任务精度提高 0.55%

但语言任务精度显著降低 3%,而 EVF 层架构在提高多模态任务精度 0.47% 的同时完全保留了语言任务精度。

Token分配的影响:对比了随机、GBPR 和 Img-GBPR 三种token分配方法对训练的影响,可视化结果表明 Img-GBPR 在各层的令牌成功率提升最显著

实验结果显示 GBPR 比随机分配方法平均精度提高 0.4 个百分点,Img-GBPR 进一步提高 0.5%。

最佳结果的消融研究:通过在方法、模型和训练数据集三个维度进行消融实验,结果表明用 PanGu-π-1.5B 替换语言模型、引入 EVF 层和 Img-GBPR、将视觉编码器升级为 SigLIP-L、用 PanGu-π-1.5B-Pro 替换语言模型以及使用第三阶段数据集分别都能提高模型精度,最终达到 68.87% 的峰值精度。

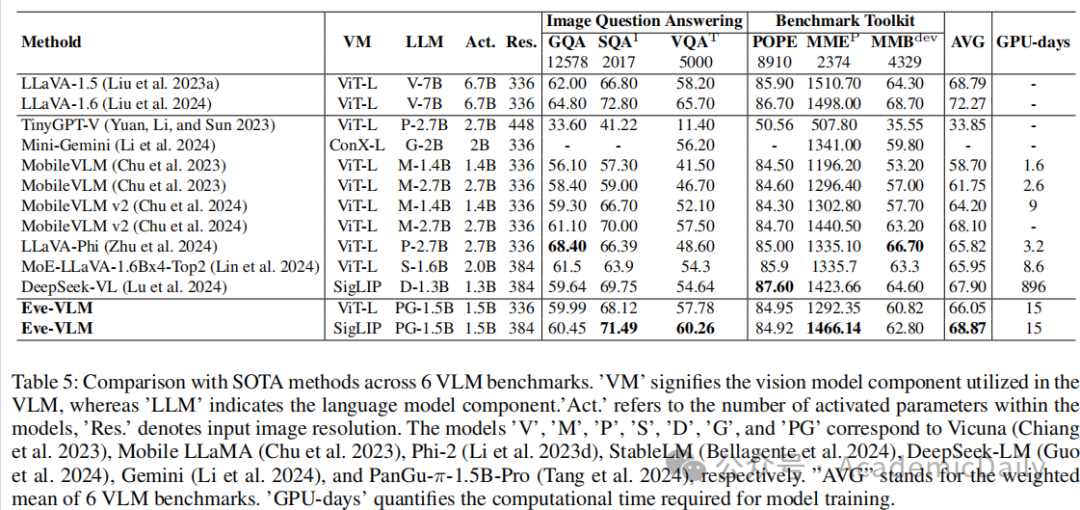

与 SOTA 方法比较

在少于 30 亿激活参数的模型中,Eve 达到了 68.87% 的最佳精度。与相似参数规模的模型相比,Eve 比 DeepSeek-VL 性能高 1.9% 且训练效率更高,仅需 15 GPU 天

甚至超过了一些 70 亿参数的模型如 LLaVA-1.5,在保持语言任务能力方面也明显优于现有参数少于 30 亿的 VLM。

6

结论

本文引入了高效的 VLM 框架 Eve,其在各个阶段嵌入弹性视觉专家,并且自适应令牌分配机制增强了模型有效处理多模态信息的能力。

因此,该模型不仅保留了语言能力,还显著提高了多模态性能。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

1179

1179

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?