原文链接:https://arxiv.org/abs/1909.09552

注:只关注人脸图像补丁部分

一、介绍

我们提出一类简单的矩形遮挡攻击,其中攻击者将矩形补丁放置在图像上,补丁的位置和内容都是对立选择的。我们开发了几种算法来计算这种对抗性遮挡,并使用对抗性训练来获得对这些遮挡鲁棒的神经网络模型。然后,我们通过实验证明,我们提出的方法对深度神经网络的物理攻击比对抗性训练和利用基于LP的攻击模型的随机平滑方法更强大。

传统的鲁棒ML在物理攻击中表现不佳有两个可能的原因:

1)涉及lp有界扰动的对抗模型太难实现有效的鲁棒学习

2)传统的攻击模型对于现实的物理攻击来说太不匹配。具体来说,我们发现,传统的鲁棒ML模型在面对LP有界攻击时表现出更高的鲁棒性。

二、方法

(1)矩形阻塞攻击(ROA)

攻击者引入一个固定尺寸的矩形。这个矩形可以被对手放置在图像中的任何地方,并且攻击者可以进一步在矩形内引入l∞噪声,并具有外部指定的上限nr(例如,nr = 255,这有效地允许添加任意对抗性噪声)。

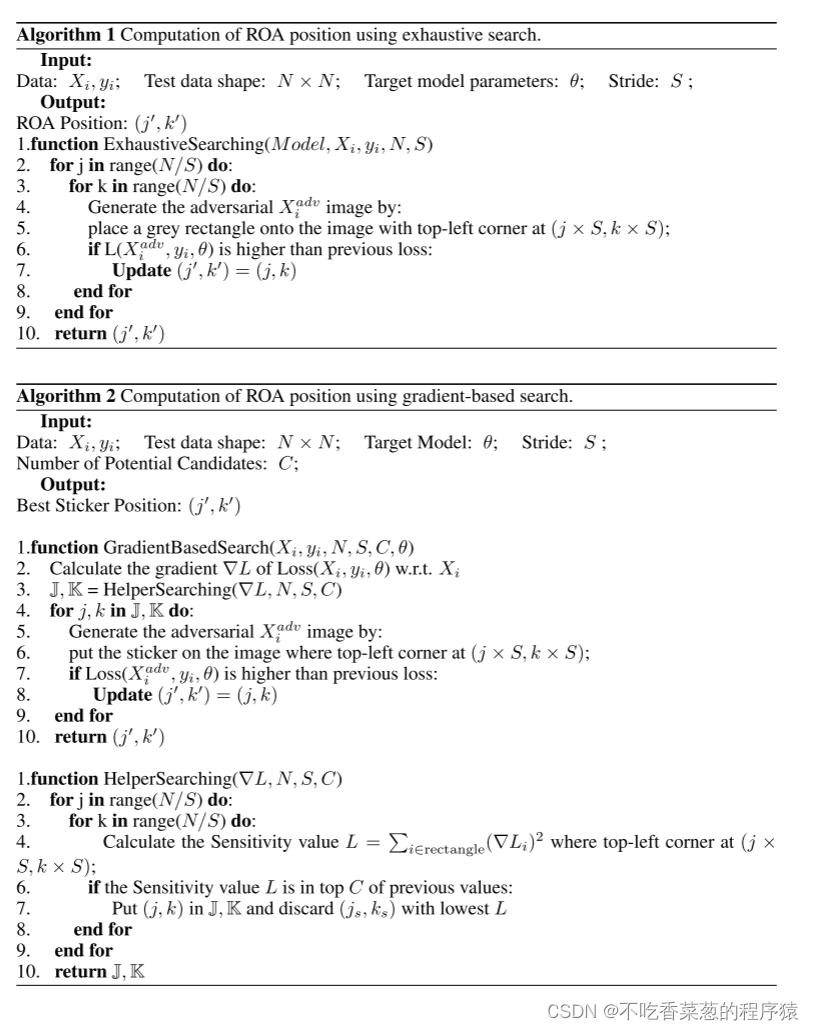

ROA攻击的计算涉及1)识别一个区域放置在图像中的矩形,和2)生成细粒度的对抗性扰动限制在这个区域。我们首先使用灰色矩形执行穷举搜索,以找到使损失最大化的位置,然后固定位置并在矩形内应用PGD。

DOA:使用我们介绍的ROA威胁模型进行对抗性训练,以对抗物理上可实现的攻击。

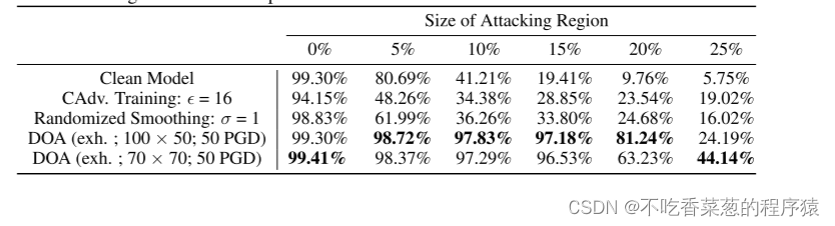

一旦攻击区域(图像的分数)达到10%或更高,对抗补丁攻击就非常有效,对抗训练和随机平滑都表现得很差。相比之下,即使对抗补丁覆盖20%的图像,DOA仍然保持高度鲁棒性。

补充:对抗性强的深度学习

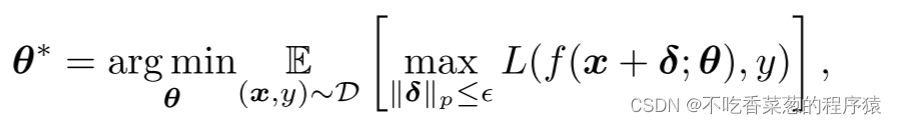

Robust Learning

其中D表示训练数据集。在实践中最有效的是PGD攻击,作为内部优化问题的近似,然后对相关的对抗输入采取梯度下降步骤。

此外,我们考虑了这种方法的修改版本,称为课程对抗训练(CAT)。我们对这种方法的实现如下:首先,对一个小的噪声应用对抗训练,然后增加噪声并重复对抗训练,以此类推,增加噪声直到我们达到我们希望鲁棒的对抗噪声水平。

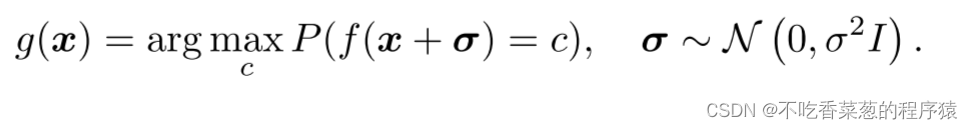

Randomized Smoothing

我们考虑的第二类技术通过在训练和预测时向输入添加噪声来工作。关键思想是通过用方差为σ的各向同性高斯噪声扰动输入x,从基本分类器f(·)构造平滑分类器g(·)。然后通过选择相对于f(·)决策的诱导分布具有最高概率测度的类来进行预测:

三、实验

人脸识别

VGGFace:我们使用标准的corp-and-resize方法将数据处理为224 × 224像素,并根据每个主题的7:2:1比例将数据集分为训练,验证和测试。

我们使用VGGFace卷积神经网络模型,VGG 16模型的变体,包含5个卷积层块和3个全连接层。我们使用标准的迁移学习,因为我们只对10个主题进行分类,保持卷积层与VGGFace结构相同,但将全连接层改为1024 → 1024 →10,而不是4096→4096→2622。具体来说,在我们的Pytorch实现中,我们将图像从RGB转换为BGR通道阶数,并减去平均值[129.1863,104.7624,93.5940],以便在卷积层上使用来自VGG-Face的预训练权重。我们将批量大小设置为64,并使用Pytorch内置的Adam Optimizer,初始学习率为10−4,并使用Pytorch中的默认参数。此外,我们使用验证集精度来跟踪模型性能,并在过拟合的情况下选择模型。经过30次的训练,该模型在测试数据上的成功率为98.94%

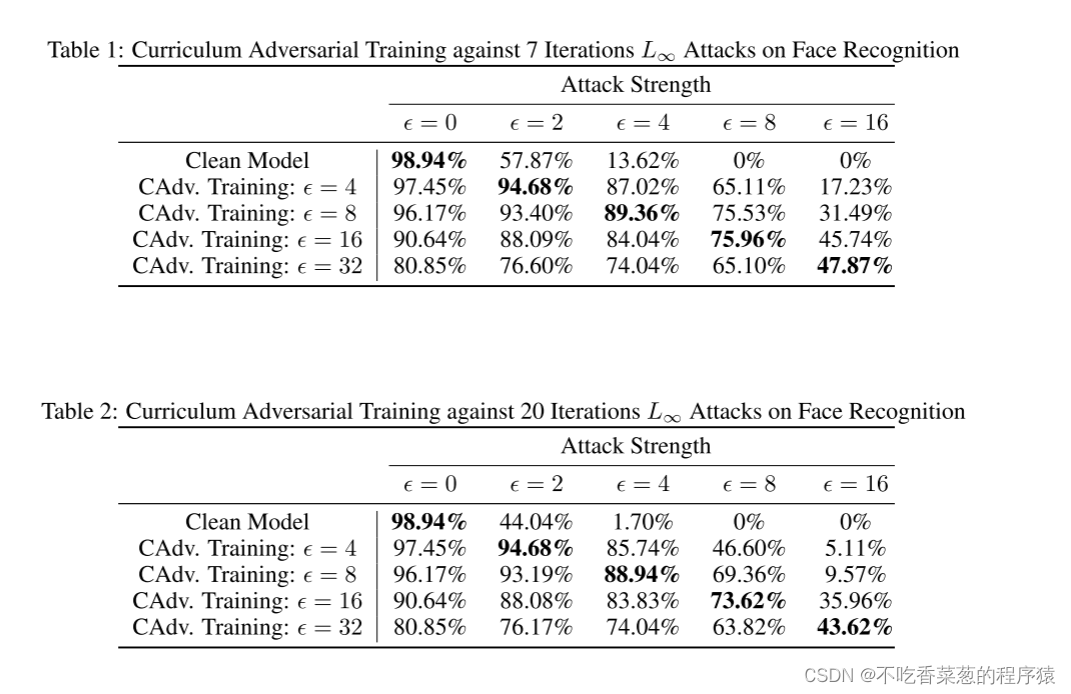

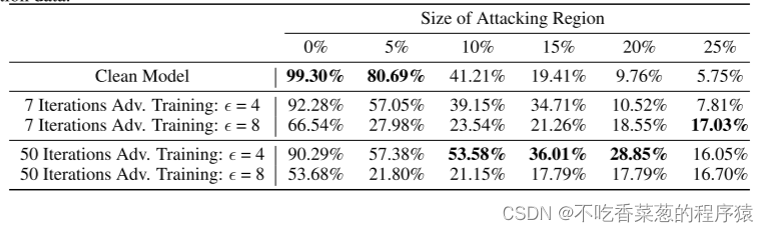

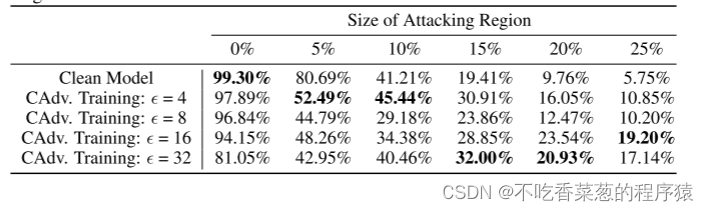

分别列出了针对不同l∞攻击的(课程)对抗训练的结果,分别用于训练和评估。正如我们所看到的那样,具有k = 16的课程对抗训练通常是最健壮的,并且对于相对较大的扰动仍然相当有效。然而,正如人们所期望的那样,我们确实观察到非对抗性数据的准确性和鲁棒性之间存在明显的权衡。

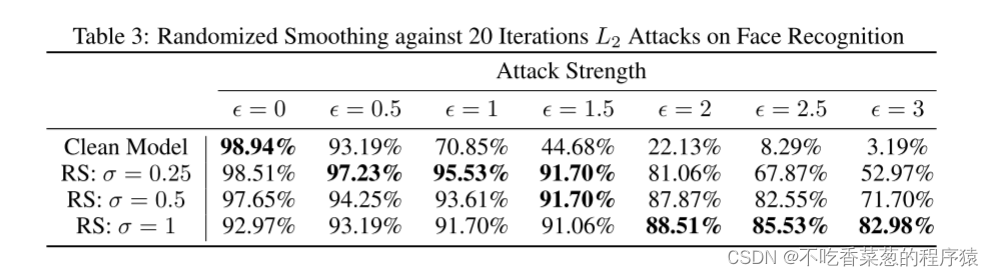

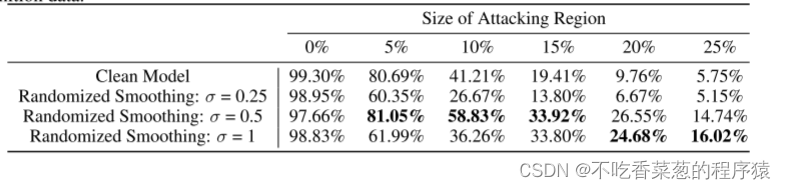

呈现了当面对l2攻击时,对面部识别数据使用随机平滑的结果。同样,我们观察到高水平的鲁棒性,并且在大多数情况下,性能下降相对有限,σ = 0.5可能达到最佳平衡。

算法:1。迭代矩形左上角点在图像中的可能位置。找到图像中最大化损失的灰色矩形(RGB值=[127.5,127.5,127.5])的位置。2.在步骤1中计算的位置处的矩形内生成高-λ l∞噪声。

尽管引入了可调步幅参数,但搜索罗阿的最佳位置仍然需要大量的损失函数评估,这在一定程度上是昂贵的(因为每个这样的评估意味着通过深度神经网络的完全前向传递),并且这些成本迅速增加。为了加快速度,我们考虑使用损失梯度的大小作为特定区域对操纵的敏感性的度量。具体地说,假设我们计算一个梯度,并让梯度Li是图像中特定像素i的梯度值。现在,我们可以遍历可能的罗阿位置,但对于每个位置,计算与矩形区域对应的位置处的损耗梯度。我们通过在矩形中的像素i上添加平方梯度值(μ Li)2来做到这一点。我们使用这种方法来找到矩形的前C个候选位置。最后,我们考虑这些,计算每个位置的实际损失,以找到罗阿的位置。完整算法作为算法2提供。

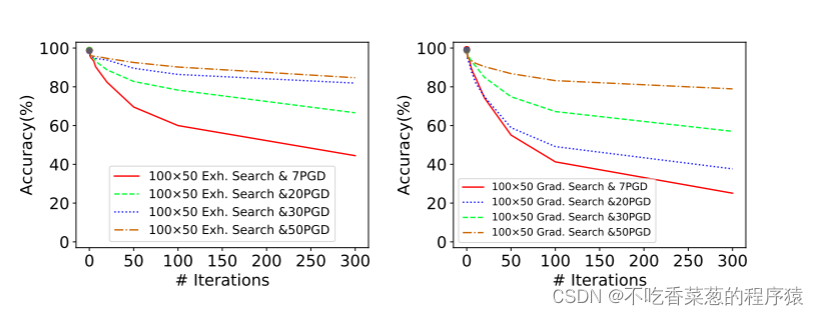

使用基于梯度的方法和100 × 50区域对抗矩形帧攻击的DOA的有效性,改变矩形内对抗性扰动的PGD迭代次数。左:使用穷举搜索。右:使用基于梯度的搜索。

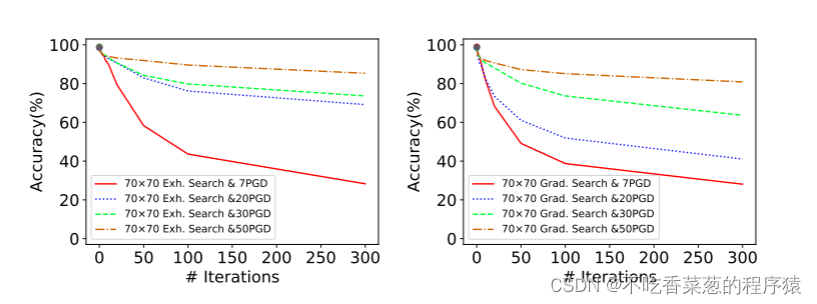

使用基于梯度的方法和70 × 70区域对抗矩形帧攻击的DOA有效性,改变矩形内对抗性扰动的PGD迭代次数。左:使用穷举搜索。右:使用基于梯度的搜索。

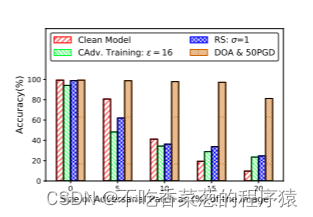

比较不同方法对抗人脸识别数据的补丁攻击的有效性。为每一个都做出了最佳参数选择。

对抗训练对抗人脸识别数据上的对抗补丁攻击的有效性

课程对抗训练对抗人脸识别数据对抗补丁攻击的有效性。

随机平滑对人脸识别数据对抗补丁攻击的有效性。

DOA(50次PGD迭代)对抗人脸识别数据上的对抗性补丁攻击的有效性。

380

380

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?