RT-DETR使用教程: RT-DETR使用教程

RT-DETR改进汇总贴:RT-DETR更新汇总贴

《Pinwheel-shaped Convolution and Scale-based Dynamic Loss for Infrared Small Target Detection》

一、 模块介绍

论文链接:https://arxiv.org/abs/2412.16986

代码链接:https://github.com/JN-Yang/PConv-SDloss-Data

论文速览:

近年来,基于卷积神经网络 (CNN) 的红外小目标检测方法取得了出色的性能。然而,这些方法通常采用标准卷积,而忽略了考虑红外小目标像素分布的空间特性。因此,我们提出了一种新的风车形卷积 (PConv) 来替代骨干网络下层的标准卷积。PConv 更好地与暗淡小目标的像素高斯空间分布对齐,增强了特征提取,显著增加了感受野,并且仅引入了最小的参数增加。此外,虽然最近的损失函数结合了尺度和位置损失,但它们没有充分考虑这些损失在不同目标尺度上的不同灵敏度,从而限制了对微小目标的检测性能。为了克服这个问题,我们提出了一种基于尺度的动态 (SD) 损失,它根据目标大小动态调整尺度和位置损失的影响,从而提高网络检测不同尺度目标的能力。

总结:本文演示文中的PConv的使用方法。

⭐⭐本文二创模块仅更新于付费群中,往期免费教程可看下方链接⭐⭐

二、二创融合模块

2.1 相关二创模块及所需参数

该模块无二创模块。

# _____________________________________ PConv2 ___________________________#

# Pinwheel-shaped Convolution and Scale-based Dynamic Loss for Infrared Small Target Detection

class PConv2(nn.Module):

''' Pinwheel-shaped Convolution using the Asymmetric Padding method. '''

def __init__(self, c1, c2, k=3, s=1):

super().__init__()

# self.k = k

p = [(k, 0, 1, 0), (0, k, 0, 1), (0, 1, k, 0), (1, 0, 0, k)]

self.pad = [nn.ZeroPad2d(padding=(p[g])) for g in range(4)]

self.cw = Conv(c1, c2 // 4, (1, k), s=s, p=0)

self.ch = Conv(c1, c2 // 4, (k, 1), s=s, p=0)

self.cat = Conv(c2, c2, 2, s=1, p=0)

def forward(self, x):

yw0 = self.cw(self.pad[0](x))

yw1 = self.cw(self.pad[1](x))

yh0 = self.ch(self.pad[2](x))

yh1 = self.ch(self.pad[3](x))

return self.cat(torch.cat([yw0, yw1, yh0, yh1], dim=1))2.2 更改yaml文件 (以自研模型加入为例)

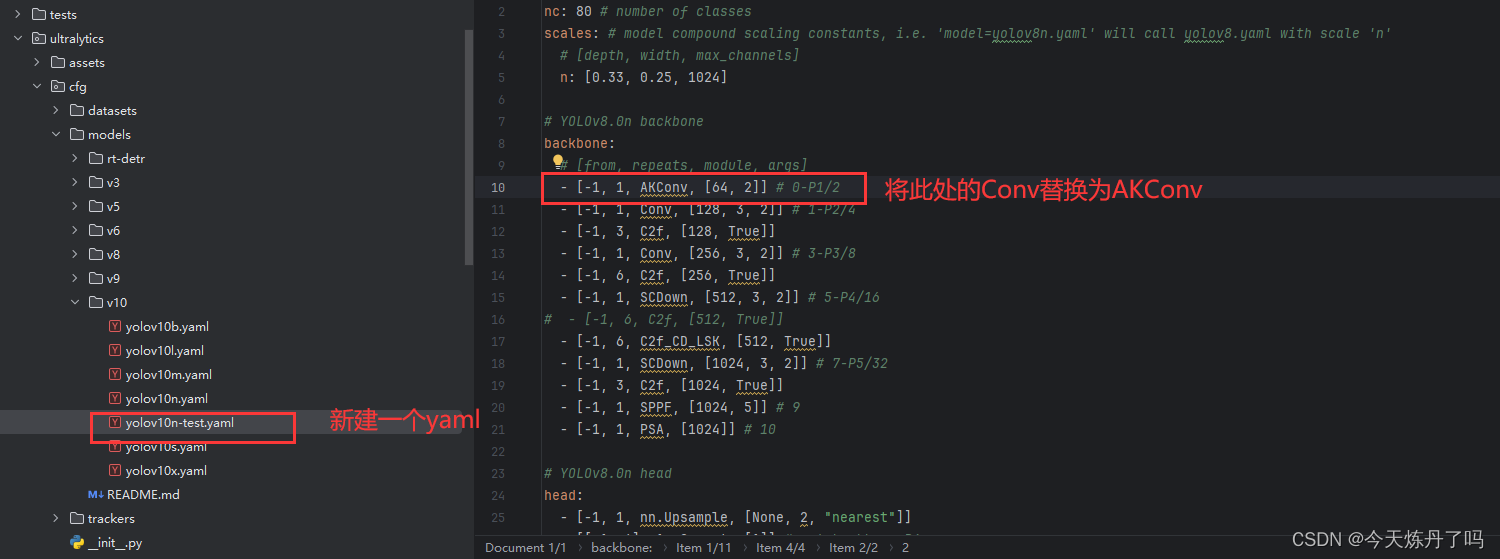

打开更改ultralytics/cfg/models/rt-detr路径下的rtdetr-l.yaml文件,替换原有模块。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# RT-DETR-l object detection model with P3-P5 outputs. For details see https://docs.ultralytics.com/models/rtdetr

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

# Parameters

nc: 80 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n-cls.yaml' will call yolov8-cls.yaml with scale 'n'

# [depth, width, max_channels]

l: [1.00, 1.00, 512]

# n: [ 0.33, 0.25, 1024 ]

# s: [ 0.33, 0.50, 1024 ]

# m: [ 0.67, 0.75, 768 ]

# l: [ 1.00, 1.00, 512 ]

# x: [ 1.00, 1.25, 512 ]

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

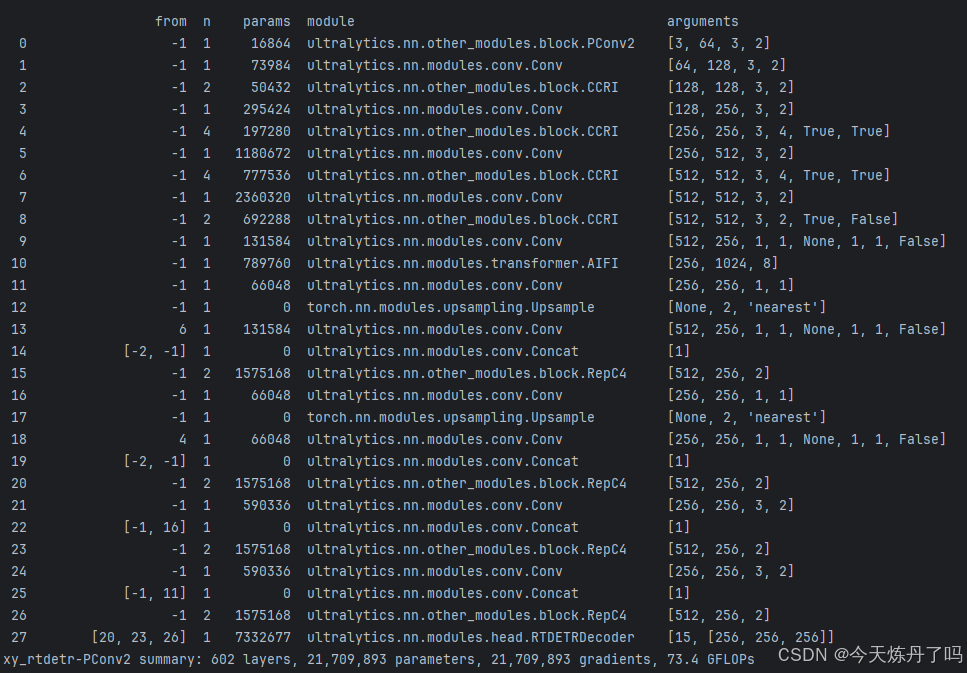

backbone:

# [from, repeats, module, args]

- [-1, 1, PConv2, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 2, CCRI, [128, 3]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 4, CCRI, [256, 3, True, True]]

- [-1, 1, Conv, [512, 3, 2]] # 5-P4/16

- [-1, 4, CCRI, [512, 3, True, True]]

- [-1, 1, Conv, [1024, 3, 2]] # 7-P5/32

- [-1, 2, CCRI, [1024, 3, True, False]]

head:

- [-1, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 9 input_proj.2

- [-1, 1, AIFI, [1024, 8]]

- [-1, 1, Conv, [256, 1, 1]] # 11, Y5, lateral_convs.0

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [6, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 13 input_proj.1

- [[-2, -1], 1, Concat, [1]]

- [-1, 2, RepC4, [256]] # 15, fpn_blocks.0

- [-1, 1, Conv, [256, 1, 1]] # 16, Y4, lateral_convs.1

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [4, 1, Conv, [256, 1, 1, None, 1, 1, False]] # 18 input_proj.0

- [[-2, -1], 1, Concat, [1]] # cat backbone P4

- [-1, 2, RepC4, [256]] # X3 (20), fpn_blocks.1

- [-1, 1, Conv, [256, 3, 2]] # 22, downsample_convs.0

- [[-1, 16], 1, Concat, [1]] # cat Y4

- [-1, 2, RepC4, [256]] # F4 (23), pan_blocks.0

- [-1, 1, Conv, [256, 3, 2]] # 24, downsample_convs.1

- [[-1, 11], 1, Concat, [1]] # cat Y5

- [-1, 2, RepC4, [256]] # F5 (26), pan_blocks.1

- [[20, 23, 26], 1, RTDETRDecoder, [nc]] # Detect(P3, P4, P5)

# ⭐⭐Powered by https://blog.csdn.net/StopAndGoyyy, 技术指导QQ:2668825911⭐⭐

2.2 修改train.py文件

创建Train_RT脚本用于训练。

from ultralytics.models import RTDETR

import os

os.environ['KMP_DUPLICATE_LIB_OK'] = 'True'

if __name__ == '__main__':

model = RTDETR(model='ultralytics/cfg/models/rt-detr/rtdetr-l.yaml')

# model.load('yolov8n.pt')

model.train(data='./data.yaml', epochs=2, batch=1, device='0', imgsz=640, workers=2, cache=False,

amp=True, mosaic=False, project='runs/train', name='exp')

在train.py脚本中填入修改好的yaml路径,运行即可训。

8489

8489

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?