概述:Ollama

基本介绍: Ollama

Ollama是一个支持在Windows、Linux和MacOS上本地运行大语言模型的工具。

它允许用户非常方便地运行和使用各种大语言模型,比如Qwen模型等。

用户只需一行命令就可以启动大语言模型。

主要特点

- 跨平台支持Windows、Linux、MacOS系统。

- 提供了丰富的模型库,包括Qwen、Llama等1700+大语言模型,可以在官网model library中直接下载使用。

- 支持用户上传自己的模型。

用户可以将huggingface等地方的ggml格式模型导入到ollama中使用。

也可以将基于pytorch等格式的模型转换为ggml格式后导入。

- 允许用户通过编写modelfile配置文件来自定义模型的推理参数,如temperature、top_p等,从而调节模型生成效果。

- 支持多GPU并行推理加速。

在多卡环境下,可以设置环境变量来指定特定GPU。

- 强大的技术团队支持,很多模型开源不到24小时就能获得支持。

总的来说,Ollama降低了普通开发者使用大语言模型的门槛,使得本地部署体验大模型变得简单易行。

对于想要搭建自己的AI应用,或者针对特定任务调优模型的开发者来说,是一个非常有用的工具。

它的一些特性,如允许用户自定义模型参数,对模型进行个性化适配提供了支持。

安装/部署篇

安装 on Windows

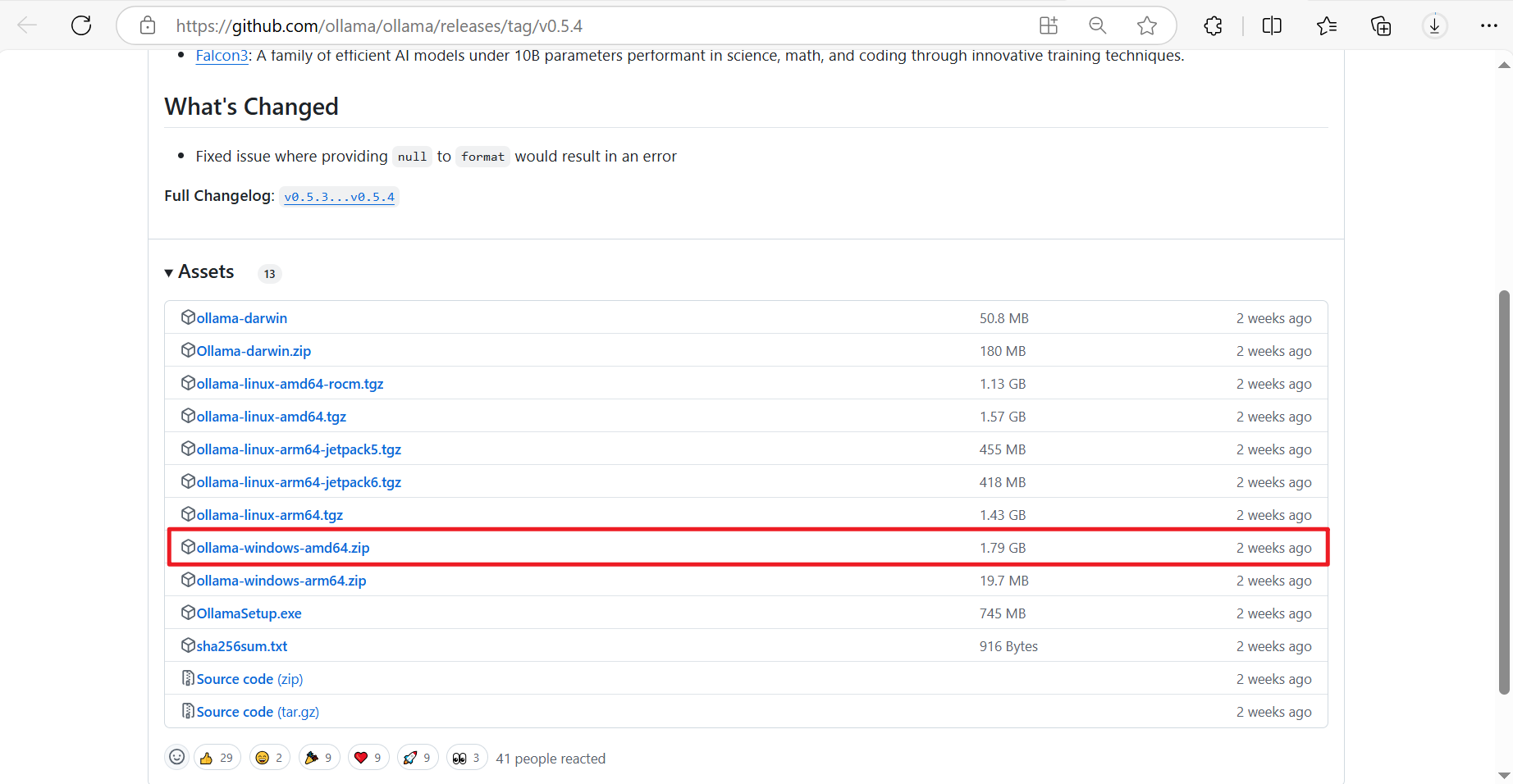

Step1 下载安装包

- download url

curl -o %USERPROFILE%\Desktop https://github.com/ollama/ollama/releases/download/v0.5.4/ollama-windows-amd64.zip -v

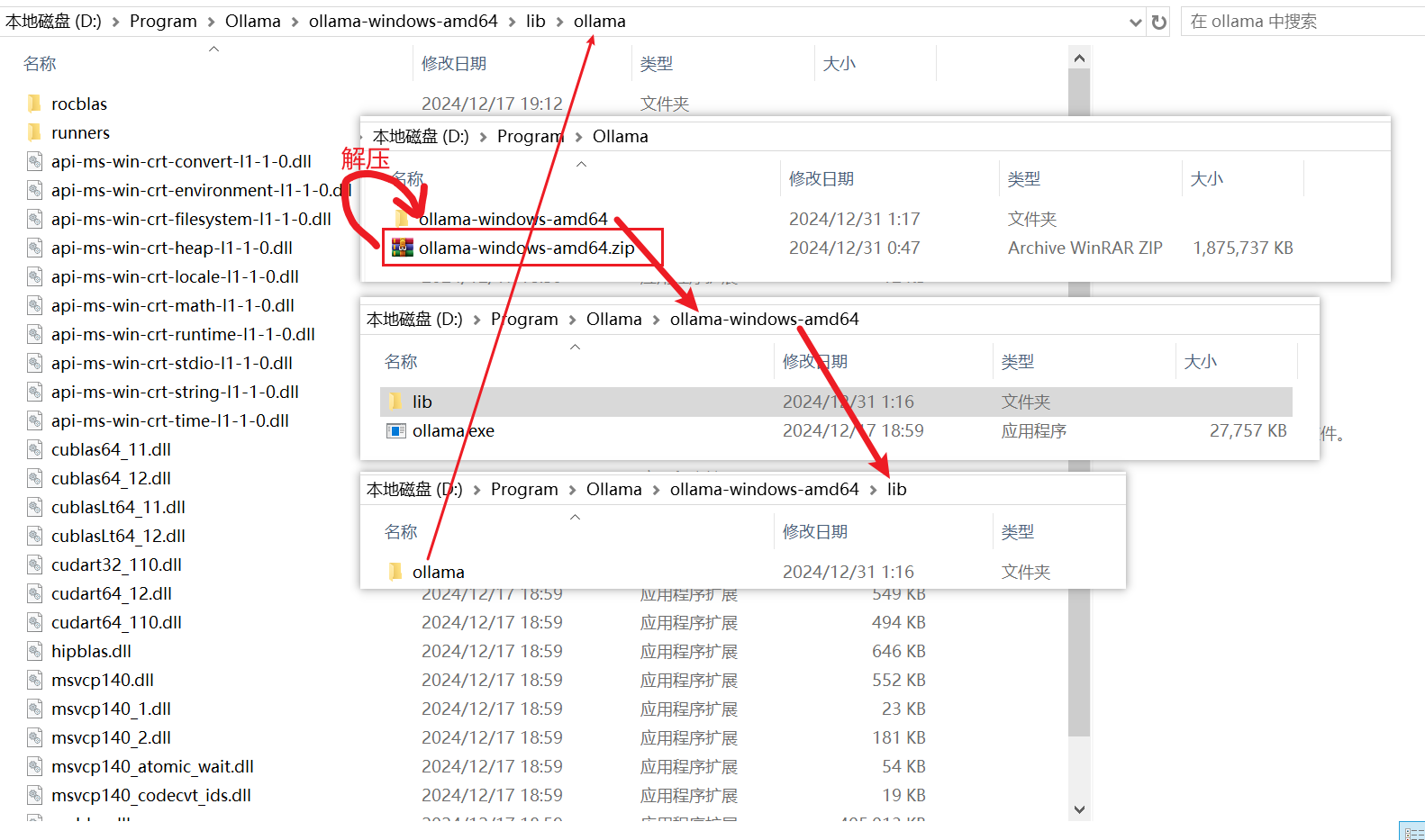

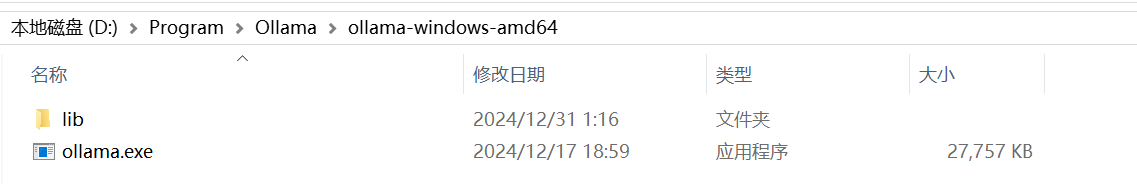

Step2 安装 Ollama

- 解压即安装

D:\Program\Ollama\ollama-windows-amd64

D:\Program\Ollama\ollama-windows-amd64\ollama.exe

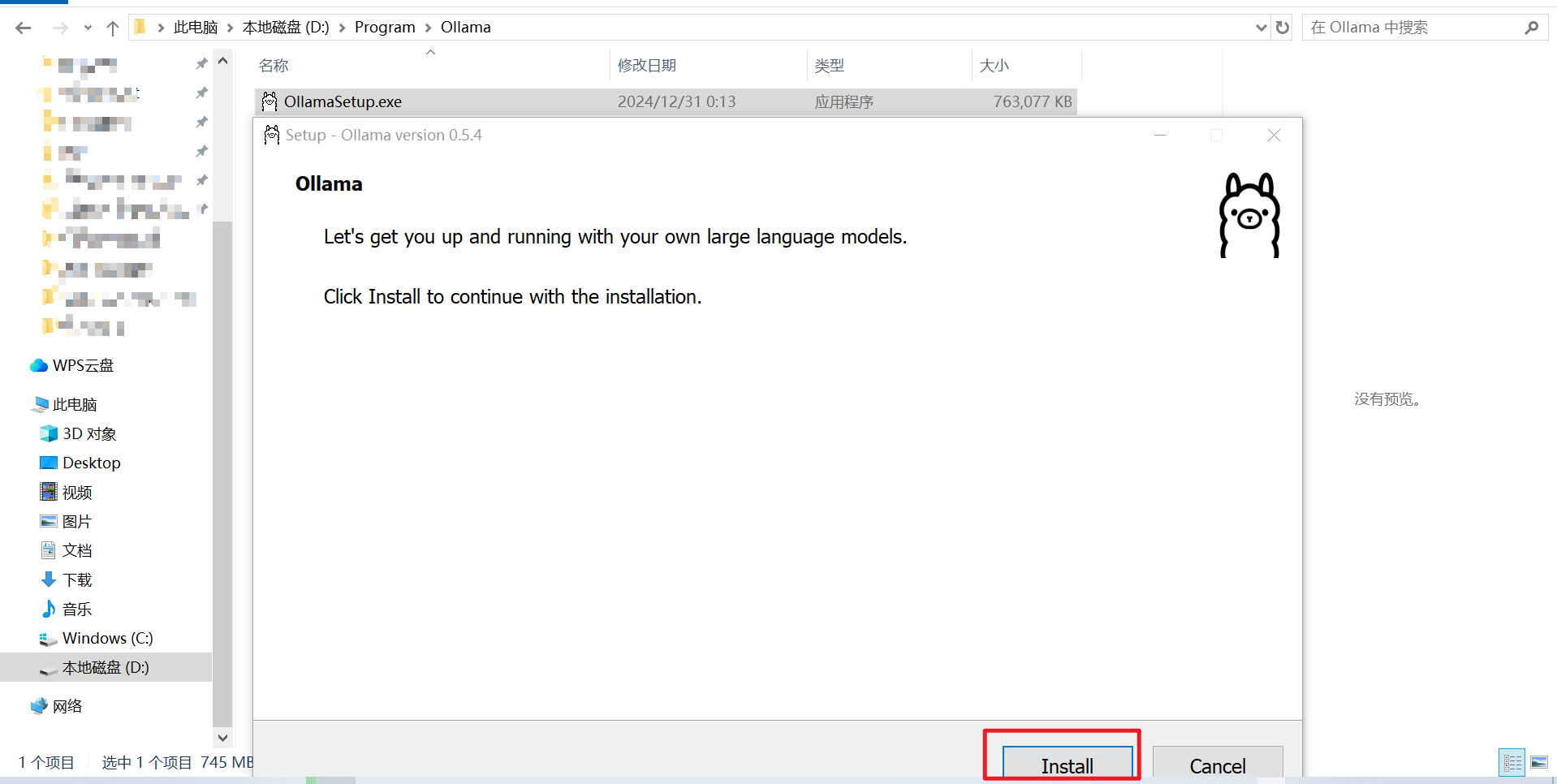

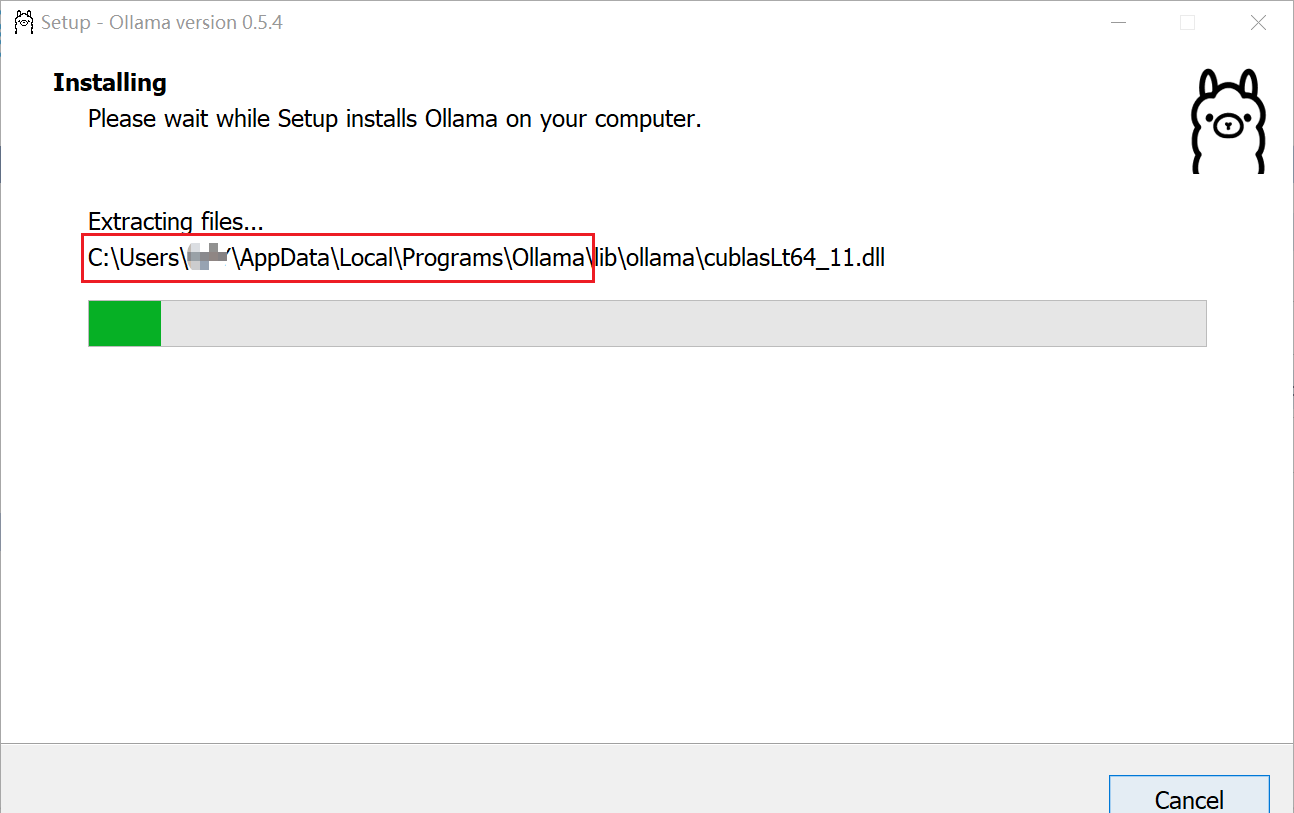

- 补充:OllamaSetup.exe 安装包的安装 【不推荐】

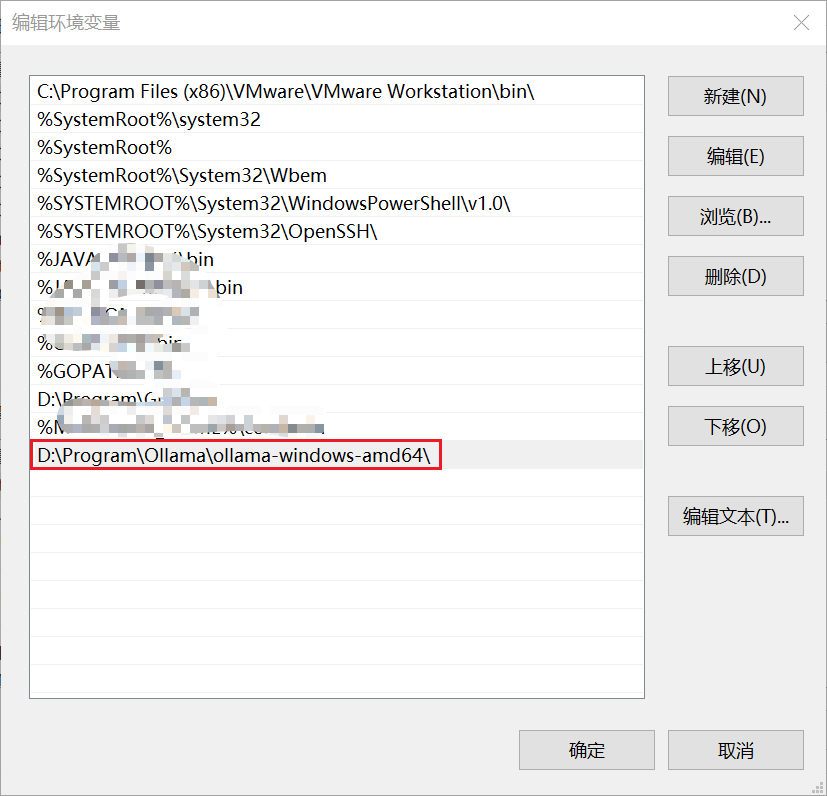

- 添加

ollama.exe到环境变量Path中

便于可以通过 cmd :

ollama快捷启动

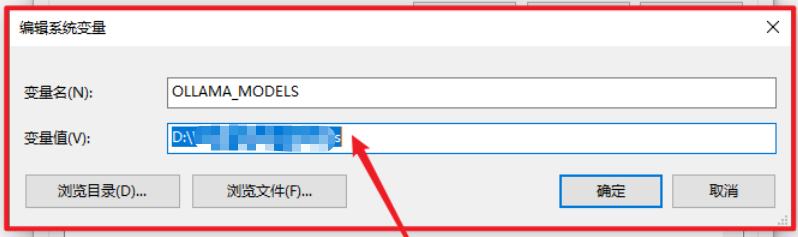

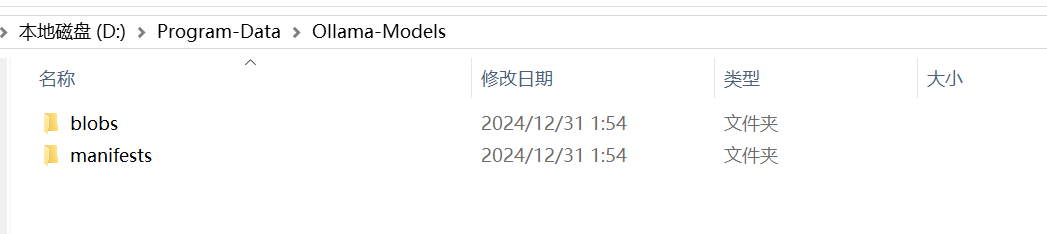

- 配置OLLAMA的模型目录到环境变量(必须)

Ollama的默认模型存储路径一般在:C:\Users\%username%.ollama\models

无论 C 盘空间大小,需要安装多少模型,都建议换一个存放路径到其它盘,否则会影响电脑运行速度。

- 打开「系统环境变量」,新建一个系统变量

OLLAMA_MODELS,然后设置ollama模型的存储路径。- 变量名:

OLLAMA_MODELS- 变量值(路径):

D:\Program-Data\Ollama-Models

- 配置Ollama的运行端口(可选):

Ollama API的默认访问地址和侦听端口: http://localhost:11434- 只能在装有 Ollama 的系统中直接调用。

- 如果要在网络中提供服务,请修改 API 的侦听地址和端口(在系统环境变量里设置):

- 变量名:

OLLAMA_HOST(要监听的地址)- 变量值(端口):

:8000或0.0.0.0等- 只填写端口号可以同时侦听(所有) IPv4 和 IPv6 的

:8000端口。(变量值的端口前号前有个冒号:)

注:要使用 IPv6,需要

Ollama 0.0.20或更高版本。

另外,可能需要在 Windows 防火墙中开放相应端口的远程访问。

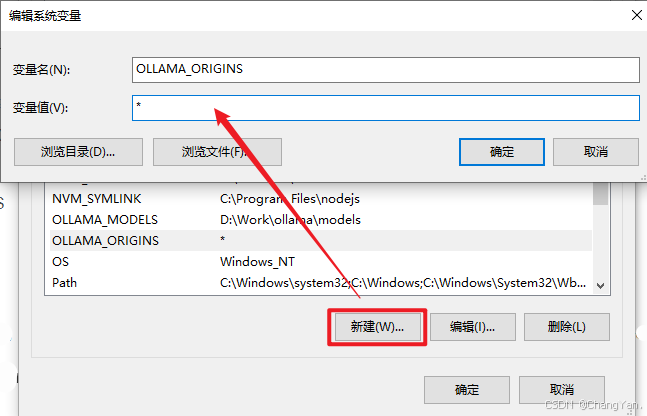

- 允许浏览器跨域请求(可选):

Ollama默认只允许来自127.0.0.1和0.0.0.0的跨域请求

如果你计划在其它前端面板中调用Ollama API,比如Open WebUI,建议放开跨域限制:

- 变量名:

OLLAMA_ORIGINS- 变量值:

*

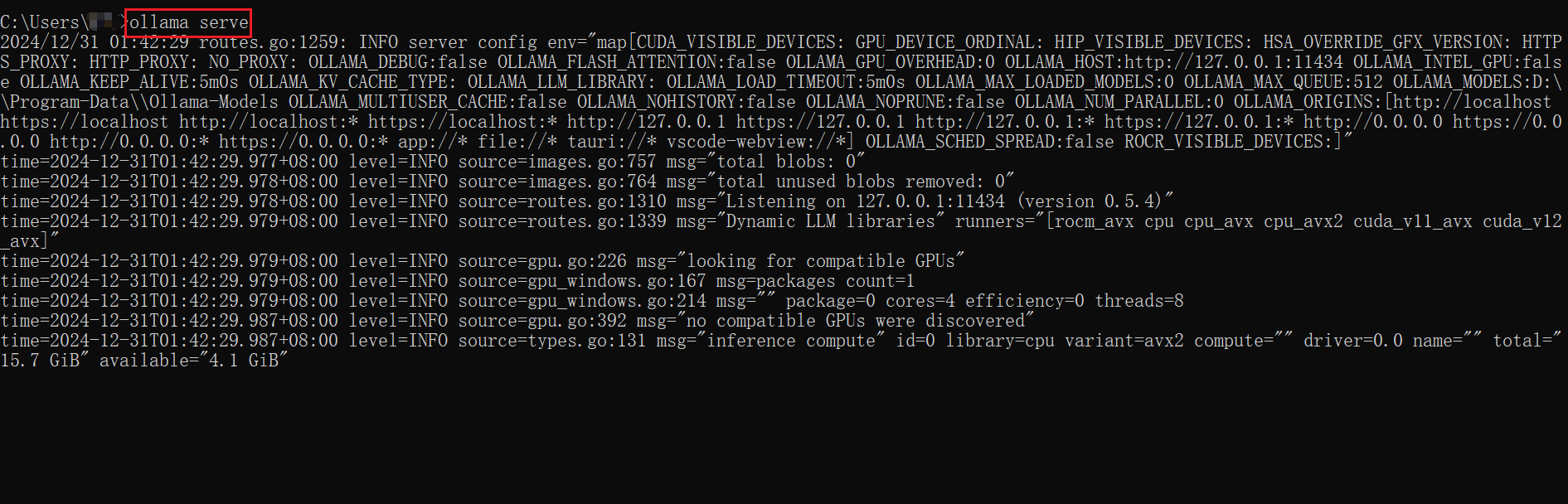

Step3 启动 Ollama 服务

- 基于

CMDorGit Bash启动 Ollama

ollama serve

这个命令也会启动Ollama服务,适用于没有配置systemd的情况

如果是 centos ,则可以使用此方式启动:sudo systemctl start ollama

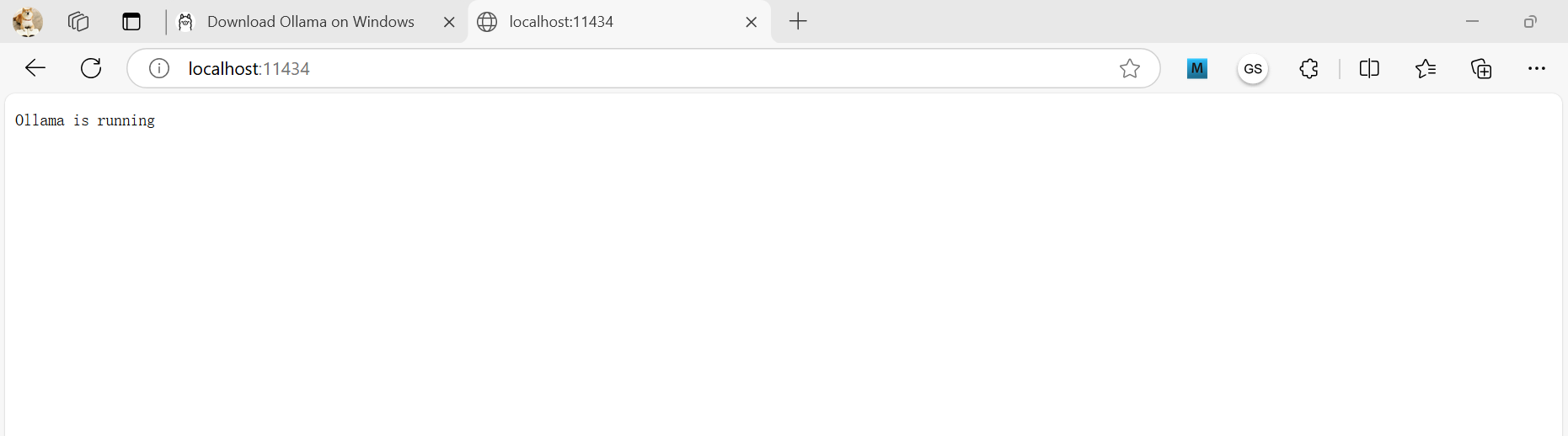

若前面没有修改监听端口时,可直接访问: http://localhost:11434 ,可查看其运行状态

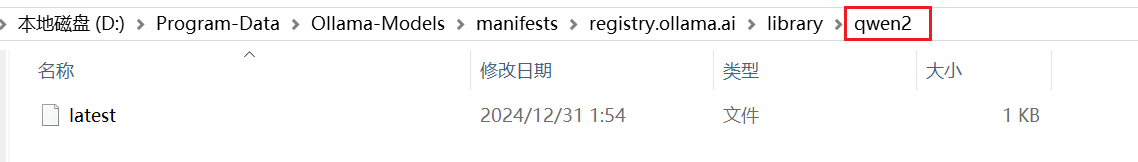

Step4 下载模型

- 下载LLM模型

# ollama pull qwen

ollama pull qwen2

Y Ollama 常用命令

帮助手册

C:\Users\XXX> ollama

Usage:

ollama [flags]

ollama [command]

Available Commands:

serve Start ollama

create Create a model from a Modelfile

show Show information for a model

run Run a model

stop Stop a running model

pull Pull a model from a registry

push Push a model to a registry

list List models

ps List running models

cp Copy a model

rm Remove a model

help Help about any command

Flags:

-h, --help help for ollama

-v, --version Show version information

Use "ollama [command] --help" for more information about a command.

常用命令

和

docker命令非常类似

启动ollama服务

ollama serve

从注册仓库中拉取模型

ollama pull {modelName}[:{tag}]

如:

ollama pull qwen

ollama pull qwen2:7b

ollama pull llama3:70b

如:

C:\Users\xxx> ollama pull qwen2

pulling manifest

pulling 43f7a214e532... 100% ▕█████████████████████████████████████████████████████████████████████████████████████████████▏ 4.4 GB

pulling 77c91b422cc9... 100% ▕█████████████████████████████████████████████████████████████████████████████████████████████▏ 1.4 KB

pulling c156170b718e... 100% ▕█████████████████████████████████████████████████████████████████████████████████████████████▏ 11 KB

pulling f02dd72bb242... 100% ▕█████████████████████████████████████████████████████████████████████████████████████████████▏ 59 B

pulling 75357d685f23... 100% ▕█████████████████████████████████████████████████████████████████████████████████████████████▏ 28 B

pulling 648f809ced2b... 100% ▕█████████████████████████████████████████████████████████████████████████████████████████████▏ 485 B

verifying sha256 digest

writing manifest

success

C:\Users\xxx> ollama list

NAME ID SIZE MODIFIED

qwen2:latest dd314f039b9d 4.4 GB About a minute ago

列出已下载模型

ollama list

C:\Users\xxx> ollama list

NAME ID SIZE MODIFIED

qwen2:latest dd314f039b9d 4.4 GB About a minute ago

列出正在运行的模型

C:\Users\xxx>ollama ps

NAME ID SIZE PROCESSOR UNTIL

qwen2:latest dd314f039b9d 5.5 GB 100% CPU 3 minutes from now

从模型文件创建模型

ollama create

显示模型信息

ollama show

如:

C:\Users\xxx>ollama show qwen2:latest

Model

architecture qwen2

parameters 7.6B

context length 32768

embedding length 3584

quantization Q4_0

Parameters

stop "<|im_start|>"

stop "<|im_end|>"

System

You are a helpful assistant.

License

Apache License

Version 2.0, January 2004

运行模型 : 实际运行前,会先自动下载模型

ollama run {modelName}[:{tag}]

如:

C:\Users\xxx> ollama list

NAME ID SIZE MODIFIED

qwen2:latest dd314f039b9d 4.4 GB About a minute ago

C:\Users\xxx> ollama run qwen2:latest

>>>

>>>

>>> hello

Hello! How can I assist you today?

>>>

>>>

Use Ctrl + d or /bye to exit.

>>> /?

Available Commands:

/set Set session variables

/show Show model information

/load <model> Load a session or model

/save <model> Save your current session

/clear Clear session context

/bye Exit

/?, /help Help for a command

/? shortcuts Help for keyboard shortcuts

Use """ to begin a multi-line message.

>>> /bye

C:\Users\xxx>

将模型推送到注册仓库

ollama push

复制模型

ollama cp

删除模型

ollama rm

K Ollama 模型库

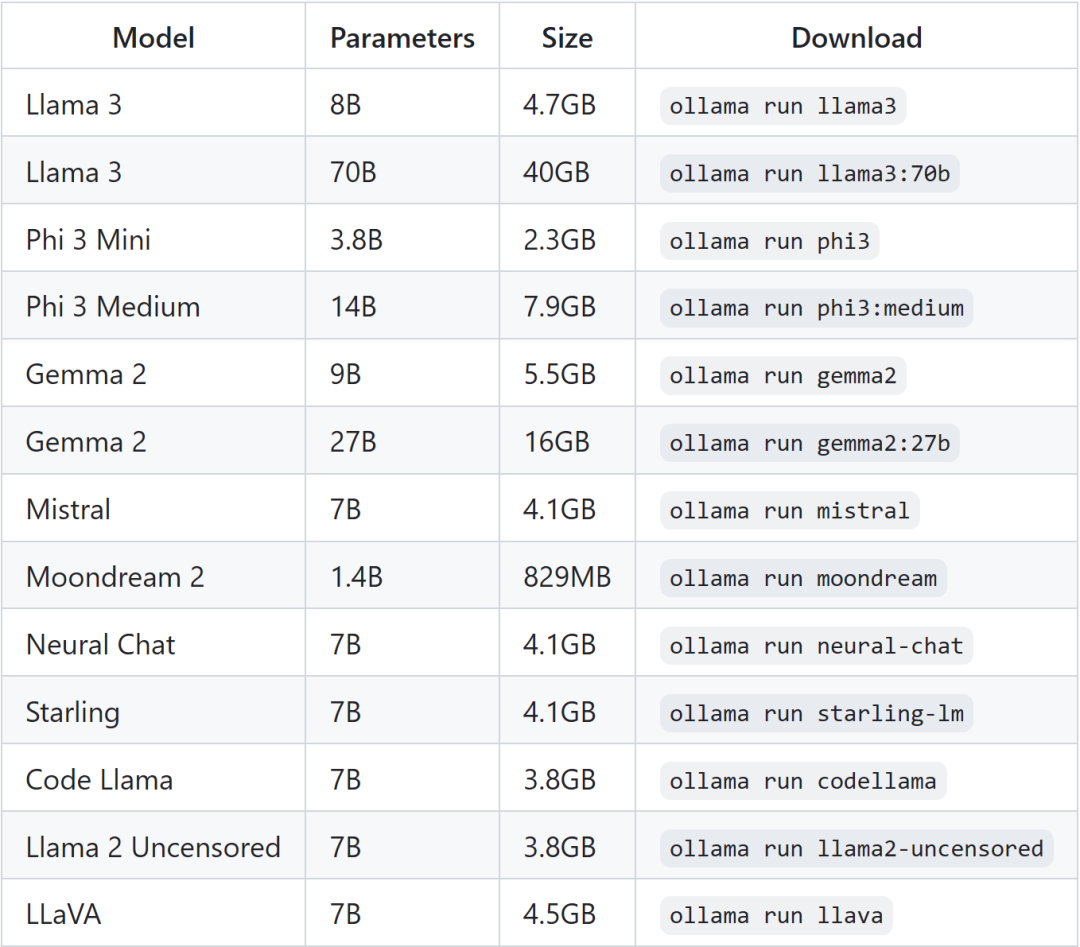

类似 Docker 托管镜像的 Docker Hub,Ollama 也有个 Library 托管支持的大模型。

从0.5B 到 236B,各种模型应有尽有,大家可以根据自己的机器配置,选用合适的模型。

同时,官方也贴心地给出了不同 RAM 推荐的模型大小,以及命令:

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

2789

2789

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?