前言

信息时代到来,企业积累的数字文档知识数量巨大,文档中蕴含的信息对业务发展至关重要,与企业相关的数据价值难以估量。企业利用好现有资源,将企业资源合理配置,将数据串联,产生更大的效益,这才是企业最需要的。然而,传统的搜索技术常常因只能进行关键字查询而无法满足对文档深层次理解的需求。因此需要建立一个面向企业级知识管理的智能问答,对知识进行统一管理,通过精准的信息检索加上严格的权限控制,帮助企业内部员工挖掘企业多年沉淀下来的知识,提升工作效率,增强企业竞争力。

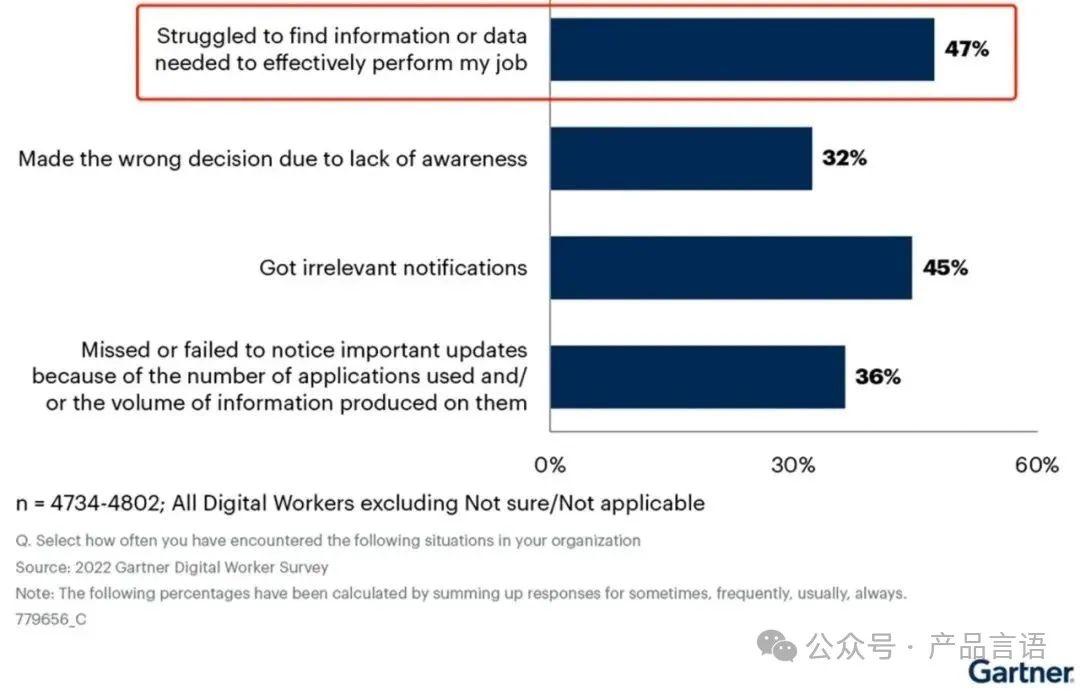

据Gartner调查,高达47%的员工在工作中很难寻找到有效工作文档信息和数据时遇,这一比例在大型组织中这一问题更为突出只会更高。揭示了企业内部知识管理的普遍问题:如何在海量文档中迅速找到确切所需文档和数据?如何从复杂信息中提取关键内容?

为了解决工作中的信息检索问题,企业通常会使用基于ES或采购搜索软件来进行知识搜索,但是常规的搜索对内容格式优先以及不支持语义搜搜和缺少上下文信息,因此导致结果不够精准。

现在**LLM(大型语言模型Large Language Model)**在自然语言处理方面取得了显著进展,具备了语义理解、信息提取和逻辑推理等多项能力。LLM通过与用户进行对话问答的交互方式,LLM能够更准确地理解用户的需求,提高搜索相关文档的效率和准确性。

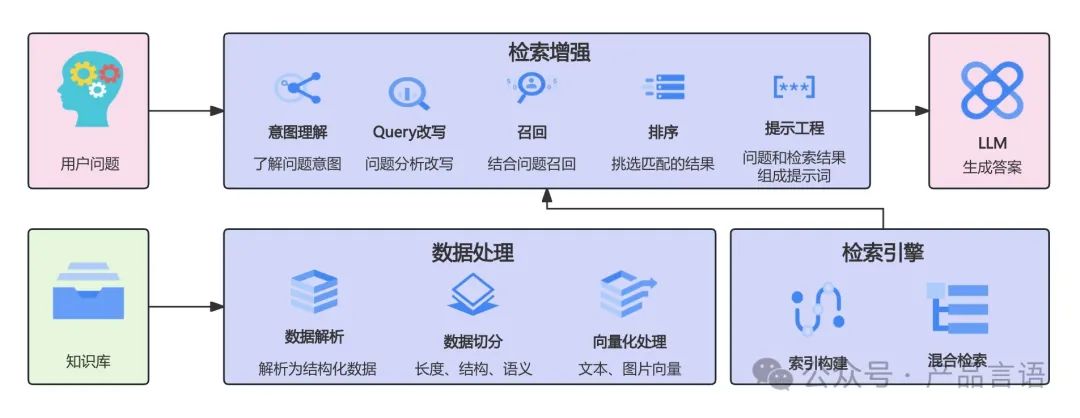

尽管通用LLM在知识问答方面取得了非常大的进展,由于大模型的特性,大模型对于企业专业领域的知识问答依然无能为力,因为企业内部领域的数据不会对外公开,通用LLM没有学习过,自然不会回答。目前行业有两种方案,一种是将企业内部数据喂给通用LLM进行微调,但是技术难度和成本较高;另外一种方案是使用**RAG****(Retrieval Augmented Generation,索引增强生成)**方案进行解决专业领域的问答,将用户问题和检索到的相关企业内部知识作为提示词一起给到通用的LLM,由通用的LLM进行理解、分析和总结,给出答案。针对这类问题,业界主流的方案是采用 **RAG****方案。**通过RAG的方式为LLM提供更加精准的信息,从而提升最终回答效果,如下图所示:

01

—

RAG的产品形态

随着RAG技术的发展和演变,RAG产生了Naive RAG、Advanced RAG、Modular RAG。

Naive RAG

初级RAG主要包含以下几个流程:

建立索引: 数据清洗并分块,将分块后的知识通过Embedding模型产出语义向量并建立索引;

检索: 通过用户query使用相同的Embedding模型,检索上下文;

生成: 将给定问题和相关文档合并为新的提示,由LLM基于提供的信息回答问题。

Advanced RAG

高级RAG相比初级RAG,基于初级RAG的流程,围绕着知识检索做优化,对检索前、检索中、检索后进行策略优化,解决索引、检索和生成问题。

检索前优化: 知识切分、索引方式和query改写优化等;

检索优化: 微调Embedding模型召回最相关知识、使用混合搜索等;

检索后优化: 提示压缩、重新排序;

Modular RAG

模块化RAG将RAG具体功能模块化,流程上可以对RAG模块之间进行设计和编排,方便业务进行使用。

02、RAG产品建设路径

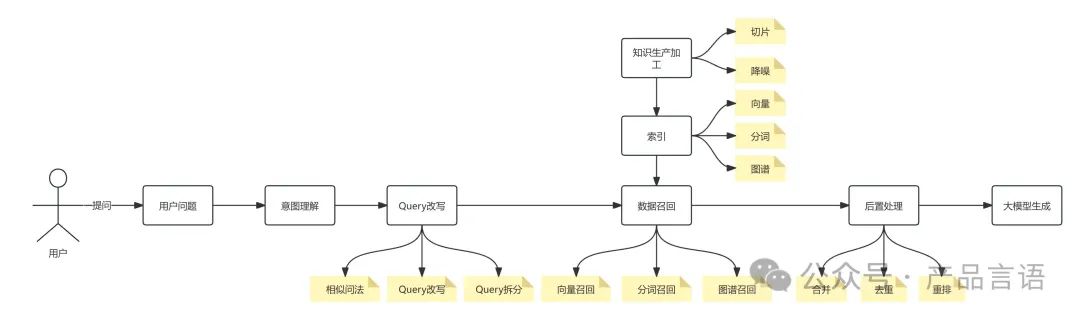

RAG整理业务链路划分为5个步骤:知识生产加工、query改写、数据召回、后置处理以及大模型生产;

第一阶段:可运行

第一阶段保障系统可用:

-

知识生产与加工:

-

支持问答对类型;

-

支持长文本类型:先按照固定字符切分,预留冗余字段保证语义不被截断;

-

query改写: 结合上下文,使用大模型理解能力,更好回答用户问题;

-

数据召回: 实现向量召回,找到契合的embedding模型和向量数据库。

-

数据后置处理: 设置符合业务预期的阈值筛选数据,主要是文本匹配度和召回数;

第二阶段:提效果

第二阶段主要目标:提升RAG检索效果

-

知识生产与加工:

-

按照语义进行切分,将上下文联系紧密的句子切分成一个片段;

-

根据数据索引情况,分析索引噪音,制定降噪策略;

-

query改写:

-

根据用户query生成多相似query检索数据;

-

多任务query抽取,将用户的query拆解为多个任务query;

-

数据召回:

-

根据业务场景探索向量、分词、图谱召回的能力;

-

数据后置处理:

-

数据去重合并;

-

多路召回结果重排能力;

第三阶段:高扩展

第三阶段主要目标:提升可扩展性,各个功能做模块化设计

-

功能模块化建设:

-

建设通用模块能力,方便业务接入组合不同的RAG检索系统,满足业务效果。

-

回答能力建设:

-

问答的调试预览;

-

回答过程白盒化;

-

基于问题和回答的问题推荐;

RAG通过检索现有大量知识结合强大的生成模型,为复杂的问答带来全新的解决方案,而在产品建设过程中遇到诸多挑战:

-

数据质量差导致检索效果差: 检索阶段的输出影响生成阶段的输入和最终的输出质量。RAG数据库中存在大量的错误信息并检索到,可能导致模型生成的错误,即使在检索阶段做大量工作, 可能对结果的影响也微乎其微。

-

数据向量化的信息缺失: 数据向量化缺失可能会导致一定程度的信息损失,文本数据的复杂性和多样性很难用有限的向量来完全表达,导致向量化后可能会缺失一些文本数据的细节和特征,从而影响文档检索的准确率。

-

语义搜索的不准确: 语义检索利用向量空间中的距离和相似度来进行检索,准确率无法100%保障。

03、结语

RAG问答系统搭建做出来比较容易,但想做好比较难的,流程中的每一个步骤都有可能对最终效果产生影响。在RAG中需要做大量的探索如不同文档的切分方式、query改写策略、数据如何找回等等。面向企业的知识更有很多难点需要解决,企业中有不同的部门,同一个部门有不同的角色,对应的知识的权限不同,以及还涉及到外部合作伙伴的权限,在不同的权限交互下,处理起来非常复杂。因此做好一个企业内部的RAG智能问答任重而道远。

最后的最后

感谢你们的阅读和喜欢,我收藏了很多技术干货,可以共享给喜欢我文章的朋友们,如果你肯花时间沉下心去学习,它们一定能帮到你。

因为这个行业不同于其他行业,知识体系实在是过于庞大,知识更新也非常快。作为一个普通人,无法全部学完,所以我们在提升技术的时候,首先需要明确一个目标,然后制定好完整的计划,同时找到好的学习方法,这样才能更快的提升自己。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

120

120

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?