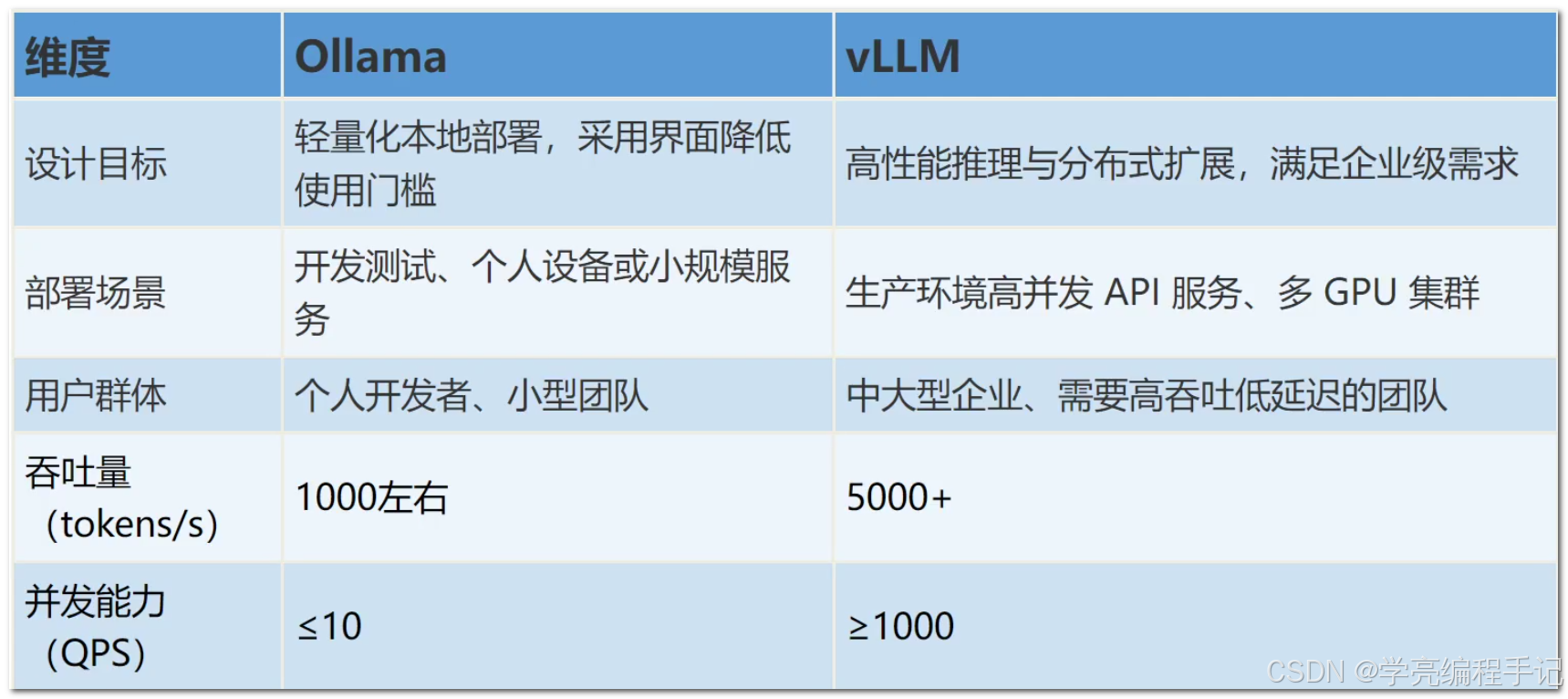

以下是 Ollama 和 vLLM 的核心对比总结,基于上图内容提炼:

核心定位差异

| 工具 | 设计目标 | 适用场景 | 用户群体 |

|---|---|---|---|

| Ollama | 轻量本地化部署,降低使用门槛 | 开发测试、个人设备/小规模服务 | 个人开发者、小团队 |

| vLLM | 高性能推理与分布式扩展 | 高并发API服务、多GPU集群 | 中大型企业团队 |

性能对比

| 指标 | Ollama | vLLM |

|---|---|---|

| 吞吐量(tokens/s) | ≈1000 | ≥5000 |

| 并发能力(QPS) | ≤10 | ≥1000 |

选择建议

- Ollama:适合本地快速验证模型、个人学习或轻量级场景,优势是低配置启动(如单机CPU/低显存GPU)。

- vLLM:适合企业级高并发需求(如在线服务、大规模推理),依赖多GPU集群和分布式架构优化性能。

一句话总结

Ollama是“小而美”的本地化工具,vLLM是“大而强”的生产级方案。

1720

1720

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?