在YOLOv4中,CBM和CBL是构成其网络结构的基本组件,它们各自承担着不同的角色和功能。

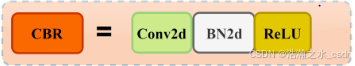

一、CBR模块

YOLO系列模型中的CBR模块,虽然在YOLOv6的官方文档或常见实现中不直接以“CBR”这一名称出现,但我们可以理解为它代表了一种常见的卷积模块结构,即卷积层(Convolutional Layer,Conv)-> 批归一化层(Batch Normalization Layer,BN)-> 激活函数层(ReLU或其他激活函数)。这种模块结构在YOLO系列的多个版本中都有所应用,并在特征提取和模型训练过程中发挥着重要作用。

CBR模块组成

-

卷积层(Conv):负责从输入

订阅专栏 解锁全文

订阅专栏 解锁全文

107

107

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?