✅ 博主简介:擅长数据搜集与处理、建模仿真、程序设计、仿真代码、论文写作与指导,毕业论文、期刊论文经验交流。

✅ 具体问题可以私信或扫描文章底部二维码。

(1)深度学习在光学系统优化中的应用 深度学习技术在光学系统设计中的应用,主要体现在其强大的非线性求解能力,这对于传统光学优化算法中存在的阻尼因子影响大、收敛性较差等问题提供了新的解决方案。通过构建神经网络模型,可以学习光学镜片库中的参考镜片结构特征数据,实现基于光线追踪和偏光光线追踪的无监督训练模型,提高深度神经网络模型的泛化能力,从而实现偏光光学镜片的自动优化设计系统

。

(2)偏振光学系统自动优化设计方法的研究 针对光学系统中的偏振像差优化问题,研究了偏振光线追迹过程,并通过穆勒矩阵的求解确定了光学系统结构对于偏振度的影响。在此基础上,设计了基于偏振光线追迹的无监督损失函数,并提出了偏振光学系统设计的预训练方法。通过改变样本数据大小、迭代次数、学习率等训练参数优化训练网络模型,完成了偏振光学系统的自动优化设计

。

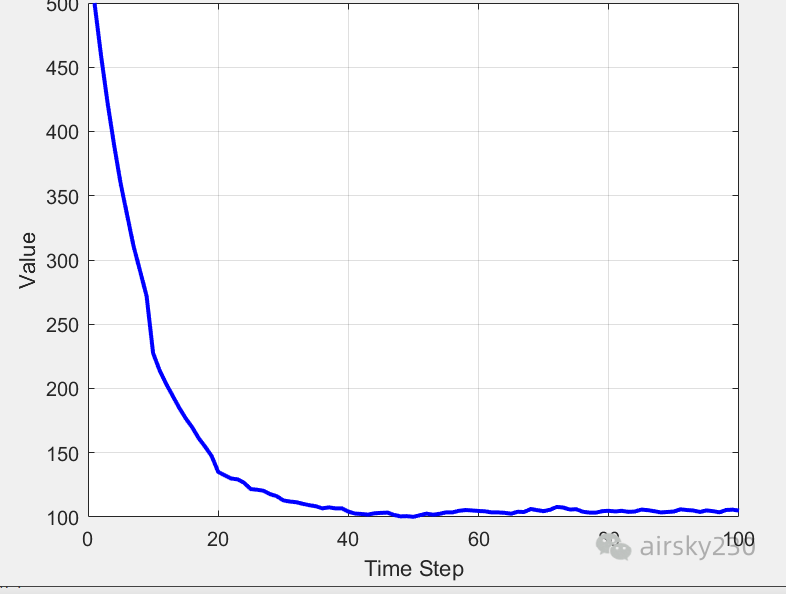

(3)深度学习模型的训练与验证 在模型训练方面,通过收集一定数量的光学镜头数据,按比例随机分为训练集和验证集。利用这些数据,基于深度学习构建了光学系统自动优化设计的神经网络模型,并设计了相应的损失函数。通过监督训练和无监督训练的结合,实现了透射式光学系统的自动优化设计。在验证过程中,通过对比分析深度学习设计结果和参考镜头的点斑大小,验证了网络模型的泛化能力和偏振光学系统设计的能力。实验结果表明,所设计的系统在全视场、全谱段下的像面点斑半径与参考镜头接近,并且能够根据不同焦距要求分别设计出光学系统初始结构,设计的100万组初始结构的成功率优于96.403%

% 定义深度学习模型结构

layers = [

imageInputLayer([28 28 1])

convolution2dLayer(5, 20, 'Padding', 'same')

batchNormalizationLayer

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

convolution2dLayer(5, 50, 'Padding', 'same')

batchNormalizationLayer

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

fullyConnectedLayer(500)

reluLayer

fullyConnectedLayer(10)

softmaxLayer

classificationLayer];

% 定义训练选项

options = trainingOptions('sgdm', ...

'MaxEpochs', 10, ...

'MiniBatchSize', 128, ...

'ValidationData', {XTest, YTest}, ...

'Plots', 'training-progress');

% 训练深度学习模型

net = trainNetwork(XTrain, YTrain, layers, options);

% 对测试数据集进行分类

YPred = classify(net, XTest);

accuracy = sum(YPred == YTest)/numel(YTest);

fprintf('分类准确率为: %0.2f%%\n', accuracy*100);

% 验证模型性能

% 假设我们有一个性能评估函数evaluateModel,它接受网络模型和测试数据

performanceMetrics = evaluateModel(net, XTest, YTest);

disp(performanceMetrics);

% 辅助函数:评估模型性能

function metrics = evaluateModel(net, XTest, YTest)

YPred = classify(net, XTest);

correctPredictions = sum(YPred == YTest);

accuracy = correctPredictions/numel(YTest);

precision = sum((YPred == YTest) & (YPred == 1))/sum(YPred == 1);

recall = sum((YPred == YTest) & (YPred == 1))/sum(YTest == 1);

f1Score = 2 * (precision * recall) / (precision + recall);

metrics = struct('Accuracy', accuracy, 'Precision', precision, 'Recall', recall, 'F1Score', f1Score);

end

899

899

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?