✅ 博主简介:擅长数据搜集与处理、建模仿真、程序设计、仿真代码、论文写作与指导,毕业论文、期刊论文经验交流。

✅ 具体问题可以私信或扫描文章底部二维码。

(1) 驾驶员情绪的机理及研究框架构建

驾驶员的情绪在驾驶过程中发挥着重要的作用,其影响着驾驶员的注意力、反应时间和决策能力。为了深入探讨驾驶员情绪的产生机制以及其对驾驶行为的作用机制,本文对驾驶员情绪的基本理论、情绪诱导机制和调节过程进行了系统的总结。

首先,情绪的发展是一个复杂的过程,受生理、心理、社会等多重因素的影响。情绪的产生可分为情绪诱发、情绪体验、情绪表达三个过程,这些过程共同作用决定了驾驶员在驾驶中的情绪状态。在驾驶情境中,情绪可能通过认知过程改变驾驶员对道路信息的处理方式,进而影响决策与行为。驾驶员的情绪可通过多模态信号,如面部表情、生理信号(如心率变化)、行为数据(如方向盘转动等)来捕捉和识别。

基于对驾驶员情绪机理的全面理解,本文构建了一个面向“情感化交互”智能座舱的驾驶员情绪研究框架。该框架主要分为驾驶员层、智能汽车层和网络层三部分:驾驶员层主要负责情绪的识别、监测和调节;智能汽车层通过与驾驶员的交互来调节其情绪状态,提高驾驶的舒适性和安全性;网络层则用于将智能汽车与外部环境相连,以实时获取道路、交通以及相关服务的信息。

(2) 驾驶员情绪对驾驶行为的影响

情绪是影响驾驶行为的关键因素之一,负面情绪如愤怒、焦虑、沮丧等可能导致驾驶员出现鲁莽驾驶、注意力不集中等危险行为。为了分析不同情绪对驾驶行为的具体影响,本文使用离散情绪模型和维度情绪模型进行了对比研究,并对中国驾驶员的情绪对驾驶行为的具体影响进行了实验研究。

首先,本文建立了驾驶员情绪诱导材料库,包含了不同场景、视觉元素、音频以及视频资料,通过这些材料,诱导驾驶员进入特定的情绪状态。随后,本文实施了驾驶员情绪驾驶实验,记录了驾驶员在愤怒、悲伤、兴奋等情绪状态下的驾驶行为特征。数据分析结果表明,愤怒情绪通常会导致驾驶员增加加速和换道行为的频率,注意力集中时间变短,危险驾驶行为显著增加;而悲伤情绪则会延长反应时间,降低驾驶的主动性。

通过基于维度情绪模型的情绪实验,本文发现情绪的“唤醒度”和“愉悦度”两个维度对于驾驶行为有重要影响。高唤醒度的情绪,如愤怒或兴奋,会显著提高驾驶员的应激反应,但也增加了错误的可能性;而高愉悦度的情绪,如喜悦,则有助于保持驾驶员的冷静和驾驶的稳定性。这些发现为后续驾驶员情绪的识别和调节策略设计提供了有价值的参考。

(3) 驾驶员情绪识别及调节方法研究

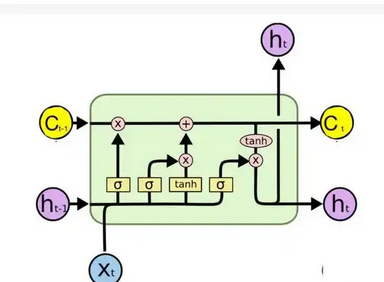

驾驶员情绪的识别是智能座舱实现“情感化交互”的关键。本文提出了一种基于面部表情和驾驶行为数据的多模态情绪识别模型,称为MDERNet(Multi-modal Driver Emotion Recognition Network)。在模型构建方面,本文首先采集了驾驶员在驾驶过程中的面部表情视频以及相关驾驶行为数据(如方向盘角度、车辆速度、加速度等)。通过对这些数据进行标注和预处理,本文采用卷积神经网络(CNN)和长短时记忆网络(LSTM)结合的方法来处理面部表情数据和驾驶行为数据,实现情绪的准确识别。

实验结果表明,MDERNet模型在情绪识别准确率和鲁棒性方面均取得了良好的表现,尤其是在愤怒、焦虑、冷静等主要情绪类别的识别中,模型的表现优于其他基准方法。此外,本文还建立了多种情境下的驾驶员情绪数据集,包括模拟器环境下的多模态情绪数据集和实车环境下的面部表情与道路场景数据集。这些数据集的公开将有助于推进驾驶员情绪识别的研究,推动智能座舱领域的发展。

在情绪调节方面,本文着重研究了驾驶员愤怒情绪的调节,这是提高驾驶安全性的重要课题。愤怒情绪通常会增加事故的发生概率,因此本文尝试通过视觉元素的调节来实现情绪的缓解。研究设计了不同视觉元素参数的组合,包括颜色(冷色系和暖色系)、表现形式(扁平化和拟物化)和调节方式(积极干预和状态反馈)等,以研究这些视觉设计对驾驶员愤怒情绪的调节效果。

实验结果表明,冷色调(如蓝色)和拟物化表现形式能够有效降低驾驶员的愤怒情绪,同时状态反馈的调节方式可以让驾驶员对自身情绪状态更加敏感,从而实现有效的情绪管理。这些发现为未来的智能座舱界面设计提供了科学依据,确保在驾驶员情绪波动时,智能系统能够及时做出反馈以减轻负面情绪的影响,提升驾驶体验的安全性和愉悦性。

(4) 驾驶员情绪调节方法的应用展望

未来智能座舱的发展,将更深层次地实现人车之间的情感交互,这要求汽车能够不仅仅识别驾驶员的情绪,还能够实时对驾驶员的情绪状态做出适应性调节。本文讨论了将情绪识别与车载娱乐、导航、空调等系统相结合的潜在应用。例如,当识别到驾驶员处于愤怒状态时,系统可以自动播放舒缓音乐,调整车内灯光和温度,甚至引导驾驶员进行深呼吸等放松训练,从而缓解紧张情绪。

此外,随着5G和物联网技术的不断发展,智能座舱的情绪调节系统还可以与外部环境进行连接,通过与其他车辆、基础设施的协同工作,提供更多的调节手段。例如,在拥堵环境中,系统可以预测驾驶员的情绪变化,主动建议最佳路径或调整驾驶风格,以降低驾驶员的焦虑感。

import cv2

import numpy as np

import tensorflow as tf

from keras.models import Sequential

from keras.layers import Conv2D, MaxPooling2D, Flatten, Dense, LSTM

# 加载面部表情数据集和驾驶行为数据集

face_data = cv2.VideoCapture('face_dataset.mp4')

drive_data = np.load('driver_behavior.npy')

# 定义情绪识别模型 MDERNet

model = Sequential()

# 卷积层提取面部特征

model.add(Conv2D(32, (3, 3), activation='relu', input_shape=(64, 64, 3)))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Conv2D(64, (3, 3), activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Flatten())

# 全连接层处理面部特征

model.add(Dense(128, activation='relu'))

model.add(Dense(64, activation='relu'))

# LSTM层处理驾驶行为特征

lstm_input = tf.convert_to_tensor(drive_data, dtype=tf.float32)

lstm_model = Sequential()

lstm_model.add(LSTM(50, return_sequences=True, input_shape=(lstm_input.shape[1], lstm_input.shape[2])))

lstm_model.add(LSTM(50, return_sequences=False))

# 将卷积网络和LSTM网络输出连接

combined_input = tf.concat([model.output, lstm_model.output], axis=-1)

final_model = Sequential()

final_model.add(Dense(50, activation='relu', input_dim=combined_input.shape[-1]))

final_model.add(Dense(3, activation='softmax')) # 三种情绪分类

# 编译模型

final_model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

# 训练模型

final_model.fit([face_data, lstm_input], epochs=10, batch_size=32)

# 保存模型

final_model.save('MDERNet_model.h5')

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?