imagenet上使用深度卷积网络

背景介绍

目前的数据集太小,而复杂的图像分类和识别任务需要更多的数据训练。

对于大量的数据又需要容量大的网络,cnn网络可以通过调节宽度和深度来调节网络的容量。cnn相比于标准的前馈网络有较少的链接和参数(归功于卷积操作共享权重),易于训练。

与此同时,高性能gpu以及经过优化的2d卷积可以帮助训练。

本文主要贡献:

1、训练了深度卷积网络并取得了很好的分类效果

2、实现了高性能的gpu 2D卷积

3、通过一些特性提高了网络性能并减少了网络运行的时间

4、通过一些方法减少过拟合

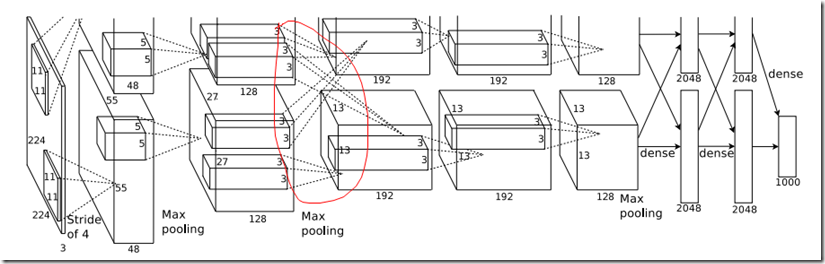

5、网络包含5层卷积和3层全连接,并且网络的深度影响准确率

具体的结构:

1、Relu

相比于tanh和sigmod,ReLU减少训练时间,如下图,

本文探讨了使用深度卷积网络AlexNet对ImageNet图像进行分类,介绍了ReLU激活函数、多GPU训练、局部响应归一化、重叠池化等关键特性,以及数据增强和dropout策略来减少过拟合。实验表明,网络的深度对提高分类准确率有显著影响。

本文探讨了使用深度卷积网络AlexNet对ImageNet图像进行分类,介绍了ReLU激活函数、多GPU训练、局部响应归一化、重叠池化等关键特性,以及数据增强和dropout策略来减少过拟合。实验表明,网络的深度对提高分类准确率有显著影响。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?