三角法求深度(triangulation)

在知道了相机的轨迹以后,使用三角法就能计算某个点的深度,在Hartley的《Multiple view Geometry》一书中第10章、第12章都是讲的这个,这里只讲解线性求解方法。

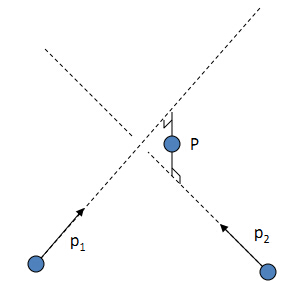

对于三维空间中的一点

P ,我们假设第一个摄像机坐标系C 1

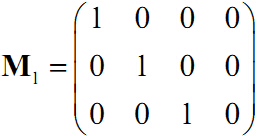

P = ( x , y , z , 1 ) T ,这时,摄像机坐标系

C 1 的外参数矩阵

M 1 为单位矩阵。

点

P 和光心的连线交第一个图像平面于点p 1

p 1 是在摄像机坐标系的坐标表示,不是在图像坐标系下,这在上一篇博客中已经强调。同理,和第二个摄像机光心连线交第二幅图像于点

p 2 。

p i 在各自摄像机坐标系中的表示为:

p 1 = ⎛ ⎝ ⎜ x 1 y 1 1 ⎞ ⎠ ⎟ c 1 和

p 2 = ⎛ ⎝ ⎜ x 2 y 2 1 ⎞ ⎠ ⎟ c 2

摄像机坐标系

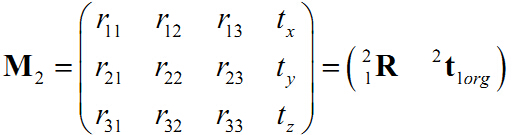

C 2 的外参数矩阵为

M 2 ,由于摄像机坐标系

C 1 就是世界坐标系,所以有

在推导本征矩阵

E 的时候,我们说R

C 2 到坐标系

C 1 的旋转变换矩阵,即

1 2 R 。t是平移,更确却的说是光心

C 2 在

C 1 中的坐标表示,即

1 t 2 。所以在通过8点法求出的R,T以后,得到的从摄像机坐标2变换到到摄像机坐标系1的变换矩阵为

1 2 H = [ R 3 × 3 0 t 3 × 1 1 ]

而这里的外参数矩阵

M 2 是将世界坐标系中的一点P投影到摄像机坐标系

C 2 。所以

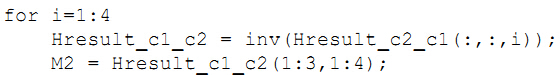

M 2 = 2 1 H = 1 2 H − 1 ,只需去掉H矩阵的最下面一行齐次坐标就行了。所以,通过本征矩阵得到R,t以后,要计算摄像机坐标系

C 2 外参数矩阵的程序如下:

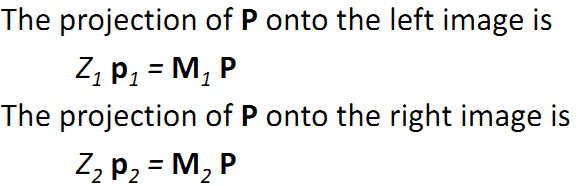

有了外参矩阵,我们就可以得到这些点坐标的关系:

由于光心

C i ,三维坐标点P,以及

p i 三点共线,所以向量

C i p i 、 C i P 的叉乘应该为0,上述方程又可以转化为:

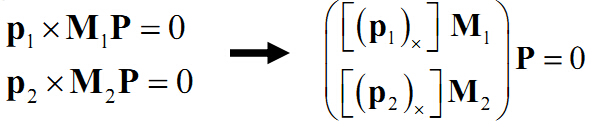

这又是一个要用最小二乘求解的线性方程方程组 ,和求本征矩阵一样,计算矩阵A的SVD分解,然后奇异值最小的那个奇异向量就是三维坐标P的解。程序如下:

计算出来的P的坐标就是P在世界坐标系中的坐标,这里就是P在摄像机坐标系

C 1 中的表示。并且注意上篇博客中强调过的:

p 1 = K − 1 ⎛ ⎝ ⎜ u 1 v 1 1 ⎞ ⎠ ⎟ 、

p 2 = K − 1 ⎛ ⎝ ⎜ u 2 v 2 1 ⎞ ⎠ ⎟

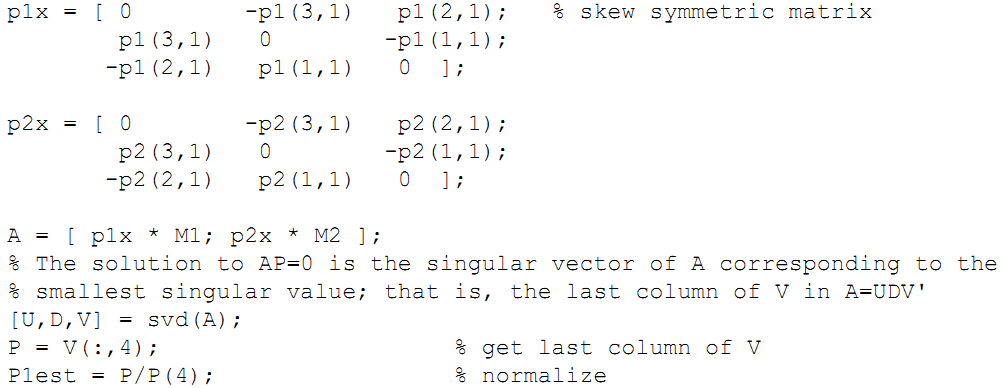

上篇博客中还提到本征矩阵恢复的R,T组合有四种组合形式,我们需要通过计算点的深度来判断R,T的哪种组合是正确的,和这篇博客结合起来,获得R,T正确组合的流程和代码如下:

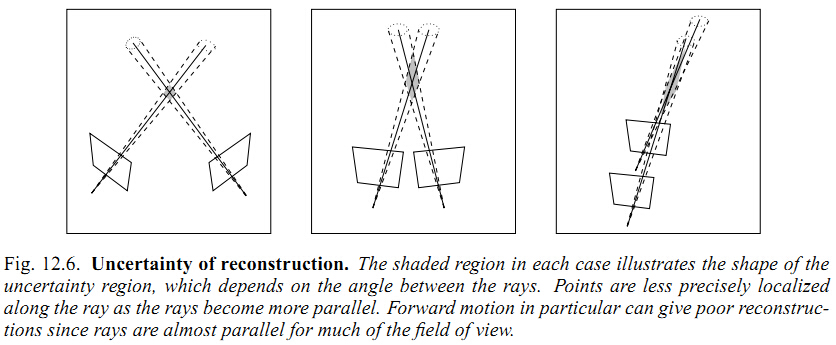

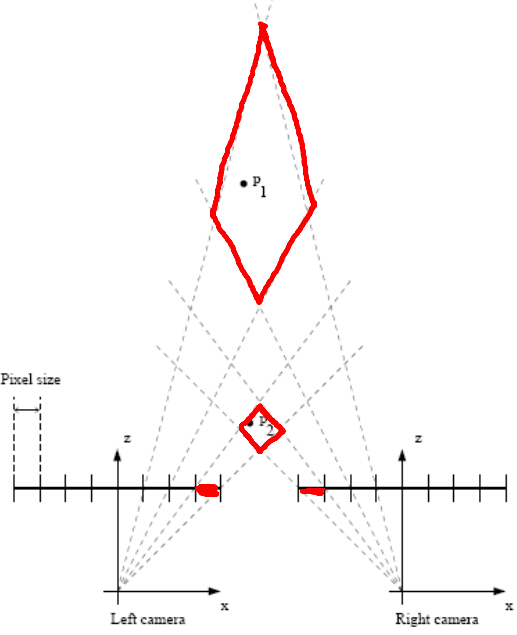

从两幅图中可以看出,两个射线夹角越小,误差协方差越大。所以点到光心连线组成的射线向量在orbslam中是有明确记录的。

(转载请注明作者和出处:

http://blog.csdn.net/heyijia0327 未经允许请勿用于商业用途)

reference:

博客主要参考了 professor William Hoff 的课件《structure from motion》

本文详细介绍了如何利用三角法(triangulation)计算三维空间中某点的深度,并给出了具体的线性求解方法及其实现步骤。文章首先设定相机轨迹,然后通过两个不同位置的相机观测同一场景点来确定该点的空间位置。

本文详细介绍了如何利用三角法(triangulation)计算三维空间中某点的深度,并给出了具体的线性求解方法及其实现步骤。文章首先设定相机轨迹,然后通过两个不同位置的相机观测同一场景点来确定该点的空间位置。

2286

2286

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?