1、编码器-解码器(Encoder-Decoder)

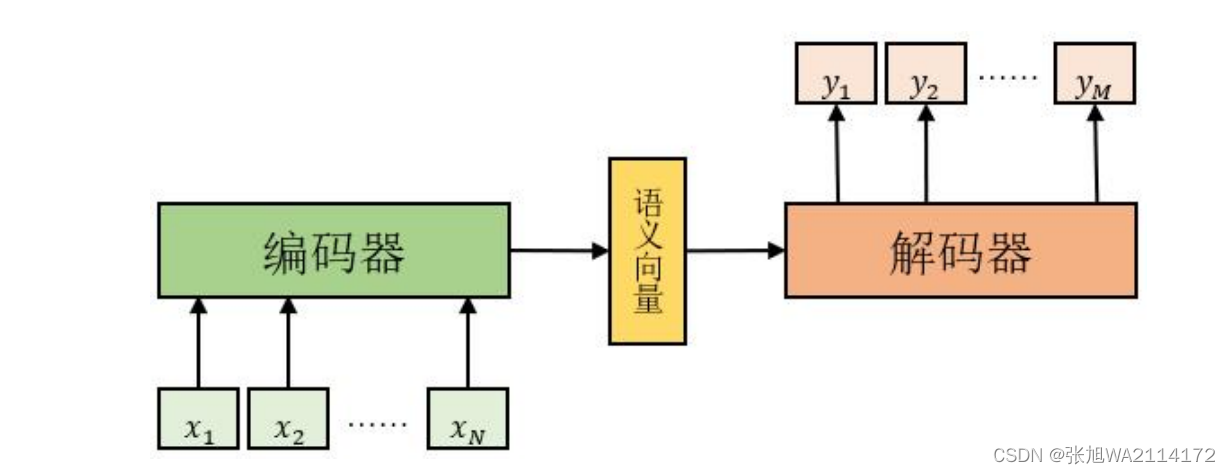

编码器-解码器是一种常见的深度学习架构,可以处理不定长的输入和输出序列,常用于机器翻译、文本摘要等领域。本文的引例为序列到序列(seq2seq)模型,Seq2Seq模型由两个主要部分组成:编码器(Encoder)和解码器(Decoder)。

1.1编码器结构

编码器负责将输入序列(比如源语言句子)转换为一语义向量,捕捉不定长输入序列的语义信息并将其转化为一个固定长度的向量表示。编码器通常基于循环神经网络(RNN)、长短时记忆网络(LSTM)、门控循环单元(GRU)或者Transformer的编码器。

seq2seq采用的编码器结构是循环神经网络(RNN),编码器的输入是一个序列,比如一个句子,每个单词或字符都被表示为一个向量。这些向量依次输入到RNN单元中,并且每个RNN单元的输出会作为下一个RNN单元的输入。这样,在每个时间步,RNN单元都会通过考虑之前的上下文来生成一个新的输出。

1.2解码器结构

解码器接收编码器生成的隐藏状态向量作为输入,并通过逐步生成输出序列(目标语言句子)来学习如何将编码的信息转换为所需的输出格式。

解码器也通常是基于RNN、LSTM、GRU或Transformer的结构,在每个时间步生成一个输出单词或符号,直到生成一个特殊的结束标记或达到预定的最大输出长度。

单纯的编码-解码结构的弊端:一个向量无法完全表示整个序列的信息。

2、包含注意力机制的编码器-解码器

在传统的seq2seq模型中,编码器将整个输入序列(源语言句子)编码成一个固定长度的向量,然后解码器使用这个向量来生成输出序列(目标语言句子)。然而,这种方法有时会导致信息丢失或性能下降,特别是在处理长文本时。

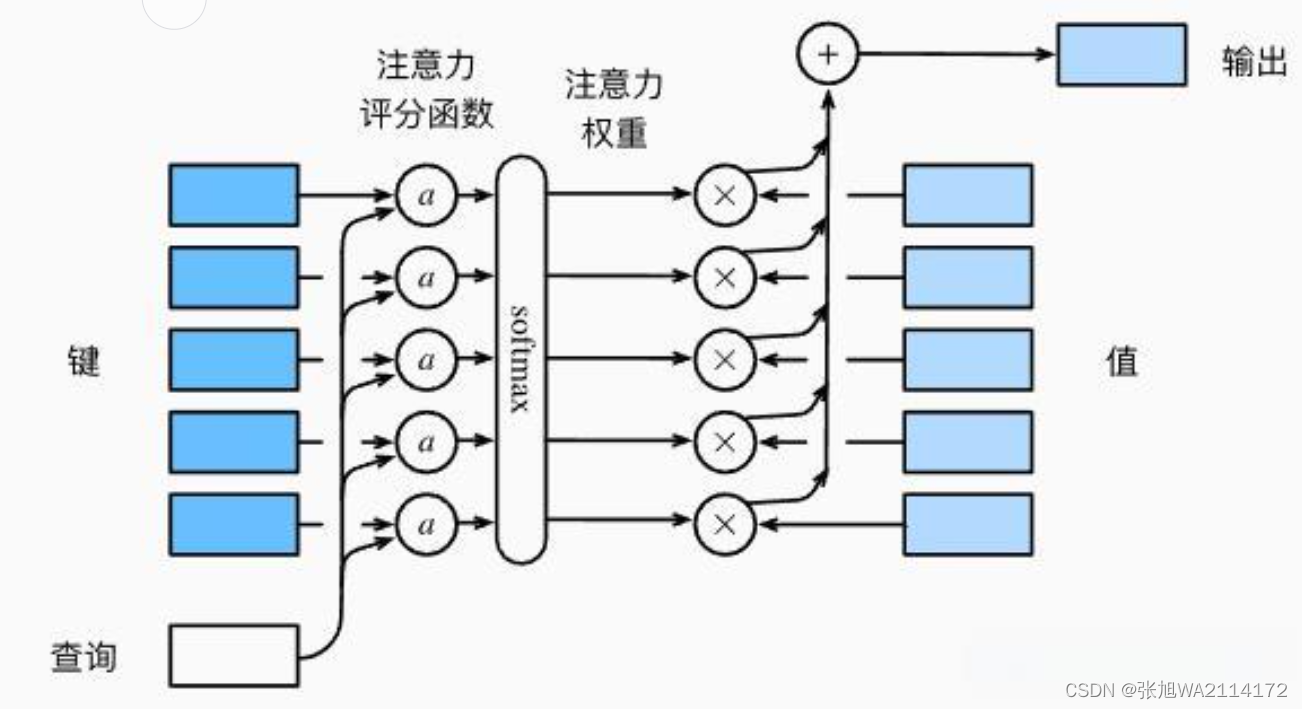

注意力机制的引入解决了这个问题,它允许解码器在生成每个输出单词时,动态地关注和编码器输入序列中不同位置的信息,而不是仅依赖于一个固定的上下文向量。

编码器的工作原理是通过自注意力机制对输入序列进行编码。自注意力机制通过对输入序列的每个位置进行注意力权重的计算,从而捕捉到输入序列中不同位置之间的关系。每个位置在计算注意力权重时,会考虑到其它位置的信息,并根据其它位置的重要性来调整自身的表示。

解码器的工作原理是通过注意力机制和上下文向量来生成输出序列。在解码的每个位置,模型会根据输入序列的编码结果和已经生成的部分输出序列来计算注意力权重。通过注意力权重,模型能够选择输入序列中与当前位置相关性较高的部分,并将这些部分的信息结合到当前位置的解码中。这样一步步地迭代生成输出序列,直到生成完整的序列。

3、数据预处理

为保持输入序列等长,可添加符号“<pad>”在序列的末尾,直到每个序列等长,同样可以在序列的前后添加标识符,来标志序列的开始和结束。下列为数据预处理定义的函数

# 将一个序列中所有的词记录在all_tokens中以便之后构造词典,然后在该序列后面添加PAD直到序列等长

# 长度变为max_seq_len,然后将序列保存在all_seqs中

def process_one_seq(seq_tokens, all_tokens, all_seqs, max_seq_len):

all_tokens.extend(seq_tokens)

seq_tokens += [EOS] + [PAD] * (max_seq_len - len(seq_tokens) - 1)

all_seqs.append(seq_tokens)

# 使用所有的词来构造词典。并将所有序列中的词变换为词索引后构造Tensor

def build_data(all_tokens, all_seqs):

vocab = Vocab.Vocab(collections.Counter(all_tokens),

specials=[PAD, BOS, EOS])

indices = [[vocab.stoi[w] for w in seq] for seq in all_seqs]

return vocab, torch.tensor(indices)

设置序列的最大长度为7,输出英语和法语第一个样本经处理后的序列

![]()

4、编码器-解码器设计

为实现英语到法语的翻译,构建基于注意力机制的编码器-解码器结构。

4.1编码器

编码器采用GRU循环神经网络,可以解决RNN中不能长期记忆和反向传播中的梯度等问题,与LSTM的作用类似,不过比LSTM简单,容易进行训练。其中的输出指的是最后一层的隐藏层在各个时间步的隐藏状态,并不涉及输出层计算。注意力机制将这些输出作为键项和值项。

class Encoder(nn.Module):

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers, drop_prob=0):

super(Encoder, self).__init__()

self.embedding = nn.Embedding(vocab_size, embed_size)

self.rnn = nn.GRU(embed_size, num_hiddens, num_layers, dropout=drop_prob)

def forward(self, inputs, state):

# 输入形状是(批量大小, 时间步数)。将输出互换样本维和时间步维

embedding = self.embedding(inputs.long()).permute(1, 0, 2) # (seq_len, batch, input_size)

return self.rnn(embedding, state)

现在,我们来看一个实际的例子,创建一个批量大小为4、时间步数为7的小批量序列输入,并使用我们定义的编码器进行计算。得到的结果如下所示。

![]()

4.2注意力机制

注意力模型函数(attention_model): 这个函数定义了一个多层感知机,用于计算注意力权重。在本例中,我们使用一个包含单隐藏层的多层感知机,其中隐藏层的输入是解码器的隐藏状态与编码器在所有时间步上的隐藏状态的连接。

def attention_model(input_size, attention_size):

model = nn.Sequential(

nn.Linear(input_size, attention_size, bias=False),

nn.Tanh(),

nn.Linear(attention_size, 1, bias=False)

)

return model

注意力前向传播函数(attention_forward): 这个函数根据注意力模型,计算编码器和解码器的隐藏状态之间的注意力权重。输入包括编码器在所有时间步上的隐藏状态 和解码器上一时间步的隐藏状态 。

def attention_forward(model, enc_states, dec_state):

dec_states = dec_state.unsqueeze(dim=0).expand_as(enc_states)

enc_and_dec_states = torch.cat((enc_states, dec_states), dim=2)

e = model(enc_and_dec_states) # 形状为(时间步数, 批量大小, 1)

alpha = F.softmax(e, dim=0) # 在时间步维度做softmax运算

return (alpha * enc_states).sum(dim=0) # 返回背景变量

我们设置编码器和解码器的隐藏单元个数均为8,编码器的时间步数为10,批量大小为4。

![]()

4.3解码器

通过注意力机制计算当前时间步的背景向量,这是根据编码器的隐藏状态和解码器当前隐藏状态加权求和得到的重要信息表示。解码器的输入是输出语言的词索引,通过词嵌入层转换为密集向量表示,并与背景向量在特征维度上进行连结。将这个连结结果与上一个时间步的隐藏状态输入到门控循环单元(如GRU或LSTM)中,以计算当前时间步的输出和更新隐藏状态。

class Decoder(nn.Module):

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

attention_size, drop_prob=0):

super(Decoder, self).__init__()

self.embedding = nn.Embedding(vocab_size, embed_size)

self.attention = attention_model(2*num_hiddens, attention_size)

# GRU的输入包含attention输出的c和实际输入, 所以尺寸是 num_hiddens+embed_size

self.rnn = nn.GRU(num_hiddens + embed_size, num_hiddens,

num_layers, dropout=drop_prob)

self.out = nn.Linear(num_hiddens, vocab_size)

def forward(self, cur_input, state, enc_states):

"""

cur_input shape: (batch, )

state shape: (num_layers, batch, num_hiddens)

"""

# 使用注意力机制计算背景向量

c = attention_forward(self.attention, enc_states, state[-1])

# 将嵌入后的输入和背景向量在特征维连结, (批量大小, num_hiddens+embed_size)

input_and_c = torch.cat((self.embedding(cur_input), c), dim=1)

# 为输入和背景向量的连结增加时间步维,时间步个数为1

output, state = self.rnn(input_and_c.unsqueeze(0), state)

# 移除时间步维,输出形状为(批量大小, 输出词典大小)

output = self.out(output).squeeze(dim=0)

return output, state

5、训练

我们先实现batch_loss函数计算一个小批量的损失。解码器在最初时间步的输入是特殊字符BOS。之后,解码器在某时间步的输入为样本输出序列在上一时间步的词,即强制教学。构建满足模型的损失函数,注意使用掩码变量避免填充项对损失函数计算的影响。

在训练函数中,我们需要同时迭代编码器和解码器的模型参数。

def train(encoder, decoder, dataset, lr, batch_size, num_epochs):

#初始化

enc_optimizer = torch.optim.Adam(encoder.parameters(), lr=lr)

dec_optimizer = torch.optim.Adam(decoder.parameters(), lr=lr)

#损失函数

#训练循环

for epoch in range(num_epochs):

l_sum = 0.0

for X, Y in data_iter:

enc_optimizer.zero_grad()

dec_optimizer.zero_grad()

l = batch_loss(encoder, decoder, X, Y, loss)

l.backward()

enc_optimizer.step()

dec_optimizer.step()

l_sum += l.item()

if (epoch + 1) % 10 == 0:

print("epoch %d, loss %.3f" % (epoch + 1, l_sum / len(data_iter)))接下来,创建模型实例并设置超参数,得到如下的训练结果,随着迭代的轮数增加,损失越少,训练的结果趋于收敛,模型更加稳定。

6、预测不定长的序列及翻译的准确性

上面我们已经构建好了编码器和解码器,并对模型进行了初步训练,接下来我们要使用模型,输出法语,输出对英文的预测,评估翻译的准确性。

6.1预测

这里我们使用最简单的贪婪搜索,来生成解码器在每个时间步的输出。

def translate(encoder, decoder, input_seq, max_seq_len):

# 将输入序列按空格分割为单词,并添加结束符号(EOS)和填充符号(PAD)使其达到最大序列长度

in_tokens = input_seq.split(' ')

in_tokens += [EOS] + [PAD] * (max_seq_len - len(in_tokens) - 1)

# 解码过程,最多进行max_seq_len次迭代

for _ in range(max_seq_len):

dec_output, dec_state = decoder(dec_input, dec_state, enc_output)

pred = dec_output.argmax(dim=1)

pred_token = out_vocab.itos[int(pred.item())]

if pred_token == EOS: # 当任一时间步搜索出EOS时,输出序列即完成

break

else:

output_tokens.append(pred_token)

dec_input = pred

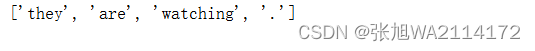

return output_tokens使用模型进行简单预测,输入法语句子“ils regardent.”,翻译后的英语句子应该是“they are watching.”

input_seq = 'ils regardent .'

translate(encoder, decoder, input_seq, max_seq_len)

6.2结果评估

BLEU评分通常用于自然语言处理任务中,特别是机器翻译任务,用来衡量机器生成文本与参考文本之间的相似度。

def bleu(pred_tokens, label_tokens, k):

# 计算预测和参考序列的长度

len_pred, len_label = len(pred_tokens), len(label_tokens)

score = math.exp(min(0, 1 - len_label / len_pred))

# 计算不同n-gram的精度

for n in range(1, k + 1):

num_matches, label_subs = 0, collections.defaultdict(int)

for i in range(len_label - n + 1):

label_subs[''.join(label_tokens[i: i + n])] += 1

# 计算预测序列中与参考序列匹配的n-gram数量

for i in range(len_pred - n + 1):

if label_subs[''.join(pred_tokens[i: i + n])] > 0:

num_matches += 1

label_subs[''.join(pred_tokens[i: i + n])] -= 1

# 计算当前n-gram大小的精度,并根据n-gram大小应用加权

score *= math.pow(num_matches / (len_pred - n + 1), math.pow(0.5, n))

return score在每个n-gram大小的精度计算后,根据n的大小应用加权。通常,BLEU评分会对不同长度的n-gram给予不同的重视程度,较长的n-gram会有更高的权重,最后输出score结果。

接下来,定义一个自己想要的辅助打印函数,来显示化评估结果。

1059

1059

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?