分类目录:《机器学习中的数学》总目录

相关文章:

· 激活函数:基础知识

· 激活函数(一):Sigmoid函数

· 激活函数(二):双曲正切函数(Tanh函数)

· 激活函数(三): 线性整流函数(ReLU函数)

· 激活函数(四):Leaky ReLU函数

· 激活函数(五):ELU函数

· 激活函数(六):Parametric ReLU(PReLU)函数

· 激活函数(七):Softmax函数

· 激活函数(八):Swish函数

· 激活函数(九):Maxout函数

· 激活函数(十):Softplus函数

· 激活函数(十一):Softsign函数

· 激活函数(十二):高斯误差线性单元(GELUs)

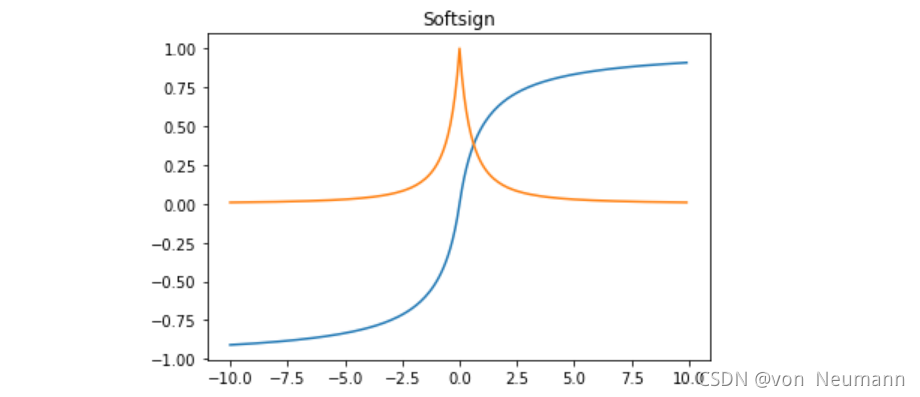

Softsign函数是Tanh函数的另一个替代选择。就像Tanh函数一样,Softsign函数是反对称、去中心、可微分,并返回-1和1之间的值。其更平坦的曲线与更慢的下降导数表明它可以更高效地学习,比tTanh函数更好的解决梯度消失的问题。另一方面,Softsign函数的导数的计算比Tanh函数更麻烦。

Softsign

(

x

)

=

x

1

+

∣

x

∣

\text{Softsign}(x)=\frac{x}{1+|x|}

Softsign(x)=1+∣x∣x

Softsign

′

(

x

)

=

1

(

1

+

∣

x

∣

)

2

\text{Softsign}'(x)=\frac{1}{(1+|x|)^2}

Softsign′(x)=(1+∣x∣)21

Softsign函数及其导数的图像:

3556

3556

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?