Cross-Modality Image Matching Network With Modality-Invariant Feature Representation for Airborne-Ground Thermal Infrared and Visible Datasets

机载-地面热红外和可见光数据集的具有模态不变特征表示的跨模态图像匹配网络

武汉大学 IEEE TRANSACTIONS ON GEOSCIENCE AND REMOTE SENSING, VOL. 60, 2022

摘要:热红外(TIR)遥感图像可以通过长波红外在夜间清晰地成像物体,因此热红外与可见光(VIS)图像融合是提高遥感解译能力的一种途径。然而,由于两种图像之间的辐射差异很大,因此很难对它们进行匹配。其中最重要的问题之一是缺乏对模态特有信息和模态共享信息的综合考虑,这使得现有方法难以获得模态不变的特征表示。本文提出了一种跨模态图像匹配网络(CMM-Net ),通过学习模态不变的特征表示来实现热红外和可见光图像的匹配。首先,为了提取图像的特定模态特征,该框架构建了一个浅二分支网络,以充分利用特定模态信息,而不共享参数。第二,为了提取不同模态之间的高级语义信息,模态共享层被嵌入到网络的深层。此外,设计并组合了三种新的损失函数来学习模态不变的特征表示,即同一模态中非对应特征的区别损失,不同模态之间对应特征的跨模态损失,以及跨模态三元组(CMT)损失。基于地面和机载热红外图像和可见光图像的多模态匹配实验表明,该方法对地面和机载图像的匹配性能分别比现有方法提高了约2%和6%。

卷积神经网络(CNN)、跨模态匹配、深度学习、图像匹配、模态不变特征表示、热红外(TIR)图像、可见光(VIS)图像。

热红外(TIR)图像可以让我们从背景中分辨出目标热辐射差,进行全天成像。可见(VIS)图像可以以与人类视觉系统一致的方式提供高分辨率的纹理细节。这两类图像的联合应用可以利用热红外图像中物体的辐射信息和可见光图像中的特征轮廓和纹理信息[2]。

在匹配这两种跨模态图像类型后,它们的联合应用和联合解释可以使地球观测更加强大[3]–[5]。然而,由于数据的异质性,图像匹配具有挑战性,因为它们的信号来自不同的辐射机制。可见光图像捕捉的是可见波段的反射光,而热红外图像表现的是目标发出的辐射,这种辐射也被称为热辐射,与物体的温度高度相关[6],[7]。根据热力学定律,热辐射具有扩散性,因此它从高温物体传导到低温物体。就图像匹配任务而言,从热红外图像中提取明显的轮廓和结构非常困难[8]、[9]。现有的图像匹配方法是基于手工绘制的描述符,并致力于提取几何特征,如图像的独特轮廓和结构。这些方法使用选定的度量来实现特征匹配,例如尺度不变特征变换(SIFT) [10]、加速鲁棒特征(SURFs) [11]、定向快速旋转摘要(ORB) [12]和KAZE [13]。然而,基于手工描述的热红外与可见光图像匹配存在两个主要问题。

1)在特征提取阶段,手工描述符的抽象能力不足,它们依赖于图像的底层信息,如角点、梯度、边缘等。然而,由于热红外图像的热扩散效应,梯度平滑和边缘模糊会导致热红外图像的特征提取失败。

2)在特征匹配阶段,特征相似性度量标准(如最近邻搜索[14]或欧几里德距离匹配[15])是容易局限于局部最优解。因此,手工制作的描述符应用于热红外和可见光图像的匹配效果普遍较差。

近年来,以深度学习为代表的数据驱动方法已被成功引入图像匹配领域[16]-[20]。几个非线性数据映射函数可以叠加形成一个深层网络函数,在大量训练样本的支持下逼近任意复杂的函数[21]。检测和描述网络(D2网)[22]采用卷积神经网络(CNN)从原始图像生成特征图,然后在特征图上执行特征检测。对于热红外和可见光图像匹配,现有的基于深度学习的方法主要采用两分支框架,其中CNN同时充当特征提取器和特征描述器[23]-[27]。二分支网络可分为孪生网络和伪孪生网络。暹罗网络使用共享参数来降低二分支网络的训练成本[28],但是对于跨模态图像匹配任务,暹罗网络不能容易地描述不同模态之间的差异。没有共享参数的伪模态网络可以根据不同的模态学习不同的特征表示。因此,伪孪生网络已被证明比孪生网络更适合解决跨模态图像匹配问题[29][30]。通过实际研究,我们发现在浅层网络的特征描述中,具有不同模态的低级特征的视觉表示是非常不同的。可见光图像描述了物体的边缘和纹理信息,而热红外图像反映了物体的温度。这些图像类型之间存在显著差异,因此在浅层网络中,伪孪生网络可以帮助捕捉这种差异,这对于图像匹配至关重要。

然而,使用伪孪生网络进行跨模态图像匹配面临着一些挑战。

1)对于网络的设计,非共享参数的机制不利于学习一个独立于模态的共享空间。然而,虽然热红外和可见光图像是跨模态的异构图像,但它们仍然具有一些相似的语义信息,如形状、结构和拓扑关系。深度CNN可以提取更深层次的语义特征,这些特征由不同的模态共享。事实上,人类在解读多模态图像时所依赖的恰恰是这种高级语义信息。

2)对于网络损失函数,很少有专门为跨模态图像匹配设计的损失函数。热红外和可见光图像的匹配是一个跨模态问题,数据可能具有较高的模态内可变性,这使得跨模态图像匹配任务极具挑战性。与近红外图像相比,热红外图像描述了地面物体的发射能量,即温度信息。图像匹配任务的体现是所提取特征的类内差异性增加,降低了特征的唯一性和差异性。现有的基于深度学习的红外图像匹配方法通常基于近红外图像[31]、[28],而不是热红外图像。结果,他们没有关注特征组内差异大的问题,因此将其应用于热红外和可见光图像的结果往往令人失望。

为了解决上述问题,本文提出了一种新型网络& CMM-Net。本工作的主要贡献如下。

A.用于热红外和可见光图像的新型CMM-Net网络

由于波段组成不同,热红外和可见光图像具有很大的视觉差异。然而,现有的方法缺乏对模态特有信息和模态共享信息的综合考虑。CMM-Net采用在浅层具有非共享参数的伪孪生网络来学习特定于模态的特征表示,而在网络的深层嵌入参数共享层来学习模态不变的特征表示。CMM-Net充分利用了特定模态信息和模态共享知识,这对于减少跨模态差异和生成不变特征是有价值的。

B.用于扩展类间距离以学习形态不变特征表示的形态特定鉴别(MSD)损失函数

虽然热红外图像和可见光图像是跨模态异构图像,但它们仍然具有一些相似的语义信息,如结构或拓扑关系。在深度卷积网络的帮助下,CMM-Net学习一个公共的代表性空间,在该空间中可以比较来自各种模态的数据。MSD损失函数最大化类间距离,以分离模态特定特征和模态不变特征。

C.使用欧几里德距离的跨通道约束(CMC)来缩小跨通道间隙

热红外和可见光图像之间的模态差异导致了相应特征表示的不同。在模态不变特征空间中,有必要施加进一步的约束,以使相应特征的分布更加紧凑。CMC减小了跨模态内部特征之间的距离,从而减小了来自不同模态的相应特征之间的差异。

利用无人机获取的机载图像数据集和地面传感器获取的地面图像数据集作为实验数据,验证了CMM-Net的有效性。在这些上获得的测试结果具有挑战性的数据集表明,CMM-Net优于当前最先进的图像匹配方法。本文的其余部分组织如下。用于图像匹配的两分支网络在第二部分中总结。第三节介绍了CMM-Net的框架、关键特征的检测和损失函数的设计。在第四节中,我们描述了如何使用机载和地面平台的热红外和可见光图像作为实验数据集来验证CMM-Net的有效性。第五节介绍了消融研究和敏感性分析。第六节总结了我们的结论。

二.背景

本节描述了两分支网络结构,包括连体网络结构和假网状结构。介绍了自然图像匹配中的经典算法及其在遥感图像匹配中的应用。总结了二分支网络在跨模态图像匹配中应用的主要问题。

暹罗网络由Chopra等人于2005年首次提出[32]。孪生网络结构包含两个分支,其中同时输入两幅图像,网络的输出是相似度值,目的是比较两幅图像的相似度。因此,这种类型的匹配网络可以看作是基于patch的匹配问题。网络的结构由两个主要部分组成。

1)两个特征提取分支,通过CNN提取它们的特征表示。两个分支之间的权重被共享以减少参数。

2)分类器组件,它通过合并两个分支中的元素来生成匹配概率。这是一个受监督的端到端框架,它将这两个部分作为一个整体来实现。为了减少计算量,原暹罗网络的双支路结构采用完全相同的参数。随着孪生网络的应用越来越广泛,带非共享参数的伪连体网络被用来描述两幅图像的独特特征。随着深度学习的发展,暹罗网络已经广泛用于人脸识别[33]-[36],个人重新识别[35]、[37]和变化检测[38]、[39]。

在过去的五年中,暹罗网络已经成为图像匹配任务中最流行的网络架构之一,并广泛用于自然图像[40],[41]。MatchNet通过连接用于特征描述的二分支网络和测量网络,并用交叉熵损失函数进行训练,成功地将匹配问题转化为分类问题[42]。DeepCompare探索了各种不同的神经网络结构,即连体网络、伪连体网络、双通道网络、空间金字塔池(SPP)连体网络,以及称为中心环绕双流网络的双流多分辨率模型[43]。DeepDesc学习128维描述符,其欧几里德距离反映了patch相似性[44]。pn-Net提出使用三元组损失的软化版本来训练描述符,以与欧几里德距离匹配[45]。

暹罗网络也被成功地应用于遥感图像匹配。与自然影像相比,遥感影像内容复杂,唯一性低。在小模态差异的图像匹配任务中,学者们倾向于使用共享参数的连体网络作为特征提取器或描述符。网络的输入是以关键点为中心的两幅图像patches,网络的输出是两幅图像patches的相似度[24],[26]。暹罗全卷积网络(SFcNet)的两个分支共享相同的基础设施和相同的权重[28]。它的两个分支通过卷积运算连接起来,并采用最大化正负样本间特征距离的策略输出两个输入图像块间的相似性得分。该方法已在光学、近红外、热红外和合成孔径雷达(SAR)图像上进行了测试,但对热红外和可见光图像的匹配精度不高。

对于模态差异较大的图像,连体网络中完全共享参数的策略不如不共享参数的伪连体网络。伪连体网络对不同模态的图像采用不同的模态参数,可以获得较高的匹配精度。这个结论已经在很多研究中得到验证[29],[30]。为了识别光学和SAR遥感图像中的相应patch,Hughes等人[29]使用了一个具有两个独立权重但具有相同卷积结构的连体网络来计算SAR和光学图像patch之间的相似性,以应对输入图像的异质性。朱等[30]采用伪连体网络实验多模态图像匹配,独立训练二分支网络,不共享网络参数。训练结束后,两个网络分支再次合并,作为后续匹配网络的输入。这种网络设计使得网络的每个分支都能够保留其纯粹而重要的特征表示,有利于提高后续特征匹配的准确性。

通过以上分析,我们得出结论,当待匹配的两幅图像具有相同的模态时,由于图像具有相似且稳定的辐射信息,因此具有共享参数的连体网络可以降低计算成本。当要匹配的两个图像是跨模态异构数据时,需要没有共享参数的伪连体网络来学习模态特定信息。我们的工作是基于这些发现。

三 CMM-NET方法

在这一节中,详细描述了热红外和可见光图像的跨模态匹配框架。此外,还提出了关键特征的检测方法介绍。最后,提出了总损失函数。举例说明了三种损失函数设计,其中MSD损失扩大了同一模态内的类间距离,CMC损失缩短了跨模态的类内距离,并且采用跨模态三元组(CMT)损失来识别相应的特征。

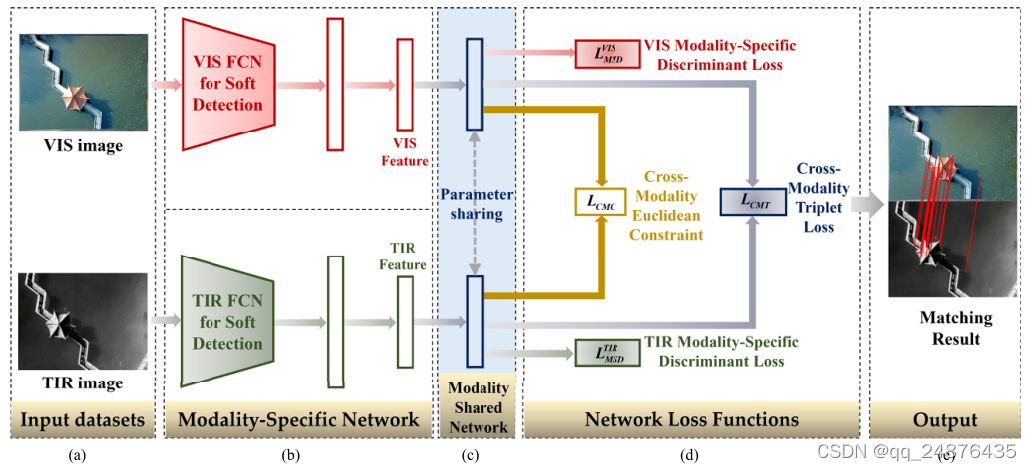

图1。CMM-Net框架。(a)图像对输入。(b)用于提取可区分的模式特定特征的模式特定网络。(c)用于嵌入模态不变特征的模态共享网络。(d) MSD损失用于扩大同一模态中的组间距离,CMC损失用于减少不同模态中的组内距离,CMT损失用于识别相应的特征。(e)图像匹配结果输出。

(在CMM网络的每个分支上,ResNet[47]被用作网络的基本主干,但在用于关键特征检测的conv4_3层之后被截断。然后将具有非共享权重的全连接层添加到每个网络中,输出特定于模态的特征。在具有非共享权重的全连接层之后,将具有共享权重的全连接层添加到每个分支以学习模态不变特征。所有实验都是在一台配备NVIDIA Tesla P100 GPU加速器和16 GB GPU内存的计算机上进行的。 )

A.跨模态图像匹配网络

本文提出了一种端到端的深度学习网络,用于热红外和可见光图像的跨模态匹配,我们称之为CMM-Net。如图1所示,该框架利用了特定于该模态的唯一信息和独立于该模态的共享信息。在CMM-Net的浅层中,分别提取热红外域和可见光域中的模态特定特征。在CMM-Net的深层,模态共享层被嵌入用于提取模态不变特征,这有利于跨模态图像匹配。

1)用于提取可区分的特定模态特征的特定模态网络:可见光图像描述了在可见光范围内物体的反射,而热红外图像描述了物体的热辐射能力。因此,这些图像类型在表达浅层视觉特征方面是完全不同的。由于不同模态之间的浅层中的特征之间的间隙,特定于模态的网络在提取可区分特征方面更有优势。因此,热红外图像和可见光图像都采用特定模态网络,并且它们之间的参数是不共享的。与暹罗网络相比,CMM-Net更注重在网络的浅层提取可区分的特定模态特征,使网络能够学习热红外和可见光之间的特定模态信息。

2)用于嵌入模态不变性特征的模态共享网络:尽管热红外和可见光图像之间复杂的几何和辐射变化使得图像的外观表现出很大的差异,但是不同模态之间仍然共享一些高级语义信息,例如物体的结构和空间拓扑关系。在网络的深层,特征包含高级语义信息。为了学习和描述模态共享特征,具有共享参数的全连接层被嵌入CMM-Net的深层。嵌入式模态共享层通过在热红外特征和可见特征之间建立联系,有助于获取共享知识。模态共享层在生成模态不变特征中起着重要作用,这有利于跨模态热红外与可见光图像匹配。

B.关键特征的检测

CNN生成的特征图定义为F,F∈Rh×w×c,c表示通道数,h×w表示通道中特征图的大小。Fijk是三维张量F,k=1,…c为了训练过程的反向传播,根据空间和信道维度中特征图上的极值点,采用软特征检测方法来检测候选关键点。

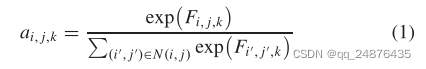

首先,在空间维度中,软局部最大值aijk表示如下:

其中N(I,j)表示图像中像素(I,j)的九个邻域像素,包括其自身。

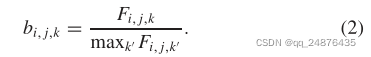

第二,在信道维度中,信道响应的最大值比通过以下公式计算:

接下来,为了同时考虑空间和信道维度,计算2-D响应的最大乘积。然后进行归一化以获得关键特征的软检测分数,如下所示:

在获得软检测分数之后,将特征图上所有位置的特征向量Fi,j乘以它们对应的软检测分数di,j,以生成di,jFi,j,其被用作最终特征图的输出。(可以理解为图像中每个特征加权,越是重要的特征其软检测分数也就是权重越高)

C.跨模态图像匹配的总体损失函数

通过使用网络中的浅层模态专用层和深层模态共享层,我们可以实现学习跨模态margin和提取区别性模态不变特征的目标。向特定于模态的损失函数添加欧几里德约束可以帮助对准不同域的跨模态特征。总损失函数表示如下:

![]()

其中,LCMT是CMT损失,LTIRMSD是热红外图像的MSD损失,LVISMSD是可见光图像的MSD损失,LCMC是用于缩小跨模态间隙的CMC损失。λ1和λ2是损失函数的加权系数。它们的值对匹配结果的影响在V-B部分的加权系数的分析中实验性地示出。

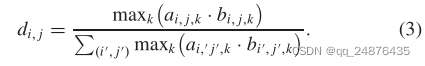

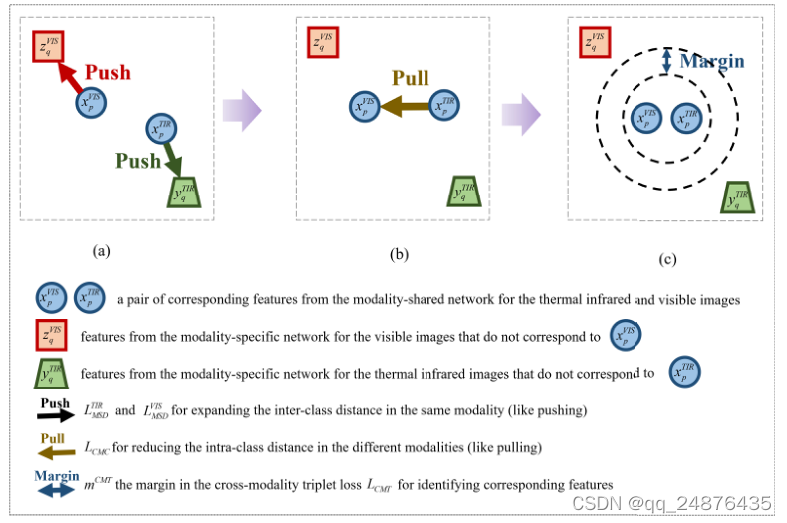

图2中示出了直观的示意图,以解释各个损失函数的作用。LTIRMSD和LVISMSD用于在相同的模态下扩大类间距离,如pushing。在不同的模态中,如pulling,采用LCMC来减少组内距离。

图2。损失函数示意图。(a)在同一模式中扩大组间距离的MSD损失。(b) CMC损失,用于减少不同模式之间的组内距离。(c)识别相应特征的CMT损失。

Pulling -------- reducing the intra-class distance in the different modalities (like pulling)

减少不同模态下类内距离(如拉力)

Push ------ for expanding the inter-class distance in the same modality (like pushing)

以扩展相同模态的类间距离(如推)。

Margin---------识别不同模态对应特征

1)用于在相同模态内扩展类间距离的MSD损失:为了确保网络可以被训练,应该准备正样本和负样本。(xTIRp,xVISp),p=1,…N被定义为从模态共享层输出的一对对应特征,其中xTIRp属于热红外图像,xVISp属于可见光图像,N是对应特征的数量。给定条件q≠p且q=1,…N,yTIRq表示从用于热红外图像的模态专用网络输出的不对应于xVISp的其他关键特征,zVISq表示从用于可见光图像的模态专用网络输出的不对应于xTIRp的其他关键特征。对应的特征xTIRp,xVISp是一对正样本,而非对应的特征(yTIRq和xTIRp)而不对应的特征(zVISq和xVISp)都是阴性样本。

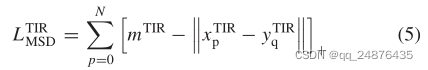

为了扩大同一模态中非对应特征的类间距离,热红外域和可见光域中的MSD损失函数设计如下:

其中mTIR和mVIS分别是热红外模态和可见光模态中的预定义余量,用于增加相应特征匹配的置信度。它们是经验值,所以在本研究中,最优值是通过大量实验获得的。另外,[ ]+ = max(,0)。非对应特征的类间距离(xTIRp,yTIRq)和(xVISp,zVISq)在不同的模态中需要大于mTIR和mVIS。关键参数mTIR和mVIS将在第五节的敏感性分析中进一步分析和讨论。

MSD损失函数LTIRMSD和LVISMSD通过最大化非对应匹配距离,达到扩大特征类间差异的目的。

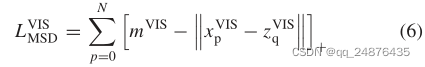

2)用于减少不同模态中的类内距离的CMC损失:图像匹配任务的关键是找到对应特征,这要求在特征描述之后对应特征的高度相似性。然而,相同对象的不同模态图像的视觉表示可能改变,因此来自不同模态的对应特征在从网络学习之后可能呈现完全不同的响应,这对于跨模态图像匹配是有害的。为了缩小对应特征的跨模态间隙,采用了跨模态欧几里德距离约束。CMC损失可表示如下:

通过最小化不同模态之间的对应特征距离,CMC损失使得相同的特征在通过模态共享层被提取之后看起来具有更相似的分布。

当不同模态之间的间隙变窄时,可见特征和热红外特征的分布变小,导致不同模态中模态共享层的距离变小。

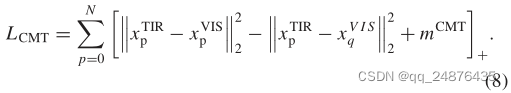

3)用于识别对应特征的CMT损失:为了识别跨模态热红外和可见光图像的对应特征,使用三元组损失函数来最小化对应特征距离,同时最大化非对应特征的距离,其中采用预定义的余量mCMT来使对应特征与非对应特征更加明显。CMT损失LCMT表示如下

模态共享层输出的热红外和可见光特征受CMT损失控制,对应特征之间的距离小于非对应特征之间的距离,从而实现对应特征识别。mCMT还用于增加相应特征匹配的置信度,因此在本研究中,其最优值也是通过大量实验得到的。在V-B部分的参数分析中分析了mCMT的值对匹配结果的影响。

总结

热红外成像可以使我们根据热辐射的差异将目标从背景中区分出来,并具有能够全天时成像的能力,而可视图像可以以与人类视觉系统一致的方式提供高分辨率纹理细节。在匹配这两种类型的交叉模态图像后,它们的联合应用和联合解释可以使地球观测方法更加强大。然而,由于数据的异质性,图像匹配具有挑战性。在本文中,在分析了现有的跨模态图像匹配方法中固有的问题之后,提出了一种适合于跨模态图像匹配的网络,称为CMM-Net,用于学习热红外和可见光图像之间的模态不变特征表示。热红外和可见光图像之间的高精度和稳健的匹配结果是通过模态专用的浅层和模态共享的深层实现的。具体来说,MSD损失用于扩大同一模态的类间距离,CMC损失用于减少不同模态的类内距离,CMT损失用于识别相应的特征。为了评估所提出的CMM-Net方法在匹配热红外和可见光图像方面与其他最新方法相比的准确性和有效性,来自机载和ground平台被采用。从定量结果可以看出,CMM-Net独特的网络结构和精心设计的损失函数能够成功地实现跨模态热红外与可见光图像匹配,比目前最先进的图像匹配方法具有更高的精度和更强的鲁棒性。

834

834

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?