写在前面:

前面是按照技术流的视频进行copy复制,后面会根据一些思考以及其他卷友的答疑进行尝试(新章节)。

这里附上机智流的Llama3教程链接:

1、个人助手复现:

继续上一章节(下载好模型、权重以及必要的依赖)

# 创建镜像并下载依赖

conda create -n llama3 python=3.10

conda activate llama3

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia

# 安装git

mkdir -p ~/model

cd ~/model

apt install git git-lfs -y

# 获取权重模型

git clone https://code.openxlab.org.cn/MrCat/Llama-3-8B-Instruct.git Meta-Llama-3-8B-Instruct

# 下载llama3的机智流的教程工具包,里面有一些数据集和web的展示程序

cd ~

git clone https://github.com/SmartFlowAI/Llama3-Tutorial

# 安装Xtuner

cd ~

git clone -b v0.1.18 https://github.com/InternLM/XTuner

cd XTuner

pip install -e .1)准备数据集

cd ~/Llama3-Tutorial

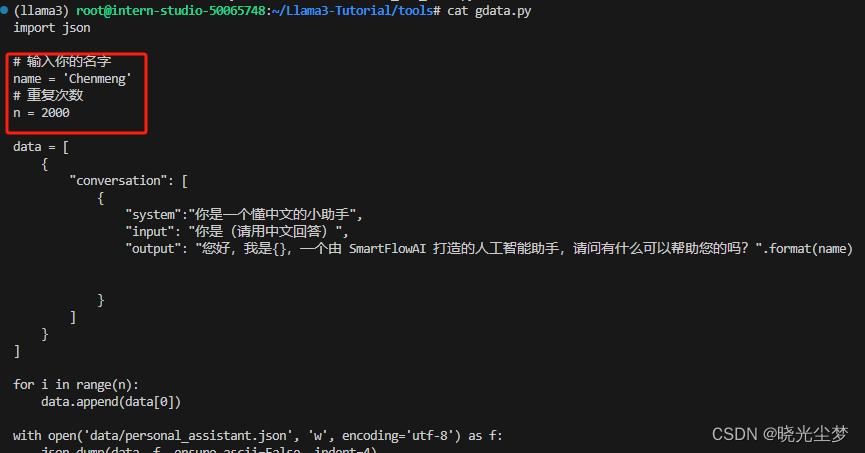

python tools/gdata.py 以上脚本就可以生成一个json文件,格式如下

[

{

"conversation": [

{

"system": "你是一个懂中文的小助手",

"input": "你是(请用中文回答)",

"output": "您好,我是SmartFlowAI,一个由 SmartFlowAI 打造的人工智能助手,请问有什么可以帮助您的吗?"

}

]

},

{

"conversation": [

{

"system": "你是一个懂中文的小助手",

"input": "你是(请用中文回答)",

"output": "您好,我是SmartFlowAI,一个由 SmartFlowAI 打造的人工智能助手,请问有什么可以帮助您的吗?"

}

]

}

]如果想要自定义,那么就编辑gata.py文件,这里我自己修改了name :

2)训练模型

cd ~/Llama3-Tutorial

# 开始训练,使用 deepspeed 加速

xtuner train configs/assistant/llama3_8b_instruct_qlora_assistant.py --work-dir /root/llama3_pth

# Adapter PTH 转 HF 格式

xtuner convert pth_to_hf /root/llama3_pth/llama3_8b_instruct_qlora_assistant.py \

/root/llama3_pth/iter_500.pth \

/root/llama3_hf_adapter

# 模型合并

export MKL_SERVICE_FORCE_INTEL=1

xtuner convert merge /root/model/Meta-Llama-3-8B-Instruct \

/root/llama3_hf_adapter\

/root/llama3_hf_merged3)推理验证

streamlit run ~/Llama3-Tutorial/tools/internstudio_web_demo.py \

/root/llama3_hf_merged打开web界面,询问问题,便可以得到答案:

但上面最大的问题就是,训练完后,所有问题的答案都是这一个!!因为gdata中只有这一条数据用于训练。

之后的篇章会记录自建数据集训练模型的过程,期得到可以回答多样的助手。

补充:后来设想,会不会编辑gdata.py文件的该单一问答重复次数过多导致过拟合,所以试验下把重复次数依次修改为10,100,500查看效果:

想想也是,这个是直接拿这些数训练模型,又不是进行微调,答案应该就是这一个(因为过拟合)。

871

871

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?