1 Adam介绍

Adam可以想成RMSprop+momentum

怎么记呢?Momentum累加前面是没有分式的,相当于除了1,所以在分子;RMSprop累加式子是在分母的,所以也在分母。

1.1 Bias Correction

2 Adam 特点

2.1 Adam通常在RNN中有很好的performance

2.2 Adam在靠近minimum的地方可能不能很好地收敛

——>靠近minimum的地方,梯度的值很小,因而梯度的平方比梯度更小。所以rt比st还要小,这就导致st除rt的值会较大。即每次变化的幅度会很大——这就可能导致overshooting

解决方法可以是慢慢地减少学习率,或者当快靠近minimum的时候,切换成带momentum的SGD

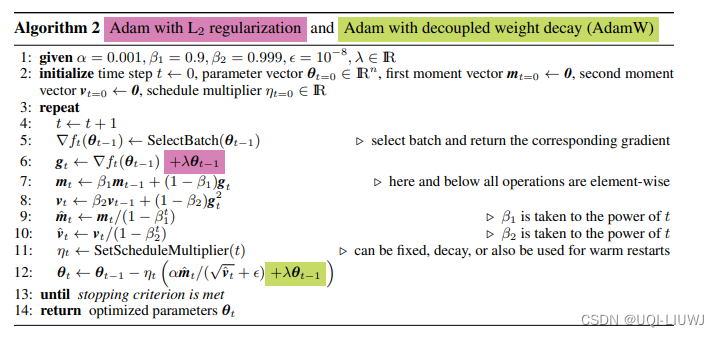

3 AdamW

19年ICLR的一篇paper

L2正则项是,此时的损失函数L关于参数W的偏导是

这篇论文改变了λWt的位置,相比于Adam+L2优化效果更好,泛化能力更强

1542

1542

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?