引言

在人工智能领域,大型语言模型(LLMs)正变得越来越重要,它们在自然语言处理任务中展现出了前所未有的能力。然而,这些模型往往需要大量的计算资源和专业技能才能运行。现在,有了LM Studio,这一切都变得简单起来。

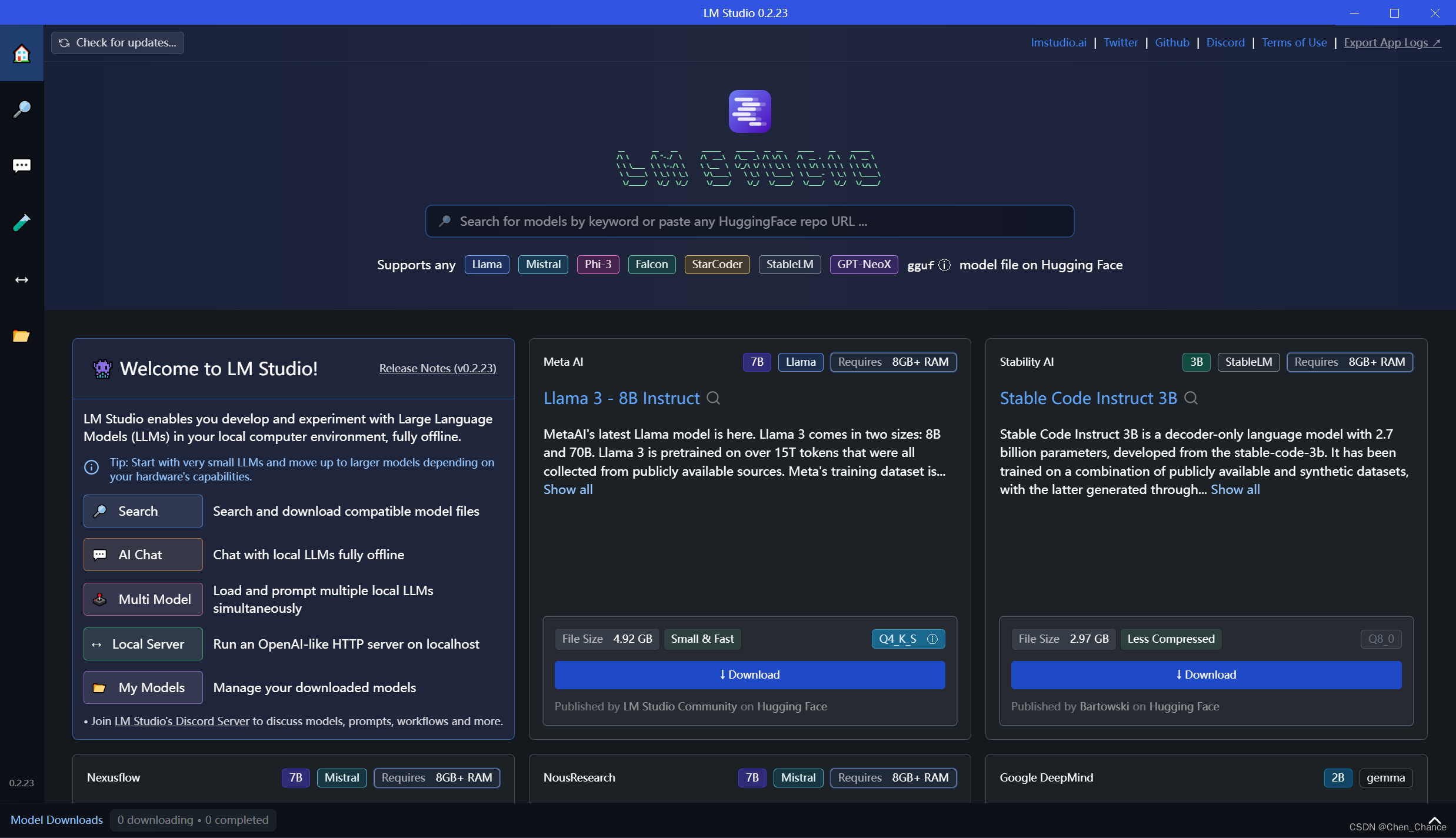

LM Studio简介

LM Studio是一款革命性的桌面应用程序,它允许用户在自己的计算机上本地运行、管理和部署大型语言模型。这款软件的目标是让大型语言模型更加亲民,让它们的力量可以被更广泛地利用。

主要功能

- 完全离线运行:无需互联网连接,用户就可以在自己的设备上运行复杂的语言模型。

- 模型兼容性:支持Hugging Face上的多种流行模型,如Llama, MPT, 和 StarCoder。

- 易于使用的界面:通过直观的聊天界面或OpenAI兼容的本地服务器,用户可以轻松地与模型交互。

- 模型下载与管理:用户可以直接从Hugging Face下载所需的模型文件,并在LM Studio中进行管理。

- 新模型发现:应用程序的首页展示了最新和最有趣的LLMs,方便用户探索和尝试。

- 本地服务器:内置的HTTP Server支持OpenAI API,方便开发人员进行本地模型部署和API测试。

系统要求

- 支持M1/M2/M3 Mac

- 支持AVX2的Windows PC

- Linux测试版

文本嵌入

从0.2.19版本开始,LM Studio引入了文本嵌入功能,这对于需要文本向量化的应用场景非常有帮助,如检索增强生成(RAG)应用程序。

安装与使用

LM Studio的安装过程简单直观,用户可以从官方网站下载适合自己操作系统的安装包。安装后,用户可以按照引导选择和下载所需的模型,然后开始构建和测试自己的应用。

以下安装使用结合视频电脑本地部署Llama3中文版 - LM studio编写

1.安装LMstdio

官网下载,下载后直接打开就行

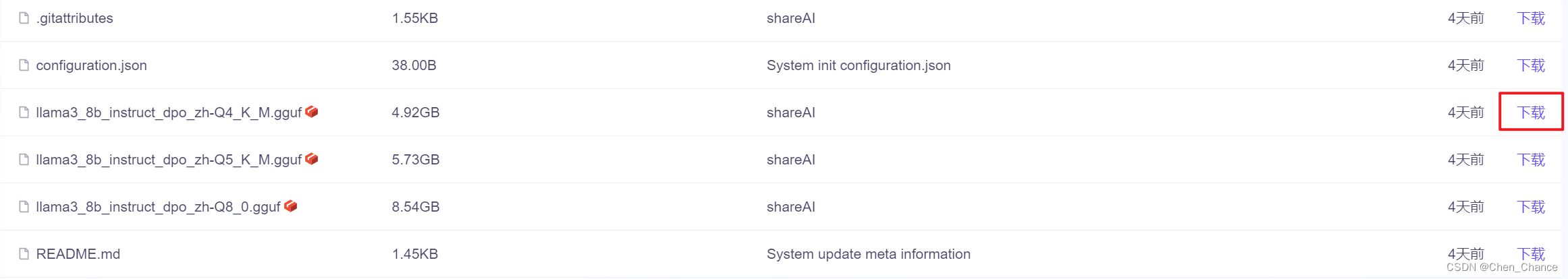

2.下载模型

GGUF模型下载:https://modelscope.cn/models/shareAI/llama-3-8b-Instruct-dpo-chinese-loftq-gguf/files

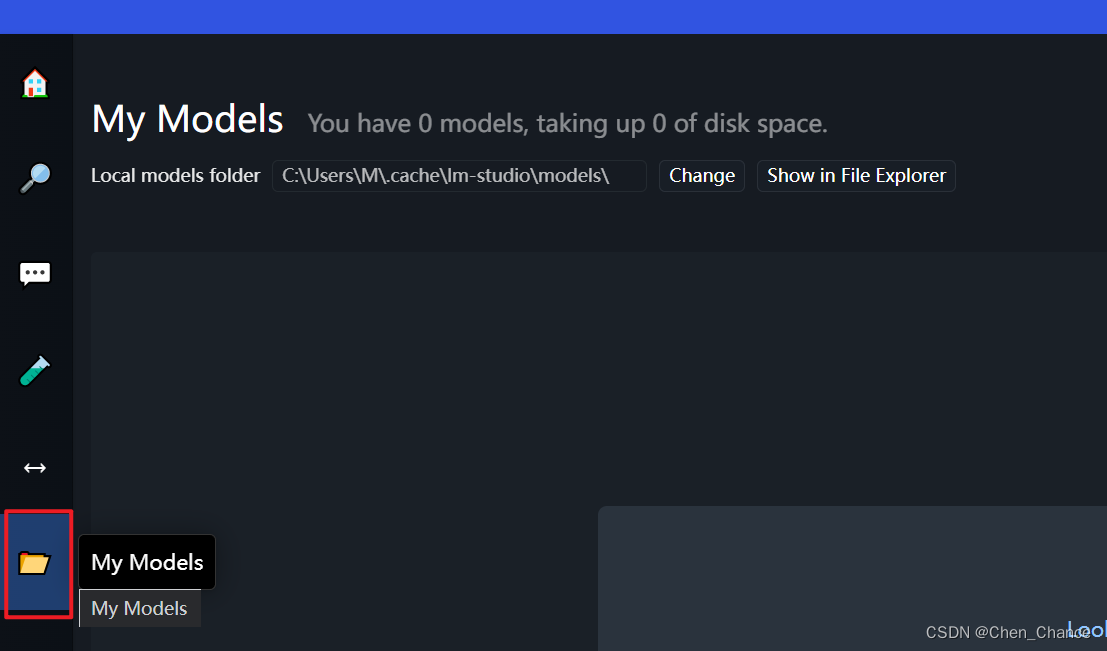

3.LM Studio使用模型

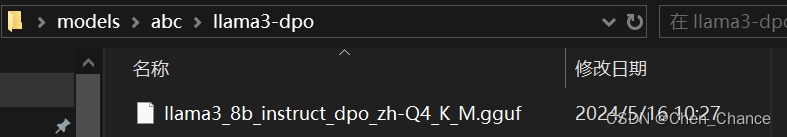

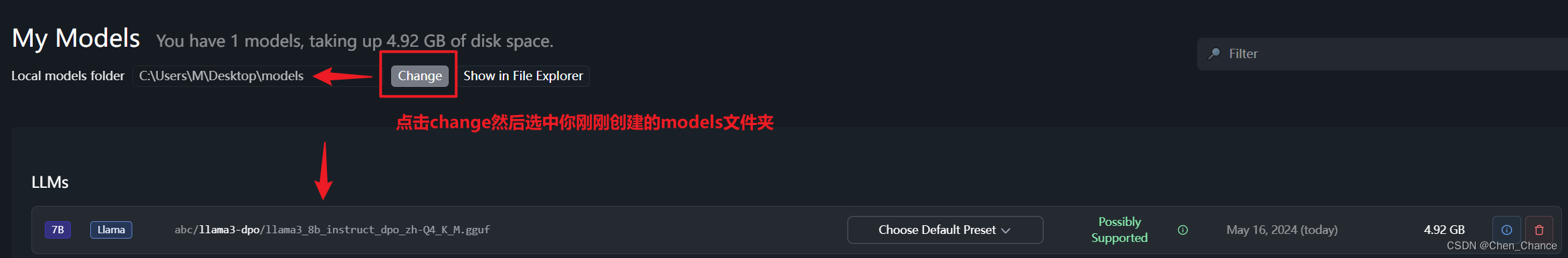

新建三层文件夹结构并在最后一层放入模型,比如我在桌面建一个models的文件夹

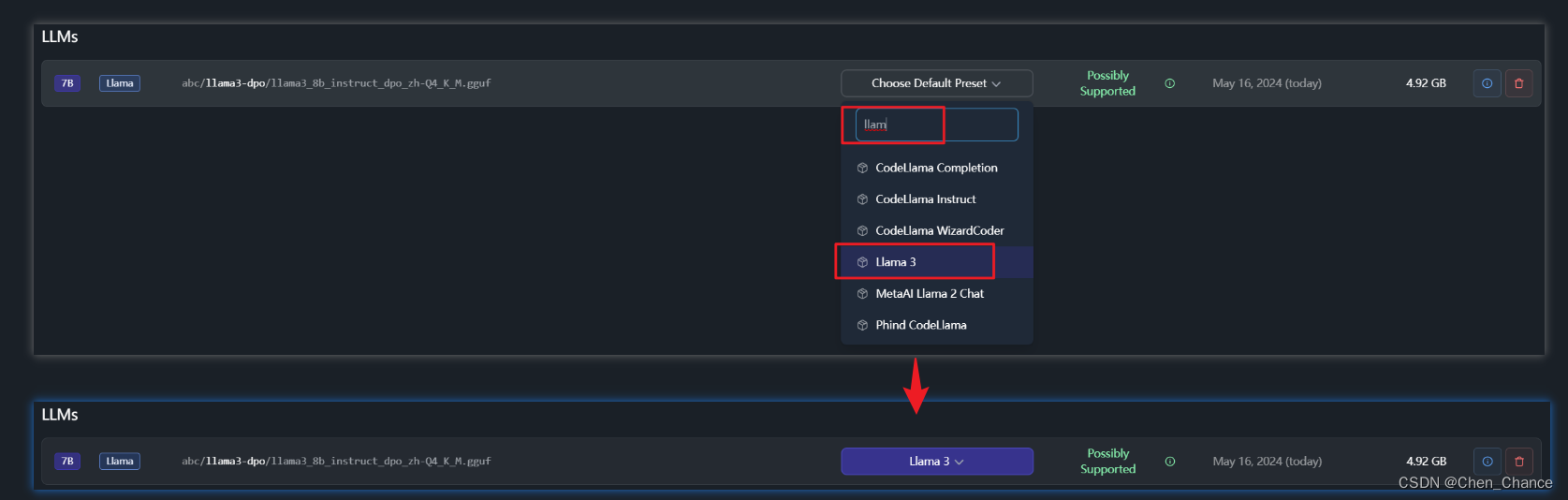

选择配置

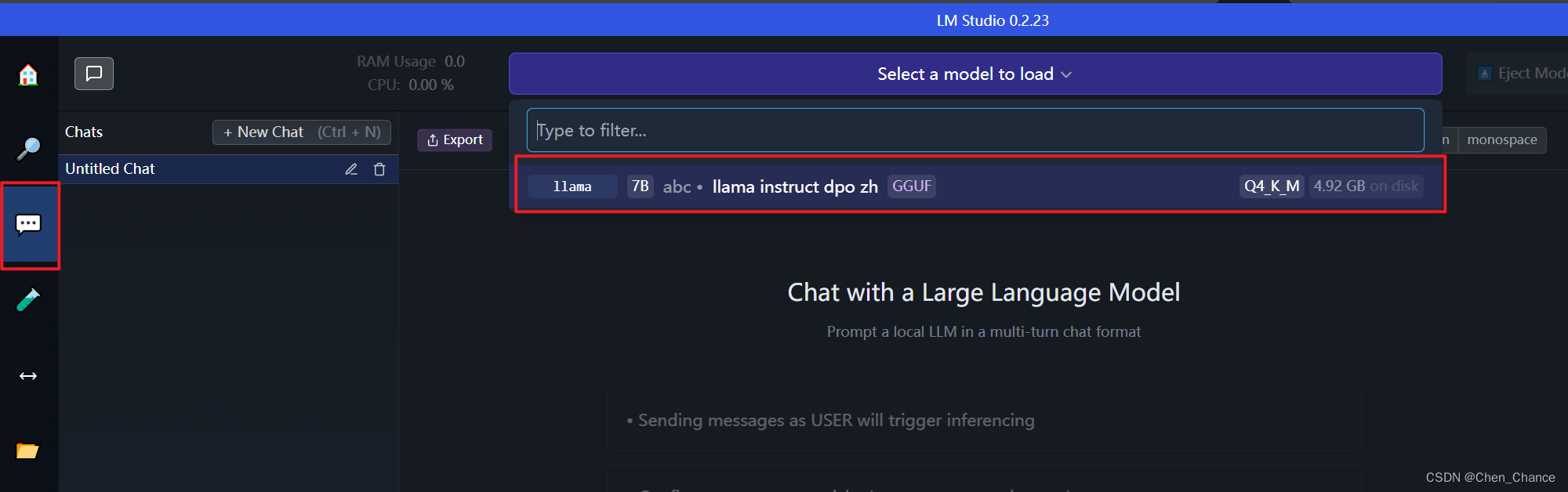

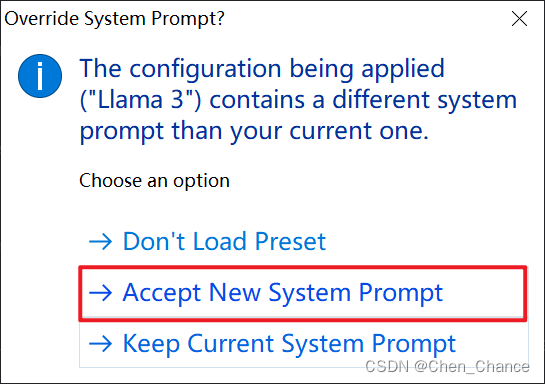

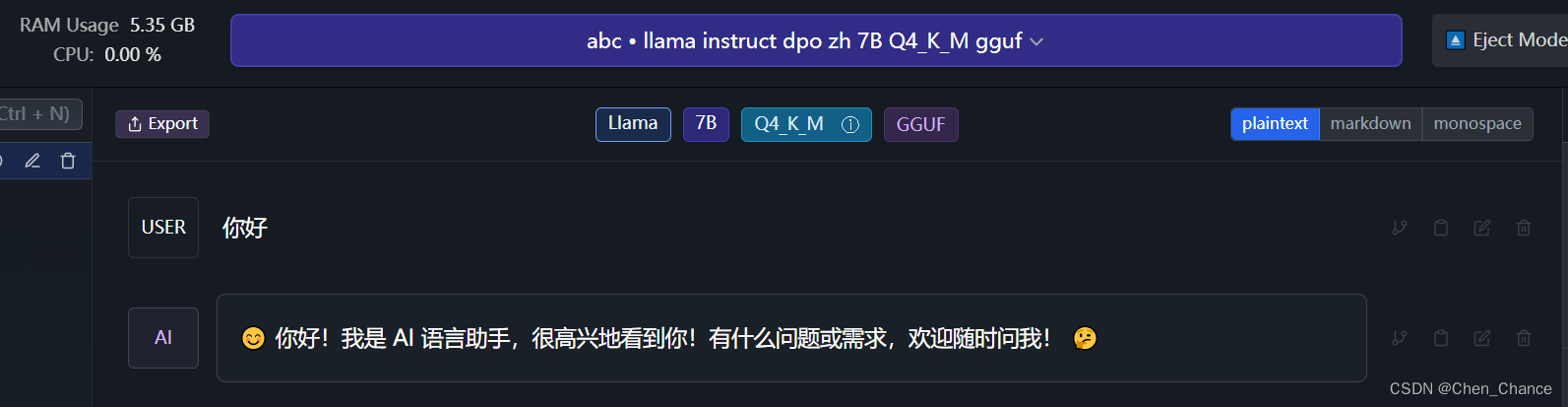

使用模型

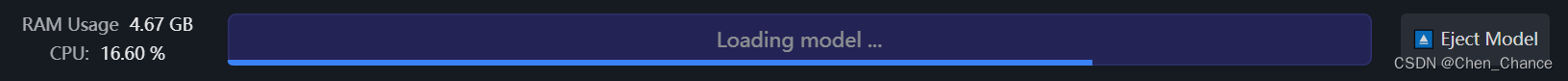

等待模型加载好后就可以使用了

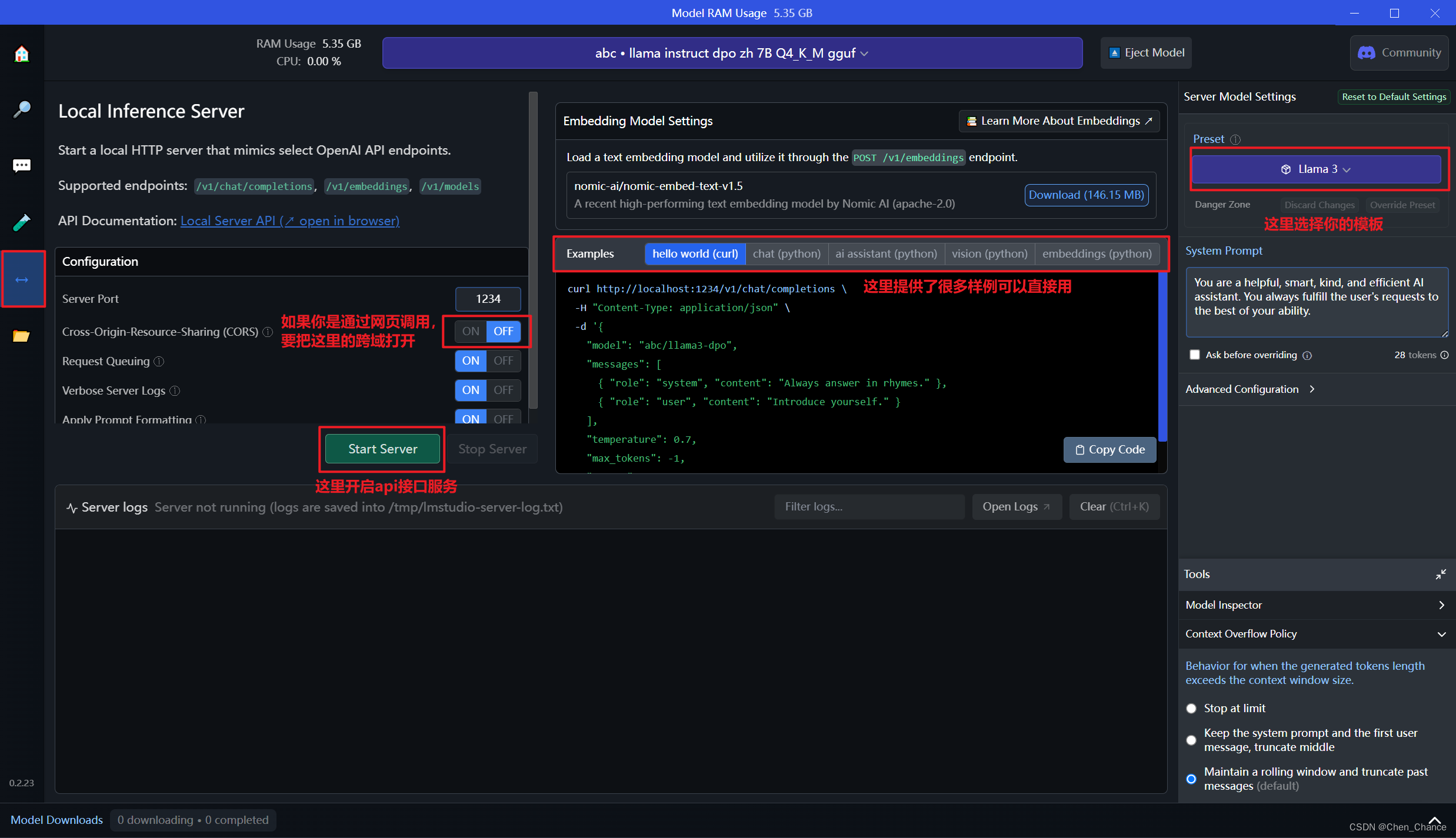

调用api使用

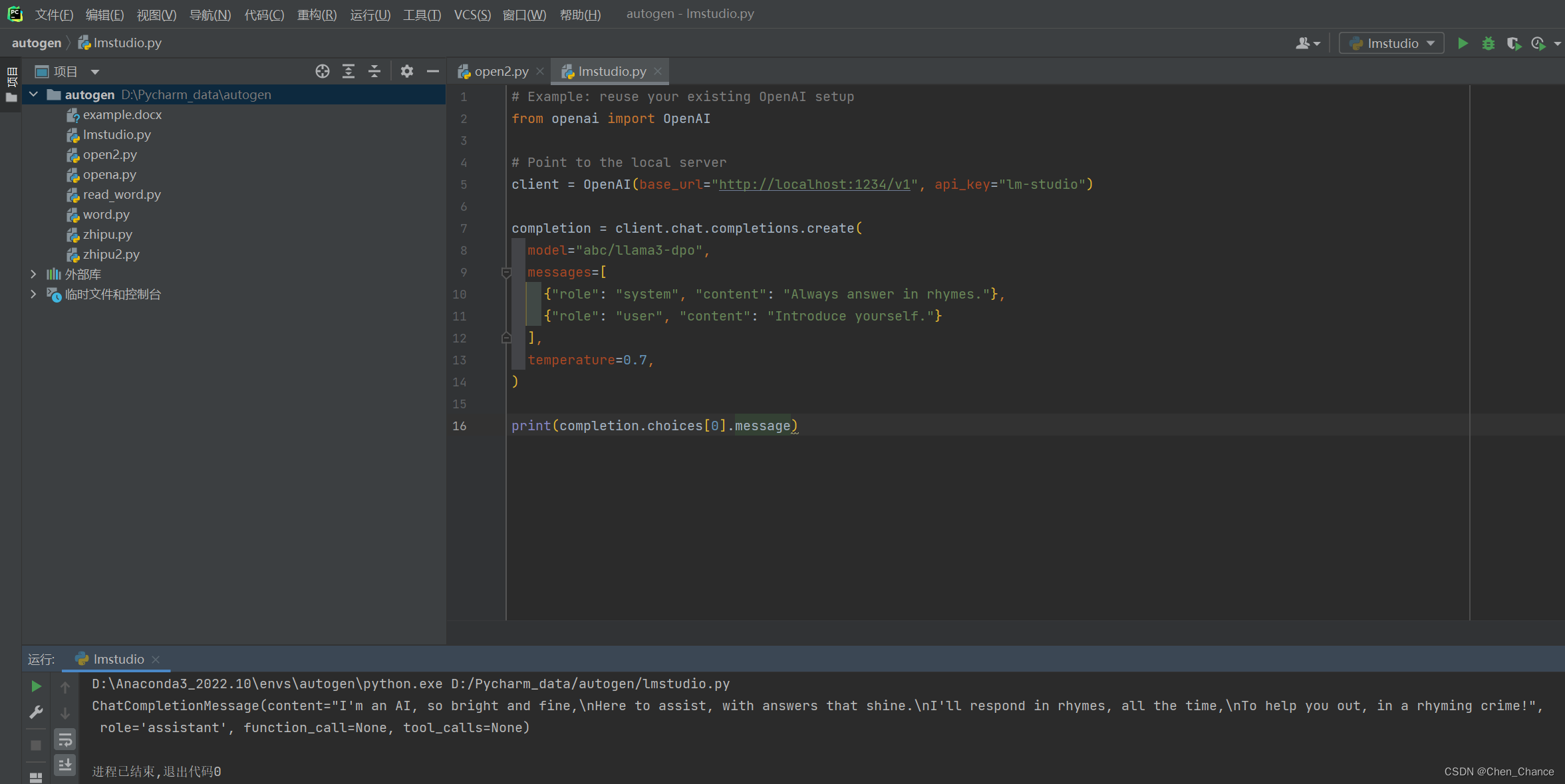

比如我直接把python里的复制到pycharm并打开接口服务(确保接口服务打开了)并运行代码

结语

LM Studio的出现,极大地降低了使用大型语言模型的门槛。无论是研究人员、开发者还是普通用户,都可以利用这款工具来发挥语言模型的潜力。随着人工智能技术的不断进步,LM Studio有望成为本地部署和管理大型语言模型的标准工具。

4336

4336

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?