Mixtral 8x7B:稀疏专家混合模型的突破性进展

引言

近年来,大规模语言模型(LLMs)在自然语言处理领域取得了显著进展,但其计算成本和资源需求也随之飙升。Mistral AI 团队在论文《Mixtral of Experts》中提出了 Mixtral 8x7B,一种基于稀疏专家混合(Sparse Mixture of Experts, SMoE)的语言模型。该模型以高效的参数利用和卓越的性能表现,为深度学习研究者提供了新的研究视角。本文将面向深度学习研究者,介绍 Mixtral 8x7B 的核心内容与创新点。

Paper:https://arxiv.org/pdf/2401.04088

核心内容概述

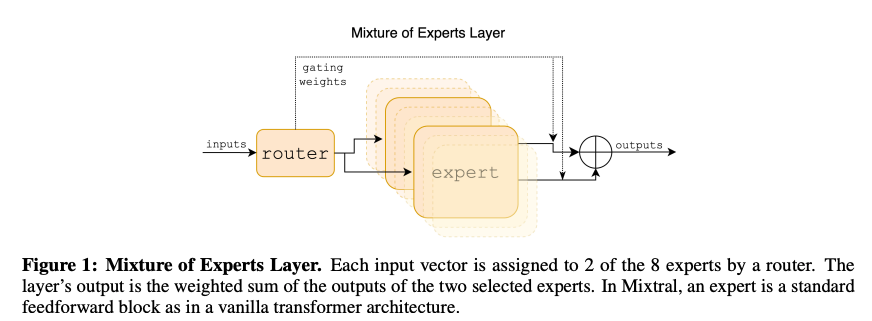

Mixtral 8x7B 是一种基于 Transformer 架构的解码器模型,核心区别在于其每个前馈层由 8 个专家(feedforward blocks)组成,并通过路由网络(router network)为每个 token 动态选择两个专家进行处理。这种设计使得模型在推理时仅使用 13B 的活跃参数,却能访问总计 47B 的参数,兼顾了性能与效率。

以下是论文的核心内容:

-

模型架构:

- Mixtral 继承了 Mistral 7B 的 Transformer 架构,修改了前馈层为稀疏专家混合(MoE)层。

- 每个 MoE 层包含 8 个专家,路由网络基于 Top-K(K=2)策略,通过 softmax 选择两个专家,输出为加权和。

- 模型支持 32k token 的上下文长度,词汇表大小和其他超参数见论文表 1。

-

性能表现:

- Mixtral 在多项基准测试中超越或匹敌 Llama 2 70B 和 GPT-3.5,尤其在数学、代码生成和多语言任务中表现突出。

- 经过指令微调的 Mixtral 8x7B - Instruct 在人类评估基准(如 MT-Bench)上超越 GPT-3.5 Turbo、Claude-2.1 和 Gemini Pro。

-

效率优势:

- 推理时仅使用 13B 活跃参数,相较 Llama 2 70B 的 70B 参数,计算成本大幅降低。

- 支持高效推理框架(如 vLLM 和 Megablocks),通过专家并行(Expert Parallelism)和模型并行优化多 GPU 部署。

-

多语言与长上下文能力:

- 通过预训练中上采样多语言数据,Mixtral 在法语、德语、西班牙语和意大利语等语言的基准测试中显著优于 Llama 2 70B。

- 在长上下文任务(如 passkey 检索)中,Mixtral 展现了 100% 检索准确率,且困惑度随上下文长度增加单调下降。

-

偏见与微调:

- 在偏见基准测试(如 BBQ 和 BOLD)中,Mixtral 表现出较低的偏见和更积极的情感倾向。

- 通过监督微调(SFT)和直接偏好优化(DPO),Mixtral - Instruct 实现了更强的指令跟随能力。

创新点分析

Mixtral 8x7B 的创新点为深度学习研究者提供了以下启发:

-

稀疏专家混合的高效参数利用:

- 传统密集模型(如 Llama 2 70B)在推理时使用全部参数,而 Mixtral 通过动态路由仅激活部分参数(13B/47B),显著降低了计算成本。

- 这种稀疏性通过 Top-2 路由实现,平衡了模型容量与推理速度,适合低批次和大规模批处理场景。

-

MoE 层的架构优化:

- Mixtral 的 MoE 层采用 SwiGLU 作为专家函数,与 GShard 等模型不同的是,Mixtral 将所有前馈层替换为 MoE 层,而非部分替换。

- 路由机制基于简单的 softmax Top-K 策略,易于实现且性能高效,结合 Megablocks 等专用内核进一步提升推理速度。

-

多语言能力的突破:

- 通过预训练中增加多语言数据的比例,Mixtral 在非英语语言任务中表现出色,为多语言模型设计提供了新思路。

- 研究者可进一步探索如何在预训练中平衡多语言数据分布以提升模型泛化能力。

-

长上下文处理能力的验证:

- Mixtral 在 32k token 上下文窗口中的优异表现(100% passkey 检索准确率)表明 MoE 架构在长序列建模中具有潜力。

- 这种能力可能得益于稀疏激活减少了内存瓶颈,研究者可进一步研究 MoE 在超长上下文(如 128k token)中的表现。

-

路由行为的分析:

- 论文通过对专家选择的分析(图 7 和图 8),揭示了路由器在语法结构(如 Python 代码中的

self和缩进)上表现出一定的局部性,而非明确的领域特化。 - 这种局部性为优化专家并行和缓存机制提供了可能,例如通过缓存高频专家分配来加速推理。

- 论文通过对专家选择的分析(图 7 和图 8),揭示了路由器在语法结构(如 Python 代码中的

-

开源与社区支持:

- Mixtral 及其指令微调版本在 Apache 2.0 许可下开源,代码和模型权重公开,降低了研究门槛。

- 与 vLLM 和 Skypilot 的集成支持高效部署,为研究者提供了实验 MoE 模型的便利。

对深度学习研究的意义

Mixtral 8x7B 的提出为深度学习研究者带来了以下研究方向的启发:

- 稀疏模型的优化:MoE 架构如何进一步优化路由算法(如动态 K 值或专家选择策略)以提升性能和效率?

- 专家特化与泛化:如何设计训练目标或数据分布,使专家在特定领域(如数学或代码)上实现更强的特化?

- 多语言与长上下文扩展:MoE 模型是否能通过架构调整支持更多语言或更长的上下文长度?

- 高效推理技术:如何结合专家并行、模型并行和缓存机制,进一步降低 MoE 模型在边缘设备上的推理成本?

- 偏见与伦理:Mixtral 在偏见基准上的改进如何通过微调或数据选择进一步增强,减少模型的社会影响?

结论

Mixtral 8x7B 通过稀疏专家混合架构,实现了在较低活跃参数(13B)下超越 Llama 2 70B 和 GPT-3.5 的性能,展现了高效参数利用的潜力。其在多语言、长上下文和偏见控制上的突破,以及开源策略,为深度学习研究者提供了宝贵的资源和研究方向。未来,研究者可基于 Mixtral 探索更高效、更泛化的模型架构,推动大模型在实际应用中的落地。

参考资料:

- 论文原文:https://arxiv.org/abs/2401.04088

- 代码仓库:https://github.com/mistralai/mistral-src

- 官方网页:https://mistral.ai/news/mixtral-of-experts/

MOE数学公式

让我们深入分析论文《Mixtral of Experts》中“2 Architectural Details”节提到的数学公式 ( G ( x ) : = Softmax ( TopK ( x ⋅ W g ) ) G(x) := \text{Softmax}(\text{TopK}(x \cdot W_g)) G(x):=Softmax(TopK(x⋅Wg)) ),并解答你的疑问,包括为什么选择先 TopK 再 Softmax,而不是先 Softmax 再 TopK,以及公式中概率分配的含义。

1. 公式背景与上下文

在 Mixtral 的稀疏专家混合(Sparse Mixture of Experts, SMoE)架构中,每个 Transformer 层的 feedforward 部分被替换为一个 MoE 层。MoE 层包含 ( n n n ) 个专家(在 Mixtral 中 ( n = 8 n = 8 n=8 )),每个专家是一个独立的 feedforward 网络。对于输入向量 ( x x x ),MoE 层的输出是选定专家输出的加权和,权重由路由网络(gating network)生成。公式 ( G ( x ) : = Softmax ( TopK ( x ⋅ W g ) ) G(x) := \text{Softmax}(\text{TopK}(x \cdot W_g)) G(x):=Softmax(TopK(x⋅Wg)) ) 描述了路由网络如何为输入 ( x x x ) 生成专家选择的概率分布。

具体来说:

- ( x x x ) 是输入向量(通常是 Transformer 层中某个 token 的隐藏状态)。

- ( W g ∈ R d × n W_g \in \mathbb{R}^{d \times n} Wg∈Rd×n ) 是路由网络的可学习权重矩阵,( d d d ) 是输入向量的维度,( n n n ) 是专家数量。

- ( x ⋅ W g ∈ R n x \cdot W_g \in \mathbb{R}^n x⋅Wg∈Rn ) 计算出 ( n n n ) 个专家的 logits(未归一化的得分)。

- ( TopK \text{TopK} TopK ) 操作选择 logits 中值最大的 ( K K K ) 个元素(在 Mixtral 中 ( K = 2 K = 2 K=2 ))。

- ( Softmax \text{Softmax} Softmax ) 将这 ( K K K ) 个选中的 logits 转换为概率分布。

MoE 层的输出为:

y

=

∑

i

=

0

n

−

1

G

(

x

)

i

⋅

E

i

(

x

)

,

y = \sum_{i=0}^{n-1} G(x)_i \cdot E_i(x),

y=i=0∑n−1G(x)i⋅Ei(x),

其中 (

G

(

x

)

i

G(x)_i

G(x)i ) 是第 (

i

i

i ) 个专家的权重(概率),(

E

i

(

x

)

E_i(x)

Ei(x) ) 是第 (

i

i

i ) 个专家对输入 (

x

x

x ) 的输出。

2. 公式 ( G ( x ) : = Softmax ( TopK ( x ⋅ W g ) ) G(x) := \text{Softmax}(\text{TopK}(x \cdot W_g)) G(x):=Softmax(TopK(x⋅Wg)) ) 的详细解释

让我们逐步分解公式的工作原理:

2.1. ( x ⋅ W g x \cdot W_g x⋅Wg )

- ( x ⋅ W g x \cdot W_g x⋅Wg ) 是一个线性变换,将输入向量 ( x x x ) 映射到 ( n n n ) 维的 logits 向量 ( ℓ ∈ R n \ell \in \mathbb{R}^n ℓ∈Rn ),其中 ( ℓ i \ell_i ℓi ) 表示第 ( I I I ) 个专家的得分。

- 这些 logits 反映了路由网络对每个专家的“偏好”,但它们是未归一化的原始得分。

2.2. ( TopK ( ℓ ) \text{TopK}(\ell) TopK(ℓ) )

- ( TopK \text{TopK} TopK) 操作从 ( ℓ \ell ℓ) 中选择 ( K K K ) 个最大的 logits,对应于 ( K K K ) 个最“相关”的专家。

- 具体定义为:

( TopK ( ℓ ) ) i = { ℓ i if ℓ i is among the top K values in ℓ , − ∞ otherwise . (\text{TopK}(\ell))_i = \begin{cases} \ell_i & \text{if } \ell_i \text{ is among the top } K \text{ values in } \ell, \\ -\infty & \text{otherwise}. \end{cases} (TopK(ℓ))i={ℓi−∞if ℓi is among the top K values in ℓ,otherwise. - 这意味着非 Top-K 的专家的 logits 被设置为 ( − ∞ -\infty −∞ ),确保它们在后续 Softmax 中不会有任何贡献。

- 在 Mixtral 中,( K = 2 K = 2 K=2 ),所以只有两个专家的 logits 保留原始值,其余的被置为 ( − ∞ -\infty −∞ )。

2.3. ( Softmax ( TopK ( ℓ ) ) \text{Softmax}(\text{TopK}(\ell)) Softmax(TopK(ℓ)) )

- Softmax 操作将输入的 logits 转换为概率分布:

G ( x ) i = Softmax ( TopK ( ℓ ) ) i = exp ( ( TopK ( ℓ ) ) i ) ∑ j = 0 n − 1 exp ( ( TopK ( ℓ ) ) j ) . G(x)_i = \text{Softmax}(\text{TopK}(\ell))_i = \frac{\exp((\text{TopK}(\ell))_i)}{\sum_{j=0}^{n-1} \exp((\text{TopK}(\ell))_j)}. G(x)i=Softmax(TopK(ℓ))i=∑j=0n−1exp((TopK(ℓ))j)exp((TopK(ℓ))i). - 由于非 Top-K 专家的 logits 是 ( − ∞ -\infty −∞ ),它们的指数 ( exp ( − ∞ ) = 0 \exp(-\infty) = 0 exp(−∞)=0 )。因此,只有 Top-K 专家的概率非零,且这 ( K K K ) 个专家的概率之和为 1。

- 例如,假设 (

n

=

8

n = 8

n=8 ),(

K

=

2

K = 2

K=2 ),TopK 选中的专家是 (

i

=

3

i=3

i=3 ) 和 (

i

=

5

i=5

i=5 ),它们的 logits 分别为 (

ℓ

3

\ell_3

ℓ3 ) 和 (

ℓ

5

\ell_5

ℓ5 )。那么:

G ( x ) 3 = exp ( ℓ 3 ) exp ( ℓ 3 ) + exp ( ℓ 5 ) , G ( x ) 5 = exp ( ℓ 5 ) exp ( ℓ 3 ) + exp ( ℓ 5 ) , G(x)_3 = \frac{\exp(\ell_3)}{\exp(\ell_3) + \exp(\ell_5)}, \quad G(x)_5 = \frac{\exp(\ell_5)}{\exp(\ell_3) + \exp(\ell_5)}, G(x)3=exp(ℓ3)+exp(ℓ5)exp(ℓ3),G(x)5=exp(ℓ3)+exp(ℓ5)exp(ℓ5),

而其他专家的 ( G ( x ) i = 0 G(x)_i = 0 G(x)i=0 )(因为 ( exp ( − ∞ ) = 0 \exp(-\infty) = 0 exp(−∞)=0 ))。

2.4. 概率分配的含义

- Top-K 专家的概率:只有选中的 ( K K K ) 个专家被分配非零概率,且它们的概率之和为 1。这是因为 Softmax 是在 TopK 操作后的 ( K K K ) 个 logits 上计算的。

- 非 Top-K 专家的概率:由于它们的 logits 被置为 ( − ∞ -\infty −∞ ),概率为 0。这意味着这些专家对当前 token 的处理没有贡献。

- 因此,你的理解是正确的:概率计算仅在 ( K K K ) 个选中的专家之间进行,( K K K ) 个专家的概率和为 1,其他 ( n − K n-K n−K ) 个专家的概率为 0。

3. 为什么先 TopK 再 Softmax,而不是先 Softmax 再 TopK?

你的疑问非常关键:为什么不先对所有 ( n n n ) 个专家的 logits 应用 Softmax,生成一个完整的概率分布,然后再选择 Top-K 个专家?让我们分析两种方法的区别和设计动机。

3.1. 先 TopK 再 Softmax(Mixtral 的方法)

- 流程:

- 计算 logits ( ℓ = x ⋅ W g \ell = x \cdot W_g ℓ=x⋅Wg )。

- 选择 Top-K logits,设置非 Top-K logits 为 ( − ∞ -\infty −∞ )。

- 对处理后的 logits 应用 Softmax,生成概率分布。

- 效果:

- 只有 ( K K K ) 个专家被激活,概率分配仅在这 ( K K K ) 个专家之间,非 Top-K 专家的概率严格为 0。

- 路由决策是“硬性”的:通过 TopK 明确选择 ( K K K ) 个专家,然后在这 ( K K K ) 个专家间分配权重。

- 这种方法直接限制了计算成本,因为只有 ( K K K ) 个专家的输出 ( E i ( x ) E_i(x) Ei(x) ) 需要计算。

- 优点:

- 计算效率:通过在 Softmax 前裁剪 logits,模型避免了对所有 ( n n n ) 个专家进行概率计算和输出计算,推理成本与 ( K K K ) 成正比,而非 ( n n n )。

- 稀疏性:强制非 Top-K 专家的权重为 0,符合 MoE 架构的稀疏激活目标,减少内存和计算开销。

- 简单实现:TopK 是一个确定性操作,易于在硬件上优化(如 Megablocks 内核)。

- 缺点:

- 路由决策可能过于“硬性”,忽略了非 Top-K 专家的潜在贡献。

- 如果 TopK 选择不准确(例如由于训练不足),可能导致次优的专家分配。

3.2. 先 Softmax 再 TopK

- 流程:

- 计算 logits ( ℓ = x ⋅ W g \ell = x \cdot W_g ℓ=x⋅Wg )。

- 对所有 ( n n n ) 个专家的 logits 应用 Softmax,生成概率分布 ( p i = exp ( ℓ i ) ∑ j exp ( ℓ j ) p_i = \frac{\exp(\ell_i)}{\sum_j \exp(\ell_j)} pi=∑jexp(ℓj)exp(ℓi) )。

- 选择概率最高的 ( K K K ) 个专家,将其他专家的概率置为 0,并重新归一化 Top-K 专家的概率(使之和为 1)。

- 效果:

- 所有 ( n n n ) 个专家最初都有非零概率,Softmax 考虑了所有专家的相对得分。

- TopK 操作在概率空间中选择 ( K K K ) 个专家,可能导致概率分布的“截断”。

- 重新归一化后,Top-K 专家的概率和仍为 1,非 Top-K 专家的概率为 0。

- 优点:

- 更平滑的路由:Softmax 考虑了所有专家的 logits,可能捕捉到更细微的专家相关性,尤其当 logits 分布较为均匀时。

- 潜在的鲁棒性:在训练初期,logits 可能不稳定,先 Softmax 可能帮助模型探索更多专家组合。

- 缺点:

- 计算开销:需要在所有 ( n n n) 个专家上计算 Softmax,这增加了计算成本,尤其当 ( n ) 很大时。

- 稀疏性减弱:即使最终只用 ( K K K ) 个专家,Softmax 的计算仍涉及所有专家,违背了 MoE 稀疏激活的核心目标。

- 复杂性:重新归一化概率分布增加了实现复杂性,且可能引入数值稳定性问题(例如当所有概率都很小时)。

3.3. 设计选择的原因

Mixtral 选择先 TopK 再 Softmax 的主要原因可以归结为以下几点:

-

稀疏性和效率优先:

- MoE 架构的核心目标是稀疏激活,即每个 token 只由少数专家处理。先 TopK 直接裁剪非 Top-K 专家,确保只有 ( K K K ) 个专家参与后续计算,符合高效推理的需求。

- 先 Softmax 再 TopK 需要对所有 ( n n n ) 个专家计算概率,增加了不必要的开销,尤其在 ( n ) 较大(如未来扩展到数百个专家)时。

-

与硬件优化的兼容性:

- TopK 是一个简单的排序操作,易于在 GPU 上并行化。Megablocks 等专用内核可以高效处理稀疏矩阵运算,而先 TopK 减少了 Softmax 的输入规模,降低了计算复杂度。

- 先 Softmax 涉及全专家的指数运算和归一化,难以利用稀疏矩阵优化。

-

训练与推理一致性:

- 先 TopK 再 Softmax 的路由决策在训练和推理中是一致的,简化了模型开发流程。

- 先 Softmax 再 TopK 可能需要在训练时引入额外的正则化(例如鼓励稀疏性),否则 Softmax 可能导致过于分散的概率分布,影响专家特化。

-

实际效果的验证:

- 论文的结果表明,Mixtral 的路由机制(先 TopK 再 Softmax)在多种基准测试中表现优异,证明了该设计的有效性。

- 路由分析(第 5 节)显示,专家选择表现出局部性和语法相关性,表明 TopK 策略足以捕捉关键模式,无需全专家的 Softmax。

3.4. 为什么非 Top-K 专家概率为 0?

- 如前所述,TopK 操作将非 Top-K 专家的 logits 置为 ( − ∞ -\infty −∞ ),导致 ( exp ( − ∞ ) = 0 \exp(-\infty) = 0 exp(−∞)=0 )。这是一种“硬性”稀疏策略,确保只有选中的 ( K K K ) 个专家对输出有贡献。

- 如果先 Softmax 再 TopK,非 Top-K 专家在 Softmax 后可能有微小的非零概率,但 TopK 操作会强制将这些概率置为 0。两种方法最终都会使非 Top-K 专家的权重为 0,但先 TopK 避免了不必要的 Softmax 计算。

4. 进一步的思考

你的疑问触及了 MoE 路由机制设计的核心问题:如何平衡稀疏性、计算效率和路由的准确性?以下是一些扩展讨论:

-

替代路由策略:

- 论文提到其他路由方法(参考 [6, 15, 35]),如可微分的专家选择(DSelect-K)或专家选择路由(Expert Choice Routing)。这些方法可能在 Softmax 和 TopK 之间采取不同的折衷,例如通过加权 Softmax 鼓励稀疏性。

- 未来的研究可以探索自适应 ( K K K ),根据输入复杂性动态调整激活的专家数量。

-

训练时的探索性:

- 先 TopK 再 Softmax 的硬性选择可能在训练初期限制模型探索次优专家。一些工作通过引入噪声(如 Gumbel-Softmax)或辅助损失(如负载平衡损失)来改善路由的多样性。

- Mixtral 使用了负载平衡策略(未在论文中详细描述),可能通过正则化确保专家分配均匀。

-

概率分布的语义:

- 先 TopK 再 Softmax 的概率分布仅反映 ( K K K ) 个专家的相对重要性,而非所有专家的全局分布。这可能导致路由决策更依赖于 logits 的绝对值差异,而非相对分布。

- 先 Softmax 再 TopK 可能更适合需要全局概率信息的场景,但需要额外的机制来强制稀疏性。

5. 总结

公式 ( G ( x ) : = Softmax ( TopK ( x ⋅ W g ) ) G(x) := \text{Softmax}(\text{TopK}(x \cdot W_g)) G(x):=Softmax(TopK(x⋅Wg)) ) 通过先 TopK 再 Softmax 的方式,实现了一个高效的稀疏路由机制:

- 概率分配:只有 ( K K K ) 个 Top-K 专家被分配非零概率,且概率之和为 1;非 Top-K 专家的概率为 0,因为它们的 logits 被置为 ( − ∞ -\infty −∞ )。

- 先 TopK 的原因:优先保证稀疏性和计算效率,避免对所有专家进行 Softmax 计算,符合 MoE 架构的优化目标,并与硬件加速(如 Megablocks)兼容。

- 先 Softmax 的局限:虽然可能提供更平滑的路由,但增加了计算开销,违背了稀疏激活的目标,且实现更复杂。

Mixtral 的设计选择反映了在效率、性能和实现简便性之间的权衡。通过将非 Top-K 专家的贡献直接置零,模型显著降低了推理成本,同时在多项基准测试中表现出色。对于深度学习研究者,这一公式提供了一个值得深入研究的起点,例如探索更灵活的路由策略或优化专家选择的鲁棒性。

后记

2025年5月7日于上海,在grok 3大模型辅助下完成。

781

781

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?