目录

一 主要针对自动驾驶:

1.KITTI数据集:

http://www.cvlibs.net/datasets/kitti/index.php

(RGB+Lidar+GPS+IMU)

-

KITTI数据集由德国卡尔斯鲁厄理工学院和丰田美国技术研究院联合创办,是目前国际上最大的自动驾驶场景下的计算机视觉算法评测数据集。该数据集用于评测立体图像 (stereo),光流 (optical flow),视觉里程计(visual odometry),3D物体检测 (object detection) 和 3D跟踪 (tracking)等计算机视觉技术在车载环境下的性能。KITTI包含市区、乡村和高速公路等场景采集的真实图像数据,每张图像中最多达15辆车和30个行人,还有各种程度的遮挡与截断。

-

Andreas Geiger and Philip Lenz and Raquel Urtasun, Are we ready for Autonomous Driving? The KITTI Vision Benchmark Suite, CVPR'12, cited by 3000+

-

该数据集论文共8页,主要由三部分组成:Introduction、Challenges and Methodolgy、Evaluation:

-

Introduction:列一下相关的开源数据集;说明自己做这个数据集的原因(现有数据集都过分简单,严格限制路况从而没有包含现实路上的实际情况等);介绍自己数据集的采集方式、包含的内容等;

-

Challenges and Methodolgy:主要写了数据采集会遇到的问题以及要做的所有事情。如,传感 setup;标定方式;groundtruth怎么获取;如何选取好的数据作为benchmark;评价标准。

-

Experimental Evaluation:将state-of-the-art的系统在自己的数据集上跑结果&对比&分析。

-

2.Oxford数据集 :

http://robotcar-dataset.robots.ox.ac.uk/datasets/(RGB+Lidar+GPS+IMU)

-

自动驾驶数据集。对牛津的一部分连续的道路进行了上百次数据采集,收集到了多种天气行人和交通情况下的数据,也有建筑和道路施工时的数据,总的数据长度达1000小时以上。

-

W. Maddern, G. Pascoe, C. Linegar and P. Newman, "1 Year, 1000km: The Oxford RobotCar Dataset" The International Journal of Robotics Research (IJRR), 2016. cited by 200+

3.其余自动驾驶相关数据集有:

-

Cityscape, Comma.ai, BDDV, TORCS, Udacity, GTA, CARLA, Carcraft

二 包含Depth的SLAM与三维重建数据集:

1.ASL Kinect数据集

http://projects.asl.ethz.ch/datasets/doku.php

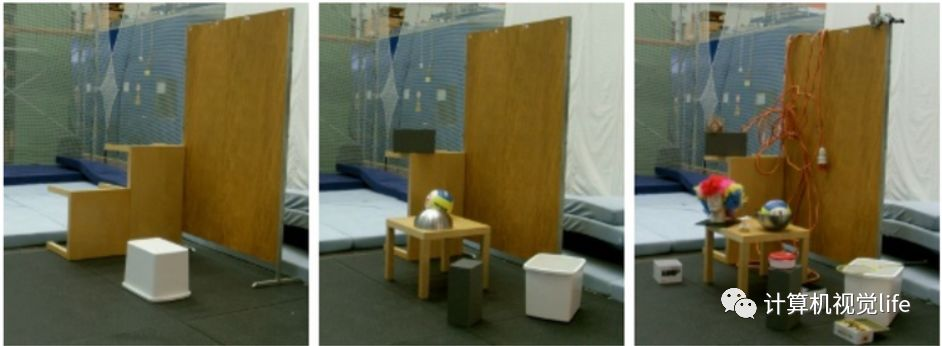

由Kinect采集的包含三种不同难度的27个序列,GT得自Vicon,采集场景如下:

-

F. Pomerleau, S. Magnenat, F. Colas, M. Liu, R. Siegwart, "Tracking a Depth Camera: Parameter Exploration for Fast ICP", IROS 2011, cited 91

-

论文主要内容:开源了一个基于ROS的模块化的ICP库,可以快速的测试不同变种ICP的参数和性能; 然后开源自己采集的这个数据集,并在该数据集的基础上做实验,考虑了depth的噪声,采集频率,FOV等因素对ICP的影响。

2.ASL RGB-D 数据集

http://projects.asl.ethz.ch/datasets/doku.phpid=kmavvisualinertialdatasets#downloads

-

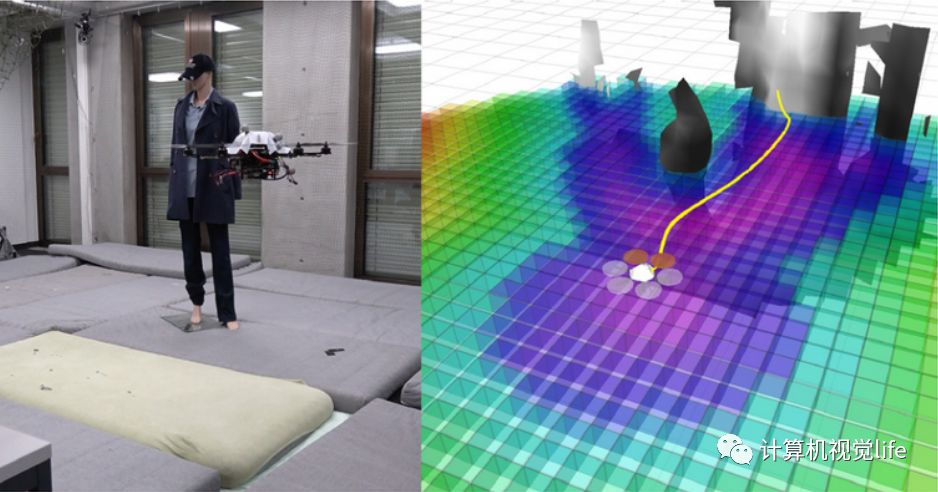

就一个序列,但是其论文主要是提出一个系统,不是将开源数据集作为贡献。数据集:RGB-D,轨迹的GT来自Vicon,并用Lidar得到场景结构的GT(点云)

-

Helen Oleynikova, Zachary Taylor, Marius Fehr, Juan Nieto, and Roland Siegwart, “Voxblox: Building 3D Signed Distance Fields for Planning”, IROS'17, cited 40

这篇论文主要做的问题是机器人路径规划需要的建图:是用 Euclidean Signed Distance Fields (ESDFs) 而非 Octomap(路径规划常用地图)来建立四轴飞行器优化路径需要的地图;他们的主要贡献是提出方法使得在飞行器上基于CPU能实时地完成从建立的TSDF图中提取ESDF并完成路径规划。

3.TUM RGB-D:

http://vision.in.tum.de/data/datasets/rgbd-dataset/download

-

数据集包含一些室内的序列,在不同的纹理下,不同的光照和不同的结构条件,从Kinect传感器采集到的数据中分别去评估物体的重建和SLAM/视觉里程计的性能。但是这个数据集还是没有完整的IMU。

-

J. Sturm and N. Engelhard and F. Endres and W. Burgard and D. Cremers,A Benchmark for the Evaluation of RGB-D SLAM Systems, IROS'12, cited 1200+

-

它们来自于慕尼黑工业大学(TUM)提供的公开 RGB-D 数据集‹。以后我们就称之为 TUM 数据集。它含有许多个 RGB-D 视频,可以作为 RGB-D 或单目 SLAM 的实验数据。它还提供了用运动捕捉系统测量的精确轨迹,可以作为标准轨迹以校准 SLAM 系统。

4.ICL-NUIM:

http://www.doc.ic.ac.uk/~ahanda/VaFRIC/iclnuim.html

-

虚拟数据集,但是没有IMU。该集旨在对RGB-D、视觉测距和SLAM算法进行基准测试。两个不同的场景(起居室和办公室场景)提供了基本事实。客厅具有3D表面地面实况以及深度图和相机姿势,用于标记相机轨迹而且还用于重建。办公室场景仅带有轨迹数据,并且没有任何明确的3D模型。

-

A. Handa and T. Whelan and J.B. McDonald and A.J. Davison, A Benchmark for {RGB-D} Visual Odometry, {3D} Reconstruction and {SLAM} ,ICRA‘14,cited 340

5.VaFRIC:

http://www.doc.ic.ac.uk/~ahanda/VaFRIC/index.html

-

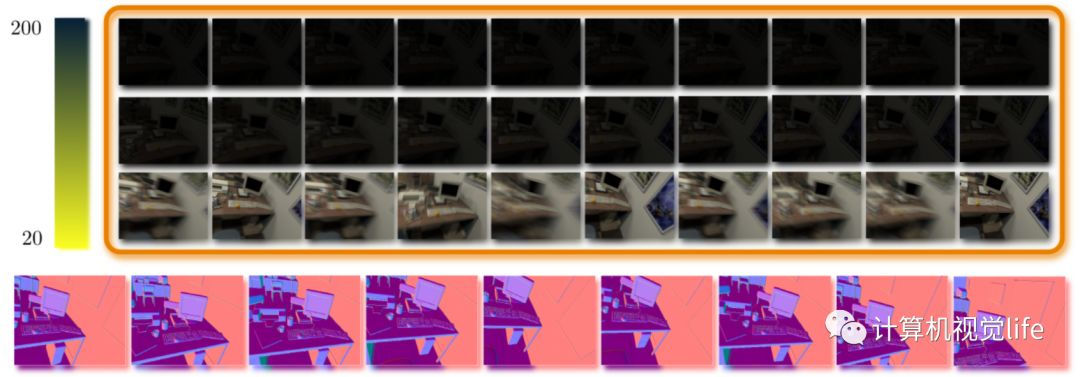

虚拟数据集,没有IMU。ICL-NUIM的同一个团队,这个数据集只有一个目的,测试不同曝光时间对相机跟踪的影响,我的想法的萌芽。网站有提供一些做虚拟数据集的方法

-

A. Handa and R. A. Newcombe and A. Angeli and A. J. Davison, Real-Time Camera Tracking: When Is High Frame-Rate Best? , ECCV'12 , cited 100+

三 不含Depth的SLAM数据集:

1.ASL EuRoC:

http://projects.asl.ethz.ch/datasets/doku.phpid=kmavvisualinertialdatasets

-

双目RGB+IMU,GT来自于Vicon和Lidar,EuRoC。数据集包含11个双目序列,这些序列是由微型飞行器在两个不同的房间和一个大型工业环境中飞行时记录下来的。提供两种类型的数据集: 第一个包含来自Leica多站的三维位置地面真值,并着重于视觉惯性的评估SLAM算法在一个真实的工业场景。

-

M. Burri, J. Nikolic, P. Gohl, T. Schneider, J. Rehder, S. Omari, M. Achtelik and R. Siegwart, The EuRoC micro aerial vehicle datasets, (IJRR'16 ) cited 258

-

IJRR是机器人顶刊,SCI一区,该论文应该是约稿。论文分三部分:1. 传感器的组装以及坐标的设定;2. 所采集数据集的细节描述以及如何使用;3. 如何标定传感器以及GT。

2.TUM VI banchmark:

http://vision.in.tum.de/data/datasets/visual-inertial-dataset (fisheye+IMU)

-

Schubert, D.Goll, T.Demmel, N.Usenko, V. Stuckler, J.& Cremers, D. (2018). The TUM VI Benchmark for Evaluating Visual-Inertial Odometry. IROS'18

-

开源做的非常好,给的信息非常详细,但公开的比较晚,有上一个工作在了,所以这个工作的引用还上不去。

3.TUM monoVO:

http://vision.in.tum.de/data/datasets/mono-dataset

(fisheye-only)

-

A Photometrically Calibrated Benchmark For Monocular Visual Odometry (J. Engel, V. Usenko and D. Cremers), arXiv16

-

论文没有正式发表,主要写了光度标定校准等的方法以及与一些开源数据集的比对。该数据集很少人用,主要是给他们自己的DVO用。

4.TUM LSD :

-

Large-Scale Direct SLAM for Omnidirectional Cameras (D. Caruso, J. Engel and D. Cremers), In International Conference on Intelligent Robots and Systems (IROS), 2015. cited 100+

四 包含语义的数据集:

1.NYU:

http://cs.nyu.edu/~silberman/datasets/nyu_depth_v2.html

-

kinect采集的主要针对语义分割的数据集。RGB-D序列+手标label

-

Nathan Silberman, Pushmeet Kohli, Derek Hoiem, Rob Fergus, Indoor Segmentation and Support Inference from RGBD Images,ECCV'12

2.Matterport 3D:

http://niessner.github.io/Matterport/

-

用18对RGB-D图像生成全景图, 主要做语义分割,有90个场景

-

Chang, Angel and Dai, Angela and Funkhouser, Thomas and Halber, Maciej and Niessner, Matthias and Savva, Manolis and Song, Shuran and Zeng, Andy and Zhang, Yinda, Matterport3D: Learning from RGB-D Data in Indoor Environments, 3DV'17

3.ScanNet:

http://www.scan-net.org/#code-and-data

-

作者Angela Dai在BundleFusion后的下一个工作。是真实世界数据集,主要针对语义分割。数据集的生成方式是通过利用BundleFusion将不同用户基于structure io采集的RGB-D序列重建成场景三维模型,在模型的基础上打语义标签,然后再将语义信息重投影回每张图片上生成图像的语义GT。

-

Dai, Angela and Chang, Angel X. and Savva, Manolis and Halber, Maciej and Funkhouser, Thomas and Niener, Matthias, ScanNet: Richly-annotated 3D Reconstructions of Indoor Scenes,CVPR’17

4.InteriorNet:

http://interiornet.org/

-

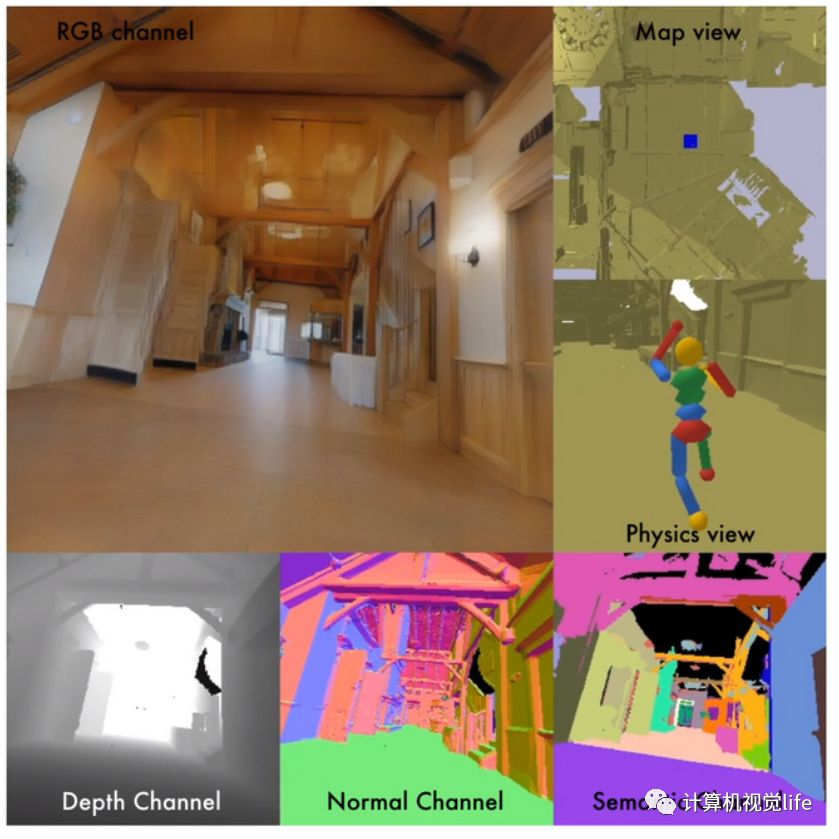

目前发现的唯一一个同时包含RGB-D-IMU的(虚拟)数据集。有非常多的场景,做的也非常专业,提供了语义标签,fisheye,模拟了快速相机运动以及图像模糊。遗憾的是数据集还没有开放下载。

-

Wenbin Li and Sajad Saeedi and John McCormac and Ronald Clark and Dimos Tzoumanikas and Qing Ye and Yuzhong Huang and Rui Tang and Stefan Leutenegger, InteriorNet: Mega-scale Multi-sensor Photo-realistic Indoor Scenes Dataset, British Machine Vision Conference (BMVC) 2018

5.Stanford 2D-3D-Semantics:

http://buildingparser.stanford.edu/dataset.html

-

提供大尺度场景的三维以及语义信息,是由采集的全景图生成,数据集主要是拿来做Building Parsing的。

Gibson+Environment

-

提供大量真实场景的三维模型,包含纹理、几何以及语义,以此来模拟训练移动机器人的感知能力(AI系统)

6.SUNCG:

http://sscnet.cs.princeton.edu/

-

用虚拟场景渲染单个视角的彩色深度和语义,主要拿来做基于单帧图像的语义场景修复。

-

Shuran Song, Fisher Yu, Andy Zeng, Angel X. Chang, Manolis Savva, Thomas Funkhouser,Semantic Scene Completion from a Single Depth Image,CVPR 2017

五. 三维语义场景理解的数据集

在自动驾驶领域,场景理解至关重要。本文介绍用于三维场景理解的数据集,数据集分为室内和室外。随着深度学习的发展,数据集的意义愈发重要,本节将介绍三维场景理解领域常用的数据集。依据场景类型不同,可划分为室内场景数据集和室外场景数据集,数据集汇总见表1与表2。

1.室内场景数据集

室内场景数据集多由 RGBD 相机采集,可得到 RGB 图像和深度图像。根据深度图像可以计算得到空间中的三维点云,对基于数据驱动的三维点云算法研究有较大促进意义。这里介绍常用的室内场景数据集:

• NYUv2[1]:数据集地址:https://cs.nyu.edu/~silberman/datasets/nyu\_depth\_v2.html。该数据集提供了 1449 张 RGBD 图像,并对图像进行了像素级标注,可用于语义分割和实例分割。根据 RGB 图和深度图,可以自行计算得到对应的三维点云,进行三维点云数据的语义分割和实例分割。提供的数据中, 795 张用于训练, 654 张用于测试。

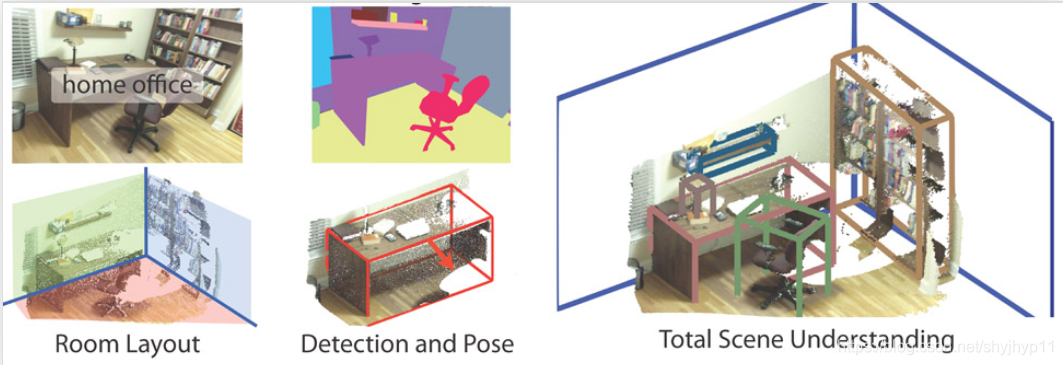

• Sun RGB-D[2]:数据集地址:http://rgbd.cs.princeton.edu/。该数据提供了 10335 张 RGBD 图像,来源于 NYUv2 数据集[1]、 Berkeley B3DO 数据集[3] 和 SUN3D 数据集[4]。其提供了图像语义分割、 2D 边界框、 3D 边界框、物体朝向、场景类别、房间布局等多种标注,可用于语义分割、目标检测、场景识别等多种任务。其提供了通过 RGB 图和深度图生成的点云数据,可进行三维点云的分割、检测。提供的数据中,一半用于训练,一半用于测试。

• SceneNN[5]: 数据集地址:http://www.scenenn.net/。该数据集提供了 100 个标注的室内点云建图场景,以三角网格的形式提供,并对每个图像像素和每个网格节点均进行了语义标注,同时标注了边界框和物体姿态信息,可用于图像和点云的分割、检测等任务。

• 2D-3D-S[6]: 数据集地址:http://buildingparser.stanford.edu/dataset.html。该数据集提供了 270 个标注的室内点云建图场景,分布在 6 个不同的区域。其对图像和点云进行了实例级别的语义标注,可用于语义分割和实例分割。该数据集同时提供了表面法向量的真值。官方建议的训练集和测试集的划分为 3-fold 交叉验证。

• ScanNetv2[7]: 数据集地址:http://www.scan-net.org/。该数据集提供了 1613 个标注的室内点云建图场景,进行了语义和实例级别的标注,可用于图像和点云的语义分割、实例分割,也可以在此数据集上进行场景识别任务。1201 个场景用于训练, 312 个场景用于验证,另外有 100 个场景用于官方在线测试。

• Matterport3D[8]: 数据集地址:https://niessner.github.io/Matterport。该数据集使用了三组彩色相机和深度相机,通过旋转360 度、并进行拼接得到全景图片。其共采集来自于 90 个教学楼场景下的 194400 张 RGBD 图片,拼接得到 10800 张三维全景图片和对应的三维场景。每个场景均进行了实例级别的语义标注,可用于图像和点云的语义分割、实例分割、表面法向量估计。提供的标注数据中, 61 个教学楼场景用于训练, 11 个用于验证, 18 个用于测试。

• SceneNet RGB-D[9]: 数据集地址:https://robotvault.bitbucket.io/scenenet-rgbd.html。不同于前述数据集,该数据集不是真实场景采集的数据,而是合成数据集。其提供了约 5000000 张 RGBD 图片用作训练,以及300000 张作为验证和测试。该数据集可用作语义分割、实例分割和目标检测等任务。和NYUv2 数据集类似,虽然该数据集未直接提供三维点云,但可以通过 RGB 图和深度图间接计算获得。

file

2.室外场景数据集

近年来,自动驾驶在国内外都受到广泛关注与大量研究[23-25],许多针对室外场景的数据集也陆续开源。开源者中不乏一些自动驾驶明星公司,体现了行业内对三维场景数据集的重视程度。这里介绍常用的室外场景数据集:

• Oakland[10]: 数据集地址:https://www.cs.cmu.edu/ ~vmr/ datasets/oakland_3d/ cvpr09 /doc/。该数据集提供了坐落于奥克兰的卡耐基梅隆大学的校园点云场景,其使用 SICK 单线激光雷达采集。场景全长为 1510 米,对每个点进行了语义类别标注,包含 44 个类别,可用于三维点云数据的语义分割。实际使用时,该 44 个类别数被重新映射为 5 个类别。该数据集的训练集包含36932 个点,验证集包含 91579 个点,测试集包含 1300000 个点。

• Paris-rue-Madame[11]: 数据集地址:http://www.cmm.mines-paristech.fr/~serna/rueMadameDataset.html。该数据集提供了巴黎街道场景的点云地图,长度约为160 米,使用 Velodyne HDL-32E 激光雷达采集,标注了 17 个类别,可用于三维点云数据的语义分割。该数据集提供了两段点云场景文件,共包含两百万个点。

• iQmulus[12]: 数据集地址:http://data.ign.fr/benchmarks/UrbanAnalysis/。该数据集采集了巴黎城市环境下的三维点云地图,全长 210米,包含约 3 亿个点。其使用Riegl LMS-Q120i 激光雷达进行采集,该雷达相比 Velodyne 激光雷达,所产生的点更加稠密。每个点标注了一个语义类别和实例标签,可用于三维点云的语义分割和实例分割。

• VKITTI[13, 14]: 数据集地址:https://europe.naverlabs.com/Research/Computer-Vision/Proxy-Virtual-Worlds/。该数据集为合成数据集,模拟了城市场景下的道路环境。其提供了 50 段视频,共计 21260 帧RGB 图和深度图,可用于图像的语义分割、实例分割、目标检测等任务。根据深度图和内外参矩阵,可生成对应的三维点云数据,进行点云上的语义理解。

• Semantic3D[15]: 数据集地址:http://www.semantic3d.net/。该数据集提供了 30 个无重叠的室外点云建图场景, 15 个场景用于训练, 15 个用于测试,使用静态地基激光雷达 (Terrestrial Laser Scanner, TLS) 采集。对每个点进行标注,包含 8 个类别,可用于三维点云数据的语义分割。30 个场景涵盖城市、郊区和乡村场景。由于采集设备的特性,该数据集点云数量巨大,达到 40 亿个点。除了三维坐标,该数据集同时提供了每个点对应的 RGB 值和强度值。

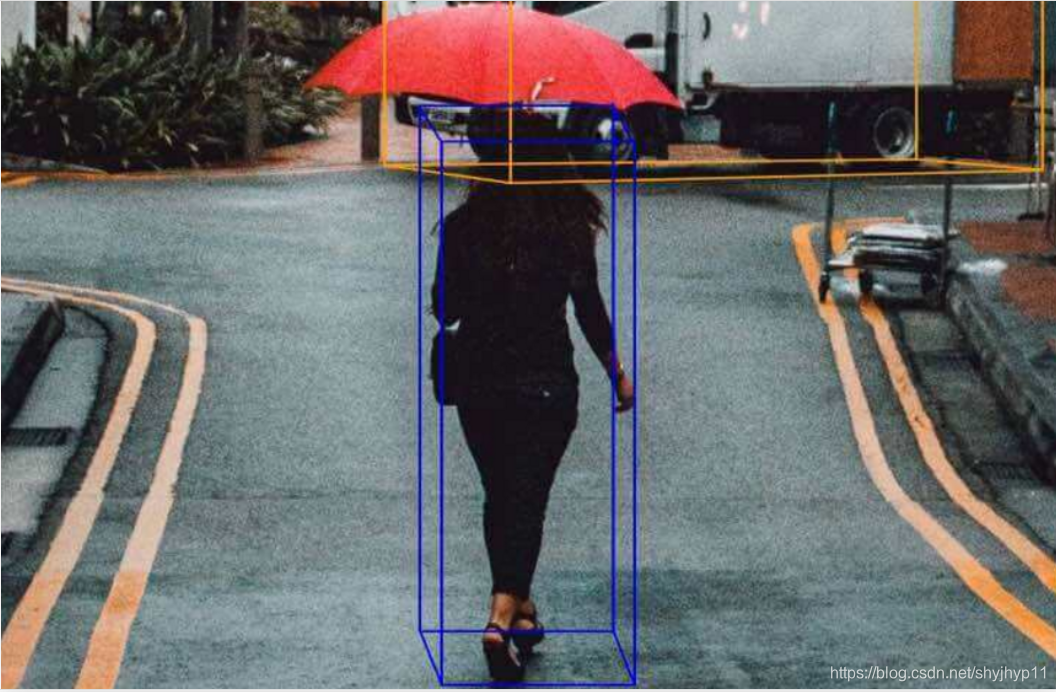

• Kitti 3D Object[14]: 数据集地址:http://www.cvlibs.net/datasets/kitti/eval\_object.php ?obj_benchmark=3d。该数据集提供了 14999 帧数据,同时包含图像和对应的点云,是专用于自动驾驶的数据集。其中,训练集包含 7481 帧,测试集包含 7518 帧。该数据集对前视范围内的点云进行了约 20 万个 3D 边界框的标注,类别有三种,分别为车辆、行人、自行车,可用作三维点云的目标检测。

• TUM[16]: 数据集地址:https://www.iosb.fraunhofer.de/servlet/is/71820。该数据集提供了德国慕尼黑城市道路场景下的三维点云数据,共计 17756 帧数据,数据采集时间约 15 分钟,由两个 Velodyne HDL-64E 激光雷达共同采集。其中部分数据标注了点的语义类别,标注的数据量为每个雷达 800 帧,这部分数据可用于三维点云数据的语义分割。

• Paris-Lille-3D[17]: 数据集地址:http://npm3d.fr/。该数据集提供了法国巴黎和里尔两个地区的点云地图,使用一个倾斜安装的 Velodyne HDL-32E 激光雷达采集,总长度共计 1940米。训练集包含三段场景,标注了 50 个类别,测试集包含三段场景,标注了 10 个类别,可用于三维点云数据的语义分割。实际使用时,需要将训练集的 50 个类别重映射为测试的 10 个类别。

• ApolloScape Scene[18]:数据集地址:http://apolloscape.auto/scene.html。该数据集提供了城市道路场景下 146997 帧 RGB 图和深度图,并提供了语义级别和实例级别的标注。根据深度图和内外参矩阵,可生成三维点云数据。值得注意的是,该数据集提供的深度图只包含静态物体,动态物体已被事先滤除。

• ApolloScape LIDAR[19]:数据集地址:http://apolloscape.auto/tracking.html。该数据集为 ApolloScape 提供的另一类数据,用于三维点云的检测与跟踪任务。其提供了约20000 帧点云数据,标注了 3D边界框及跟踪信息。

• SemanticKitti[14, 20]:数据集地址:http://semantic-kitti.org/。该数据来源于 KITTI[14] 里程计数据集,使用 VelodyneHDL-64E 激光雷达采集,后由 [20] 标注了每个点的语义类别。其共包含 22段连续序列,前 11 段为训练集,后 11 段为测试集,共计 43552 帧点云,可用作三维点云数据的语义分割以及基于语义信息的建图与定位。

• nuScenes[21]: 数据集地址:https://www.nuscenes.org/。该数据集提供了 1000 段连续采集数据,每段持续 20 秒、包含 40 帧图像和点云的边界框信息,共计 40000 帧标注数据。其使用 6 个相机和 1 个 32 线激光雷达进行数据采集,同时提供毫米波雷达的信息。

• Waymo[22]: 数据集地址:https://waymo.com/open/。该数据集提供了用于自动驾驶的三维点云数据集,包含 1000段连续采集数据,每段长度 20 秒,共计 20 万帧图像和点云数据。使用 5 个相机和 5 个激光雷达进行数据采集,其中 1 个为中距离激光雷达, 4 个为短距离激光雷达。其为点云标注了 3D 边界框,可用于三维点云的目标检测。

补充:

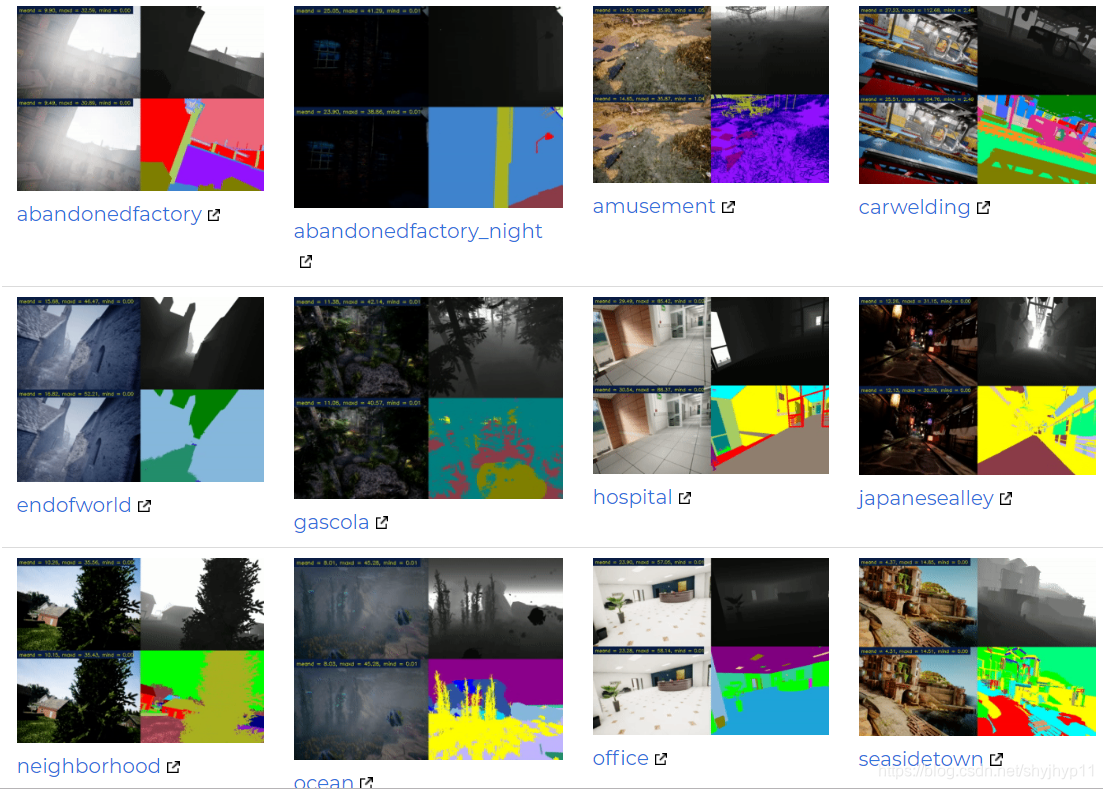

TartanAir: A Dataset to Push the Limits of Visual SLAM http://theairlab.org/tartanair-dataset/

挑战赛主页:https://sites.google.com/view/vislocslamcvpr2020/slam-challenge

参考:

- 超全的 3D 视觉数据集汇总:

- KITTI数据集 https://www.cvlibs.net/datasets/kitti/raw\_data.php

- Cityscapes https://www.cityscapes-dataset.com/

- 牛津数据集 https://robotcar-dataset.robots.ox.ac.uk/datasets/

- ApolloScape https://apolloscape.auto/

- BDD100K https://bdd-data.berkeley.edu/

- Waymo Open Dataset https://github.com/waymo-research/waymo-open-dataset

- nuScenes数据集 https://www.nuscenes.org/download

- 3D Photography Dataset https://www-cvr.ai.uiuc.edu/ponce\_grp/data/mview/

- Matterport 3D重建数据集 https://matterport.com/

- NoW Dataset https://ringnet.is.tue.mpg.de/challenge

- Pix3D https://pix3d.csail.mit.edu/

- Replica Dataset https://github.com/facebookresearch/Replica-Dataset

- Scan2CAD https://github.com/skanti/Scan2CAD

- ScanNet https://www.scan-net.org/

- NYC3Dcars https://nyc3d.cs.cornell.edu/

- Expressive Hands and Faces https://smpl-x.is.tue.mpg.de/

- TUM数据集 https://vision.in.tum.de/

- EUROC数据集 https://projects.asl.ethz.ch/datasets/doku.php?id=kmavvisualinertialdatasets

- 最强战队 | 三维视觉、SLAM方向全球顶尖实验室汇总

本文汇总了多个针对自动驾驶、SLAM、三维重建和语义理解的重要数据集,包括KITT、Oxford数据集、TUM RGB-D、ICL-NUIM、EuRoC等,涵盖了室内、室外场景,包含RGB、Depth、IMU等多种传感器数据,对于自动驾驶和三维视觉算法的研究极具价值。

本文汇总了多个针对自动驾驶、SLAM、三维重建和语义理解的重要数据集,包括KITT、Oxford数据集、TUM RGB-D、ICL-NUIM、EuRoC等,涵盖了室内、室外场景,包含RGB、Depth、IMU等多种传感器数据,对于自动驾驶和三维视觉算法的研究极具价值。

2659

2659

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?