文章目录

如何降低Transformer的计算复杂度

Efficient Transformers.

本文目录:

- Transformer的计算复杂度

- 改进自注意力机制

1. Transformer的计算复杂度

(1) Transformer的典型结构

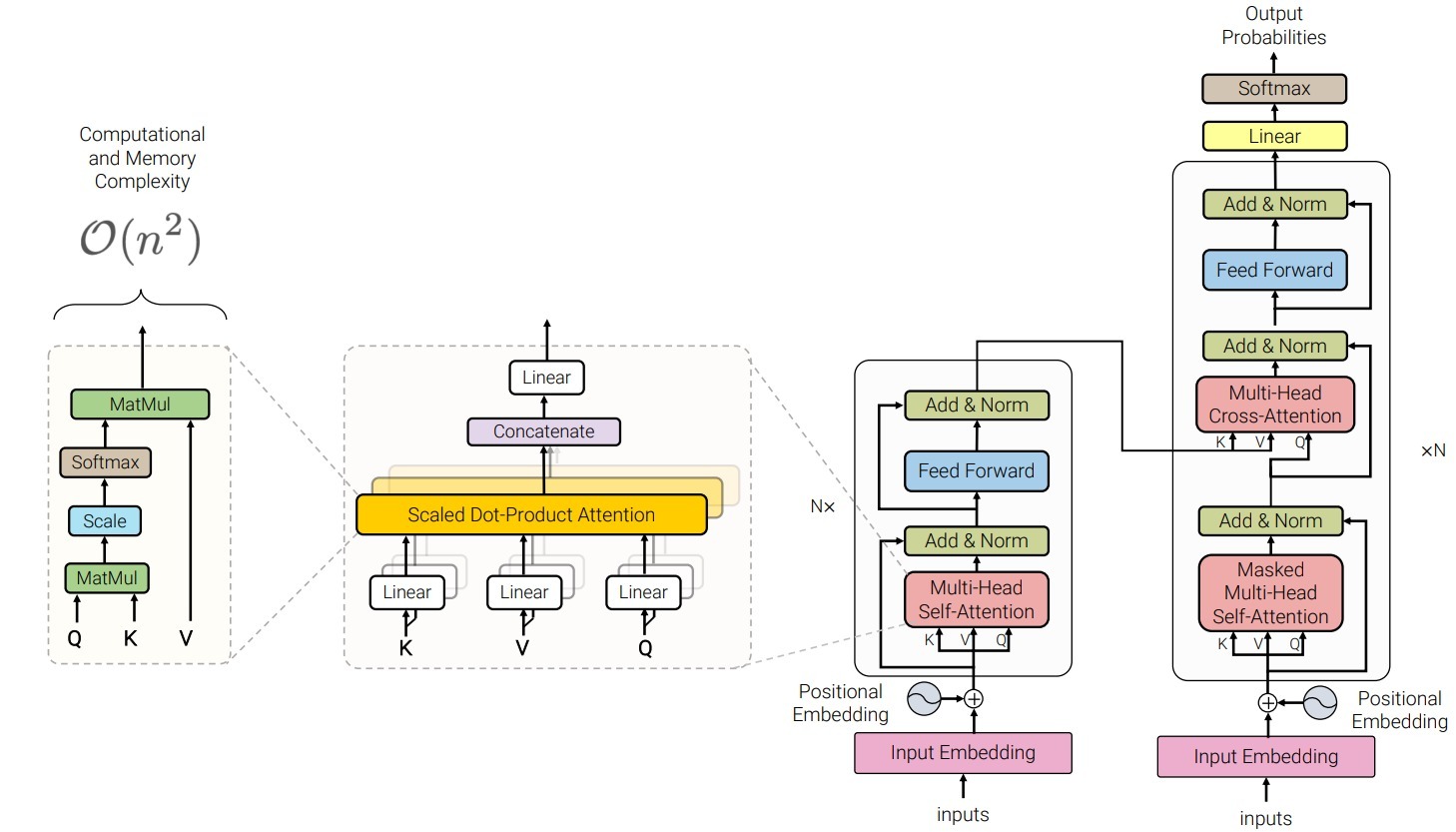

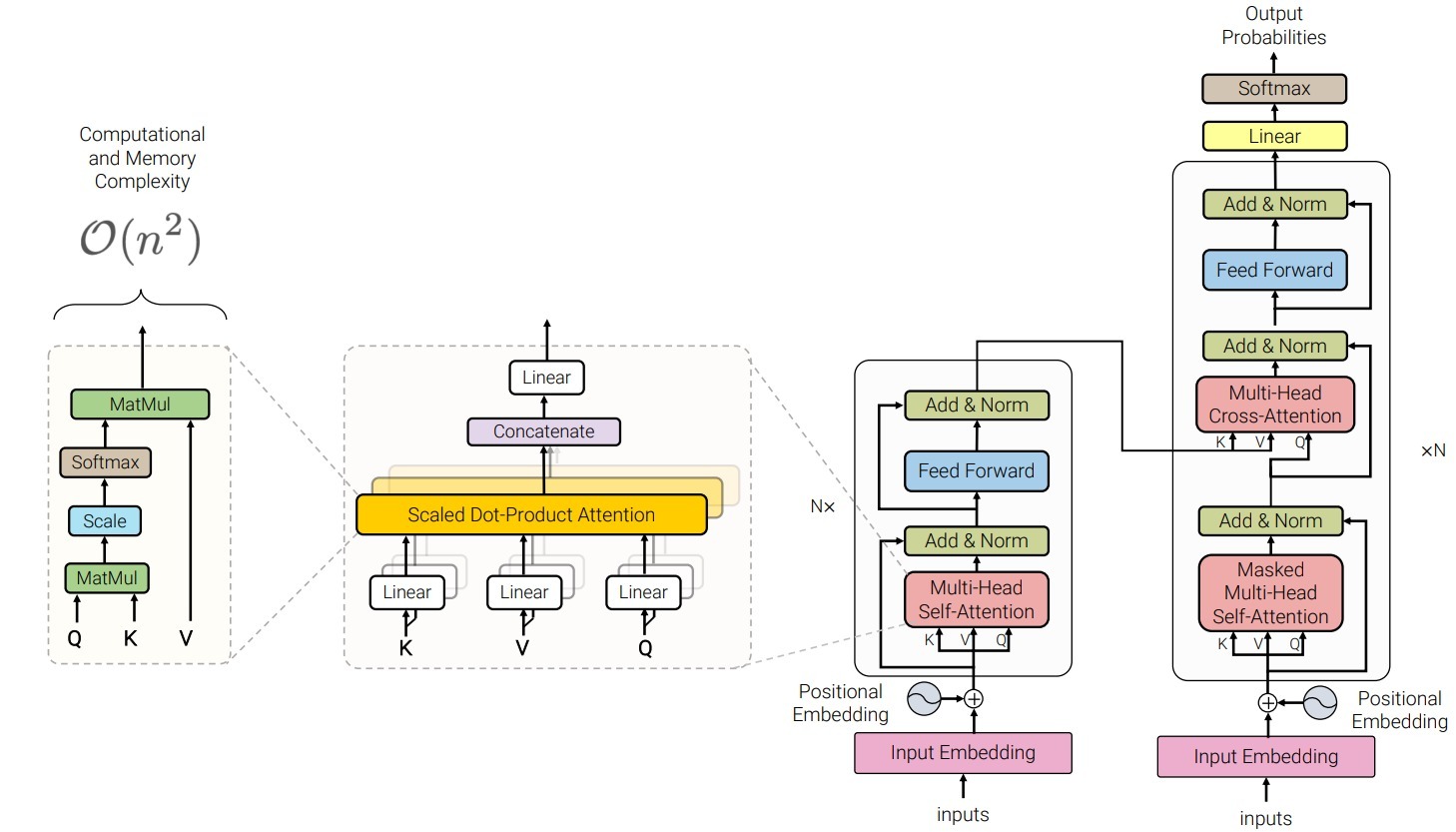

典型的Transformer结构如上图所示,其整体计算量来源于模型中的自注意力层和全连接层两部分,本文主要讨论自注意力层的改进。

(2) 自注意力机制的运算

由于计算机中乘法的计算速度比加法慢,因此在衡量计算复杂度时主要考虑乘法。对于矩阵乘法

Efficient Transformers.

本文目录:

典型的Transformer结构如上图所示,其整体计算量来源于模型中的自注意力层和全连接层两部分,本文主要讨论自注意力层的改进。

由于计算机中乘法的计算速度比加法慢,因此在衡量计算复杂度时主要考虑乘法。对于矩阵乘法

1112

1112

492

492

992

992

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?