作者:禅与计算机程序设计艺术

1.简介

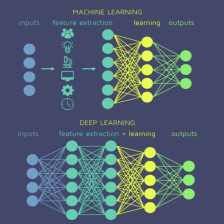

随着深度学习模型的不断进步,神经网络已经从单纯的机器学习算法,转变成了处理图像、声音、文本等多种模态数据中最强大的工具。但是神经网络训练速度慢、泛化能力差、易受干扰,并且在某些情况下还会出现过拟合现象。因此,近年来人们对神经网络的训练过程进行优化,探索如何提升模型的性能和稳定性,并提出了许多有助于解决上述问题的策略,其中Stochastic Weight Averaging(SWA)算法就是一种比较成功的策略之一。

什么是SWA?

SWA,即 Stochastic Weight Averaging ,是一种训练方式,它通过采用平均值的方式代替参数更新,使得模型在训练时更加稳健、鲁棒。该方法主要用于解决模型的不稳定性和欠拟合问题,在固定训练时间下比普通的训练更高效、收敛速度更快。

SWA算法的特点:

- 模型权重迭代平均,因此不需要重新初始化模型参数;

- 在每一轮训练结束后,通过将所有模型参数平均得到一个新的模型参数,作为最后一次迭代时的模型参数;

- 每次计算平均时,可以随机采样若干个模型参数来获得平均值,增强模型的鲁棒性;

- 在每次训练之后,可以对新的模型参数进行分析和评估,分析模型是否存在过拟合或欠拟合现象&#

SWA(Stochastic Weight Averaging)是一种神经网络训练策略,通过模型权重的迭代平均,提高模型的稳定性和泛化能力,有效解决过拟合问题。算法在每个周期结束时,对所有模型参数取平均,增强模型鲁棒性。SWA结合循环学习率、模拟退火算法等,优化模型训练过程,尤其适用于ResNet-50等模型在CIFAR-10任务上的训练。

SWA(Stochastic Weight Averaging)是一种神经网络训练策略,通过模型权重的迭代平均,提高模型的稳定性和泛化能力,有效解决过拟合问题。算法在每个周期结束时,对所有模型参数取平均,增强模型鲁棒性。SWA结合循环学习率、模拟退火算法等,优化模型训练过程,尤其适用于ResNet-50等模型在CIFAR-10任务上的训练。

订阅专栏 解锁全文

订阅专栏 解锁全文

1287

1287

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?