yolov5v7.0 segmet 实例分割 tensorrt C++部署

专门的onnx导出trt软件,训练后导出成onnx,再经过导出软件导出成trt

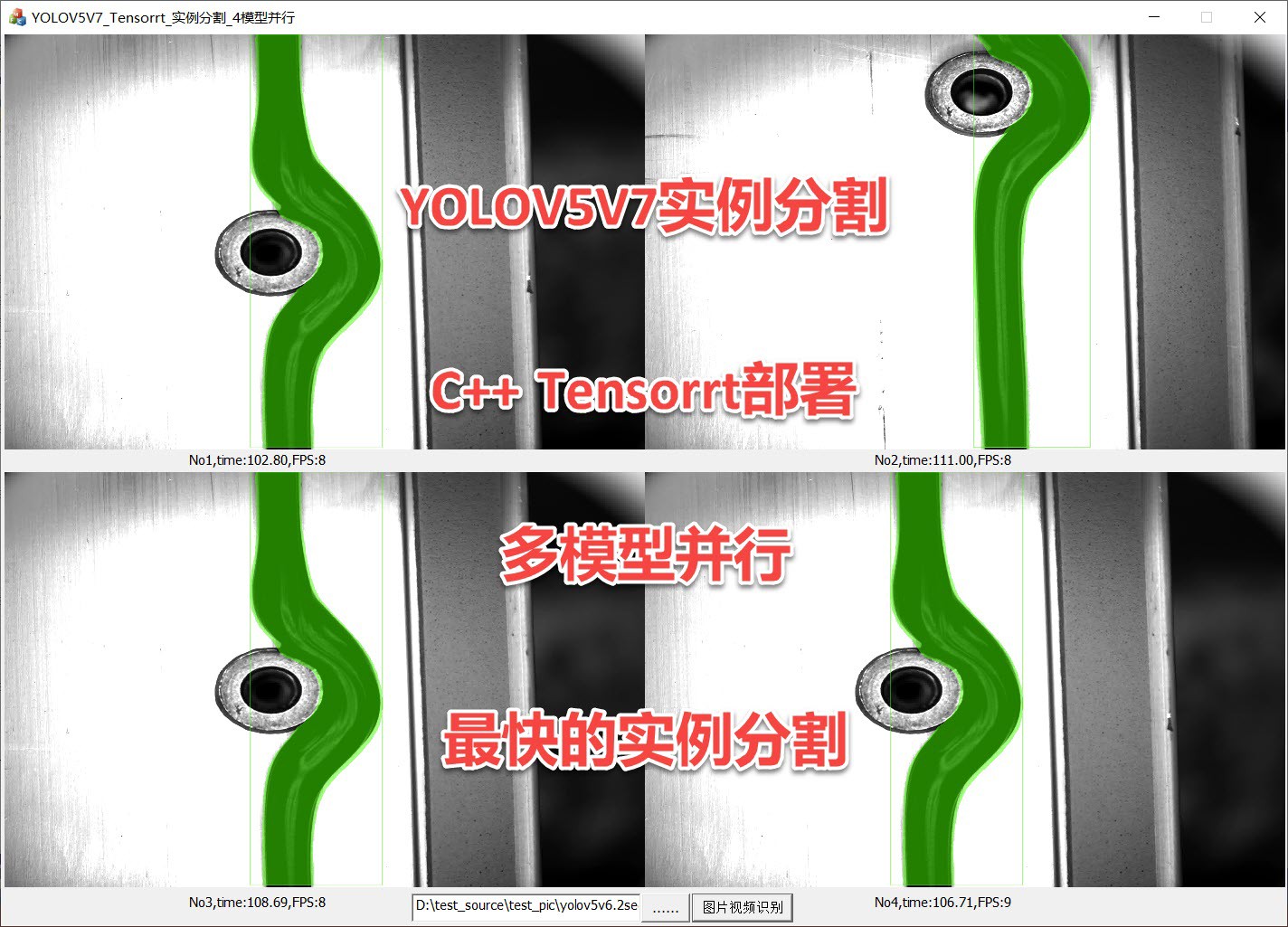

C++ tensorrt推理dll库,支持多模型并行运行,支持自训练自定义模型

支持界面MFC/C#/Qt调用

MFC和Qt windows下,支持硬解码拉流调用

ID:793600694310055639

IT干将

yolov5v7.0 segmet 实例分割 tensorrt C++部署

专门的onnx导出trt软件,训练后导出成onnx,再经过导出软件导出成trt

C++ tensorrt推理dll库,支持多模型并行运行,支持自训练自定义模型

支持界面MFC C# Qt调用

MFC和Qt windows下,支持硬解码拉流调用

标题:基于yolov5v7.0的分割实例分析与C++部署技术探讨

摘要:

本文围绕yolov5v7.0的分割实例分析与C++部署技术展开,介绍了基于onnx导出trt软件的训练方法,并探讨了C++ tensorrt推理dll库的多模型并行运行以及自训练自定义模型的支持。此外,还详细说明了如何在MFC、C#和Qt界面下调用相关模型,并探究了在Windows下利用硬解码拉流进行调用的方法。

关键词:yolov5v7.0、分割实例、C++部署、onnx导出、trt软件、自训练模型、多模型并行运行、MFC、C#、Qt、硬解码拉流

-

引言

在计算机视觉领域,实例分割是一项重要的技术,它可以将图像中的每个实例分别定位和分割出来,为物体识别和场景分析提供了重要的基础。本文将介绍一种基于yolov5v7.0的分割实例分析方法,并探讨了该方法在C++环境下的部署技术。 -

yolov5v7.0的分割实例分析方法

yolov5v7.0是一种先进的实例分割算法,通过对图像进行目标检测和分割,能够同时获得物体的类别和位置信息。本文将详细介绍yolov5v7.0的分割实例分析方法,包括训练过程、模型导出和部署方法等。 -

基于onnx的trt软件训练方法

为了方便部署和加速推理,我们提出了一种基于onnx的trt软件训练方法。该方法首先将训练好的模型导出为onnx格式,然后通过导出软件将其导出为trt格式,以实现更高效的推理过程。本节将详细介绍该训练方法的步骤和实现技术。 -

C++ tensorrt推理dll库的多模型并行运行

为了支持多模型并行运行,我们开发了一个C++ tensorrt推理dll库。该库可以同时加载和运行多个模型,提高系统的处理能力和并行性。本节将详细介绍该库的设计思路、实现细节和使用方法,并展示了该库在实例分割任务中的性能表现。 -

自训练自定义模型的支持

除了使用预训练模型外,我们还支持自训练自定义模型。通过将自定义模型导入到yolov5v7.0框架中进行训练,并使用前文介绍的训练方法和部署技术,可以快速实现对特定场景的实例分割。本节将详细介绍自训练自定义模型的步骤和注意事项。 -

MFC、C#和Qt界面调用方法

为了方便开发者的使用,我们支持在MFC、C#和Qt界面下调用相关模型。这样一来,开发者可以根据自己的需求选择合适的界面开发工具,并通过相关接口实现对图像的实例分割。本节将分别介绍在这三种界面下的调用方法和示例代码。 -

在Windows下利用硬解码拉流进行调用

除了软件调用外,我们还支持在Windows下利用硬解码拉流进行实例分割的调用。通过利用硬件加速技术,可以大幅提升系统的处理速度和并发能力。本节将介绍如何在Windows下配置硬解码环境,并说明在yolov5v7.0框架下的具体实现方法和效果展示。 -

结论

本文详细介绍了基于yolov5v7.0的分割实例分析方法,并探讨了在C++环境下的部署技术。通过使用基于onnx的trt软件训练方法和C++ tensorrt推理dll库,我们可以高效地进行实例分割任务,并支持自训练自定义模型的应用。此外,我们还提供了在MFC、C#和Qt界面下的调用方法,并介绍了在Windows下利用硬解码拉流进行调用的技术。这些技术的应用将大大方便开发者进行实例分割任务的开发和部署。

参考文献:

[1] Redmon, J., Divvala, S., Girshick, R., & Farhadi, A

【相关代码 程序地址】: http://nodep.cn/694310055639.html

2383

2383

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?