下面以GeForce RTX 2080TI GPU为例,基于ubuntu18.04进行驱动程序的安装。

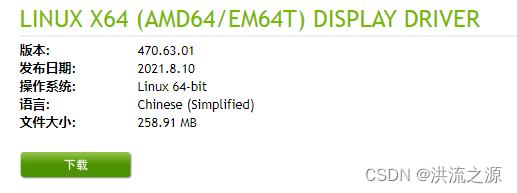

1. 下载驱动程序

驱动程序下载链接:官方驱动 | NVIDIA

根据GPU型号,在如下下拉列表中进行选择,然后点击搜索按钮:

2. 安装驱动程序

1)卸载老版本驱动程序

sudo apt --purge remove nvidia*

sudo apt autoremove

sudo apt --purge remove "*cublas*" "cuda*"

sudo apt --purge remove "*nvidia*"2)禁用nouveau

(1) 打开blacklist.conf文件

sudo vi /etc/modprobe.d/blacklist.conf(2) 在最后一行添加如下内容,并保存

blacklist nouveau(3) 更新linux内核

sudo update-initramfs -u(4) 重启操作系统

sudo reboot(5) 查询禁用是否生效

lsmod | grep nouveau如果已生效,则没有任何输出

3)安装驱动

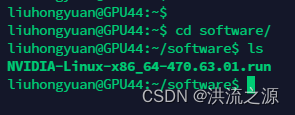

将下载好的驱动程序,上传至Linux操作系统任意用户目录下,例如将驱动程序

NVIDIA-Linux-x86_64-470.63.01.run上传至~/software目录,并进入到该目录下:

(1) 赋予可执行权限

chmod +x NVIDIA-Linux-x86_64-470.63.01.run(2) 安装

sudo ./NVIDIA-Linux-x86_64-470.63.01.run --no-opengl-files安装默认选项回车即可。

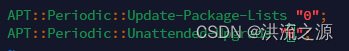

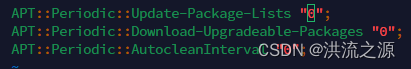

4)禁用系统更新

系统自动更新有可能会升级内核,内核升级后可能导致安装的驱动程序无法使用,常见的是,输入nvidia-smi命令后,出现"NVIDIA-SMI has failed because it couldn't communicate with the NVIDIA driver. Make sure that the latest NVIDIA driver is installed and running."的问题,因此在安装完毕驱动后,可禁用系统更新,保证驱动的稳定性。禁用系统更新,主要将20auto-upgrades、10periodic两个文件中的"1"修改为"0":

sudo vi /etc/apt/apt.conf.d/20auto-upgrades如下:

sudo vi /etc/apt/apt.conf.d/10periodic如下:

5)nvidia-smi的使用

nvidia-sim简称NVSMI,提供监控NVIDIA GPU使用情况和更改GPU状态的功能。

(1) nvidia-smi

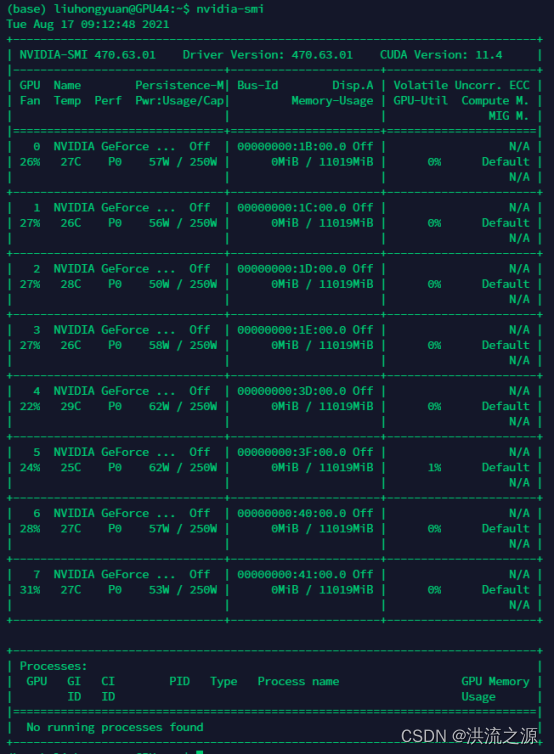

在shell终端直接输入nvidia-smi,可显示当前GPU状态,如下图所示:

表格参数介绍:

· GPU:本机中的GPU编号(有多块显卡的时候,从0开始编号)图上GPU的编号是0

· Fan:风扇转速(0%-100%),N/A表示没有风扇

· Name:GPU类型,图上GPU的类型是:GeForce 2080TI

· Temp:GPU的温度(GPU温度过高会导致GPU的频率下降)

· Perf:GPU的性能状态,从P0(最大性能)到P12(最小性能),图上是:P0

· Persistence-M:持续模式的状态,持续模式虽然耗能大,但是在新的GPU应用启动时花费的时间更少,图上显示的是:off

· Pwr:Usager/Cap:能耗表示,Usage:用了多少,Cap总共多少

· Bus-Id:GPU总线相关显示,domain:bus:device.function

· Disp.A:Display Active ,表示GPU的显示是否初始化

· Memory-Usage:显存使用率

· Volatile GPU-Util:GPU使用率

· Uncorr. ECC:关于ECC的东西,是否开启错误检查和纠正技术,0/disabled,1/enabled

· Compute M:计算模式,0/DEFAULT,1/EXCLUSIVE_PROCESS,2/PROHIBITED

· Processes:显示每个进程占用的显存使用率、进程号、占用的哪个GPU

(2) nvidia-smi –l 秒数

加入-l选项可控制GPU状态显示刷新的时间,如每间隔1s刷新一下GPU的状态,命令为:

nvidia-smi -l 1(3) 保存GPU监控结果

保存GPU状态到report.csv文件,命令如下:

nvidia-smi -l 1 \

--format=csv \

--filename=report.csv \

--query-gpu=timestamp,\

name,index,utilization.gpu,\

memory.total,memory.used,power.draw参数解释:·

l:隔多久记录一次,命令中写的是1

· --format:结果记录文件格式是csv

· --filename: 结果记录文件的名字

· --query-gpu:记录哪些数据到csv文件

· timestamp:时间戳

· memory.total:显存大小

· memory.total:显存使用了多少

· utilization.gpu:GPU使用率

· power.draw:显存功耗,对应Pwr:Usage

以上是GPU状态监控常用的几个命令,如果还需要了解其它的使用,可通过如下命令进行查看:

nvidia-sim -h3. 卸载驱动

执行如下卸载命令:

sudo apt --purge remove nvidia*

sudo apt autoremove

sudo apt --purge remove "*cublas*" "cuda*"

sudo apt --purge remove "*nvidia*"输入nvidia-smi,如果仍然有Nvidia的驱动信息,则说明没有卸载成功。此时进入到NVIDIA-Linux-x86_64-470.63.01.run所在目录下,执行:

sudo ./NVIDIA-Linux-x86_64-470.63.01.run --uninstall然后根据提示进行操作就行。

4429

4429

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?