Golbal Average Pooling 第一次出现在论文Network in Network中,后来又很多工作延续使用了GAP,实验证明:Global Average Pooling确实可以提高CNN效果。

一、Fully Connected layer

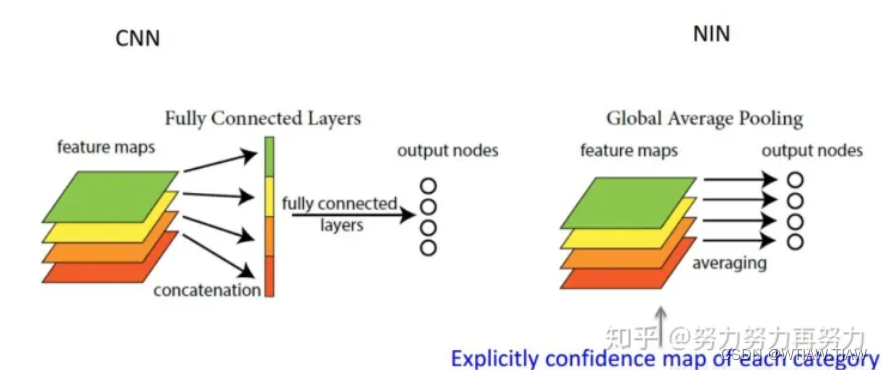

在卷积神经网络的初期,卷积层通过池化层(一般是 最大池化)后总是要一个或n个全连接层,最后在softmax分类。其特征就是全连接层的参数超多,使模型本身变得非常臃肿。

全连接存在的问题:参数量过大,降低了训练的速度,且很容易过拟合。

二、Global Average Pooling

全连接层将卷积层展开成向量之后不还是要针对每个feature map进行分类,而GAP的思路就是将上述两个过程合二为一,一起做了。如图所示:

由此就可以比较直观地说明了。这两者合二为一的过程我们可以探索到GAP的真正意义是:对整个网路在结构上做正则化防止过拟合。其直接剔除了全连接层中黑箱的特征,直接赋予了每个channel实际的内别意义。

如何使用GAP

自适应最大池化Adaptive Max Pooling:

torch.nn.AdaptiveMaxPool1d(output_size)

torch.nn.AdaptiveMaxPool2d(output_size)

torch.nn.AdaptiveMaxPool3d(output_size)

自适应平均池化Adaptive Average Pooling:

torch.nn.AdaptiveAvgPool1d(output_size)

torch.nn.AdaptiveAvgPool2d(output_size)

torch.nn.AdaptiveAvgPool3d(output_size)

Adaptive Pooling特殊性在于,输出张量的大小都是给定的o u t p u t _ s i z e output_sizeoutput_size。例如输入张量大小为(1, 64, 8, 9),设定输出大小为(5,7),通过Adaptive Pooling层,可以得到大小为(1, 64, 5, 7)的张量。

GlobalAveragePooling作为替代全连接层的方法,减少了参数量,提升了训练速度并缓解过拟合。它结合池化与分类,直接赋予特征图通道意义。AdaptivePooling允许指定输出尺寸,适应不同输入大小。

GlobalAveragePooling作为替代全连接层的方法,减少了参数量,提升了训练速度并缓解过拟合。它结合池化与分类,直接赋予特征图通道意义。AdaptivePooling允许指定输出尺寸,适应不同输入大小。

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?