论文标题:

Autoformer: Decomposition Transformers with Auto-Correlation for Long-Term Series Forecasting

论文链接:

https://arxiv.org/pdf/2106.13008v4.pdf

源码链接:

https://github.com/thuml/Autoformer

摘要

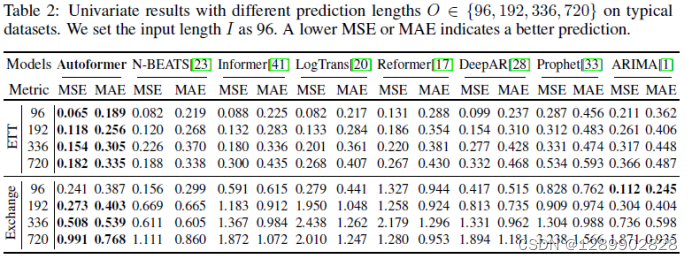

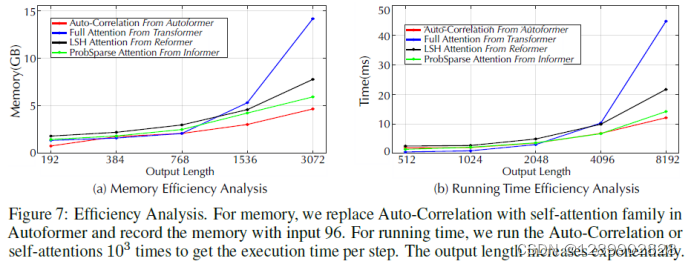

延长预测时间是极端天气预警和长期能源消耗规划等实际应用的关键需求。本文研究了时间序列的长期预测问题。之前基于Transformer的模型采用各种自注意力机制来发现长期依赖关系。然而,长期未来的复杂时间模式使模型无法找到可靠的依赖关系。此外,Transformer为了提高长序列效率,必须采用稀疏的点自注意方式,从而造成信息利用的瓶颈。针对这些挑战,我们提出Autoformer作为一种具有自相关机制的新型分解体系结构。我们超越了序列分解的预处理惯例,将其改造为深层模型的基本内部块。这种设计使Autoformer具有复杂时间序列的渐进分解能力。进一步,受随机过程理论的启发,设计了基于序列周期性的自相关机制,在子序列层面进行相关性发现和表示聚合。自相关在效率和准确性上都优于自注意。在长期预测方面,Autoformer具有最先进的准确性,在涵盖能源、交通、经济、天气和疾病5个实际应用的6个基准上有38%的相对提高。

两个关键点

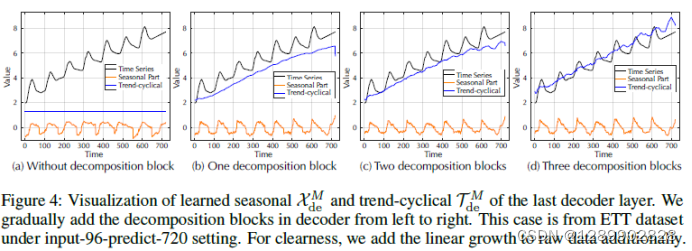

1.设计序列分解模块

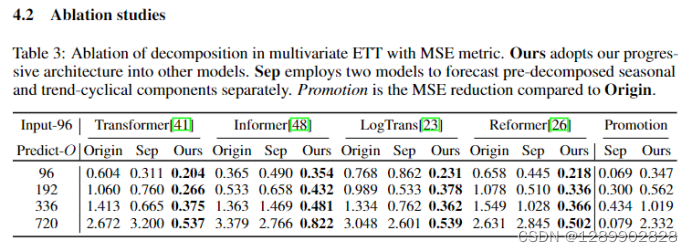

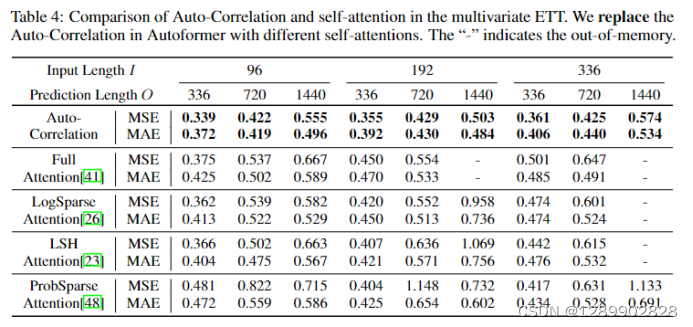

2.用自相关机制替换自注意机制

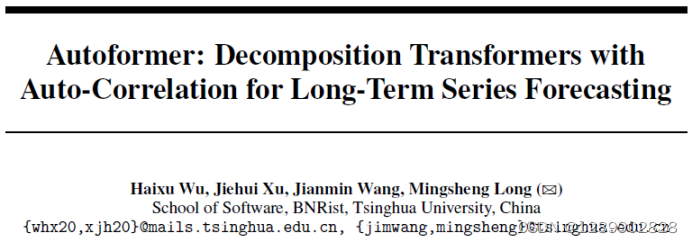

模型结构

时序分解

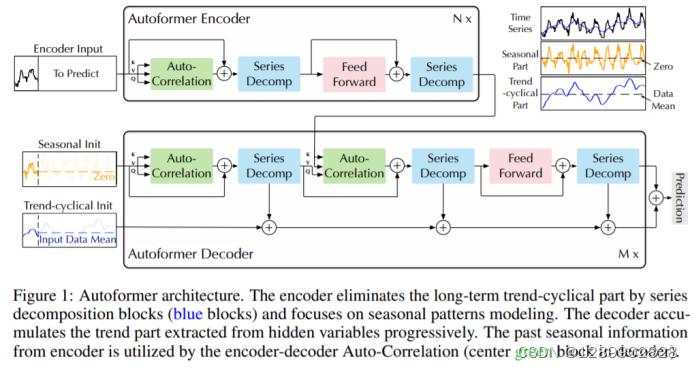

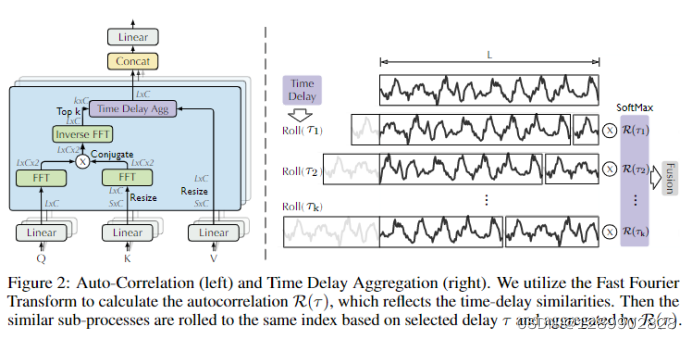

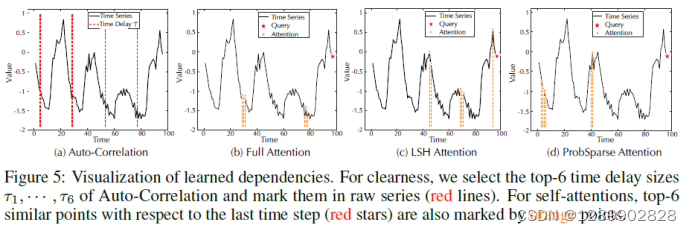

自相关

自相关模块是通过计算序列自相关系数,发现周期依赖项(Period-based dependencies),然后再平移时间做相似子序列的聚合(Time delay aggregation)。

自注意更关注与point-wise之间的依赖性,自相关更关注series-wise之间的依赖性。

实验

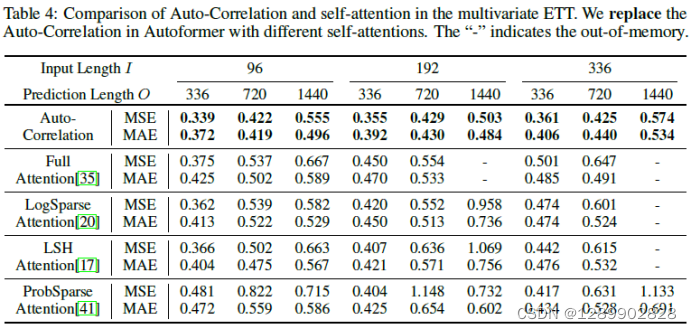

消融实验

模型分析

从实验结果来看,Autoformer比Informer好一点,和N-BEATS相差不大。

1344

1344

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?