本年度的ICRA盛会在日本横滨举办,来自全球各大高校与企业的与会者们共同探讨了机器人领域的最新研究成果和发展方向。具身智能相关领域成为了今年最受关注的方向,其中具身触觉传感的发展令人瞩目。ViTac Workshop邀请了相关领域的著名专家与研究人员进行学术交流,并收集了27篇相关的研究成果。经workshop主办方的授权,我们首先对前沿研究成果进行了汇总,主要从新型传感器本体、底层算法、仿真与学习操作和交互感知等方面进行总结,期待为具身触觉社区带来新的思想和研究方向。

一、新型触觉传感器百花齐放

为了提升触觉的感知精度、测量范围等性能指标,研究人员们提出了多种全新的传感器设计,涵盖了不同的传感机制、形态大小与应用范围。

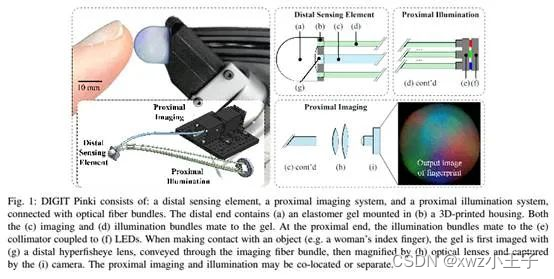

为了缩小视触觉传感器的结构尺寸,来自斯坦福大学的研究人员们提出了基于光纤照明与成像的小型视触觉传感器DIGIT Pinki,实现了15 mm直径的小尺寸构型,同时也达到了0.22mm的空间分辨率与5 mN的力感知精度。最终还将这一传感器应用于医疗场景的触诊中。

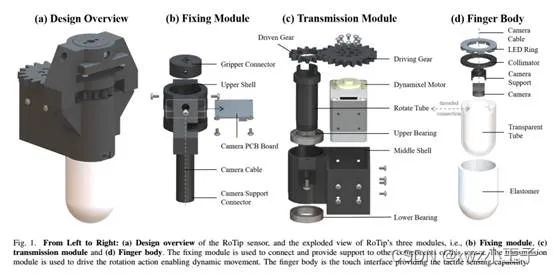

为了提升一体化视触觉传感器指尖的操作能力,来自伦敦国王学院的研究人员们提出了具有主动旋转自由度的RoTip视触觉传感器,可实现对于轻薄柔性物体的可靠操作。全指的触觉反馈与主动旋转能力有望大幅提升一体化视触觉手指对于复杂物体的精确灵巧操作能力。

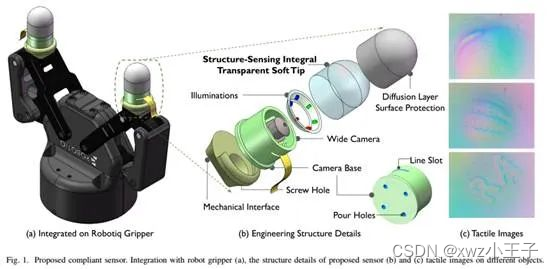

指尖的复杂精密操作对于本体的顺应性与灵巧性提出了的新的要求。来自上海交大的研究人员提出了结构感知一体化的全柔性视触觉指尖传感器,去除了内部刚性支撑结构,为指尖操作提供了高达的120%的可逆形变能力与顺应性,提高了对于复杂物体抓取操作的适应能力。

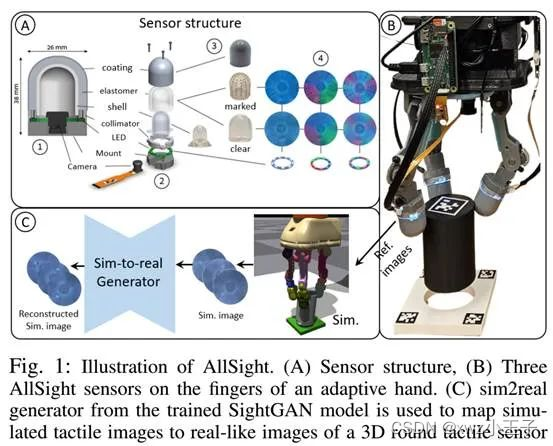

同时来自特拉维夫大学的研究人员还研发了人类拇指大小的AllSight指尖传感器,并集成到了三指灵巧手上,并利用Sim-to-Real的方式实现了复杂的灵巧操作能力,通过采用双向生成对抗网络SightGAN优化sim2real的迁移,提升了这一方法在传感器间的适应性。

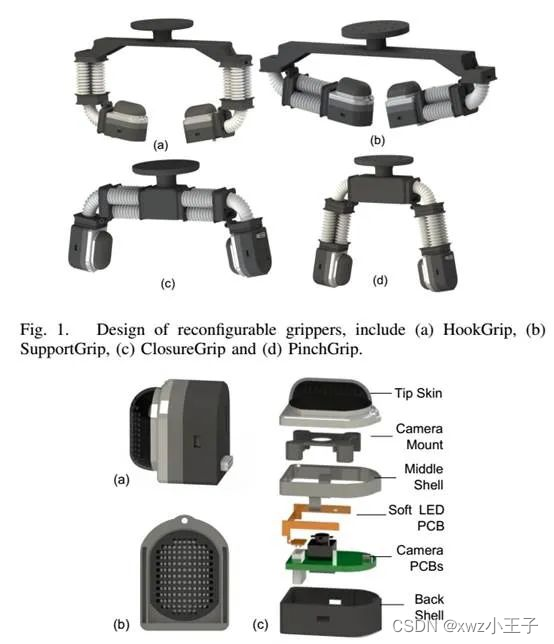

来自布里斯托大学的研究人员还展示视触觉传感器与可重构夹爪的集成能力。通过研发灵巧关节模块、旋转模块与可插拔的视触觉传感器,基于不同模块的组合搭配,研究人员们将视触觉传感器与不同构型的软体夹爪进行集成,实现了不同构型的具有视触觉感知能力的夹爪。

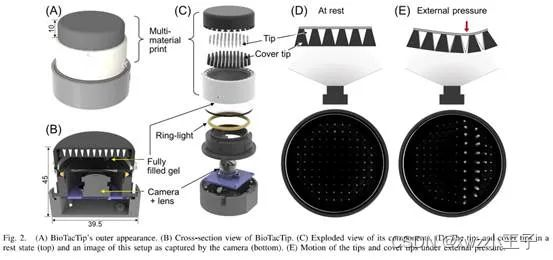

另外布里斯托大学与西英格兰大学的研究人员们还通过仿生的方式构建了可实现高效三维定位与三维力估计的光学触觉传感器。通过模块表皮与真皮层的互锁边界来捕捉外部接触力的分布、几何形状、位置与深度等信息,并为视触觉感知提供了新的观测与分析手段。

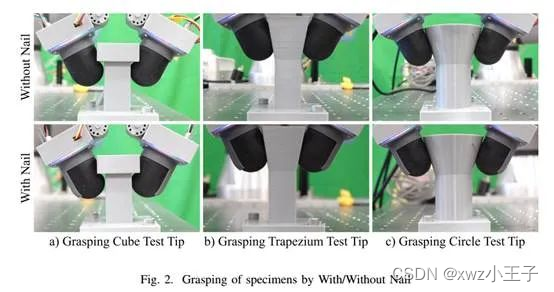

同样是基于手指仿生的原理,来自日本高等技术研究所的研究人员们参考手指的指骨与指甲结构增强视触觉传感器的抓握力。通过指甲的加入,限制了硅胶的形变范围,明显提升了接触过程中的法向力,提升了抓取力与抓取过程中的稳定性。

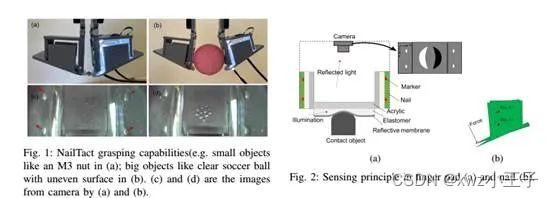

为了更好的进行小物体抓取,日本立命馆大学的研究人员从不同的角度提出了手指指腹与指甲相结合的视触觉传感器构型NailTact,可通过单个摄像头估计作用在指腹与指甲上的力,并验证了其对于多种物体的抓取性能。

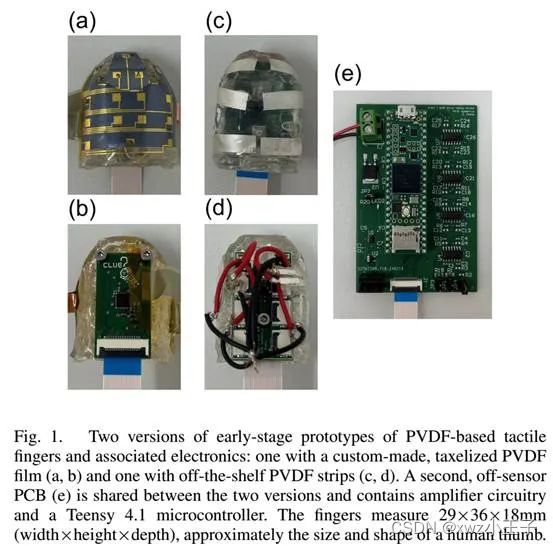

高频振动对于触觉的动力学特性感知具有重要的意义。来自哥伦比亚大学的研究人员们提出了一种基于PVDF (polyvinylidene fluoride)压电材料的触觉传感器,实现了对于高频振动信号的稳定检测。同时还构建了分布式的多点测量方式,实现了对于指尖空间振动测量的覆盖。

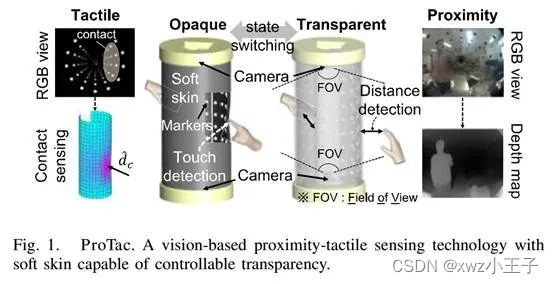

在大型的视触觉传感器方面,来自日本先进技术研究院的研究人员们提出了一种杆状的视触觉传感器ProTac Link,具有视觉与触觉两种状态,可实现内部触觉感知与感知的多功能传感。同时建立了准确的力学模型实现了较为准确的接触位移与深度估计,同时也展示了在视觉模态下的高层感知能力。

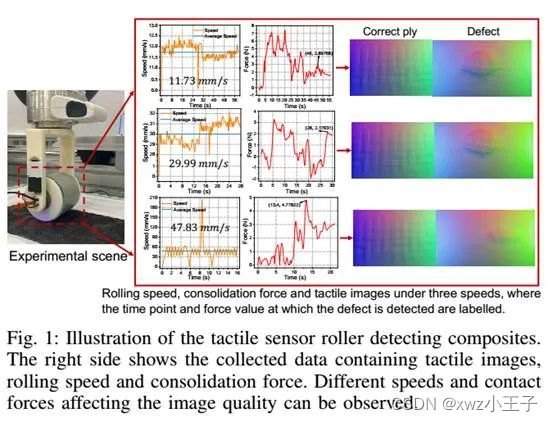

对于大面积材料表面的感知,来自布里斯托、西英格兰与利物浦等高校的研究人员们利用滚筒式的视触觉传感器进行表面缺陷感知,结合经典的光度立体视觉算法实现表面状况的深入分析,有效的筛选出了不同的缺陷类型。

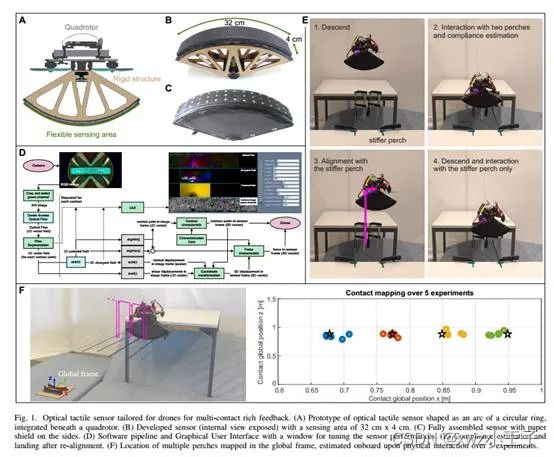

最后,ETHz的研究人员还将视触觉传感器与无人机结合,为无人机在与环境交互过程中提供接触位置的形貌与接触力等信息。通过精巧的设计实现了与无人机本体、感知与控制系统的有效集成,将为无人机在复杂环境提供更为可靠的反馈信息。

二、更准更快更通用的高性能触觉感知算法

除了各类新颖的传感器,针对触觉传感的仿真、标定、力估计等方面也涌现出了很多新的工作。

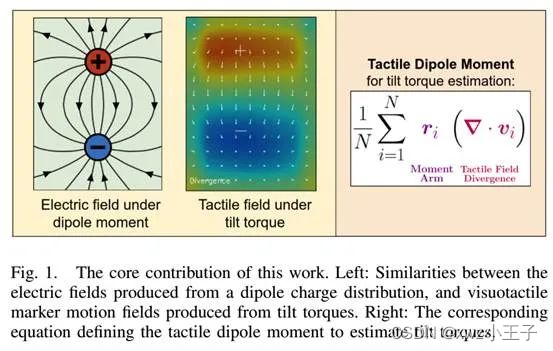

为了获取视触觉传感器在抓取过程中的力矩信息,来自欧姆龙的研究人员在偶极子思想的启发下提出了触觉场偶极子的概念,通过对marker位移场的分析在不依赖于任何深度学习算法、光学模型的情况下对扭矩进行了估计,深入挖掘了视触觉传感器对物理量的感知能力。

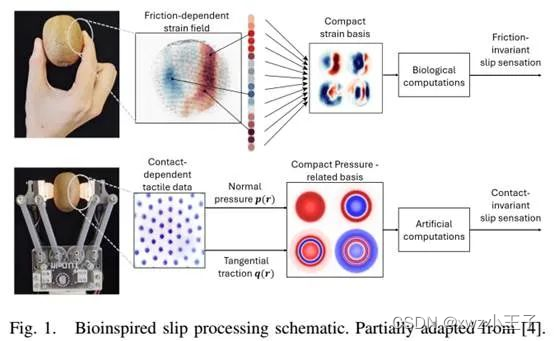

为了提升机器人对于滑移的检测能力,来自代尔夫特理工的研究人员们基于人手的感知机理提出了一种预测目标的滑移的方法,通过Cattaneo-Mindlin模型抽取压力分布的主成分构建低维空间,并将触觉数据投影到低维空间内来估计接触区域距离产生完全滑动的程度大小。

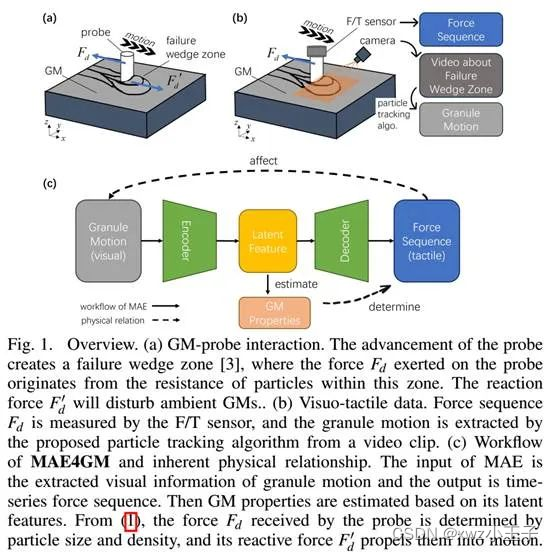

颗粒物质在日常生活中极为常见。为了感知颗粒物质的物理状态,来自香港大学等机构的研究人员提出了融合视觉与触觉传感器信息并基于多模态自编码器实现颗粒物质物理特性感知的方法MAE4GM,可获取目标物质颗粒特性与机械特性,并具有较强的泛化能力。

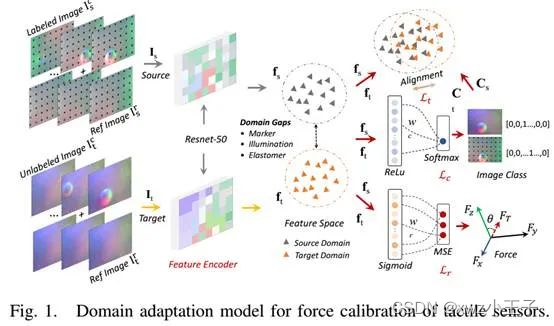

快速准确的接触力标定对于视触觉传感器具有重要意义,来自国王学院的研究人员为了克服传统基于大量力标注数据的深度学习方法所存在的数据收集困难,提出了可将已标定传感器的预测能力迁移到未标定传感器上的方法,实现了较高的力精度,大幅降低了数据收集开销。

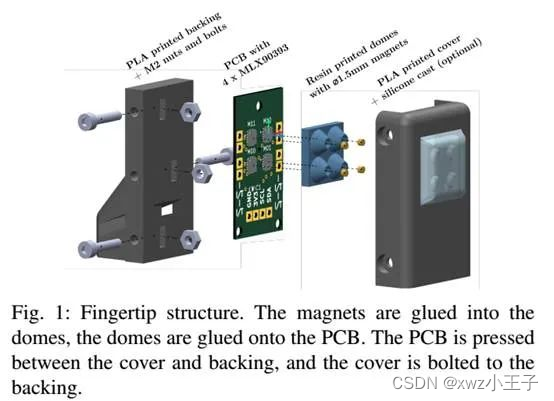

磁触觉传感器也是一类重要的触觉传感器。来自比利时根特大学的研究人员开发了一种开源的磁触觉传感器及其自动标定算法,具有自动、在位和与夹爪无关的标定能力,大幅降低了磁触觉传感器的研发与应用门槛。

三、仿真与学习驱动更灵巧的机器人操作

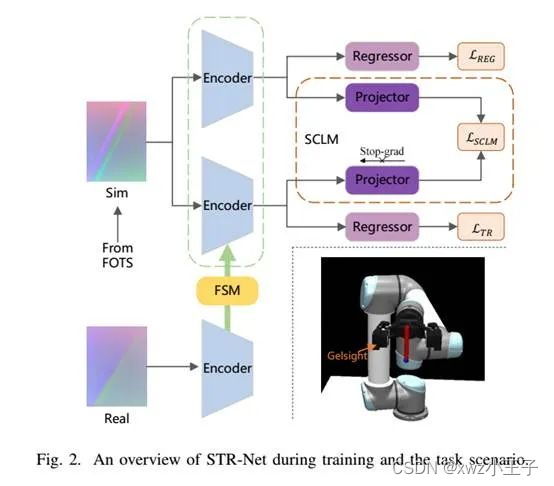

在传感器仿真方面,来自东南大学的研究人员提出了在特征层面进行sim2real的机器人学习的无监督算法架构STR-Net,通过利用特征层级的域适应设计,克服了目前基于GAN的像素级迁移方法其网络复杂性高、性能不稳定、训练开销大的问题,实现了更稳定性能。

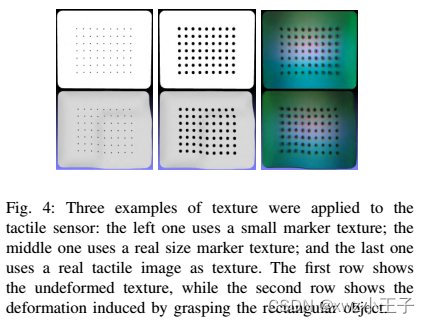

来自里昂中央理工学院的研究人员也提出了一种用于机器人触觉操作的合成数据生成方法,基于Defgraspsim建立了一套完整的数据生成方法,包含了抓取成功与滑移等标注,也涵盖了逐帧的受力、形变等底层触觉信息,同时可以利用Acronym载入非常丰富的抓取位姿。

由于精细运动控制的困难与环境的不确定性,现实中的机器人灵巧操作任务一直存在挑战。机器手的多指灵巧操作经常伴随着视觉遮挡,基于现实实验的灵巧操作学习经常面临着多个相机的复杂设置,因此在仿真环境中训练操作算法成为一个不错的方法。布里斯托大学Lepora课题组一直致力于基于触觉感知的机器人操作Sim-to-Real研究。此次他们报道了所开发的AnyRotate系统,利用模拟中的显式接触特征,通过强化学习训练了一个观察模型,实现了从仿真到现实的zero-shot迁移。尽管没有明确的滑动检测,丰富的多指触觉信息可以隐式地检测抓取内的物体运动,实现对物体在任意旋转轴的转动操作。

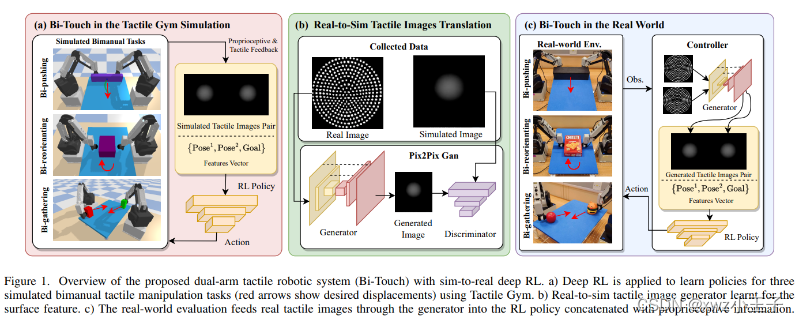

另一方面,机器人双臂操作系统由于其复杂性与相对高的成本,在现实中的应用依旧存在挑战。Lepora课题组报道了基于Tactile Gym 2.0的训练,双臂机器人实现对物体的推动、变向以及聚集操作,展现了该系统的虚拟现实迁移能力。

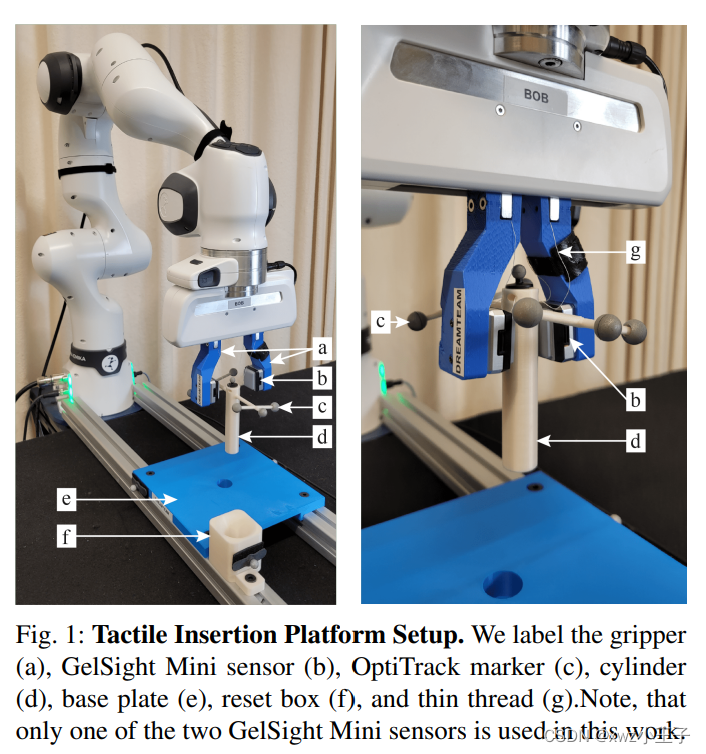

一些复杂的接触过程,比如涉及大变形物体的非线性弹性模型和动力学模型难以在仿真器中准确地实现,导致仿真与现实中的差距过大,所以一部分的操作学习是现实实验的。比如,达姆施塔特工业大学的研究者选择了在现实世界中利用强化学习,利用Dreamer-v3直接端到端的训练机器人,建立触觉传感器信息与机器人动作之间的映射关系,使机器人能够完成一个典型的插进任务。

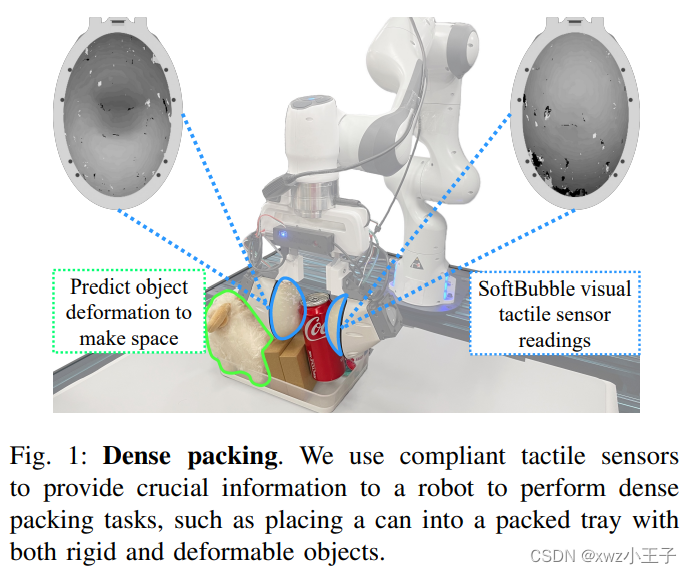

新加坡科技研究局的研究者提出了一种视触融合的机器人感知操作方法RoboPack,通过建立一个基于触觉信息的动力学模型,评估与预测物体的状态,并利用一个搭载了SoftBubble视触觉传感器的机器人演示了推箱子与致密堆积等任务。

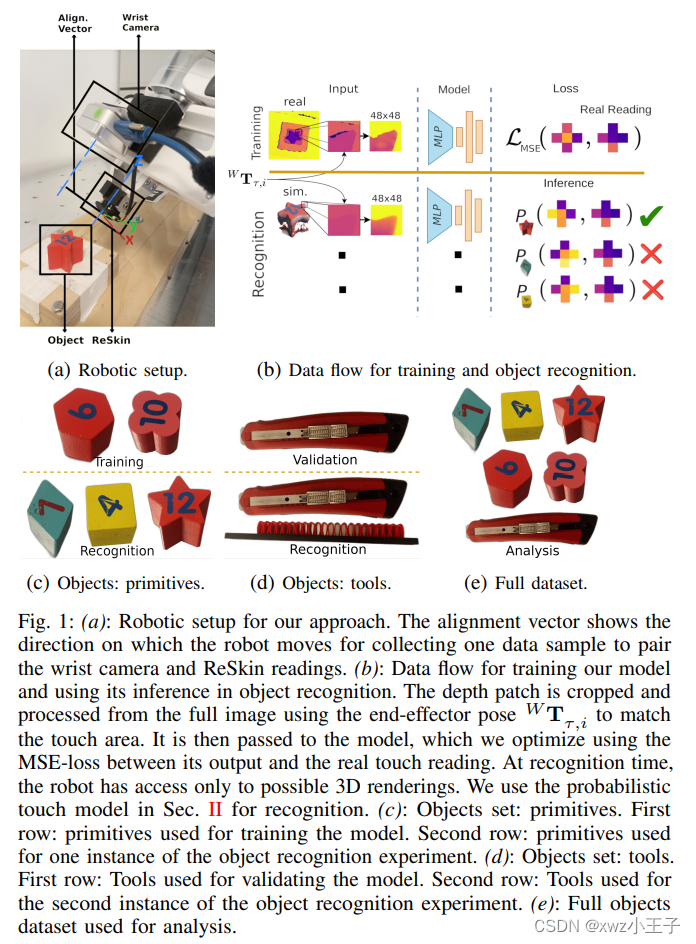

德国弗赖堡大学的研究者也开发了类似的训练系统Imagine2touch,采用了一个跨模态模型,利用腕部摄像头提供的视觉标记,由ReSkin传感器提供的低维触觉信息实现对不同形状物体的有效识别。

四、触觉提升人机交互感知体验

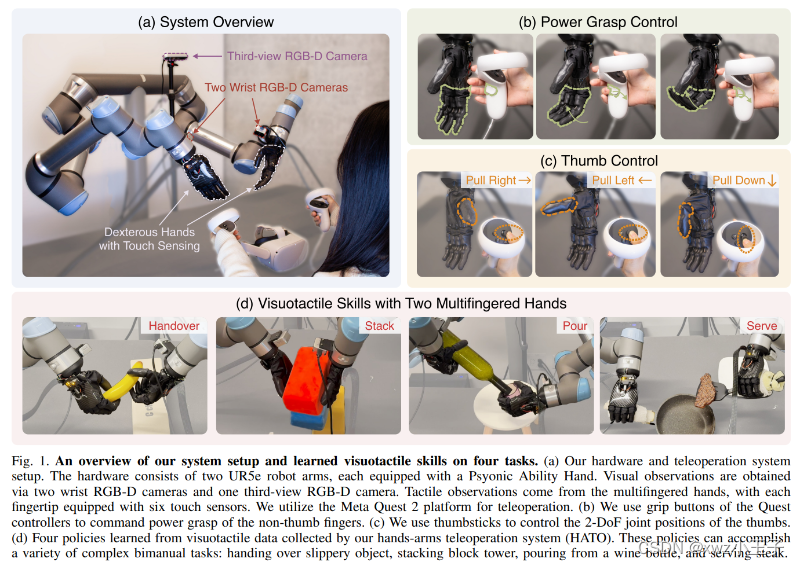

在遥操作方面,加利福尼亚大学伯克利分校的研究者利用现成的电子设备和一套软件,开发了一种价格合理、易于使用、适合多指手的双臂远程操作系统–HATO,填补了多指双臂远程操作系统的空缺。针对配备触摸传感多指手硬件的稀缺,引入了一种新颖的硬件适配方法:复用两只装有触摸传感器的假手。进而利用获得的视觉与触觉信息指导机器人完成一些长期、高精度的双手操作任务,包括:人机物品交接、堆积木、从酒瓶里倒酒,以及上牛排。

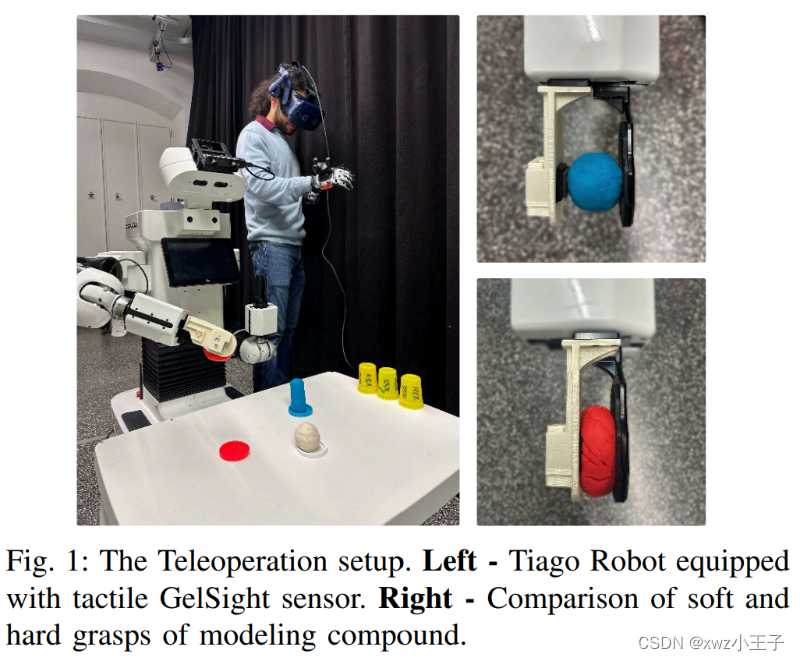

另一方面,当前遥操作提供给操作者的感官反馈主要是视觉反馈,很大程度上限制了操作者在操作任务中的灵巧性。各种触觉反馈信号,比如振动触觉信号和力阻信号,可以帮助用户理解机器人的操作意图,提升遥操作动作的精细度和控制度。瑞典皇家理工学院的研究者将触觉传感器捕获到的接触力信息处理成一个实时的触觉响应(振动振幅),通过控制器传递给用户,并将触觉反馈集成到远程操作系统中。这不仅增强了AR界面提供的视觉和空间信息,还丰富了用户的感官体验。

达姆施塔特工业大学则将触觉反馈的载体换成了可穿戴的MANUS手套,对操作者实现有效的力反馈,证明了触觉反馈信息在遥操作中的重要性。

从今年的研究展示了具身触觉领域的飞速发展,在各个领域逐渐进入到了百花齐放的阶段。希望我们的总结能启发社区的进一步研究,共同促进具身触觉研究与应用的发展。

242

242

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?