最近看到的几篇GNN论文,感觉还比较有意思~分享给大家~

On Explainability of Graph Neural Networks via Subgraph Explorations

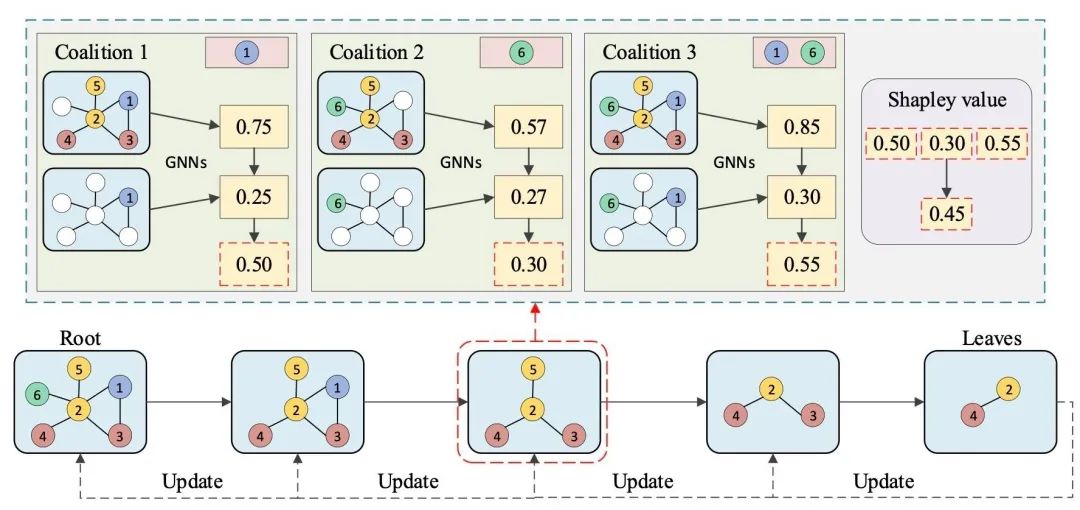

现有的图解释性方法往往只关注于解释图的节点或边的重要性,而忽略了图的子结构。事实上,这些子结构更直观,更易于理解。本文提出了一种新的GNN解释性方法,称为SubgraphX,通过识别重要的子图来解释GNNs。给定一个训练好的GNN模型和一个输入图,SubgraphX通过蒙特卡罗树搜索有效地探索不同的子图来解释它的预测。为了使树搜索更有效,本文提出使用Shapley值作为子图重要度的度量。它还可以捕获不同子图之间的交互作用。为了加快计算速度,本文也提出了一种有效的近似方案来计算图的Shapley值。

We consider the problem of explaining the predictions of graph neural networks (GNNs), which otherwise are considered as black boxes. Existing methods invariably focus on explaining th

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

351

351

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?