1.算法创新(CNN、LSTM、GCN、Attention、GAN)

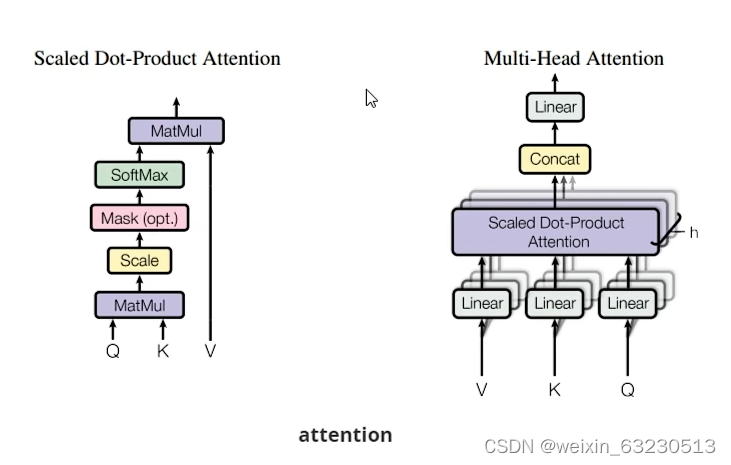

2.架构创新(transformer,nips2017)

3.迁移创新(VIT)

4.思想创新

5.方法创新

6.组合创新

组合创新 = 基准模型|(transformer,U-Net)+ 模块(Attention、GCN、CNN)

论文1 = transformer+线性注意力+因果卷积+扩散卷积

l论文2 = Auto Encoder +时间卷积网络+扩散卷积+注意力

三四区:LSTM + Attention(注意力机制的变体、概率系数注意力、金字塔注意力) + posion embedding

三四区 = transformer + (attention + cnn +pool)+ position embedding,三者进行融合,使其具有attention和cnn的优势

组合创新、大有作为

1.融合的方式:串行、并行

2、对模块进行微改,看起来是有创新性的

二、组合创新的必要性

上限高低:上课发顶刊顶会,下可发三区四区EI

入场门槛:可以零论文入手,也可以顶会下场

助人程度:上可助任教读博,下可助毕业无忧

三、组合创新的流程

一般的科研流程:

1.明确领域内存在的问题(需要广泛的阅读基础,思考能力)

2、提出合适的算法去解决(需要明确每个算法的优点)

组合创新的流程:

1、提出一个组合模型(了解一些顶刊顶会的模型框架、以及具体的算法、并进行总结)

2、了解对应论文中的问题(需要明确论文的动机和贡献)

四、组合创新的举例

1.组合创新公式

组合创新 = 基准模型|(transformer,U-Net)+ 模块(Attention、GCN、CNN)

一区:

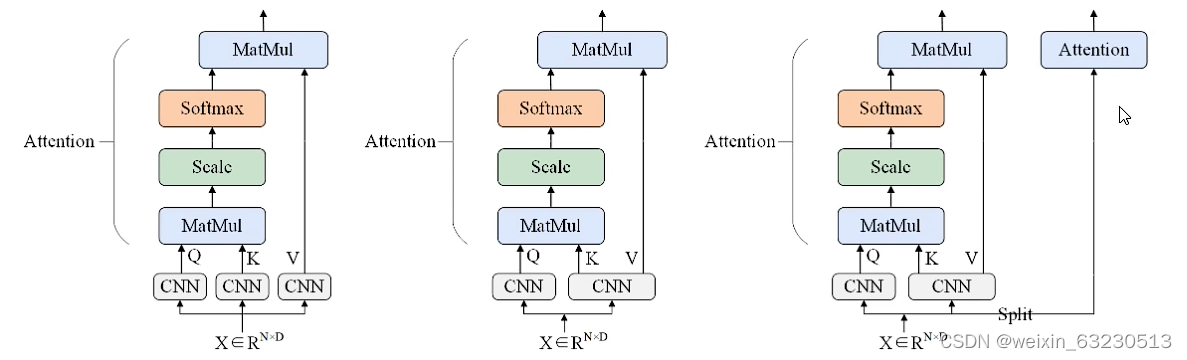

1)组合的方式:串行、并行、融合等

2)对模块进行微改、或是加入一些小trick,看起来有创新性

eg:卷积->扩展卷积、通道卷积

串行:

并行:

并行:

融合:

五、基准模型

5.1 基准模型是什么

基准模型 = 模型 - 模块(Attention、GCN、CNN) = MLP(多层感知器)+Add(残差连接)+Norm (正则化)+ 连接方式-----基本组件,不能丢

5.2 基准模型举例

基准模型 = 模型 - 模块(Attention、GCN、CNN) = MLP(多层感知器)+Add(残差连接)+Norm (正则化)+ 连接方式-----基本组件,不能丢

1、绘图

2、添加或删减模块

5.4 基准模型在哪里找

1、领域,CV、NLP

2、顶会顶刊。CVPR ICCv EcCV NIPS TPAMI IJcV TIP TCSVT TMM

3、有代码

六、模块的选择

组合创新 = 基准模型(Transformer、U-Net)+ 模块(Attention、GCN、CNN)

第一种:组合方式

第二种:微改模块、加入trick

基准模型 = 模型 - 模块(Attention、GCN、CNN)=MLP+Add+Norm+连接方式

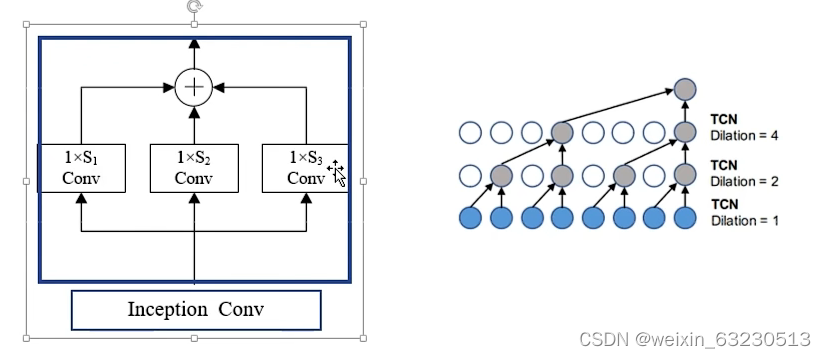

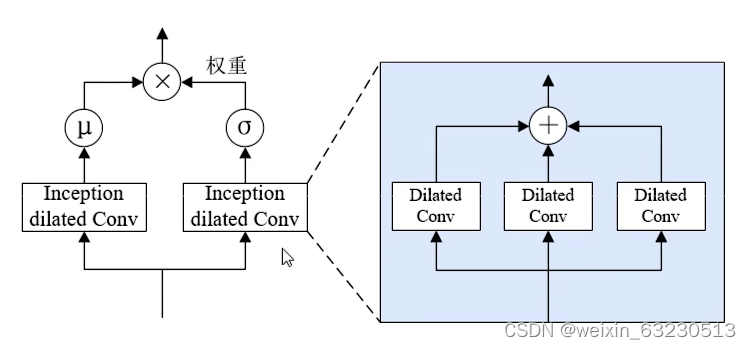

串行方式堆叠,层数过多,会产生梯度消失现象,inception卷积出现

具有多分支的结构来避免一个梯度消失,还能够提取网络的一个多分辨率特征

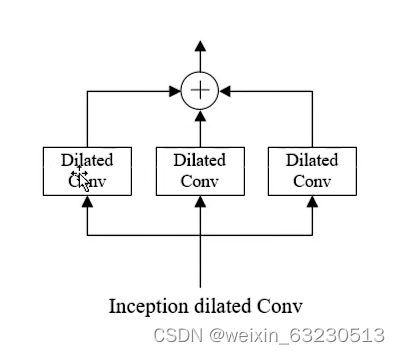

但是已经被用烂了,先替换一下最最基础的一个卷积层,卷积的变体有分组卷积、扩展卷积、深度卷积等。-------扩展卷积替换中间的卷积层

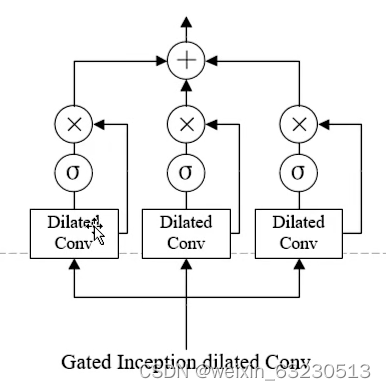

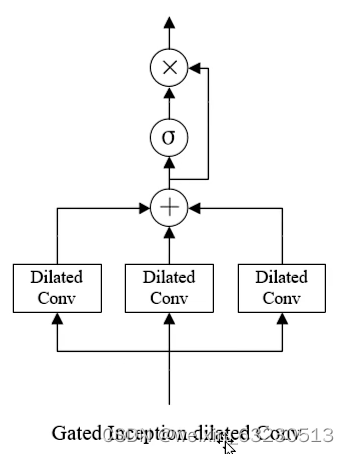

扩展卷积通过扩展因子来增加网络对信息的一个感受野,下图通过设置三个不同大小的扩展因子来提取一个多尺度的信息,最后三部分相加或者在通道上拼接起来。

选择门控单元,通常是一个sigmoid函数,0-1

×权重,选择有用的信息,再相加

门控并行扩展卷积层

加注意力机制、换卷积快、换损失函数

七、实验

1.实验性能:

一区二区:高级组合,基准模型,近两年顶会顶刊

三区四区:低级组合

2.对比实验,是否全部复现:不需要

3.提升性能:Adam优化器、学习率递减、正则化、参数初始化、seed选择、超参数。

adam优化器:

4.实验数量:对比、消融、参数。多做两个数据集

案例研究、可视化、复杂度对比、运行速度对比、选择性对比

图好看,表格数据充分

4066

4066

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?