2023年被称为“大模型元年”,到了2024年,AIGC技术彻底火出圈,其中生成式AI更是备受瞩目。这项技术凭借创新算法,突破了传统AI的局限,在数字内容创新领域实现了重大突破。对企业来说,这是个利用AI大模型搭建AI知识库,盘活企业知识资产的好机会。今天,咱们就深入聊聊大模型与企业AI知识库那些事儿。

前排提示,文末有大模型AGI-CSDN独家资料包哦!

大模型为企业AI知识库带来了什么?

企业在运营过程中积累了海量数据,可要是没有高效的处理和利用方式,这些数据就只是沉睡的“宝藏”。AI大模型的出现改变了这一局面,它就像一个智能管家,能把杂乱的数据整理得井井有条。企业借助AI大模型,可以将各类知识整合到AI知识库中,还能让知识库实现自我循环和更新。比如,当有新的行业动态、企业内部经验出现时,大模型能快速分析并将这些新知识融入知识库,让企业随时掌握最新信息。而且,大模型的搜索和推荐功能十分强大,员工查找资料时,它能像精准导航一样,快速给出最符合需求的知识内容,大大提高工作效率。

2025年大模型的实力究竟如何?

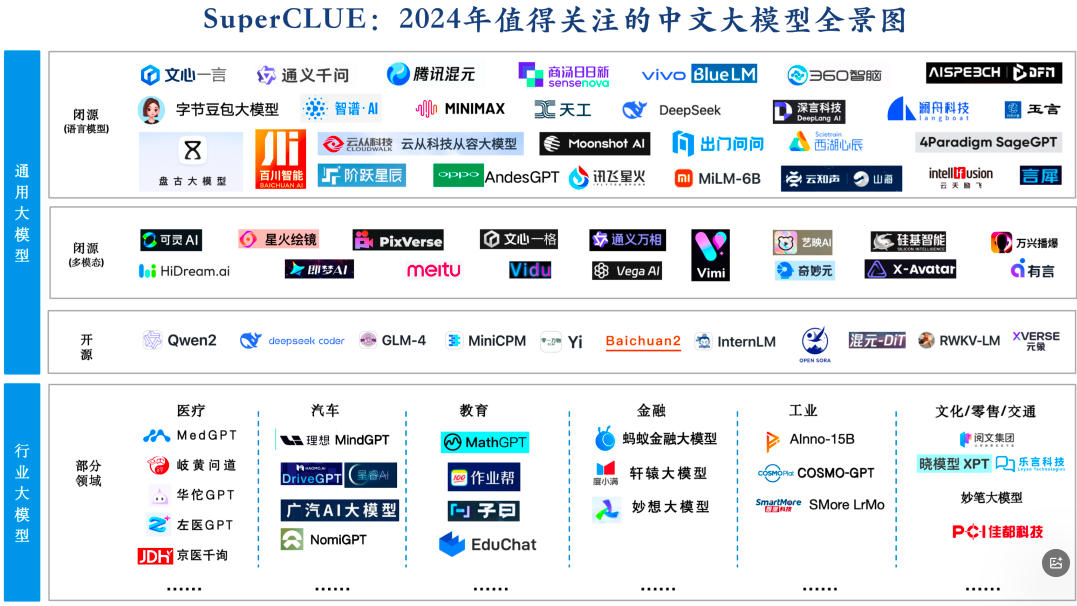

《中文大模型基准测评2024上半年报告》给我们展示了大模型的最新“成绩单”。在这场激烈的竞争中,OpenAI的GPT-4o一骑绝尘,稳居领先位置。不过,国内大模型的表现也相当亮眼,阿里的Qwen2-72B、商汤的SenseChat5.0奋起直追,和GPT-4o的差距已经缩小到5%以内。豆包、Kimi、通义千问、文心一言等也不甘示弱,都取得了70分左右的好成绩,在众多大模型中名列前茅。

在SuperCLUE通用能力测评里,开源模型的表现让人眼前一亮。Qwen2-72B在开源领域脱颖而出,和顶级闭源模型不相上下。零一万物的Yi-1.5-34B同样实力强劲,以超过60分的成绩逼近部分顶级闭源模型,开源大模型的崛起,为企业搭建AI知识库提供了更多性价比高的选择。

热门大模型各有哪些独特优势?

国内大模型

-

DeepSeek:DeepSeek是最近来新兴的大模型,它在训练算法和架构设计上进行了创新。一方面,它拥有高效的训练机制,能快速处理海量数据,使得模型对知识的学习更加全面和深入。另一方面,DeepSeek在知识融合方面表现出色,能将不同领域、不同类型的知识进行有效整合。对于科研、多领域交叉的企业来说,DeepSeek可以提供跨领域的知识洞察和分析,助力企业在复杂的知识体系中找到创新点。

-

文心一言:百度推出的文心一言,是知识增强大语言模型。它就像一个“全能选手”,在文学创作、商业文案撰写、数理逻辑推算、中文理解以及多模态生成方面都很在行。特别是在中文理解和生成上,文心一言有着深厚的功底,依托百度强大的搜索和数据处理能力,再加上海量中文标注数据的优化,它能生成包括图片、语音、视频在内的多模态内容,很适合对中文内容创作和处理有高要求的企业。

-

豆包:字节跳动的豆包是大型多模态语言模型家族。它最大的亮点就是支持高度定制化和个性化服务。不同行业的企业需求各不相同,豆包能根据企业的特定需求进行定制,无论是医疗、教育还是金融行业,都能满足企业多样化的应用场景,展现出字节系强大的技术创新能力。

-

Kimi:Kimi由月之暗面科技打造,以超长文本处理能力闻名。它能无损输入200万汉字,强大的记忆和上下文理解能力让它在处理大规模文本数据时游刃有余。而且操作简单,支持多种文件格式上传,对那些需要处理大量文档资料的企业来说,Kimi是个不错的选择。

-

通义千问:阿里巴巴的通义千问功能丰富,语义理解能力超强,能精准捕捉用户意图。它已经广泛应用在阿里巴巴内部的钉钉、天猫精灵等产品中,经过大量实际场景的打磨,在办公协同、智能客服等领域有着出色的表现,能帮助企业优化内部沟通和客户服务流程。

-

讯飞星火:科大讯飞的讯飞星火专注于语音识别和合成。在语音处理方面,它的表现堪称一流,能提供精准的文本-语音转换服务。对于教育、智能硬件等对语音交互需求大的企业,讯飞星火能助力打造更具交互性和便捷性的产品和服务。

-

智谱清言:智谱AI的智谱清言在自然语言处理方面能力全面,处理大规模文本数据时,能快速准确地完成文本分类、情感分析、命名实体识别等NLP任务。企业在进行内容管理、舆情监测等工作时,智谱清言能提供有力支持。

-

腾讯混元:腾讯混元是自主研发的高性能、低能耗大模型,支持8k-text输入长度,推理总结能力出色。依托腾讯的技术优势,混元为腾讯云在AI云服务市场赢得了竞争优势,企业使用腾讯云相关服务搭建AI知识库时,混元能提供稳定且高效的技术保障。

国外大模型

-

ChatGPT:OpenAI的ChatGPT可以说是家喻户晓,基于GPT模型开发的聊天机器人程序,以对话生成和问题解答能力著称。它能和用户进行流畅、智能的对话,无论是日常交流还是专业知识咨询,ChatGPT都能应对自如,为企业的智能客服、智能助手等应用场景提供了优秀的解决方案。

-

PaLM 2:谷歌的PaLM 2是新一代语言模型,多语言和推理能力突出,计算效率也很高。在全球化业务的企业中,PaLM 2能发挥很大作用,帮助企业处理不同语言的知识内容,满足跨国业务的知识管理需求。

搭建AI知识库,安全隐私不容忽视

企业在使用AI大模型搭建知识库时,安全和隐私问题至关重要。毕竟企业的数据包含了大量敏感信息,一旦泄露,后果不堪设想。所以,企业要采用以隐私保护为核心的机器学习方法和安全数据分析技术。像HelpLook就严格遵循ISO/IEC 27001信息安全标准,在数据传输过程中采用TLS标准进行加密,为企业的数据安全保驾护航。

搭建AI知识库的得力助手

在搭建AI知识库这件事上,HelpLook是个值得推荐的好帮手。它是一款零代码平台,对技术小白非常友好,就算没有专业的技术知识,也能轻松上手。HelpLook支持市面上众多热门AI大模型,企业不用再为挑选模型而烦恼,一站式就能应用所有心仪的模型。而且,它还配备了强大的AI搜索技术,知识检索和推荐又快又准。如果企业想要高效搭建功能强大的AI知识库,不妨试试HelpLook,说不定会有惊喜!

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

1799

1799

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?