23年6月来自澳大利亚、新加坡和国内几所高校的论文“Unifying Large Language Models and Knowledge Graphs: A Roadmap“。

大语言模型(LLM),如ChatGPT和GPT4,由于其涌现能力和泛化性,正在自然语言处理和人工智能领域掀起新的浪潮。然而,LLM是黑盒子模型,通常无法捕捉和获取事实知识。相反,知识图(KGs),例如维基百科和华谱,是明确存储丰富事实知识的结构化知识模型。KGs可以通过为推理和可解释性提供外部知识来增强LLM。同时,KGs在本质上很难构建和进化,这对KGs中现有生成新事实和表示未知知识的方法提出了挑战。因此,将LLM和KGs统一在一起,并同时利用它们的优势,是相辅相成的。本文提出LLM和KGs统一的前瞻性路线图。该路线图由三个通用框架组成,即:1)KG增强LLM,在LLM的预训练和推理阶段结合了KG,或者是为了增强对LLM所学知识的理解;2) LLM增强KG,利用LLM执行不同的KG任务,如嵌入、完成、构建、图-到-文本生成和问答;以及3)协同(Synergized)LLM+KGs,其中LLM和KGs扮演着平等的角色,并以互利的方式工作,增强LLM和KG,实现由数据和知识驱动的双向推理。在路线图中回顾和总结这三个框架内的现有工作,并确定未来的研究方向。

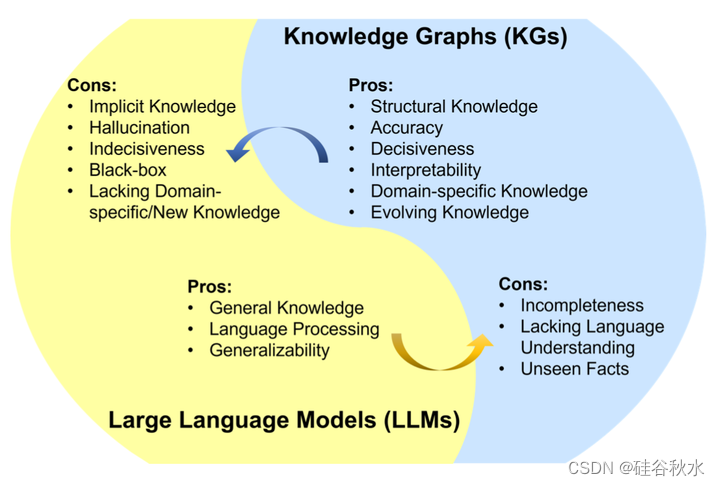

如图是LLM和KG的利弊总结。LLM优点:通识[11],语言处理[12],泛化[13];LLM缺点:隐式知识[14],幻觉[15],不确定[16],黑盒子[17],缺乏特定领域/新知识[18]。KG优点:结构知识[19],准确性[20],决定性[21],可解释性[22],域特定知识[23],进化知识[24];KG缺点:不完整[25],缺乏语言理解[26],未见过的事实[27]。

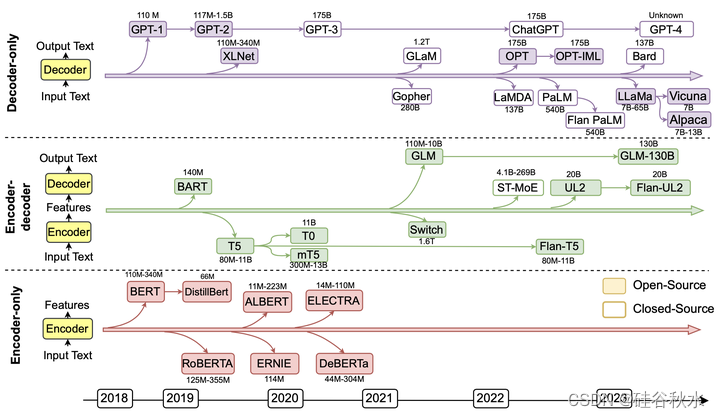

如图是近年来具有代表性的大语言模型(LLM)。开源模型用实心正方形表示,而闭源模型用空心正方形表示。

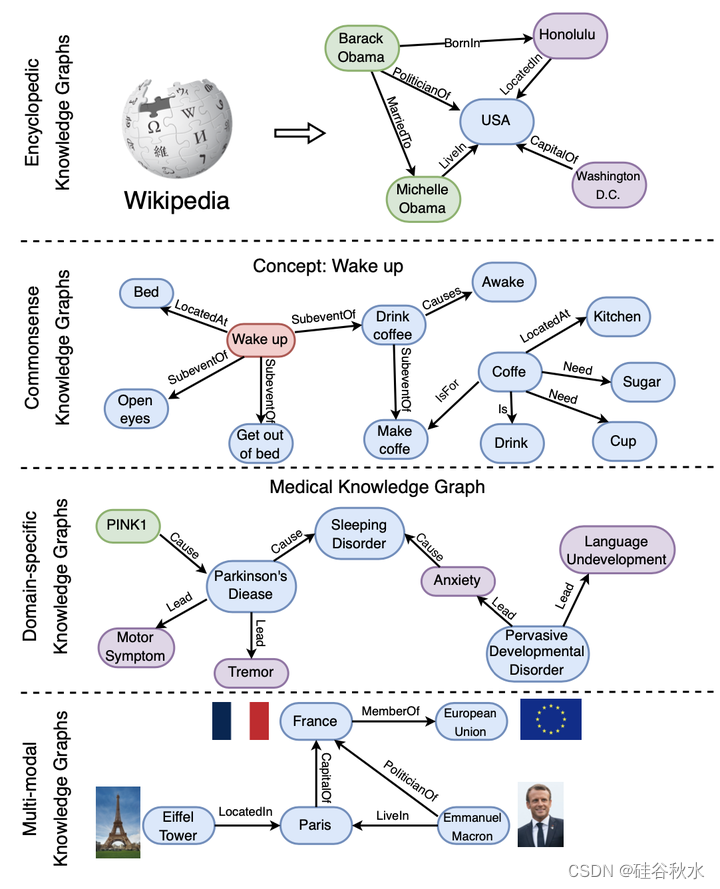

知识图(KGs)将结构化知识存储为三元组KG={(h,r,t)⊆ E×R×E}的集合,其中E和R分别表示实体和关系的集合。根据存储的信息,现有的知识图可以分为四组:1)百科全书式知识图,2)常识性知识图,3)域特定知识图,4)多模态知识图。如图举例说明了不同类别的KGs。

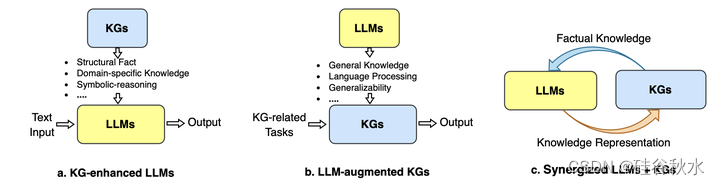

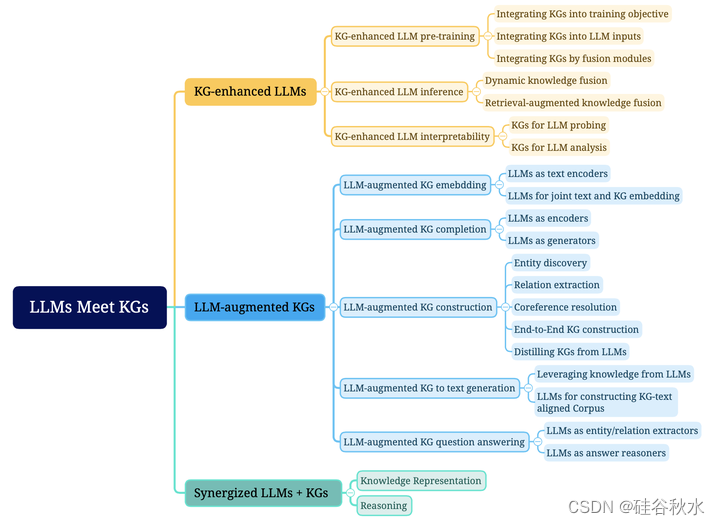

统一KGs和LLM的路线图如图所示。在路线图中,确定LLM和KG统一的三个框架,即KG增强LLM、LLM增强KG和协同LLM+KG。

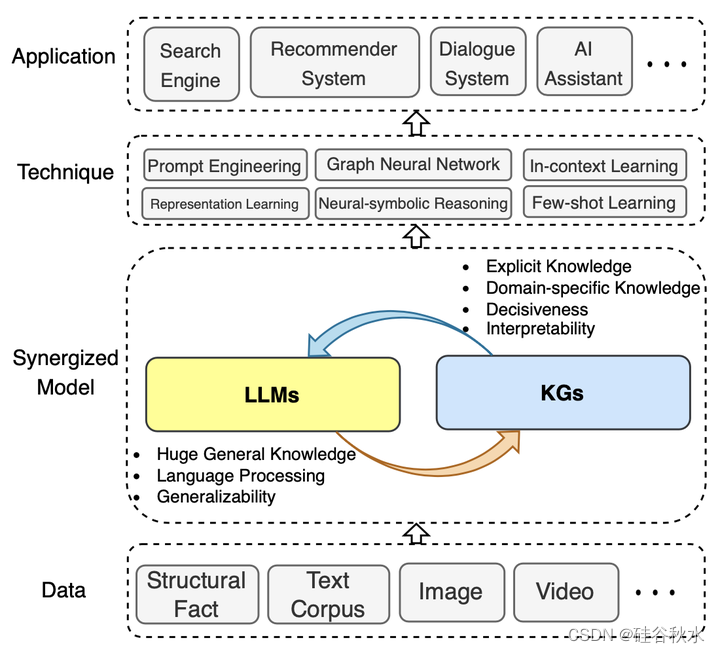

LLM和KGs的协同作用近年来引起了研究人员越来越多的关注[40],[42]。LLM和KGs是两种本质上互补的技术,它们应该统一到一个通用框架中,以相互增强。为了进一步探索统一性,如图提出协同LLM+KGs的统一框架,包含四层:1)数据层,2)协同模型层,3)技术层,4)应用层。

在数据层中,LLM和KGs分别用于处理文本数据和结构数据。随着多模态LLM[101]和KGs[102]的发展,该框架可以扩展到处理多模态数据,如视频、音频和图像。在协同模型层,LLM和KGs可以相互协同以提高其能力。在技术层,可以将LLM和KG中使用的相关技术纳入,进一步提高性能。在应用层,LLM和KGs可以统一在一起,解决各种现实世界的应用,如搜索引擎[103]、推荐系统[10]和人工智能助手[104]。

如图进一步细分LLM和KG的统一化方法:

KG增强LLM分为三组:

1) KG强化LLM预训练,包括在预训练阶段应用KG并改进LLM知识表达。

2) KG增强LLM推理,包括在LLM推理阶段使用KG的研究,使LLM能够在不进行再训练的情况下访问最新知识。

3) KG增强LLM可解释性,包括用KG来理解LLM所学到的知识并解释LLM推理过程。

LLM增强KGs分为五组:

1) LLM增强KG嵌入,包括应用LLM对实体和关系的文本描述进行编码,丰富KG表示。

2) LLM增强KG补全,包括利用LLM对文本进行编码或生成事实,获得更好的KGC性能。

3) LLM增强KG构建,包括应用LLM来解决KG构建的实体发现、核心解析和关系提取。

4) LLM增强KG-到-文本的生成,包括重新搜索,利用LLM生成描述KG事实的自然语言。

5) LLM增强KG问答,包括应用LLM来弥合自然语言问题和KG检索答案之间的差距。

未来工作的一些方法探讨:

- KG对LLM的幻觉检测

- KG对LLM的知识编辑

- KG对黑盒子LLM知识注入

- 多模态LLM对KG的扩展

- LLM对KG结构的理解

- LLM和KG协同的双向推理

1495

1495

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?