本次我们的项目实训中也需要结合到大语言模型的使用。

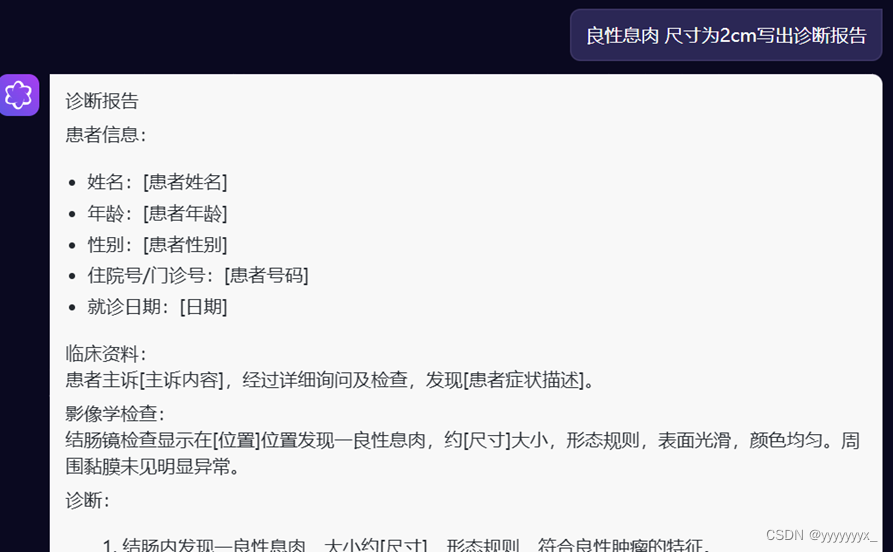

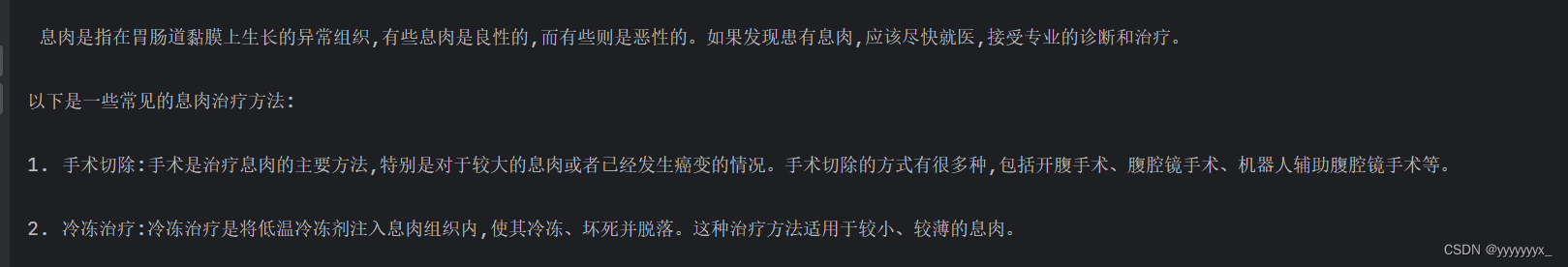

因为我们在提取了相应的息肉特征后,要将其发送给大语言模型,给出我们的辅助诊断报告。

我们的预期效果如上图所示。

那么我们首先要解决的问题就是如何部署大语言模型。

我们可以看到老师给我们提供的阿里魔搭社区里是具有一些大语言模型的

然而modelscope中有些大语言模型是不支持我们进行线上部署的。

于是我们决定使用阿里云进行大语言模型的线上部署与使用。

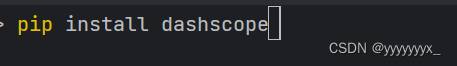

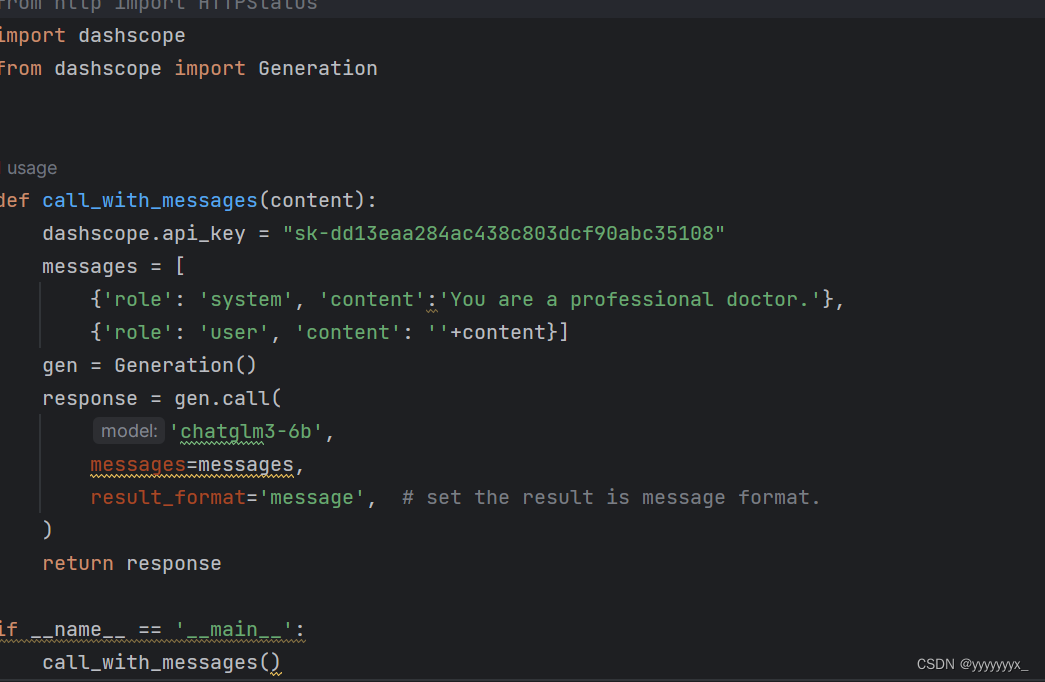

根据阿里云上的教程我们先安装DashScope SDK

我们在python中使用pip install dashscope即可安装

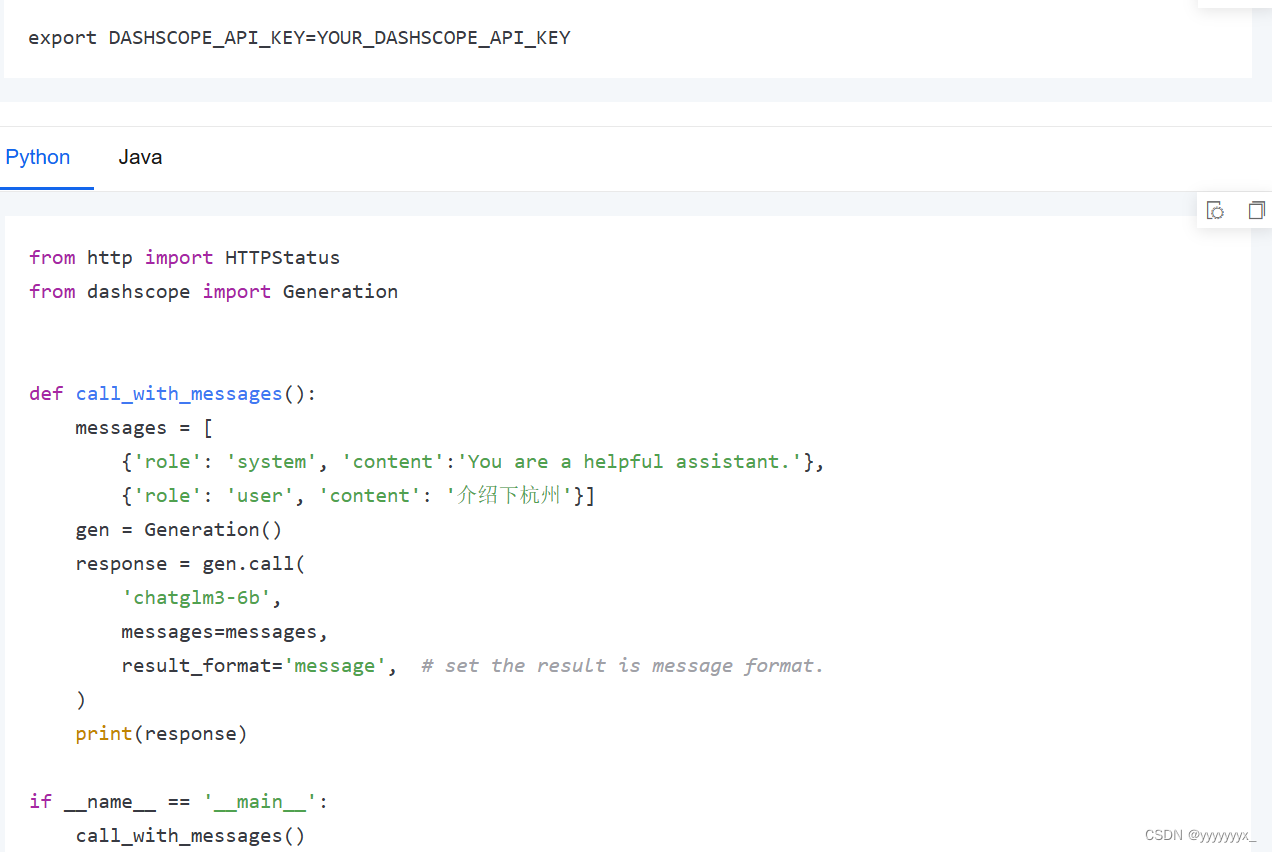

接着我们应该配置api_key。

这里需要我们开通api_key因为有些是大语言模型是需要根据token计费的。

这里我们已经进行了开通。接下来我们可以选择合适的大语言模型进行线上部署与使用。

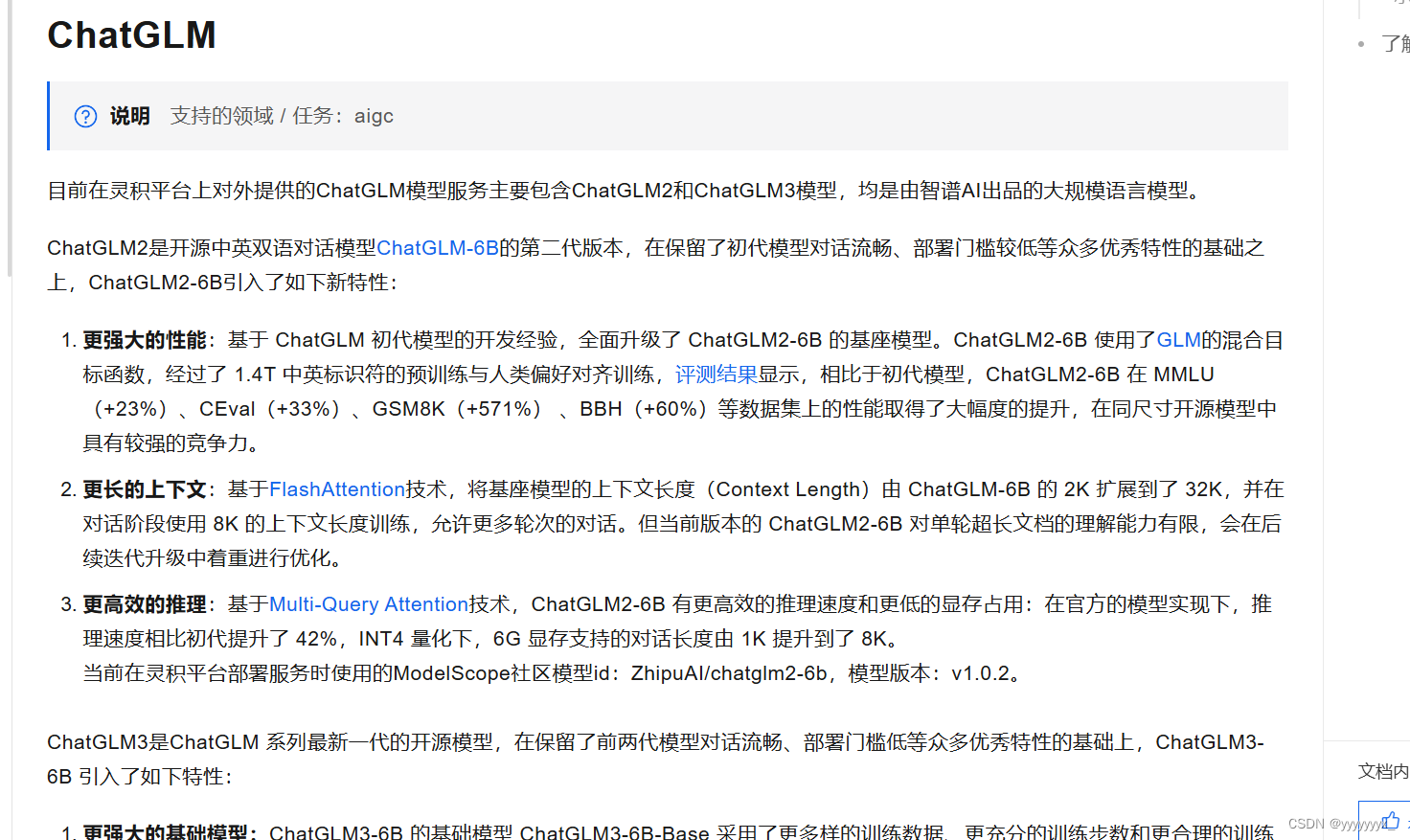

这里我们选择的模型是Chatglm3

ChatGLM3是ChatGLM 系列最新一代的开源模型,在保留了前两代模型对话流畅、部署门槛低等众多优秀特性的基础上,ChatGLM3-6B 引入了如下特性:

-

更强大的基础模型:ChatGLM3-6B 的基础模型 ChatGLM3-6B-Base 采用了更多样的训练数据、更充分的训练步数和更合理的训练策略。在语义、数学、推理、代码、知识等不同角度的数据集上测评显示,ChatGLM3-6B-Base 具有在 10B 以下的预训练模型中最强的性能。

-

更完整的功能支持:ChatGLM3-6B 采用了全新设计的Prompt格式,除正常的多轮对话外。同时原生支持工具调用(Function Call)、代码执行(Code Interpreter)和 Agent 任务等复杂场景。

-

更全面的开源序列:除了对话模型 ChatGLM3-6B 外,还开源了基础模型 ChatGLM-6B-Base、长文本对话模型 ChatGLM3-6B-32K。

我们接着来参照他的快速开始来部署我们的大语言模型。

接下来我们来试验一下在Pycharm里面能否运行。

经测试是可以正常使用的,我们视情况而定后期要不要微调大语言模型,因为我们的主要还是通过SAM进行切割,大语言模型只是我们的辅助功能。

635

635

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?