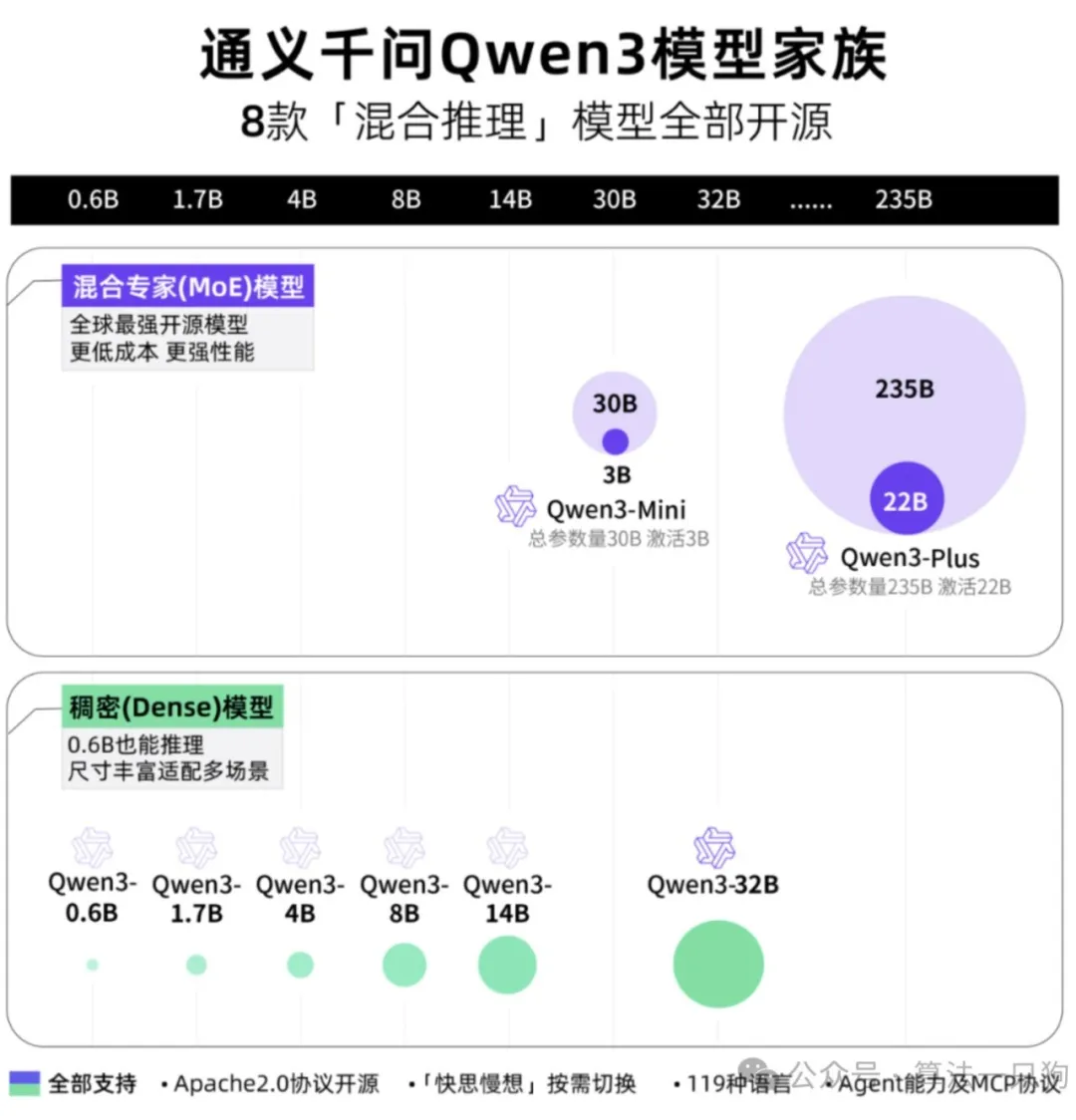

近期,阿里巴巴通义千问Qwen3系列大型语言模型正式发布并开源。此次发布包含了2款采用混合推理(Mixture-of-Experts, MoE)架构和6款稠密(Dense)架构的模型,这些模型在代码、数学、通用能力等基准测试中表现出色,与顶级模型相比展现出极具竞争力的结果。

1、Qwen3模型概览

Qwen3系列涵盖了从十亿级到千亿级参数规模的模型,满足不同应用场景的需求。主要分为MoE架构和Dense架构两种类型。

MoE (Mixture-of-Experts) 模型

MoE模型通过在推理时仅激活部分专家(参数子集)来提高效率,能在较低的计算成本下实现高性能。

| 模型名称 | 总参数量 | 激活参数量 | 上下文长度 | 特点 |

|---|---|---|---|---|

| Qwen3-235B-A22B | ~2350亿 | ~220亿 | 128K | 旗舰模型,与顶级模型相比表现极具竞争力 |

| Qwen3-30B-A3B | ~300亿 | ~30亿 | 128K | 小型MoE模型,激活参数量是Qwen-32B的10%,但表现更胜一筹 |

Dense (密集) 模型

Dense模型在推理时会使用所有参数。Qwen3的Dense模型在性能上实现了显著提升,小参数模型也能达到前代大参数模型的水平。

| 模型名称 | 总参数量 | 上下文长度 | 特点 |

|---|---|---|---|

| Qwen3-32B | ~320亿 | 32K | 性能与Qwen2.5-72B基础模型相当 |

| Qwen3-14B | ~140亿 | 32K | 性能与Qwen2.5-32B基础模型相当 |

| Qwen3-8B | ~80亿 | 32K | 性能与Qwen2.5-14B基础模型相当 |

| Qwen3-4B | ~40亿 | 32K | 性能匹敌Qwen2.5-72B-Instruct,体现了"以小博大"特点 |

| Qwen3-1.7B | ~17亿 | 32K | 性能与Qwen2.5-3B基础模型相当 |

| Qwen3-0.6B | ~6亿 | 32K | 系列中最小的模型,适用轻量级应用和嵌入式场景 |

注:Dense模型的上下文长度是基于预训练最后阶段扩展到32K推断,具体请参考官方文档。

2、核心亮点与特性

混合思维模式 (Hybrid Thinking Modes):

- 思考模式 (Thinking Mode): 模型逐步推理,深思熟虑后给出答案,适合复杂问题。可通过

enable_thinking=True(默认)或在提示中加入/think启用。 - 非思考模式 (Non-thinking Mode): 快速响应,适用于速度优先的简单问题。可通过

enable_thinking=False或在提示中加入/no_think启用。 - 这种设计允许用户根据任务需求灵活控制模型的"思考预算",平衡成本与质量。

广泛的多语言支持: 支持119种语言和方言,覆盖范围广泛,便于全球化应用。

增强的Agent与代码能力: 优化了模型的Agent(工具调用、规划)和代码生成能力,并加强了对MCP(多轮协作规划)的支持。推荐使用Qwen-Agent框架发挥其Agent能力。

卓越的性能:

-

以小博大: 如Qwen3-4B性能可匹敌前代Qwen2.5-72B-Instruct。

-

Qwen3 Dense基础模型性能普遍达到或超过更大参数规模的Qwen2.5基础模型。

-

MoE模型在激活少量参数的情况下,性能媲美同级别Dense模型,显著节省训练和推理成本。

-

先进的训练流程: 经过约36万亿token(几乎是Qwen2.5的两倍)的三阶段预训练,以及包含长思维链微调、强化学习、思维模式融合的四阶段后训练,保证了模型的强大能力和灵活性。

3、获取与使用

Qwen3系列模型已全面开源,可供全球开发者、研究机构和企业免费下载和商用。

下载平台:

-

魔搭社区(ModelScope): https://modelscope.cn/collections/Qwen3-9743180bdc6b48

-

Hugging Face: https://huggingface.co/collections/Qwen/qwen3-67dd247413f0e2e4f653967f

-

GitHub(代码库): https://github.com/QwenLM/Qwen3

-

Kaggle

-

API服务: 可通过阿里云百炼(Bailian)调用Qwen3 API。

终端用户体验:

- 通义APP已集成Qwen3

- 夸克APP即将全线接入Qwen3

部署与本地使用框架:

- 推荐部署框架: SGLang, vLLM(支持与OpenAI API兼容的endpoint)

- 推荐本地使用工具: Ollama, LMStudio, MLX, llama.cpp, KTransformers

使用示例(Hugging Face Transformers):

以下是如何在Hugging Face transformers中使用Qwen3并控制思考模式的示例:

from modelscope import AutoModelForCausalLM, AutoTokenizer # 或者 from transformers import ...

model_name = "Qwen/Qwen3-30B-A3B"# 示例模型

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name, torch_dtype="auto", device_map="auto")

prompt = "给我简单介绍一下大语言模型。"

messages = [{"role": "user", "content": prompt}]

# 启用思考模式(默认)

text_thinking = tokenizer.apply_chat_template(

messages, tokenize=False, add_generation_prompt=True, enable_thinking=True

)

# 禁用思考模式

text_no_thinking = tokenizer.apply_chat_template(

messages, tokenize=False, add_generation_prompt=True, enable_thinking=False

)

# 选择一种模式进行推理

# model_inputs = tokenizer([text_thinking], return_tensors="pt").to(model.device)

model_inputs = tokenizer([text_no_thinking], return_tensors="pt").to(model.device) # 使用非思考模式示例

generated_ids = model.generate(**model_inputs, max_new_tokens=512) # 调整max_new_tokens

output = tokenizer.decode(generated_ids[0][len(model_inputs.input_ids[0]):], skip_special_tokens=True)

print("Output:", output)

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

290

290

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?