前言

本文来看两个问题:

一个是RAG用于文档级别图谱构建框架RAKG拆解,从架构和代码拆解两个方面来看,看具体实现。

另一个是多模态RAG小Demo之NoOCR实现拆解,看看响亮口号之下是如何简陋的实现,这样能够加深印象,从代码出发理解会更加具象化。

抓住根本问题,做根因,专题化,体系化,会有更多深度思考。大家一起加油。

一、RAG用于文档级别图谱构建框架-RAKG拆解

先看RAG用于图谱构建,文档级别检索增强知识图谱构建(RAKG)框架,《RAKG:Document-level Retrieval Augmented Knowledge Graph Construction》,https://arxiv.org/pdf/2504.09823,代码地址在:https://github.com/LMMApplication/RAKG

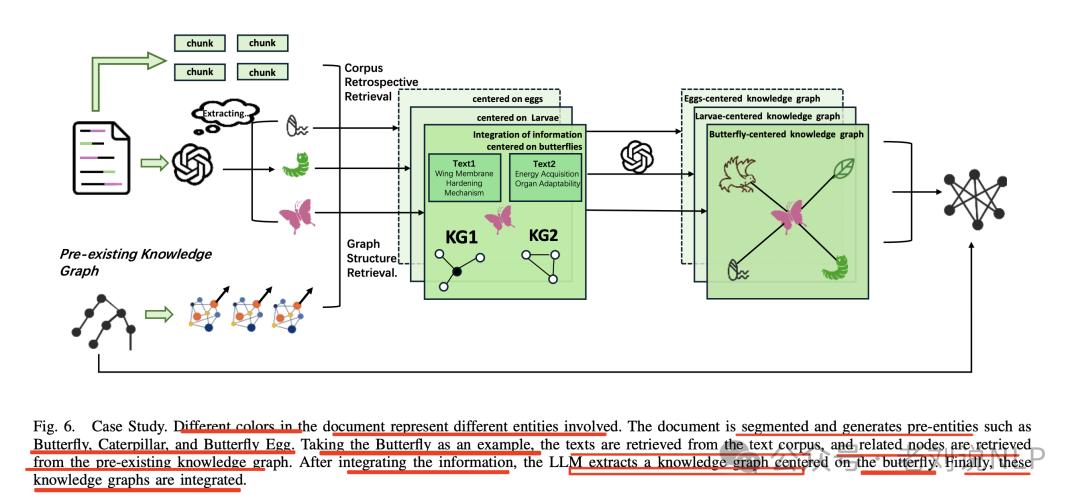

先来看一个具体的例子,文档中不同颜色代表涉及的不同实体。文档被分割并生成了预实体,例如蝴蝶、毛毛虫和蝴蝶卵。

以蝴蝶为例,从文本语料库中检索相关文本,并从现有的知识图谱中检索相关节点,在整合信息后,大型语言模型(LLM)提取出以蝴蝶为中心的知识图谱。最后,这些知识图谱被整合在一起。

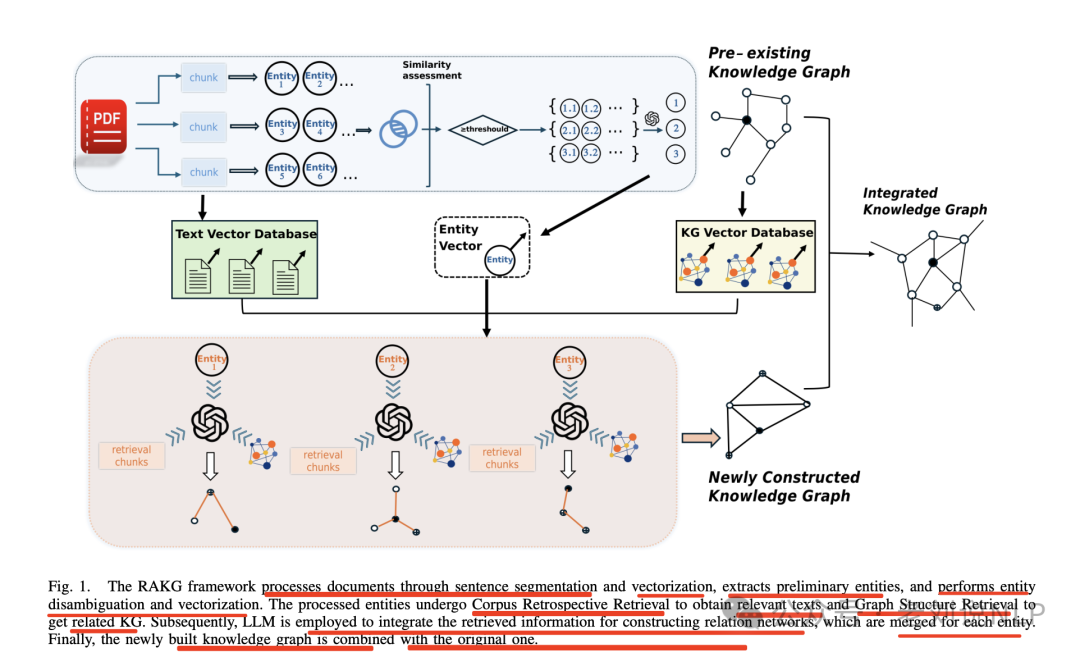

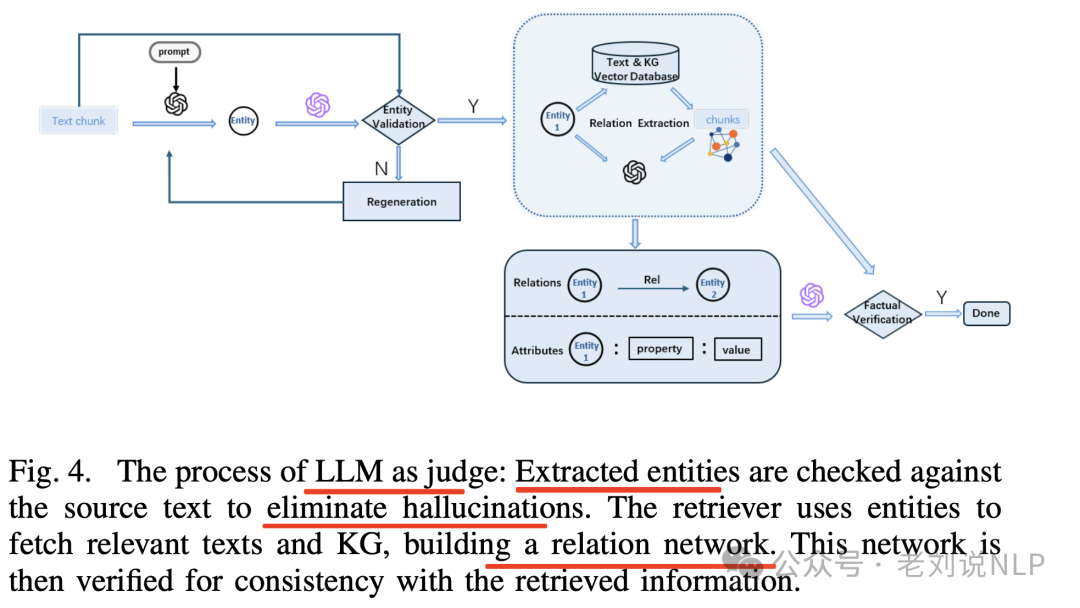

那么,具体是如何做的?可以看如下的流程图。

对应的代码在:https://github.com/LMMApplication/RAKG/blob/main/src/construct/RAKG.py

拆解出来的思路如下:

1、通过对文档进行句子分割和向量化处理

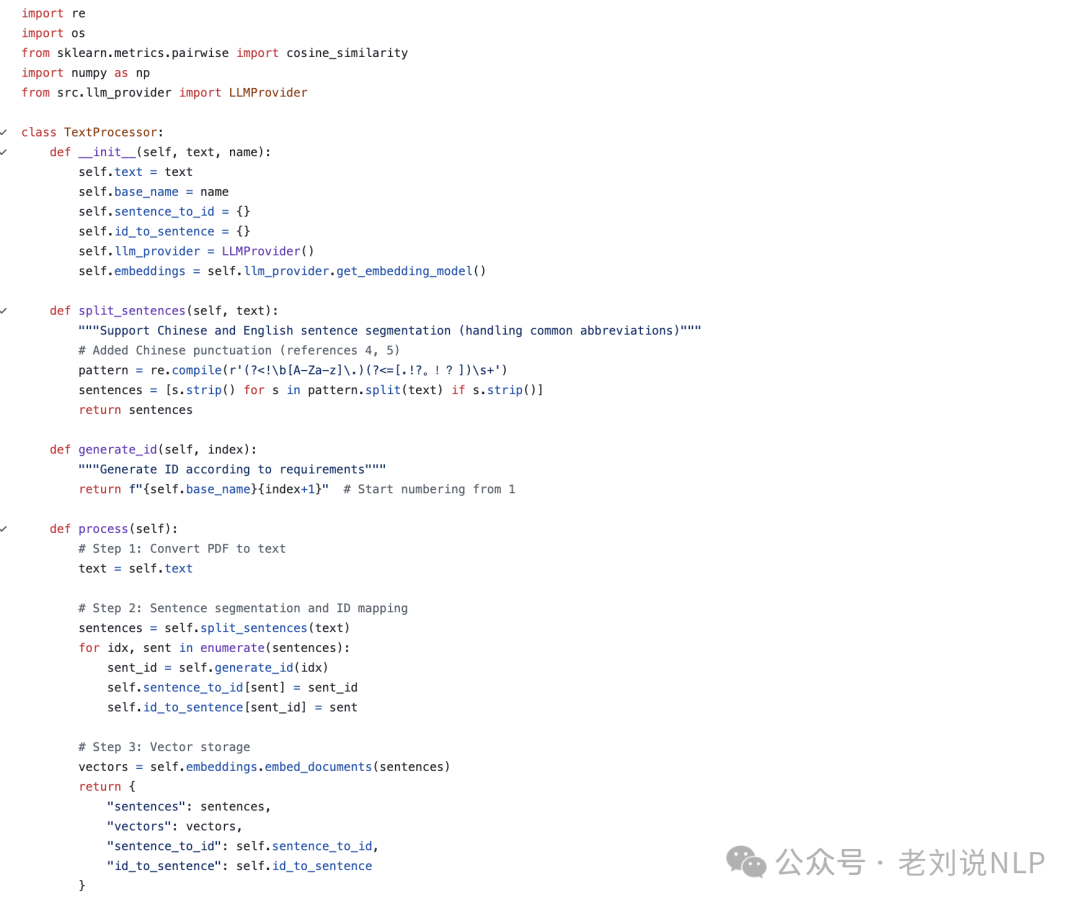

首先,将文档分块并向量化,T=DocSplit(D)。其中,T表示分块后的文本,DocSplit函数根据语义完整性进行动态分块。这个说的语义完整性,使用的很粗暴,https://github.com/LMMApplication/RAKG/blob/main/src/textPrcess.py,就是按照标点符号这些做的。

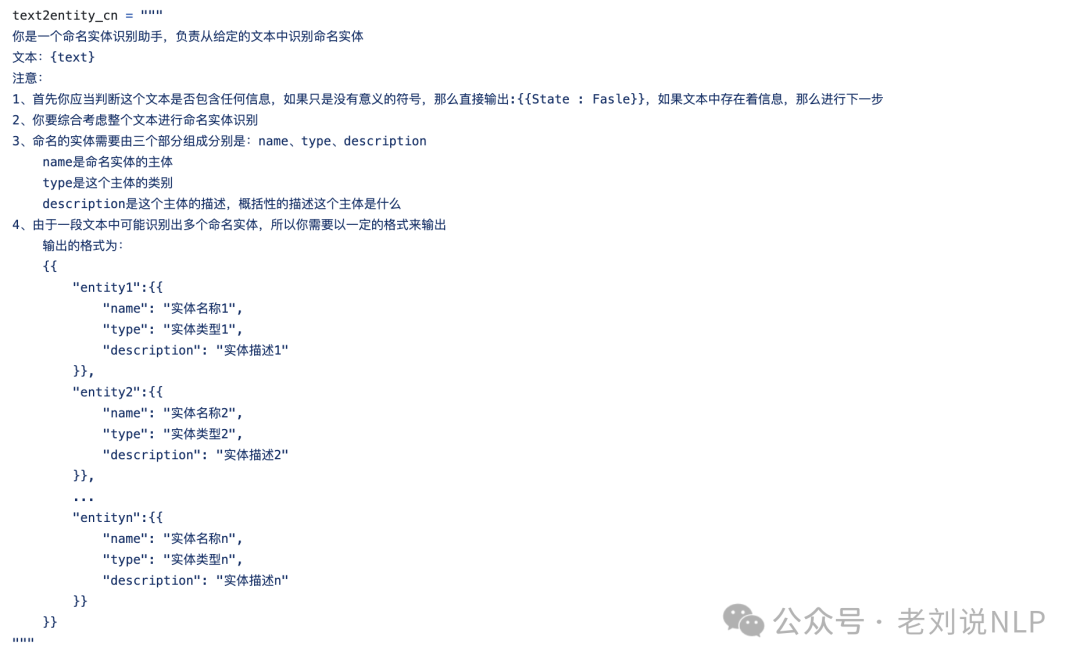

2、提取初步实体对分块文本进行命名实体识别(NER),并分配类型和描述属性。这块的prompt在:https://github.com/LMMApplication/RAKG/blob/main/src/prompt.py

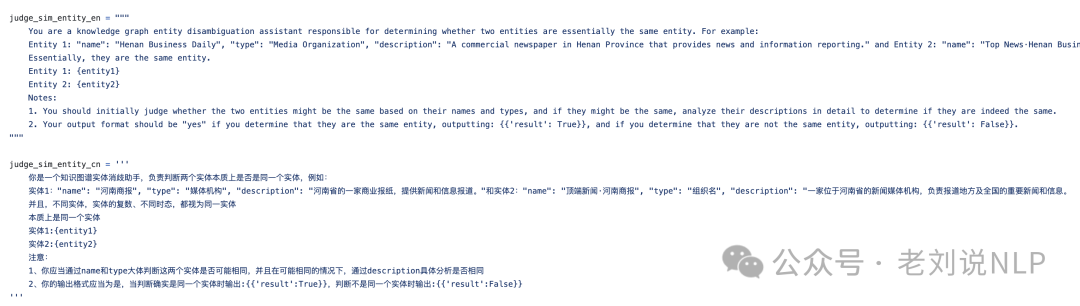

3、对识别的实体进行消歧,形成最终的相似实体集。

这里也是使用prompt完成,在https://github.com/LMMApplication/RAKG/blob/main/src/prompt.py

4、进行实体向量化,使用BGE-M3模型对每个分块进行向量化处理。

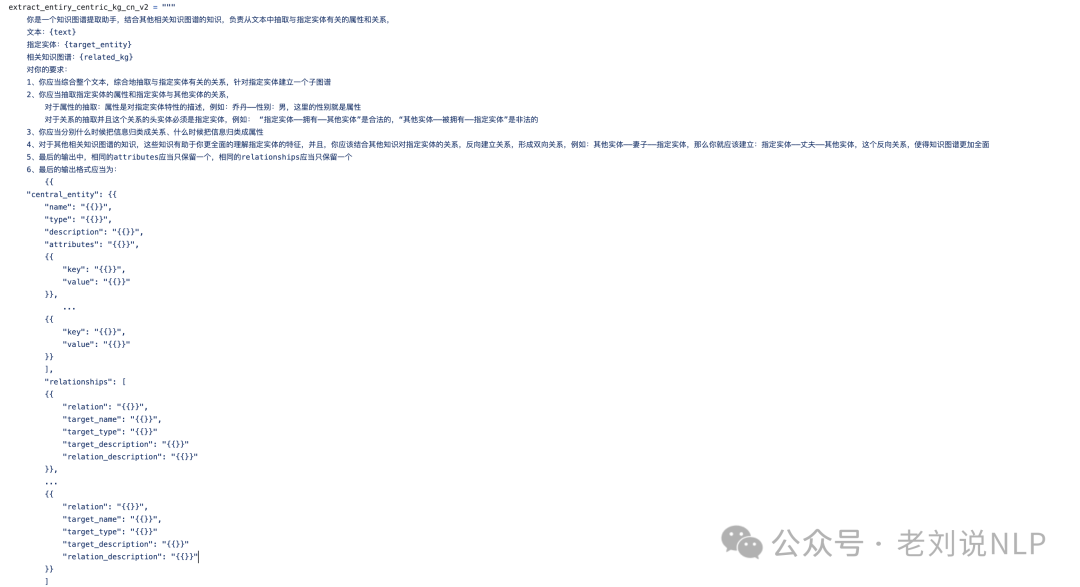

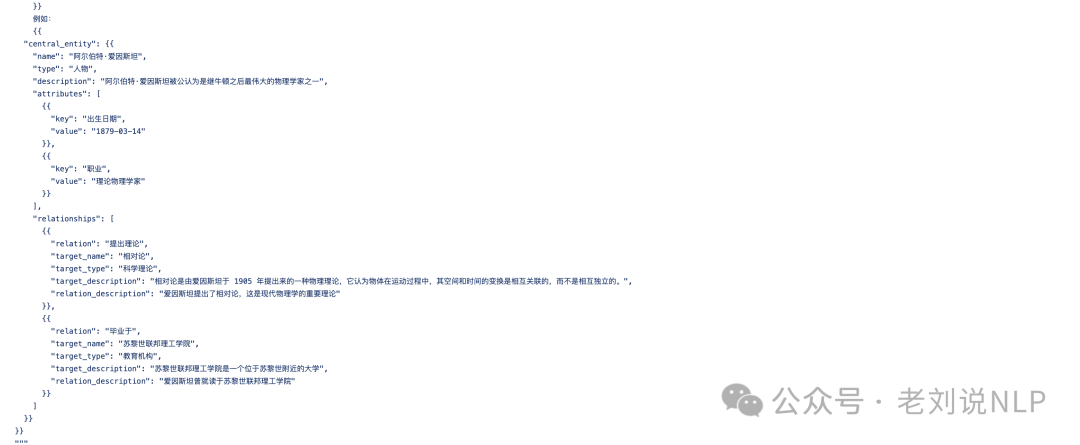

5、检索实体相关网络、上下文。处理后的实体会经过语料库回顾检索(Corpus Retrospective Retrieval)以获取相关文本,以及图结构检索(Graph Structure Retrieval)以获取相关文本和关系网络,然后送入LLM生成中心实体的属性和关系,这里对应的prompt如下:

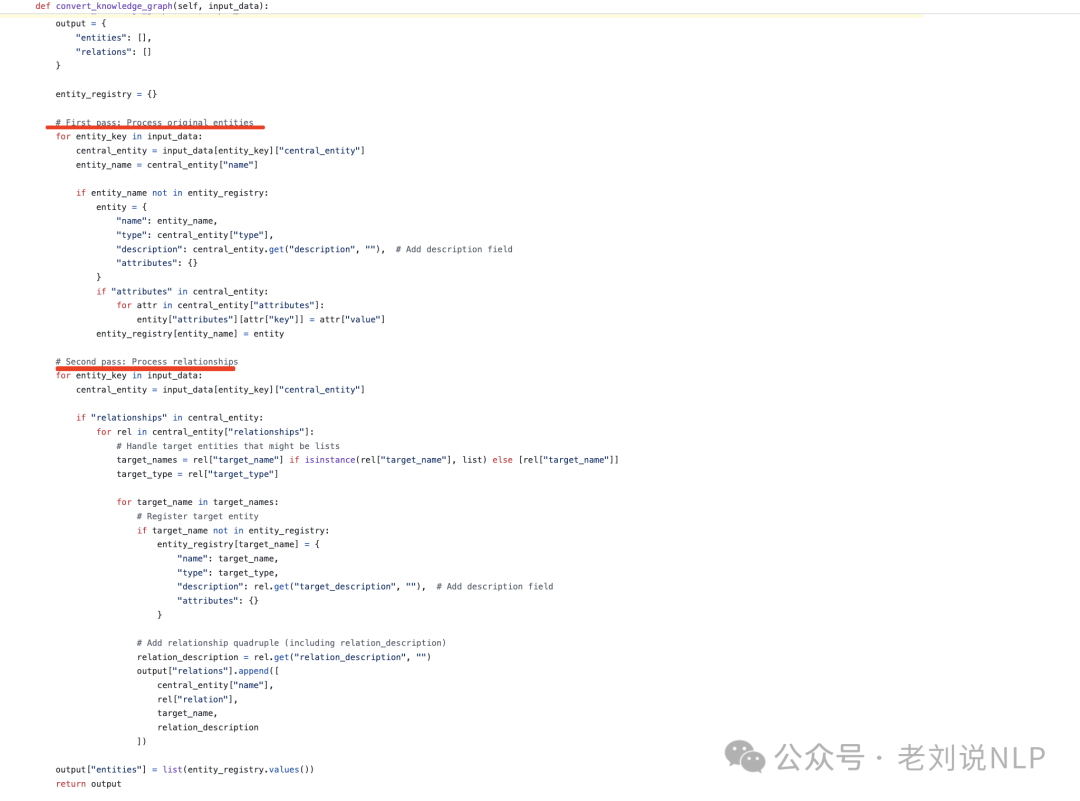

6、将新构建的知识图谱与原始知识图谱进行整合,合并新知识图谱中的实体和关系。这个地址在:https://github.com/LMMApplication/RAKG/blob/main/src/kgAgent.py#L294

核心就是走了2道,陆续合并实体和实体关系。

二、多模态RAG小Demo之NoOCR实现拆解

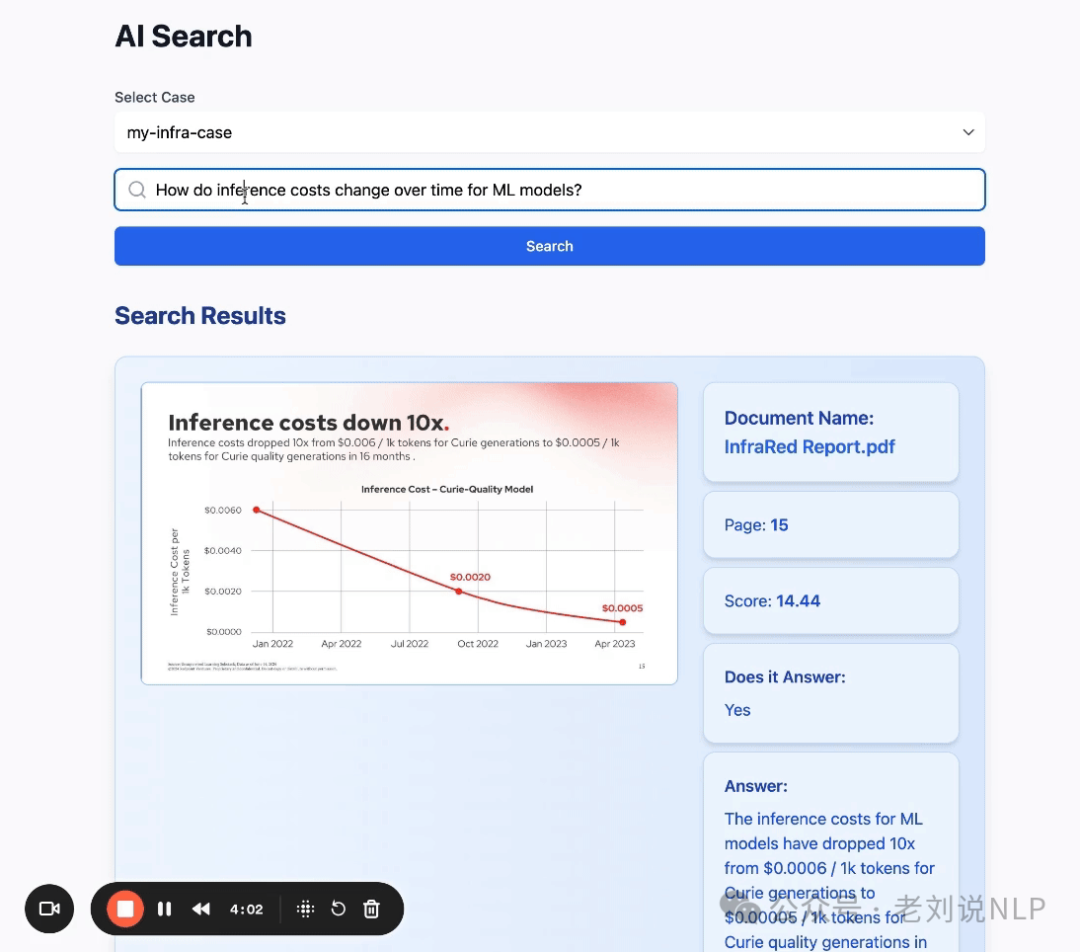

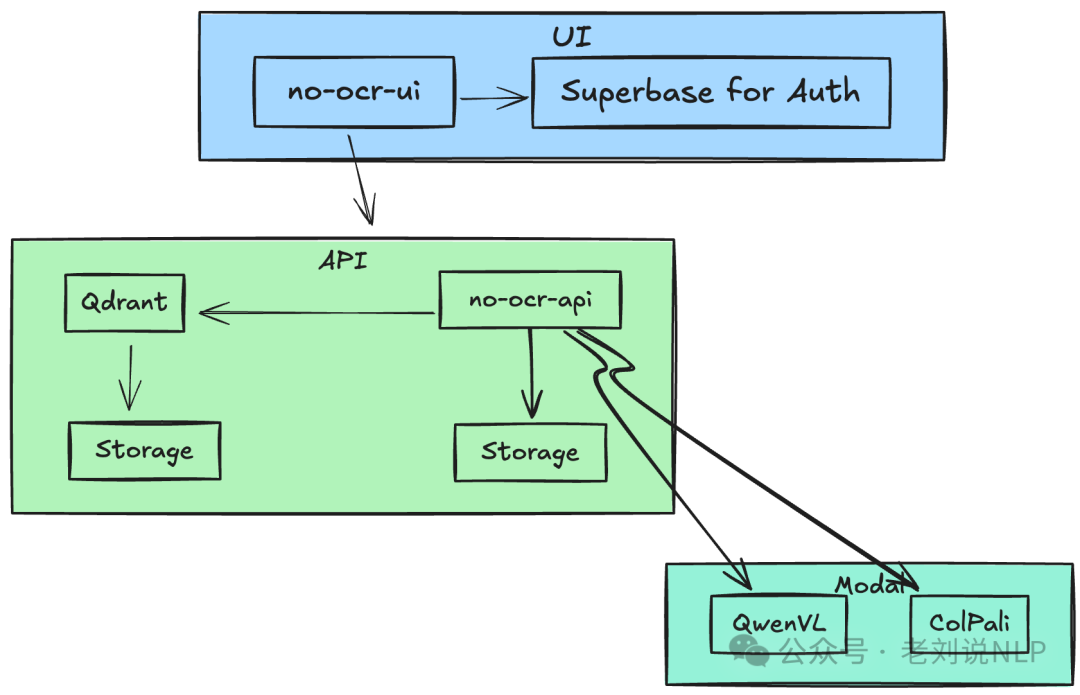

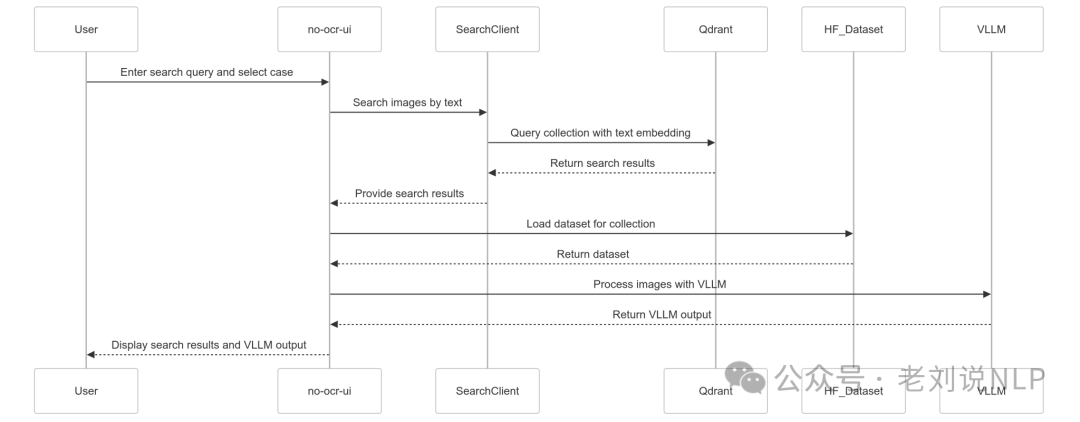

超demo级别多模态文档RAG。NoOCR(https://github.com/kyryl-opens-ml/no-ocr),slogan喊的很响,只需上传PDF文件,即可快速搜索或询问关于多个文档集合中的内容,无需依赖传统OCR技术,大大提升文档分析效率【其实一点都不大】,就是pdf切页面,转embedding,根据query召回后送多模态模型做vqa,结束。

具体实现很粗暴:

在实现选型上,基于向量的PDF页面和相关图像搜索。

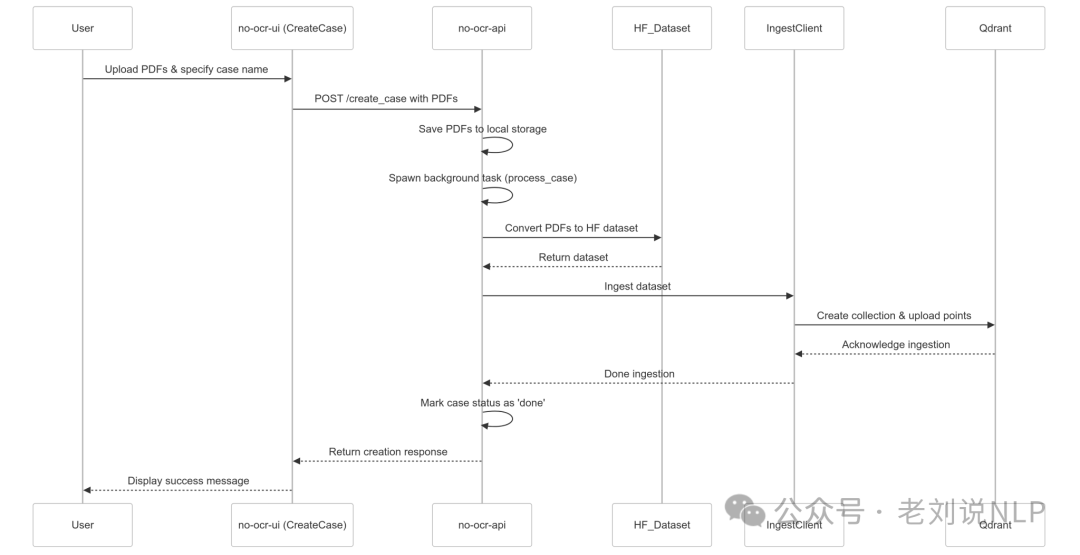

1、建库阶段

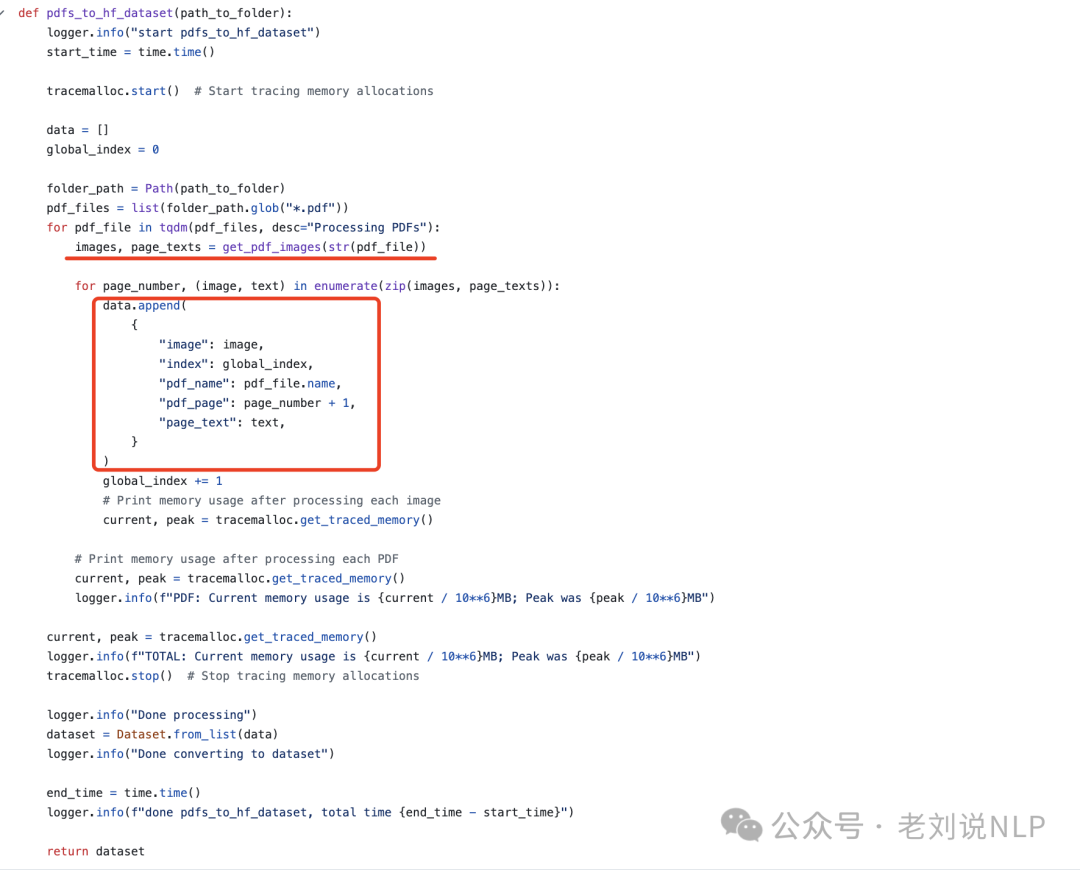

代码在https://github.com/kyryl-opens-ml/no-ocr/blob/main/no-ocr-api/np_ocr/data.py,对上传的pdf做处理,专程huggingface Data的形式。

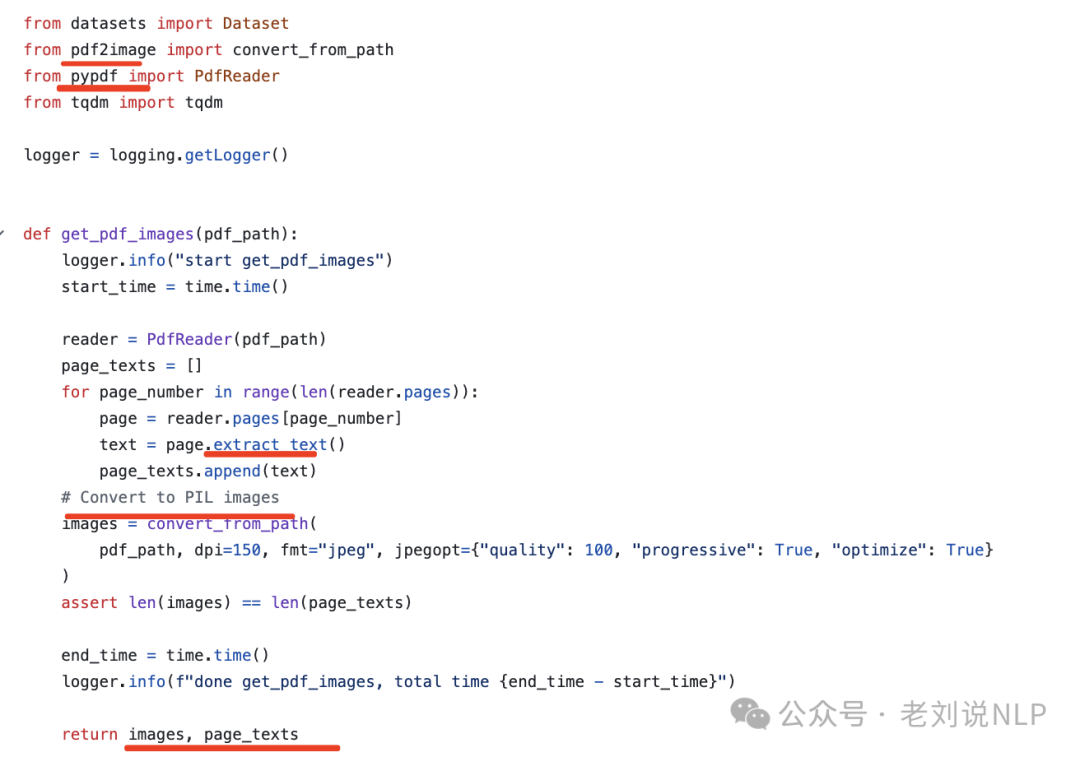

其中,将pdf处理后得到每一页的内容跟图片形式,使用的是pypdf和pdf2image。

其实,text文本内容都没有用到。

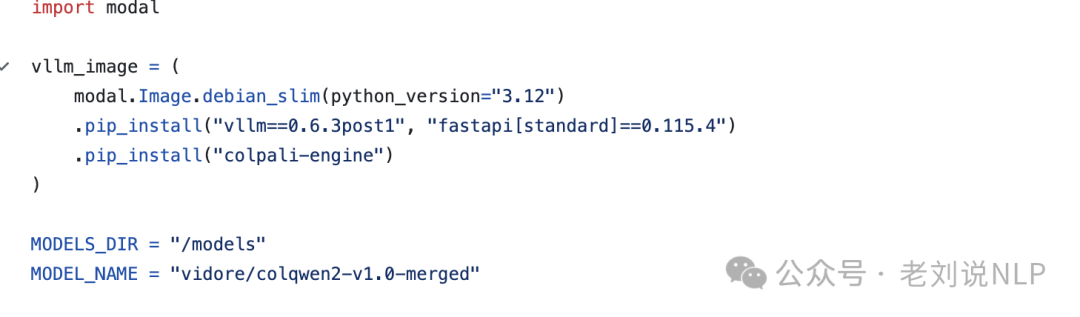

然后,使用LanceDB进行存储;使用ColQwen2进行embedding以及检索,服务的代码在https://github.com/kyryl-opens-ml/no-ocr/blob/main/no-ocr-llms/llm_serving_colpali.py。

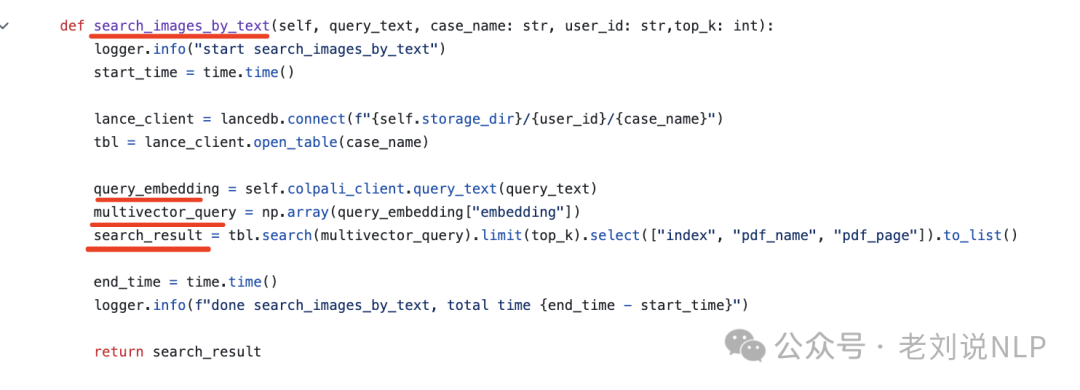

2、检索阶段

整体代码在:https://github.com/kyryl-opens-ml/no-ocr/blob/main/no-ocr-api/np_ocr/search.py

其中,检索相关的图片逻辑如下:

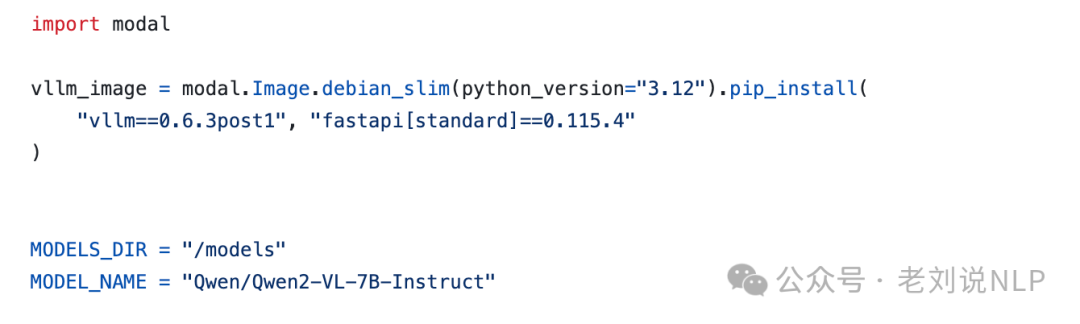

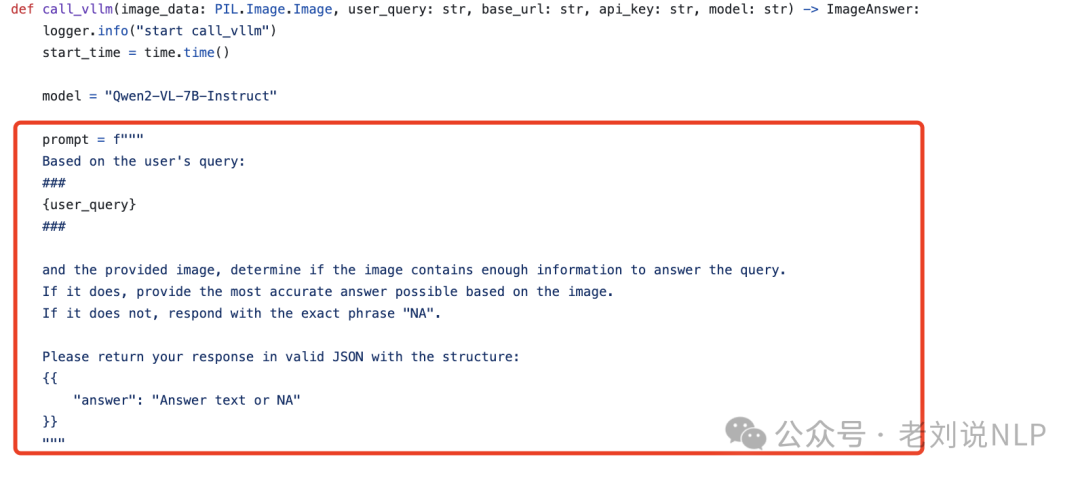

通过Qwen2-VL-7B-Instruct对图像进行视觉问答,服务代码在:https://github.com/kyryl-opens-ml/no-ocr/blob/main/no-ocr-llms/llm_serving.py

其中,使用的prompt为:

所以,总体来看,项目很简陋。

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

2030

2030

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?