★

我们平时使用的ChatGPT、kimi、豆包等Ai对话工具,其服务器都是部署在各家公司的机房里,如果我们有一些隐私数据发到对话中,很难保证信息是否安全等问题,如何在保证数据安全的情况下,又可以使用大语言模型,Ollma(哦拉玛)可以告诉你答案!

”

这是一个保姆级的教程,从下载到成功运行Qwen2.5大模型,更适合没有玩过Ollma的小白宝宝哦~

1. Ollma 是什么?

★

一句话介绍:一个可以让你在本地启动并运行大型语言模型的工具!

”

Ollma是一个开源的大模型服务工具,他可以让你在一行代码不写的情况下,在本地通过一条命令即可运行大模型。

Ollma会根据电脑配置,自动选择用CPU还是GPU运行,如果你的电脑没有GPU,会直接使用CPU进行运行(可能有点慢)

2. 安装教程

Ollma官网:[https://ollama.com/]

模型仓库:[https://ollama.com/library]

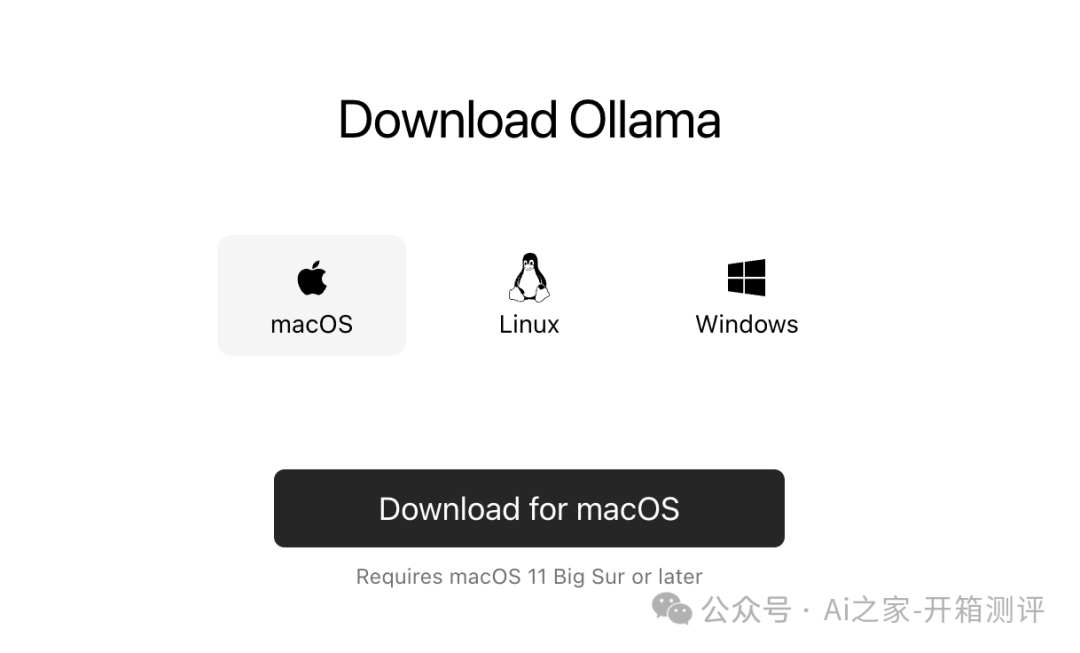

2.1 首先去官网下载

从主页点击下载,直接跳转到了当前系统所兼容的下载界面,点击download,一键下载

2.2 下载好之后安装

博主的电脑是Mac,下载好之后,直接把压缩包解压,然后移动到应用程序中即可,其他操作系统,参考这个文档:

[Windows 下的安装与配置](https://datawhalechina.github.io/handy-ollama/#/C2/2.%20Ollama%20%E5%9C%A8%20Windows%20%E4%B8%8B%E7%9A%84%E5%AE%89%E8%A3%85%E4%B8%8E%E9%85%8D%E7%BD%AE)``[Linux 安装Ollma ](https://datawhalechina.github.io/handy-ollama/#/C2/3.%20Ollama%20%E5%9C%A8%20Linux%20%E4%B8%8B%E7%9A%84%E5%AE%89%E8%A3%85%E4%B8%8E%E9%85%8D%E7%BD%AE)``[Docker 安装 Ollma](https://datawhalechina.github.io/handy-ollama/#/C2/4.%20Ollama%20%E5%9C%A8%20Docker%20%E4%B8%8B%E7%9A%84%E5%AE%89%E8%A3%85%E4%B8%8E%E9%85%8D%E7%BD%AE)

下载好之后,打开,当这个帅气的小羊驼显示在你的任务栏中的时候,说明已经启动成功了!

image.png

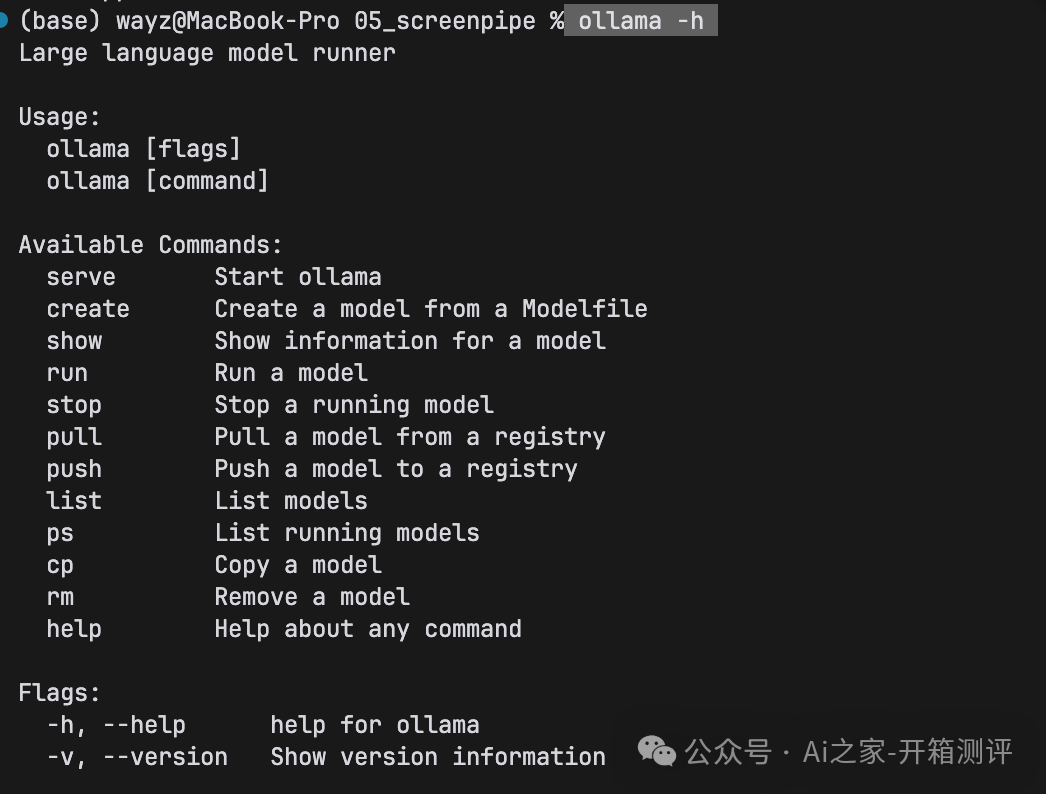

2.3 测试一下

打开命令行,输入ollama -h看到以下界面,就可以进行下一步,操作了~

3. 导入开源Qwen 2.5 - 0.5B 大模型

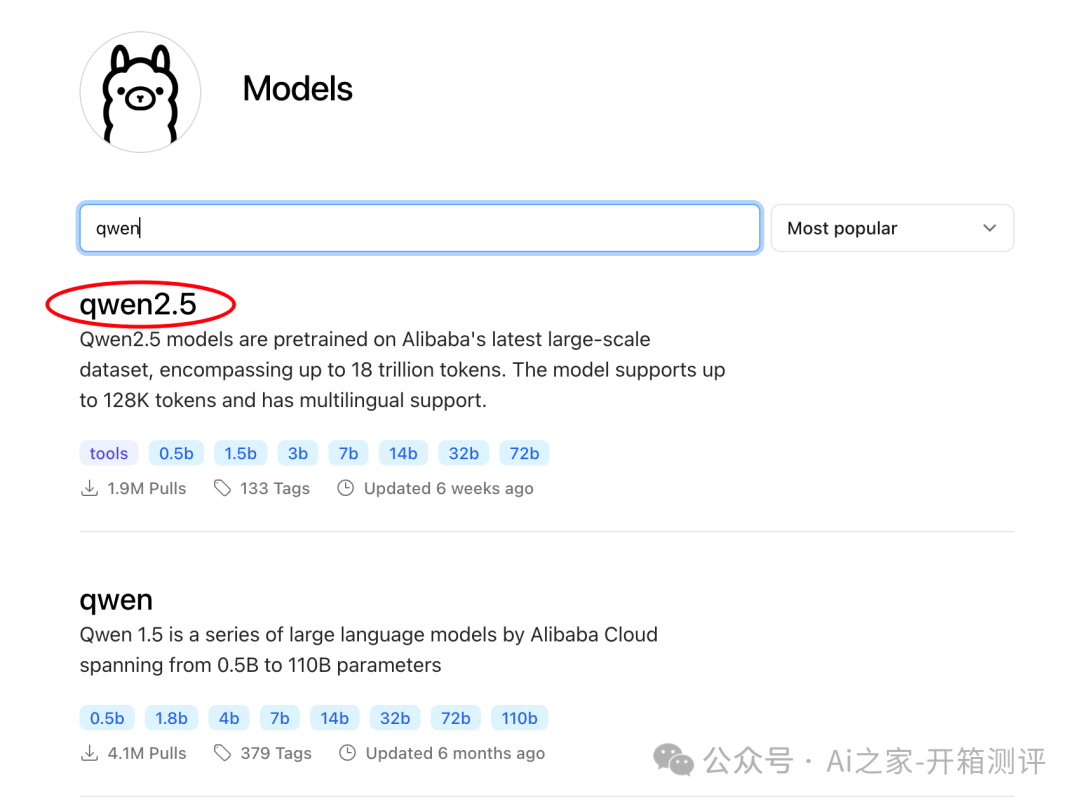

3.1 去模型仓库搜索模型

我们在上面提到的Ollma模型仓库中找到最新的千问大模型

点进去,界面如下:

点进去,界面如下:

3.2 加载模型

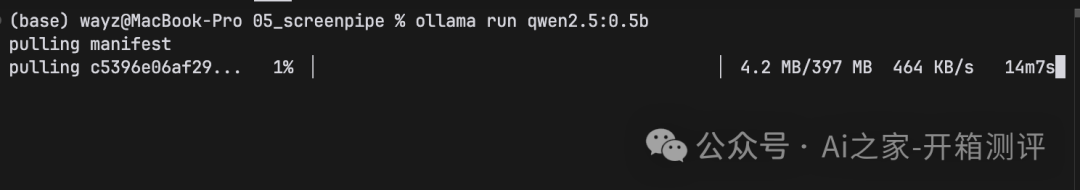

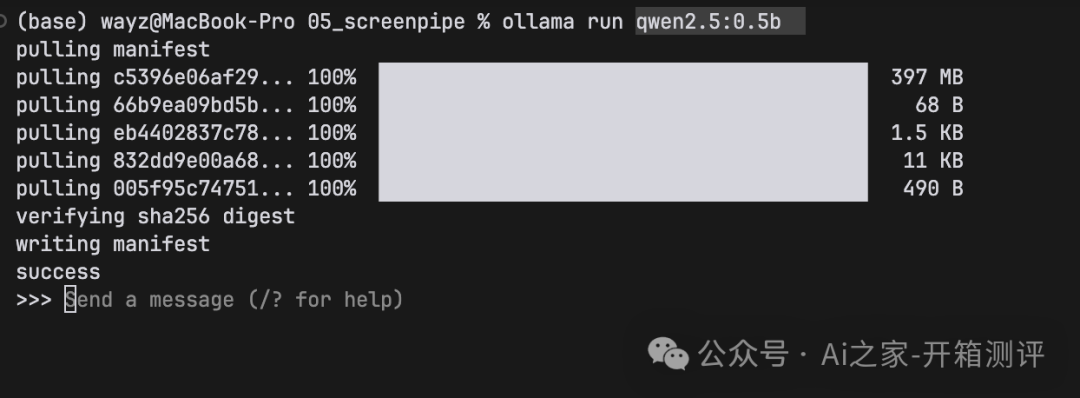

将上面的命令复制到命令行,回车执行!等待下载

等进度100%了,即可使用模型

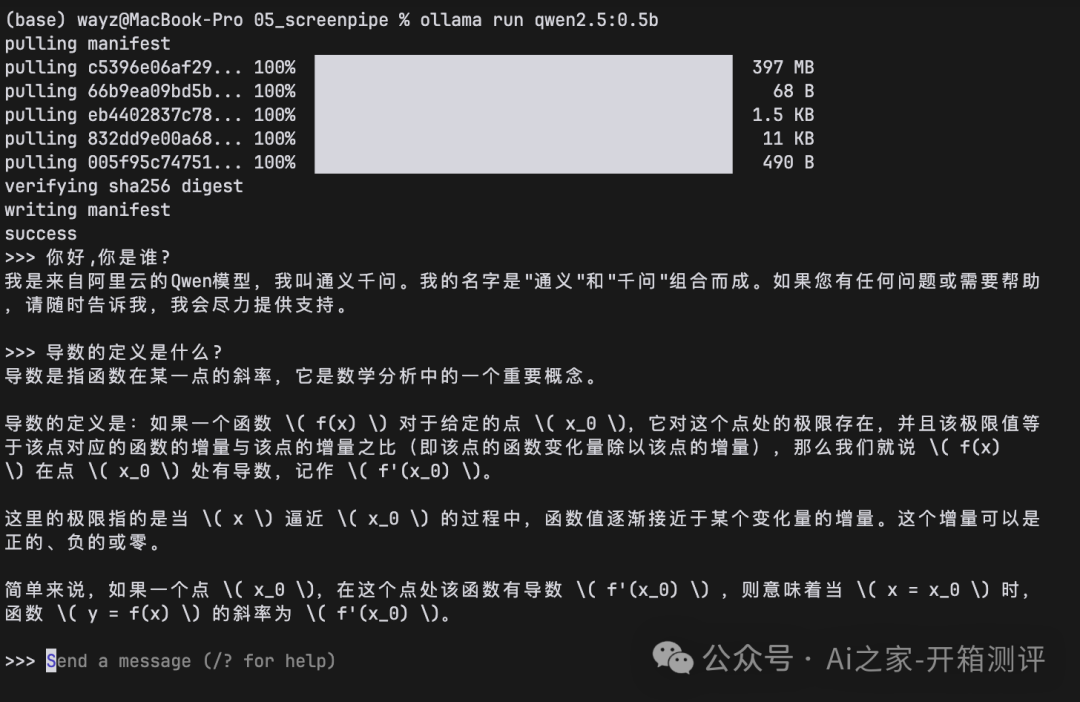

3.3 使用模型

在命令行中,即可开启与千问大模型的对话,看到这里,是不是感觉很简单,快去点个赞!

输入/bye方可结束对话。

都看到这里了,点个赞再走吧!码字实属不易呀。

4. 部署webUI可视化对话

本文使用FastAPI 部署Ollma可视化页面,简单4步即可

1、克隆仓库

git clone https://github.com/AXYZdong/handy-ollama

克隆完成进入目标目录:

cd handy-ollama/notebook/C6/fastapi_chat_app

2、安装依赖

pip install -r requirements.txt

pip install 'uvicorn[standard]'

3、修改app.py 代码

输入vim websocket_handler.py命令(确保你在fastapi_chat_app目录下先)更改model代码

#!/usr/bin/env python

# -*- coding: utf-8 -*-

import ollama

from fastapi import WebSocket

async def websocket_endpoint(websocket: WebSocket):

await websocket.accept()

user_input = await websocket.receive_text()

stream = ollama.chat(

model='qwen2.5:0.5b',

messages=[{'role': 'user', 'content': user_input}],

stream=True

)

try:

for chunk in stream:

model_output = chunk['message']['content']

await websocket.send_text(model_output)

except Exception as e:

await websocket.send_text(f"Error: {e}")

finally:

await websocket.close()

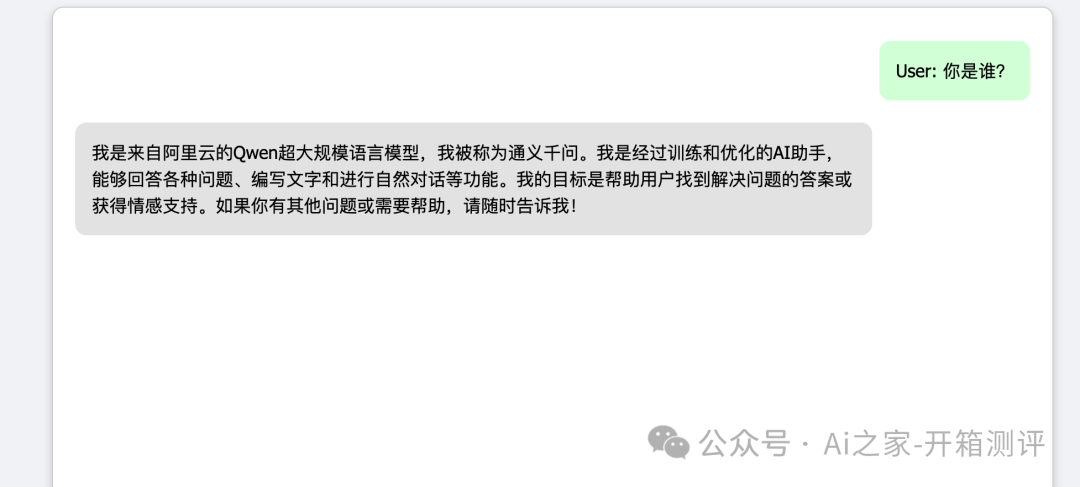

4、运行模型

输入命令:

uvicorn app:app --reload``

即可开始对话:

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

大模型全套学习资料领取

这里我整理了一份AI大模型入门到进阶全套学习包,包含学习路线+实战案例+视频+书籍PDF+面试题+DeepSeek部署包和技巧,需要的小伙伴文在下方免费领取哦,真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

6648

6648

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?